简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

它以云为基础,以AI为核心,构建了一个开放、立体感知、全域协同、精确判断和持续进化的智能系统。以百度文心智能体为例,在文心智能体平台创作专属智能体,并配置好指令如下图示例,以实现具体的功能诉求。配置完成后,即可实现AI对话,完成相应任务,比如咨询服务、写文章、制作营销规划、生成图片等功能。PC端样式移动端样式。

Chain-of-Thought(思维链,简称CoT)是一种改进的提示技术,旨在提升大型语言模型(LLMs)在复杂推理任务上的表现。Chain-of-Thought要求模型在输出最终答案之前,先展示一系列有逻辑关系的思考步骤或想法,这些步骤相互连接,形成了一个完整的思考过程。Chain-of-Thought可以通过两种主要方式实现:Zero-Shot CoT和Few-Shot CoT。

相比于每次开发单个模型的方式,这是一项本质上的进步。大型模型不仅可以缩短每个具体应用的开发周期,减少所需人力投入,也可以基于大模型的推理、常识和写作能力,获得更好的应用效果。因此,大模型可以成为 AI 应用开发的大一统基座模型,这是一个一举多得、全新的范式,值得大力推广。包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。观看零基础学习书籍和视

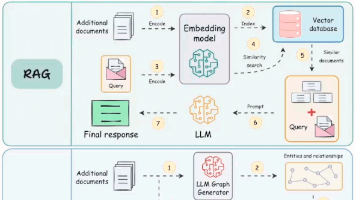

例如,当客户询问复杂的技术问题时,ConnectNow的AI Agent能够调用企业内部知识库,或通过API接口查阅最新的产品资料,为客户提供准确的技术解答。LLM大模型、RAG检索增强与AI Agent的关系,可以通过一个简单的类比来理解:如果把AI Agent比作一个智能助手,那么LLM就是这个助手的"思考中枢",而RAG则是他随时可以查阅的"智能知识库",为LLM提供信息补充,通过连接本地知

文章系统探讨了如何利用大语言模型重塑智能客服系统,提出"领域大模型脑"与"知识图谱骨架"深度融合的架构。详细解析了从RAG到GraphRAG的技术演进路径,包括领域专家模型的锻造方法、知识增强技术、安全与体验平衡策略,以及智能客服向AI智能体进化的未来趋势。强调新一代智能客服需具备"听得懂、找得准、办得成"的能力,通过技术重构实现从简单问答到任务执行的智能升级。

大模型支持多模态以后,带来了更多的应用场景,今天我们以图片识别为例,给大家介绍五个日常用例,目的是扩展思路,提高效率。我是基于Qwen3.0模型,它是上个月发布的多模态大模型,之前的文章里介绍了它的生图功能,实际上它的图片识别能力更强一点。文章最后也会列出来国内目前可用的各种多模态大模型。

相较于其他人工智能模型,DeepSeek 有免费且功能强大的优势。但其容易崩溃且幻觉率高的问题,极大限制了实际应用价值;通过本地部署 DeepSeek 并结合知识库搭建的方案,可以解决以上两个问题。下面将详细介绍如何本地部署并且搭建个人知识库。

文章主要介绍了多模态大模型(特别是Qwen3.0)在图片识别方面的五个日常应用场景:植物识别、动物识别、景点识别、图片对比和书籍统计。这些应用展示了多模态大模型如何帮助用户提高生活和工作效率,解决实际问题。文章还提到国内可用的多模态大模型包括豆包、元宝和千问,鼓励读者尝试使用这些工具解决日常问题。

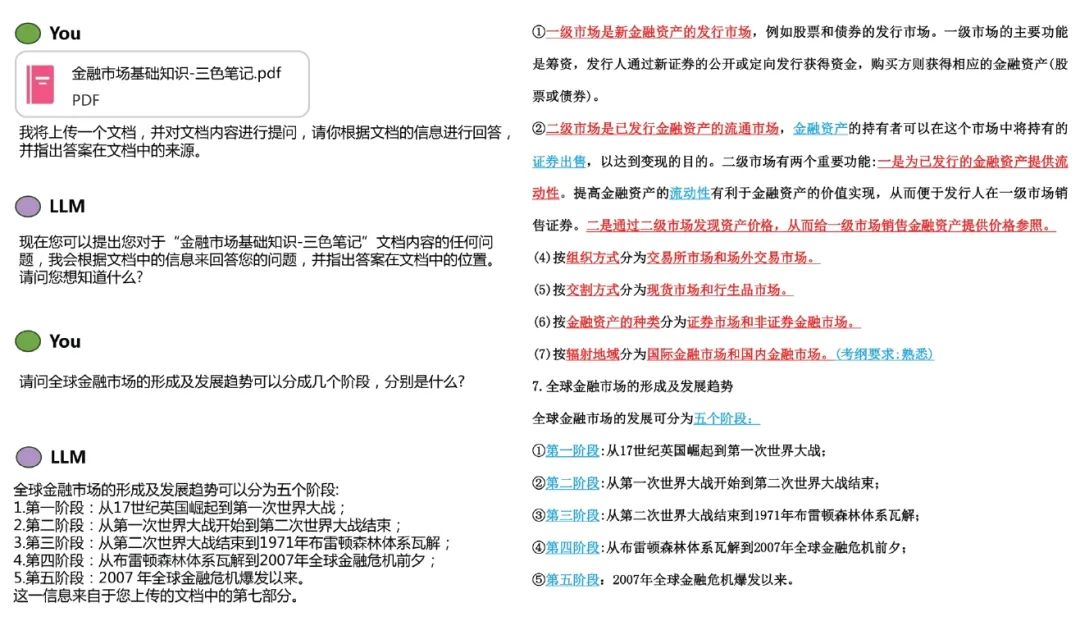

随着人工智能技术的不断发展,大语言模型(Large Language Models,LLMs)在金融行业的创新应用受到业内广泛关注。大语言模型的核心功能是能够理解和生成人类语言,使计算机能够更加智能地处理自然语言场景下的复杂任务。近年来,大语言模型在问答、文本生成、翻译等多种自然语言处理任务中表现出色。GPT-3等大语言模型采用自回归生成策略,可在没有预设答案的情况下生成连贯、相关的文本,这种策略

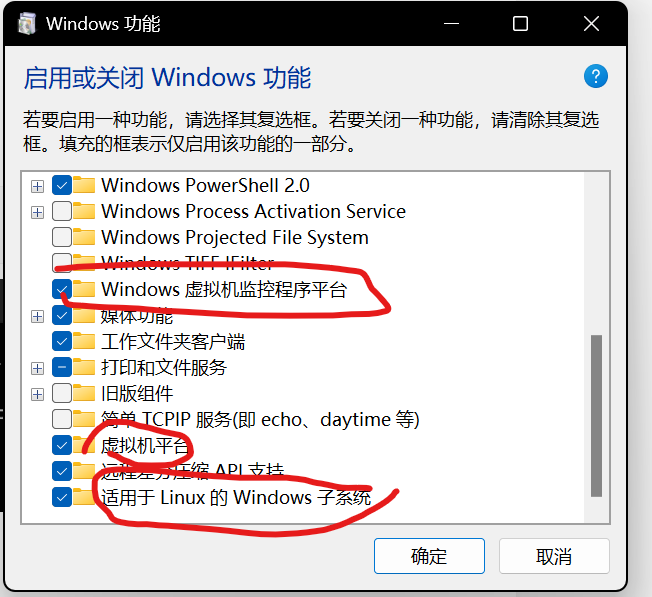

在大模型快速发展的今天,工作生活往往会依赖语言模型(我爸和我吵架直接就丢个问gpt的截图出来),但是online的模型都会保存你的用户画像以产出更适合你的回答,在本地部署LLM可以让你自己的数据更有隐私并且免费无限制可以离线工作。我用来测试的一台机器的配置如下:首先需要你的电脑安装wsl然后在windows功能中,对于打红框的三个勾选,然后重新启动重新启动后打开开始界面会多一个ubuntu点击在命