简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

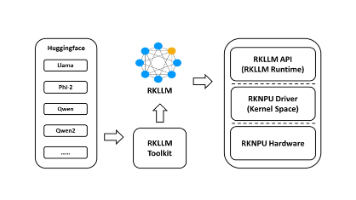

本文介绍了基于RK3588开发板的端侧大语言模型(LLM)开发实战指南。主要内容包括:1) 端侧LLM的优势,如隐私安全、低延迟等;2) RK3588芯片特性及RKLLM软件架构;3) 模型转换流程与代码示例;4) RK3588上的模型部署方法;5) C++ API开发示例;6) 支持的模型列表。文档提供了从模型转换到部署的完整流程,适合开发者快速上手端侧LLM开发。

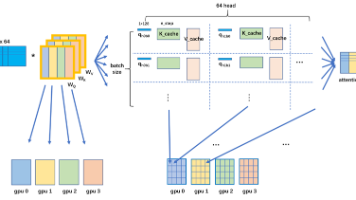

文章摘要 本文系统介绍了大型语言模型(LLM)推理的核心技术与实践方法。首先阐述了LLM推理的定义及其与训练的区别,重点分析了Transformer架构在推理中的关键作用,特别是Decoder-only模型的自回归特性和自注意力机制。随后详细说明了推理流程,包括tokenization、模型加载、前向传播等环节,并提供了基于vLLM的环境搭建和代码示例。最后探讨了推理性能评估指标,如延迟、吞吐量和

OpenClaw 遵循“文件即真理”(Files are the source of truth)这意味着AI的记忆、人格和规则,不再是黑盒,而是全部物理存储在你本地的 Markdown 文件中,不仅数据绝对安全,还能跨会话持续自我进化

openclaw20260324版本+windows框架下的更新使用及分析代码。

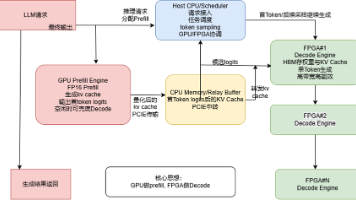

本文提出了一种创新的异构计算架构GLITCHES,通过将大模型推理任务拆分为Prefill(理解)和Decode(生成)两个阶段,分别分配给GPU和FPGA执行。研究显示,GPU擅长处理计算密集的Prefill阶段,而FPGA在带宽受限的Decode阶段更具优势。系统采用流水线设计掩盖数据传输延迟,并通过优化FPGA的HBM访问模式提升带宽利用率。实验结果表明,相比纯GPU或纯FPGA方案,这种异

openclaw20260324版本+windows框架下的更新使用及分析代码。

OpenClaw 遵循“文件即真理”(Files are the source of truth)这意味着AI的记忆、人格和规则,不再是黑盒,而是全部物理存储在你本地的 Markdown 文件中,不仅数据绝对安全,还能跨会话持续自我进化

OpenClaw 遵循“文件即真理”(Files are the source of truth)这意味着AI的记忆、人格和规则,不再是黑盒,而是全部物理存储在你本地的 Markdown 文件中,不仅数据绝对安全,还能跨会话持续自我进化

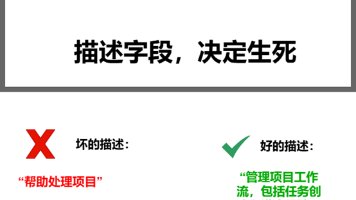

摘要: 本文介绍了SKILL.md的编写规范和OpenClaw的新变化。SKILL.md是技能的核心指令文件,需包含头部信息(名称和描述)和正文指令,描述需具体明确触发条件。技能文件夹可包含scripts、references、assets等辅助内容。文章以PDF技能为例,展示了如何定义功能范围和实现方案。此外,OpenClaw新增了5个核心技能(如实时搜索、图像识别等),并提供了恢复管理权限的命

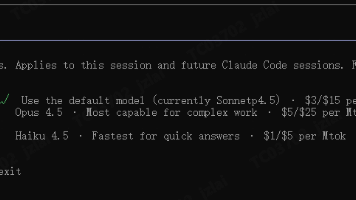

本文介绍了Claude Code AI工具的安装和使用方法。首先需要安装Node.js运行环境,然后通过npm安装Claude Code。为解决国外API的网络限制,建议使用智谱API并配置国内模型。文章详细说明了从申请API Key到替换模型的完整步骤,并介绍了Skills功能的用法,包括下载预置技能和让AI自动寻找适用技能的方法。整个安装过程可能需要较长时间,但完成后可以体验AI自动生成PPT