简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

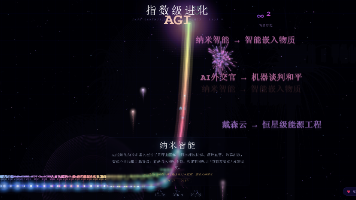

《AI指数级进化:一场跨越千年的智能之旅》通过可视化呈现了人工智能从1950年至今的发展轨迹。文章指出,AI发展呈现典型的指数曲线特征:早期缓慢进步,2012年AlexNet突破后加速,2020年GPT-3展现"涌现能力",目前正处于多模态觉醒阶段。作者强调,人类线性思维往往低估AI进步速度,而实际发展已远超预期——AI已能进行科学发现、控制机器人,并开始自我改进。未来将迎来智

本文系统总结了通往AGI(通用人工智能)的技术路径与挑战。首先回顾了大模型修炼的四个关键阶段:数据准备、预训练、监督微调和强化学习对齐,分析了当前模型在记忆、推理、规划等方面的局限。文章探讨了五条可能的AGI发展路径:扩大规模、架构创新、多模态融合、具身智能和Agent系统,并展望了短期、中期和长期的技术发展趋势。最后强调了AI开发者的社会责任,提出"以善为本、安全为先"的修炼

本文系统总结了通往AGI(通用人工智能)的技术路径与挑战。首先回顾了大模型修炼的四个关键阶段:数据准备、预训练、监督微调和强化学习对齐,分析了当前模型在记忆、推理、规划等方面的局限。文章探讨了五条可能的AGI发展路径:扩大规模、架构创新、多模态融合、具身智能和Agent系统,并展望了短期、中期和长期的技术发展趋势。最后强调了AI开发者的社会责任,提出"以善为本、安全为先"的修炼

文章摘要: 本章探讨大模型发布后的持续优化策略,强调迭代升级是保持竞争力的关键。主要内容包括:1)通过用户反馈收集与分析定位改进方向;2)持续积累和更新训练数据;3)三种迭代策略(全量更新/增量更新/混合更新)的优劣对比;4)A/B测试验证新版本效果的标准流程;5)版本管理与应急回滚机制。核心观点指出:模型优化是永续过程,需要建立数据闭环、科学评估体系和完善的版本管理,才能在快速迭代中平衡创新与稳

文章摘要: 本章介绍模型发布方式,包括开源发布、API服务和私有部署。开源发布适合研究社区,需准备模型文件、文档并选择许可证;API服务提供按需调用,可采用vLLM等框架部署;私有部署确保数据安全,支持本地、Docker等方式。不同场景可选择混合模式,满足商业、定制等需求。

文章摘要: 本章系统介绍了大模型评估的体系与方法。评估如同武林大会的比武较量,通过标准化测试检验模型真实能力。主要内容包括:1)评估维度涵盖知识、推理、语言、代码等核心能力;2)主流基准测试如MMLU(综合能力)、GSM8K(数学推理)、HumanEval(编程能力)等;3)评估方法包括自动评分、人工评审和LLM-as-Judge;4)注意事项强调避免数据泄露、过拟合等陷阱。评估需多维度、真实场景

摘要: 当前AI正迈向AGI临界点,智能体协作与"世界模型"成为核心突破方向。传统对话式AI(Chat范式)正被能自主规划执行的智能体取代,而世界模型让AI具备物理世界理解能力。多智能体协作架构和标准化协议推动AI从"工具"向"生命体"演进,引发对自主进化、经济规律驱动和人类角色定位的深层思考。尽管AGI时间表仍存争议(2026-2045

对齐训练后,模型看似安全,但攻击者可能通过各种手段绕过安全限制。红队测试(Red Teaming)通过模拟攻击发现漏洞,是确保模型安全的关键环节。

摘要: DPO(直接偏好优化)是一种革新性的大模型对齐方法,相比传统RLHF具有显著优势。它通过数学推导直接优化策略,跳过了奖励模型训练和PPO强化学习阶段,实现了更简单高效的偏好学习。核心原理是将奖励函数表示为策略与参考模型的比值,并构建基于Bradley-Terry模型的损失函数。实验表明,DPO在效果相当甚至更好的情况下,训练更稳定、计算成本更低、调参更简单。文章详细解析了DPO的数学原理、

摘要 RLHF(人类反馈强化学习)是AI对齐的核心方法,通过三个阶段使模型学习人类偏好: 监督微调(SFT):用高质量数据微调预训练模型,建立基础指令遵循能力 奖励模型训练(RM):学习人类偏好数据,构建能判断回答质量的奖励函数 PPO强化学习:在奖励模型指导下优化生成策略,通过KL散度约束确保稳定性 关键点包括:基于人类标注的偏好数据训练奖励模型,使用PPO算法在奖励信号下优化策略,同时保持与参