简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

2025 年是大模型应用爆发的一年。从年初的 DeepSeek 吸引大量开发者部署大模型产品,到 Manus 和 MCP 等 Agent 方案持续引发关注,行业内掀起了一股打造爆款大模型应用的热潮。然而,在这股热潮中,大模型的安全性问题往往被忽视。事实上,AI 应用的安全性是实现完整大模型应用的关键环节。2024 年的一篇文章中,曾介绍过大模型应用的完整架构:其中,安全模块主要包括输入围栏(Inp

一般情况下我们不需要进行开源项目的二次开发,因为开源项目往往会提供良好的封装,可以通过依赖包或 API 服务的形式引入项目中。如果开源项目存在一些问题,我们往往可以通过给开源项目提供 PR 来解决,这样就可以尽可能减少二次开发开源项目的问题。但是某些情况下可能会需要基于开源项目开发自己的服务,需要一个相对长周期二次开发。不需要开源项目后续的更新,这种情况比较简单,直接拉取代码进行开发就好,当然要注

通过上面的内容,将 Flower 框架的动手实践以及对应的实现细节都介绍到了,主要涉及到 Flower 三大核心组件中的 Strategy 与 FL loop,而 ClientManager 目前没有过多展开,这部分主要用于管理客户端的连接,有兴趣的可以自行去探索下。从目前来看,Flower 基本上是一个最精简的横向联邦学习的实现方案了,通过必要的抽象简化,Flower 将横向联邦用简单易用的方式

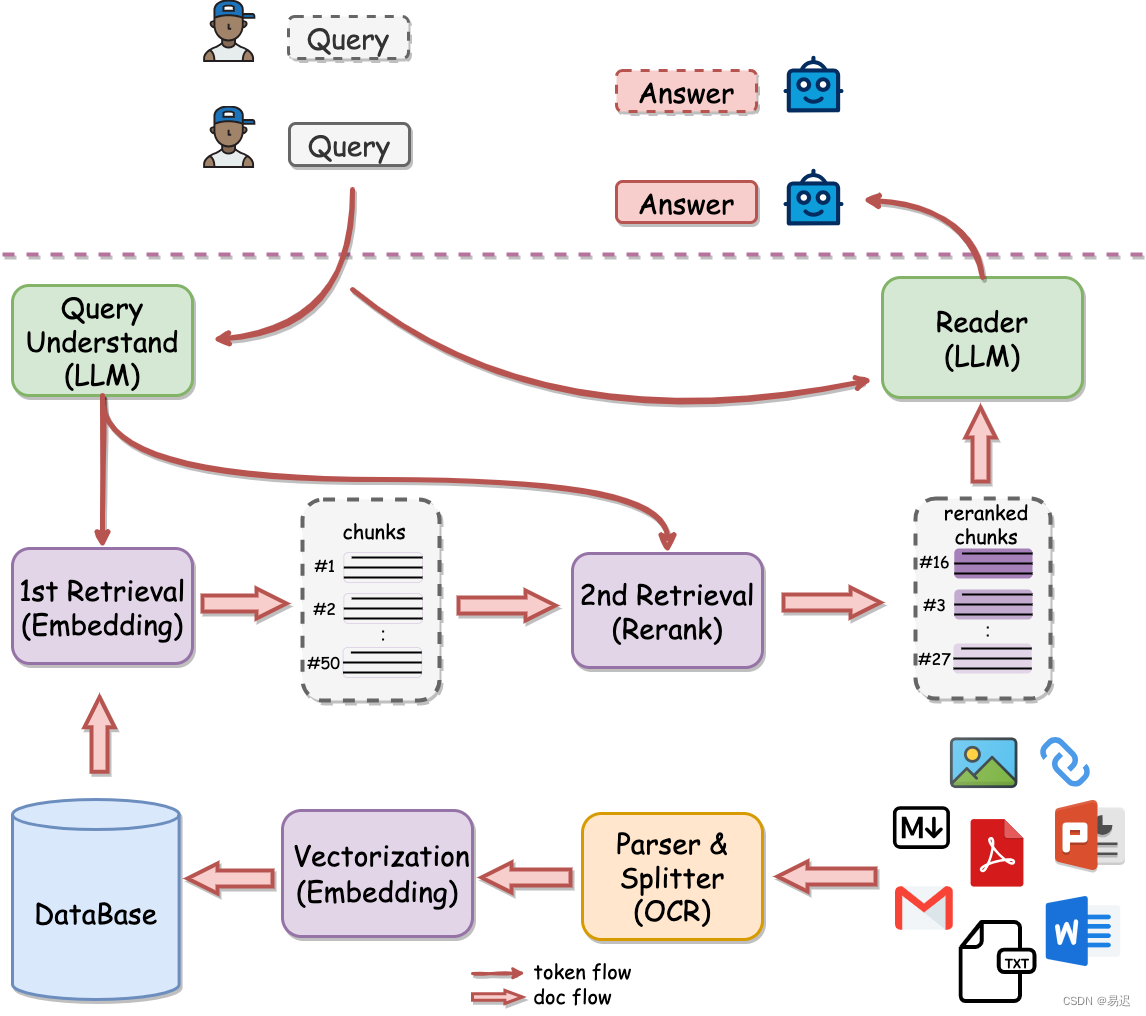

之前在做大模型知识库 RAG 优化时,主要参考的都是学术界的论文。最近了解到有道 QAnything 开源了,在线试用之后,效果看起来还不错,燃起了探索其实现细节的兴趣。正好对于 RAG 各个环节的最佳实践存在一些疑问,因此深入查看了有道 QAnything 的完整实现流程,学习下来自工业界大厂有道的实践方案,在这边分享给大家。本文章基于的是 2024-5 月最新的版本v1.4.0,这个项目还在持

过去几年,持续在医疗领域的大模型应用进行实践探索,个人在大模型技术专栏中持续积累了近 60 篇相关技术博客。过往的实践中,尝试了RAG、Agent、模型微调、知识图谱等多种技术路线,医学通用场景下 RAG 的准确率已由最初的不足 50% 提升至 90% 左右。然而,医学作为高度严谨的应用场景,90% 的准确性依旧无法完全满足生产需求。2025 年以来,进一步聚焦医学细分场景,尝试了不同的场景化大模

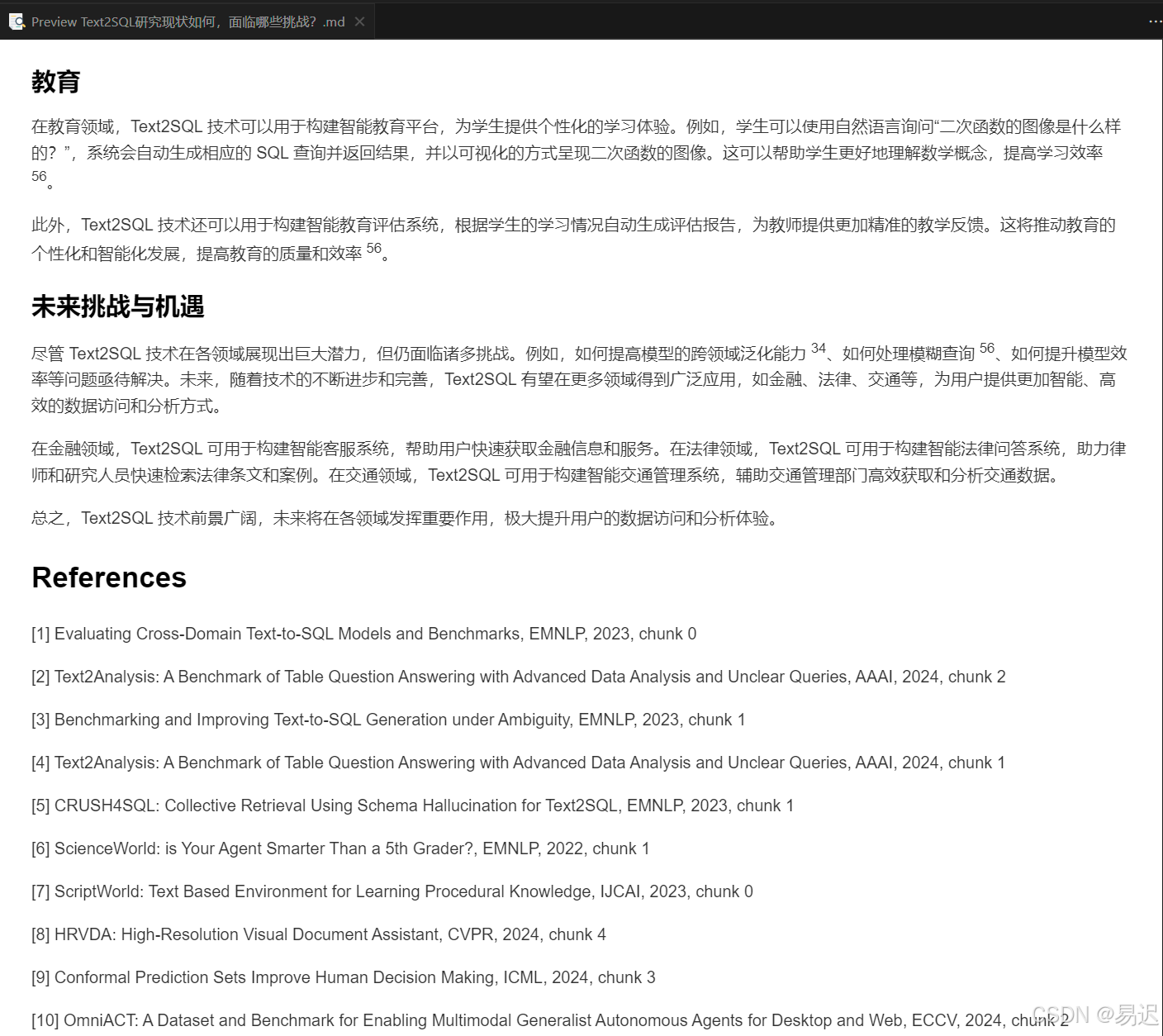

最近各种新的大模型辅助科研工具持续出现,在之前的文章中就介绍过NVIDIA 的结构化报告生成方案,最近 OpenAI 也推出了类似的产品,叫做。Deep Research 可以根据需要进行深度的调研与信息整理,但是只有 Pro 用户才能享受到,$200 的价格直接劝退。在调研后发现了开源项目AutoSurvey,相对之前的 NVIDIA 的方案更加完整,不仅包含了完整的报告生成,还能自动生成文献列

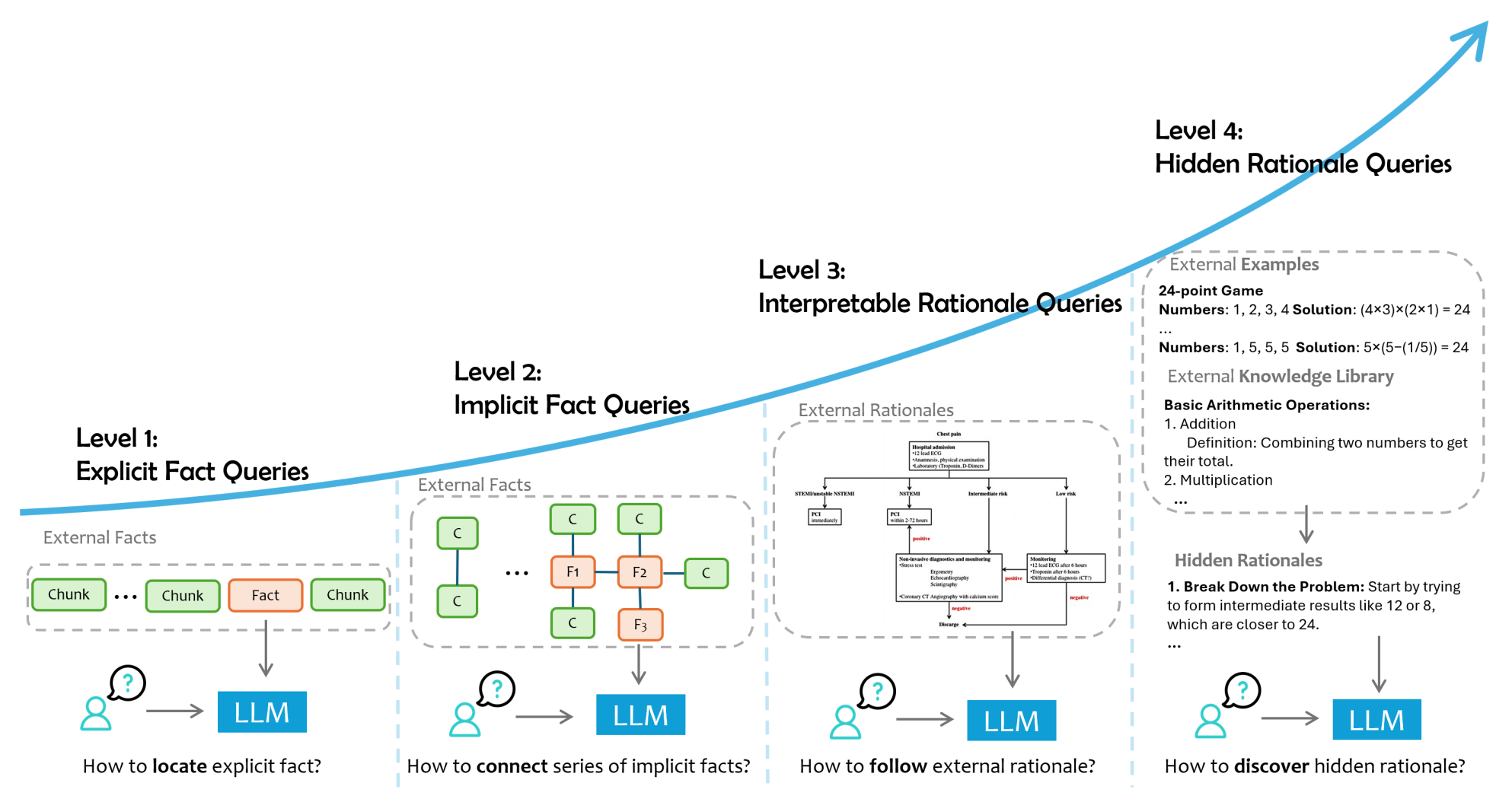

随着大模型技术的发展,RAG(检索增强生成)已成为提升AI应用能力的标配方案。在过去两年中,我从最初的 langchain Demo 实践,到QAnything和RagFlow等项目的探索,见证了检索技术从简单的向量检索发展到知识图谱和 Agentic RAG 的过程。然而随着实践深入,RAG 方案的局限性逐渐显现。在处理复杂的现实场景时,简单的检索增强往往力不从心。如何更好地利用外部数据成为了一

最近因为岗位扩张,经历了密集的简历轰炸。在短短一周内抽空筛查了接近 100+ 的前后端的简历筛选,和 HR 沟通之后,她反馈她那边已经做过一轮简历筛选,过滤掉接近 90% 的简历了,预期 HR 在短期内需要处理 1000+ 的简历筛选。考虑到这个工作的重复性,而且简历内容的筛查还存在一些明显的技术门槛,没有相关的技术背景容易误判,似乎有自动化的必要性。我们当前有一台测试服务器,上面部署了一套Dif

今年以来,关于 Vibe Coding 的内容就持续出现,甚至经常会还有程序员会被完全替代的说法。从我之前的经验来看,出现的这种新现象主要来自于两种情况:大模型的特定领域的能力逐渐成熟,考虑到大模型一次性解决所有行业变得不那么现实的情况下,当前的大模型会有意识在特定领域进行明显的强化,比如编程,数学等。行业工具的成熟,随着 Cursor,Windsurf,v0 等工具的成熟,大模型 + 领域场景的

最近抽空参加了一个讯飞的 RAG 比赛,耗时两周终于在最后一天冲上了榜首。整体的框架是基于 RAG 能力有点弱弱的 Dify 实现。在比赛调优的过程中,经常需要批量提交几百个问题至 Dify 获取回答,并需要跟踪多轮调优的效果差异。借助 Langfuse 可以通过网页跟踪结果,相对比较方便了很多。但是现有版本的 Langfuse 不支持提交文件构建数据集,私有化部署的版本也不支持自动化评估,多版本