简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

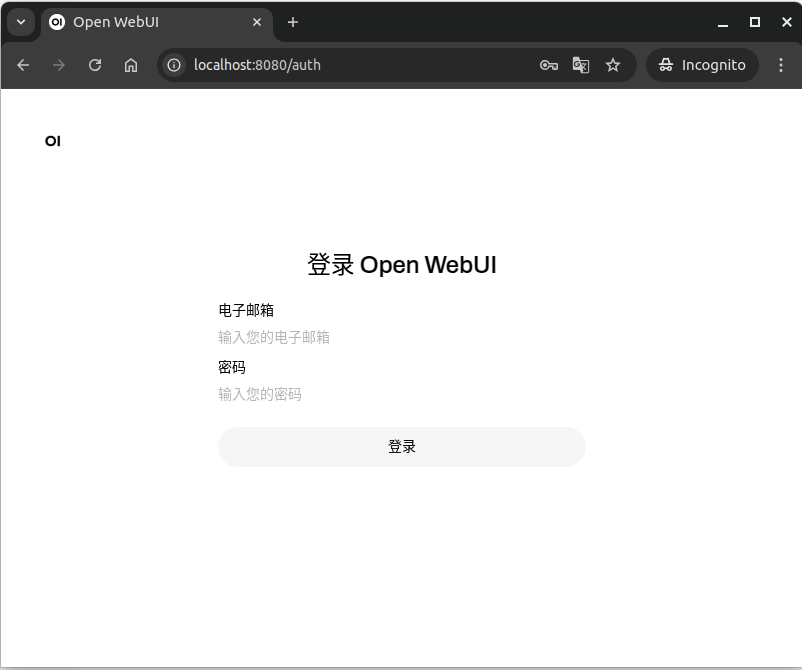

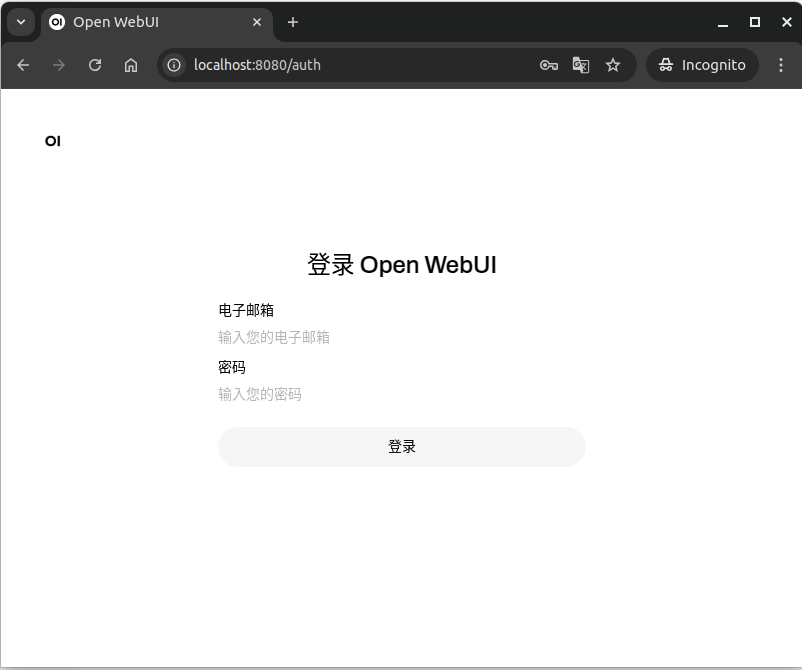

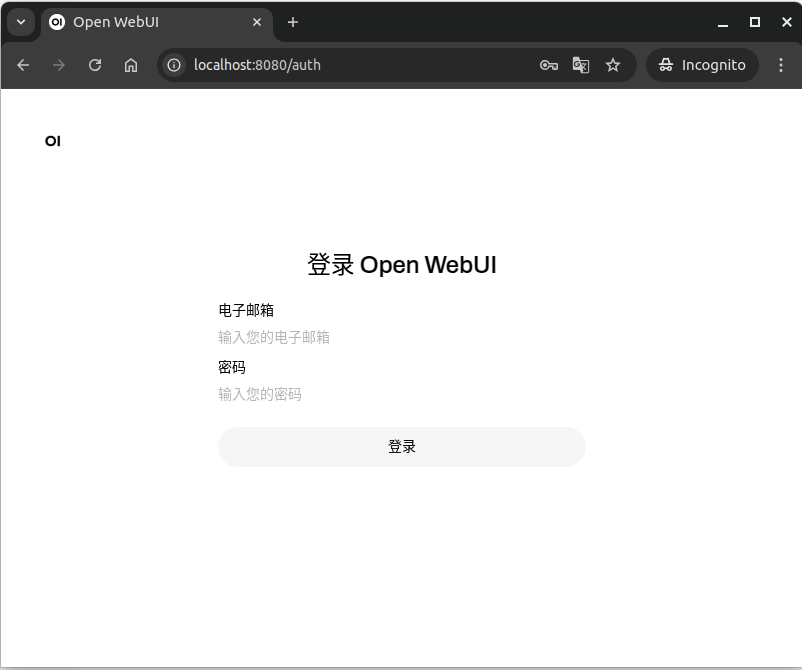

本指南详细介绍了如何在本地通过 Ollama 部署 DeepSeek-R1 模型,并集成 Open WebUI 进行交互。首先,确保硬件(如 GPU、内存)和软件(如操作系统、依赖项)满足要求。接着,安装 Ollama 并部署 DeepSeek-R1 模型,随后安装 Open WebUI 并配置与 Ollama 的连接。最后,提供了优化显存和网络加速的建议,帮助用户更好地使用和调试系统。

本文主要说明如何使用llamacpp部署的huggingface gguf模型,以及如何使用ClaudeCode调用llamacpp的模型

本指南详细介绍了如何在本地通过 Ollama 部署 DeepSeek-R1 模型,并集成 Open WebUI 进行交互。首先,确保硬件(如 GPU、内存)和软件(如操作系统、依赖项)满足要求。接着,安装 Ollama 并部署 DeepSeek-R1 模型,随后安装 Open WebUI 并配置与 Ollama 的连接。最后,提供了优化显存和网络加速的建议,帮助用户更好地使用和调试系统。

摘要 本文介绍了两种安装flash_attn库的方法。第一种是手动下载与当前环境匹配的预编译wheel文件(需匹配Python、Torch和CUDA版本),通过判断GLIBCXX_USE_CXX11_ABI值选择TRUE/FALSE版本。第二种提供了自动生成所需wheel文件名的Python脚本,该脚本会检测系统环境参数(CUDA版本、Torch版本、Python版本、ABI标志和平台信息)并生成

CPU: Intel13th Gen Intel® Core™ i9-13900K (32 核)内存: 64GB+(模型加载后占用约 20GB 内存)存储: 50GB+ 可用空间(模型文件约 20~30GB)操作系统: Linux (Ubuntu 24.04+)NVIDIA 驱动版本:590.48.01。

本文介绍了Ubuntu系统安装桌面环境和远程访问xrdp服务的方法。首先通过apt命令安装ubuntu-desktop桌面环境,然后安装xrdp服务并配置用户权限。为确保远程访问,需要开放3389端口防火墙规则,文中提供了两种方式:允许特定IP范围或完全开放该端口。完成这些步骤后,用户即可通过远程桌面连接访问Ubuntu系统。

摘要 本文介绍了两种安装flash_attn库的方法。第一种是手动下载与当前环境匹配的预编译wheel文件(需匹配Python、Torch和CUDA版本),通过判断GLIBCXX_USE_CXX11_ABI值选择TRUE/FALSE版本。第二种提供了自动生成所需wheel文件名的Python脚本,该脚本会检测系统环境参数(CUDA版本、Torch版本、Python版本、ABI标志和平台信息)并生成

默认proxy_ip: 127.0.0.1默认proxy_port:9780。

本文介绍了pnpm的安装与使用指南。主要内容包括:通过npm全局安装pnpm的步骤、验证安装的方法;可选配置镜像源以提升下载速度;基本使用命令如初始化依赖和添加单个包;注意事项部分涵盖权限要求、环境变量配置、硬链接机制以及避免混用包管理器;最后提供了卸载pnpm的方法。全文简明扼要地指导用户完成pnpm从安装到使用的完整流程。

本指南详细介绍了如何在本地通过 Ollama 部署 DeepSeek-R1 模型,并集成 Open WebUI 进行交互。首先,确保硬件(如 GPU、内存)和软件(如操作系统、依赖项)满足要求。接着,安装 Ollama 并部署 DeepSeek-R1 模型,随后安装 Open WebUI 并配置与 Ollama 的连接。最后,提供了优化显存和网络加速的建议,帮助用户更好地使用和调试系统。