简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

对于双卡 4090D请使用Docker 容器化部署或多进程脚本。容器 A(端口 8000):绑定,跑模型 A。容器 B(端口 8001):绑定,跑模型 B。这是最干净、最不容易报错的方式。使用 vLLM 的LoRA 功能。3、如果显存不够分怎么办?利用 vLLM 的参数。例如,你可以强制两个模型都只使用 50% 的显存(如果它们都在同一张卡上),但这通常只适合非常小的模型。对于大模型,物理隔离(一

打开“Model Configuration”,然后打开“Prompt Format”,向下滚动到“Pre-prompt / System prompt”,选择“>”符号打开。根据计算机的能力/速度,较大的模型将更准确,但速度较慢。对许多人来说,运行本地LLM需要一点计算机知识,因为它通常需要在命令提示符中运行它们,或者使用更复杂的web工具,如Oobabooga。点击左边的一个模型,右边就会显示

要自定义 Ollama 的安装,您可以通过运行以下命令来编辑 systemd 服务文件或环境变量或者,在中手动创建一个覆盖文件[Service]

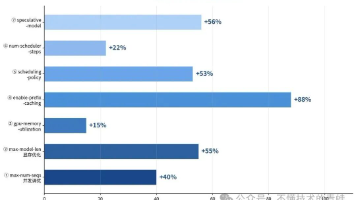

vLLM 用起来很简单,一行命令就能跑起来。这其实不奇怪。vLLM v0.20.0 功能已经很完善了,但默认参数追求的是"能跑就行",不是"跑得最好"。大多数关键配置项留给了用户自己调优——而这些参数分散在文档里,新手根本不知道哪些值得调,调到多少合适。根据 A100 80G 上 Qwen-14B-INT4 对比测试,整理出这 7 个参数。每个参数从数据、甜点值和生产建议分析整理。

前三层是“上游仓库”,提示词缓存是“唯一送进模型嘴巴里的那口饭”。缓存不是让AI更聪明,是让它少做重复计算。越不爱变的越往前放,变得越快的越往后放。没有命中率监控的缓存,等于没做。

及格线:TPS > 10(能跟上人类阅读速度,不觉得卡)。优秀线:TPS > 50(几乎是瞬间生成大段文字)。工业级目标:追求极高的 TPS(如 1000+),是为了同时服务成千上万的用户,降低单次推理的成本。

在通常的 RAG(检索增强生成)流程中,当用户提出查询请求时,系统首先通过 Embedding 模型对 Query 进行向量化,然后和向量数据库里预存的文档向量进行相似度计算,即从海量候选文档中快速筛选出一批初步相关的文档,这一阶段称为初步检索然而,初步检索结果的相关性往往并不精确,因为 Embedding 模型更擅长捕捉粗粒度的语义相似性,难以准确判断文档与 Query 之间细粒度的语义匹配程度

如果把大模型比作一个“大脑”,那么智能体(Agent)就是给这个大脑装上了“眼睛、耳朵、手和脚”。普通大模型:就像一个博学的“顾问”。你问它问题,它给你回答(文本或代码)。它的边界止步于“给建议”,它无法真正去操作你的电脑、查询实时数据库或帮你下单买东西。支持智能体的大模型:就像一个能干的“数字员工”。你给它一个目标(比如“帮我查一下明天济南的天气并订一张去北京的机票”),它不仅能思考,还能自主拆

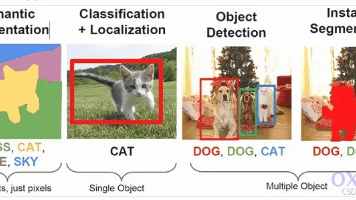

YOLO)是基于深度神经网络的目标检测算法,用在图像或视频中实时识别和定位多个对象。YOLO的主要特点是速度快且准确度较高,能够在实时场景下实现快速目标检测。YOLO是一种快速而准确的目标检测算法,被广泛应用于计算机视觉领域,包括实时视频分析、自动驾驶、安防监控、智能交通、缺陷检测等。在YOLO诞生之前,目标检测领域热门的深度学习模型是R-CNN系列模型,称之为二阶段模型(two-stage),其

当我们追问"为什么要用LLM是如何理解"结构"的?通过特殊的、不可分割的、在训练中被反复强化的标记。就像人类用标点符号区分句子,用段落分隔主题,LLM也需要自己的"标点符号"。就是LLM世界里的"引号"——它告诉模型:“注意,接下来的内容属于某个特定角色。理解这一点,你就理解了prompt engineering的本质:你不是在"写文字",而是在构建一个token序列,用结构引导模型的注意力。下次