简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

摘要:此文非技术评测,而是一份关于Deepseek最新百万token窗口的真实工程“长程思考”实录。本人非AI与计算机专业,从事生物医学与心理学工作,人文爱好者。利用十天时间,通过浏览器deepseek云端模型对话窗口,实现了一套从本地环境设置、工具流搭建、数据建库与向量化的整个工程。本文记录了主要的过程与指标。

本文系统记录可计算元认知框架的工程实现,提供完整的数据处理流水线、三步语义分析法(垂钓 → 撒网 → 熔炉)的代码实现、跨领域向量对齐的技术细节以及元认知三要素(谬误类型分析、边界信号检测、贝叶斯网络推理)的可复用模块。文章同时阐释主观向量(Subjective‑Vector)机制在工作流中的作用,展示如何在YAML配置文件中显式声明研究者的四层决策(知识、认知、元认知、计算),实现半自动(age

从主观预设到客观挖掘,再到主客观统一——三步法(垂钓、撒网、熔炉)完成了百万token窗口语义分析的方法论闭环。本文展示了三步法的工程化封装:垂钓法、撒网法、熔炉法被封装为可复用的 Skills,通过半智能体调度器实现人在环中的流程控制。更重要的是,本文提出了“主观向量”的概念——将人的洞察(元认知、领域理解)量化为可注入、可迭代的向量形式,作为机器向量(RAG、知识图谱)的意义层。主观向量不仅是

构建了FAISS向量索引和包含200个概念节点、19,701条关系边的知识图谱。实验表明,熔炉法能够同时检索相关对话片段和概念关系,支持跨窗口问答,并为“主观向量注入”预留了接口。熔炉法完成了从“主观预设”到“客观挖掘”再到“主客观统一”的方法论闭环,为项目知识管理和跨窗口迁移奠定了可扩展的基础。

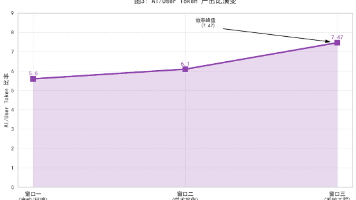

本文基于三个DeepSeek百万Token上下文窗口的长程项目实证数据,对窗口一(项目启动与环境搭建)、窗口二(窗口特性实验研究与论文)及窗口三(构建项目工程框架)的量化分析。结果显示,三个窗口的token数(cl100k base)高度一致,说明窗口内容与交互模式决定了各种主要指标的差异。随着项目阶段的推进,单轮对话平均字数呈上升趋势,AI/User Token产出比显著提升,且文本符号构成随任

基于已有的分脚本人工操作项目框架,与大模型讨论封装skills,agents及OpenClaw接口,部分成功,部分失败。出现了严重的上下文断裂,开始生成虚拟的抽象框架代码。最有趣的是之后关于这些现象的讨论,涉及到窗口稀疏注意力、OpenClaw适用于长程工程性、用户与大模型的交互模式等。尤其是大模型的反思以及提出的各种机制解释,颇具可读性。节选以供感兴趣读者参考。

基于已有的分脚本人工操作项目框架,与大模型讨论封装skills,agents及OpenClaw接口,部分成功,部分失败。出现了严重的上下文断裂,开始生成虚拟的抽象框架代码。最有趣的是之后关于这些现象的讨论,涉及到窗口稀疏注意力、OpenClaw适用于长程工程性、用户与大模型的交互模式等。尤其是大模型的反思以及提出的各种机制解释,颇具可读性。节选以供感兴趣读者参考。

本文基于第一个百万 token 窗口(以下简称 窗口 1)与第二个百万 token 窗口(以下简称 窗口 2)的完整对话数据,采用量化对比的方法,系统揭示两套对话在轮次、文本长度、语种构成以及估算 token 消耗方面的显著差异。研究发现,尽管窗口 2 的轮次和总字数均低于窗口 1,但其每轮对话的文本密度与估算 token 消耗显著更高。结合窗口 2 在生成 5 篇深度分析文章过程中的实际经验,本

摘要随着大模型上下文窗口扩展到 百万 token 级别,如何将已填满窗口的完整记忆迁移至新窗口已成为长上下文人机协作的关键挑战。本文在首个百万 token 窗口的深度分析成果(18 张结构化表、4 张核心图表、词频演进数据)的基础上,设计并实现了 六种具有代表性的跨窗口记忆迁移方法:

摘要本文基于 DeepSeek 百万 token 上下文窗口的真实对话记录(1 274 201 tokens,3 673 轮),系统性地分析了长达数十小时的人机协作过程。研究构建了 L1 基础数据层 → L2 项目演进层 → L3 关键转折层 → L4 互动模式层 → L5 情感记忆层 的五层分析框架,完整呈现了一位非 AI 专业背景的研究者(医学、心理学与人文领域)在完全依赖云端免费模型的条件下