简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

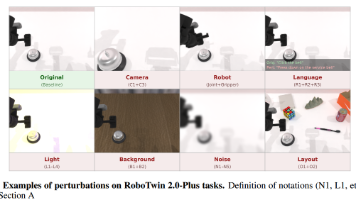

本文首次在统一基准下对比了机器人具身操作中的视觉-语言-动作模型(VLA)和世界动作模型(WAM)两大技术路线。实验表明:WAM在视觉类扰动中表现更鲁棒,得益于其从视频数据中学习的时空动态先验;但在几何配置类扰动中表现不佳,且推理速度显著慢于VLA。研究发现,通过大规模多样化数据训练,顶级VLA模型可以超越WAM的性能。文章为技术选型提供指导:WAM适合视觉干扰多、数据稀缺的场景,而VLA在需要实

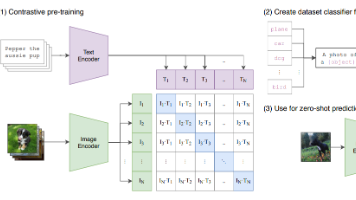

CLIP(Contrastive Language–Image Pretraining)是 OpenAI 提出的一种多模态模型,通过对大量“图像–文本”对进行对比学习训练,使模型能够将图像和自然语言映射到同一个语义空间中。它不需要为每个视觉任务单独标注数据,而是通过理解文本描述来完成图像分类、检索和零样本学习等任务,从而具备很强的泛化能力和跨模态理解能力

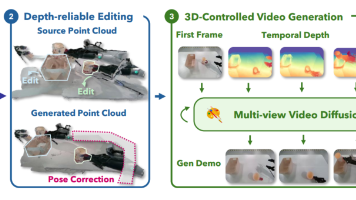

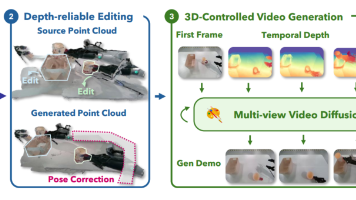

摘要: Real2Edit2Real提出了一种基于3D编辑的视频生成框架,用于增强机器人演示数据。该方法通过RGB输入重建3D场景,支持物体位姿编辑和轨迹生成,并利用深度条件视频生成模型合成逼真、多视角一致的视频。实验表明,该方法能有效提升视觉真实性和任务适应性,支持高度编辑和纹理变化,显著提高策略鲁棒性。相比传统仿真或点云方法,Real2Edit2Real仅需RGB输入,避免了物理建模和密集扫描

摘要: Real2Edit2Real提出了一种基于3D编辑的视频生成框架,用于增强机器人演示数据。该方法通过RGB输入重建3D场景,支持物体位姿编辑和轨迹生成,并利用深度条件视频生成模型合成逼真、多视角一致的视频。实验表明,该方法能有效提升视觉真实性和任务适应性,支持高度编辑和纹理变化,显著提高策略鲁棒性。相比传统仿真或点云方法,Real2Edit2Real仅需RGB输入,避免了物理建模和密集扫描

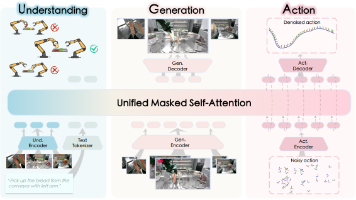

上海AI Lab提出InternVLA-A1模型,通过统一理解、生成与动作的混合Transformer架构,解决机器人操作中认知不足与自适应能力缺乏的瓶颈问题。模型采用理解、生成、动作三位专家协同工作:理解专家处理多模态输入获取语义信息,生成专家预测未来视觉状态,动作专家结合预测动态生成控制指令。训练采用两阶段策略,结合仿真与真实数据优化视觉预测与流匹配动作生成目标。实验在10项静态和动态操作任务

在安装MinkowskiEngine时遇到CUDA13.0与GCC版本不兼容问题。服务器环境为CUDA13.0+PyTorch2.9.1,当前GCC版本13.0导致安装失败。解决方案是降级GCC至12.3.0版本,与CUDA13.0匹配。参考了相关GitHub issue和博客教程,通过调整GCC版本解决了安装错误问题。该问题主要源于CUDA与编译器版本间的兼容性要求。

这篇论文提出了一个名为 RoboCOIN 的大规模、高质量、多模态数据集,专门用于训练和评估双臂机器人在复杂、长期、集成化操作任务中的能力。其核心目标是解决机器人学习领域缺乏能够支撑“闭环”任务(从感知到规划再到执行)的真实世界数据的问题。

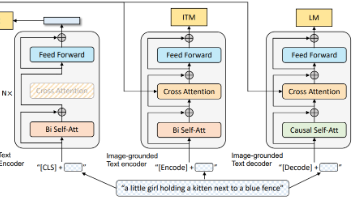

BLIP与BLIP-2是多模态视觉语言预训练模型,旨在解决视觉与语言对齐问题。BLIP通过统一编码器-解码器架构实现图文理解与生成,但存在端到端训练成本高的问题。BLIP-2引入轻量级Q-Former作为桥梁,采用两阶段训练策略:第一阶段通过对比学习、匹配任务和文本生成任务训练Q-Former提取关键视觉特征;第二阶段将Q-Former输出适配到冻结的大型语言模型(LLM),实现高效的多模态推理。

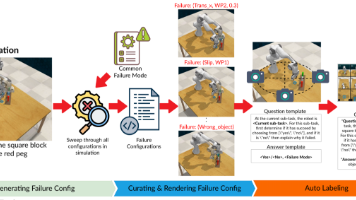

摘要:开放世界环境中的机器人操作不仅需要执行任务,还需要在执行过程中检测故障并从中学习的能力。虽然视觉语言模型(VLMs)和大型语言模型(LLMs)的最新进展增强了机器人的空间推理和解决问题的能力,但这些模型往往难以识别和推理故障,限制了它们在现实世界应用中的有效性。通过将故障检测视为自由形式的推理任务,AHA识别故障并生成详细的解释,这些解释适用于模拟和现实场景中的各种机器人、任务和环境。

这篇论文提出了一个名为 RoboCOIN 的大规模、高质量、多模态数据集,专门用于训练和评估双臂机器人在复杂、长期、集成化操作任务中的能力。其核心目标是解决机器人学习领域缺乏能够支撑“闭环”任务(从感知到规划再到执行)的真实世界数据的问题。