简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

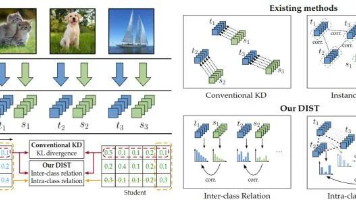

NeurIPS|2022|Knowledge Distillation from A Stronger Teacher:面向更强教师的知识蒸馏

本文来源于一个观察,即:当教师模型的体积增大时进行知识蒸馏过程,学生模型的性能提升并不明显;当使用更强的训练策略 (数据增强) 进行知识蒸馏过程,学生模型的性能提升也不明显。这启发作者的思考,可能是知识整理过程中经常使用的 KL 散度,这种精确匹配的模式 (即当且仅当教师和学生的输出完全相同时,损失达到最小值) 就显得过于苛刻。所以作者在本文的直觉是搞一种轻松的方式来匹配老师和学生之间的预测。

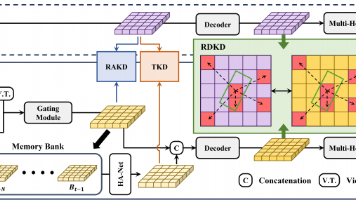

CVPR|2025|RCTDistill:基于时间融合的雷达—相机三维目标检测跨模态知识蒸馏框架

3.图中紫色(Teacher)、黄色(Student)特征图里,不同红色区块(代表不同目标)之间的虚线箭头,对应 “同一帧中多个目标的特征区分关系”—— 比如两个相邻目标的特征需要有足够差异,避免混淆,RDKD 会让 Student 学习 Teacher 中这种 “不同目标间的特征区分度”。:高层特征图输入检测头,生成分类得分图,取 “所有类别得分中的最大值”,得到置信度得分图,设定一个阈值,大于

到底了