简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

在 AI 技术全面爆发的背景下,企业数字化转型加速,传统软件测试面临高度依赖人工经验、重复操作繁重、用例覆盖不全等核心瓶颈,难以满足敏捷开发与高质量交付的双重需求。为应对上述挑战,中国联通软件研究院以书生大模型 InternLM3-8B-Instruct 为核心引擎,创新构建覆盖“智能需求解析→用例生成→智能评审→用例转化→智能执行”的全流程智能化测试,系统性突破传统软件测试在效率与覆盖度上的核心

上海人工智能实验室将以实战营为平台联合更多合作伙伴,提供开发技术支持,助力开发者打造“出圈”项目,共同推动国产 AI 生态繁荣。书生大模型实战营第 6 期全面升级,本次课程将在 A100、曦云C系列及 Ascend 多个算力平台,以科学多模态大模型 Intern-S1 为载体,带领大家掌握大模型部署、微调、评测全链路技能。同时,特别增设近 10 万元奖金池的「书生大模型 SFT/RL 公式识别打榜

先来看一下POLAR能做到什么。与传统的奖励模型不同,POLAR是根据参考答案为模型的输出打分。这意味着POLAR可以灵活地基于不同场景的参考答案给出不同的奖励分数,轻松适配多样的定制化需求。彩虹是怎么形成的?彩虹是阳光经过水滴折射和反射后形成的。当阳光照射到空气中的小水滴时,光线会进入水滴发生折射,再从水滴的内壁反射后再次折射出水滴。由于不同波长的光折射角度不同,最终呈现出不同的颜色,这些颜色组

另外,研究团队还同步打造了面向科学时序理解与生成的系统性评测基准 SciTS,覆盖天文、地球科学、生物声学、气象学、神经科学、数学等 12 个学科的 43 个典型场景,可科学呈现文本、多模态大模型与传统时序模型在科学时序任务中的表现。围绕这一目标,上海人工智能实验室开展了跨领域科学时序信号统一建模的探索,将原创的专用时序模块应用于书生科学多模态大模型 Intern-S1-Pro,助力模型首次具备统

同时,传统批阅方式仅停留在分数统计层面,缺乏对错因、知识薄弱环节的细致诊断,难以实现深度的学情分析。这既加重了教师的工作负担,也使得教研活动缺乏数据支撑,制约了教学优化与个性化发展的可能性。其核心是通过 AI 实现自动批阅,教师只需复核不足 5% 的异常情况,帮助教师高效、精准地完成试卷批阅工作,同时提供全面的学情分析和教学建议。依托书生·万象 InternVL 多模态大模型,深圳市牛娃教育科技的

在这个快节奏的世界里,我们需要一点调味剂来调和生活。无论是需要一点甜言蜜语来提振精神,还是需要一剂犀利怼语来释放压力,FunGPT都能满足您的需求。FunGPT基于 InternLM2.5 系列大模型,利用 XTuner 进行QLoRA指令微调,使模型能够满足用户的个性化要求。同时为了方便用户,我们还发布了 1.8B 系列小模型,减量不减效果;此外,我们还利用 LMDeploy 对多个模型使用感知

上海人工智能实验室(上海AI Lab)致力于以“”路径实现通用人工智能(AGI),为推动科学发现等重要任务带来下一代先进基础大模型。近日,基于一系列“通专融合”底层技术新进展,书生·思客(InternThinker)获得专业推理能力大幅提升,成为首个既具备围棋专业水平,又能展示透明思维链的大模型。在实验室科研人员的布局和着子中,蕴含数千年智慧的围棋成为了科学探索的“试应手”。

本文将带领大家基于华为云 ModelArts,使用 XTuner 单卡微调一个 InternLM 个人小助手。开源链接:(欢迎 star)

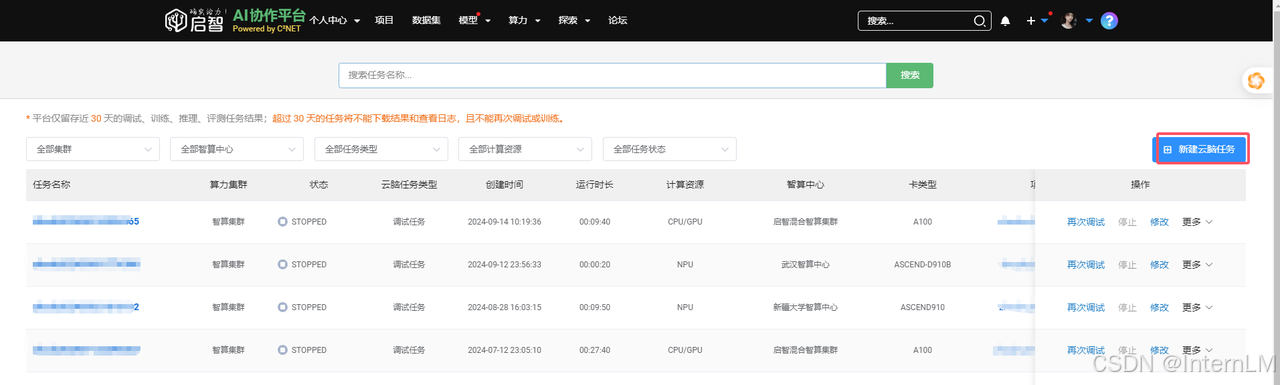

LMDeploy 在 0.6.0 这个版本上开始支持华为昇腾NPU。不过官方的文档只包含了 docker 镜像推理的示例,对于非 docker 镜像如何部署安装没有提到,这样对平台的移植性就变差了。好在启智平台提供了华为的昇腾NPU 运行环境,不过这里我们需要注意:虽然启智平台提供了华为的昇腾 NPU 运行环境,但是 不是每个镜像都能很顺利地跑完,我花了些时间进行测试,结果发现大部分镜像是不能运行

InternLM2.5 系列模型现已在 OpenCSG 社区以专区形式正式上线,大家可以灵活选择算力,快速启动推理服务,或利用平台提供的丰富数据集进行模型微调。InternLM 开源链接:(欢迎 star)https://github.com/InternLM/InternLM专区链接:https://opencsg.com/collections/43/OpenCSG 社区还特别提供了 Inte