简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

大模型也叫大语言模型,是一个通过分析和学习大量的文本数据来理解和生成人类语言的复杂计算机程序,是上边深度学习的媒介,通过大语言模型来实现深度学习。举一个形象的例子说明大模型在机器学习中的工作原理。你在学习做蛋糕。刚开始,你会跟着食谱的指示,一步步地学习如何混合材料、调节烤箱温度和时间。每次根据食谱做蛋糕后,你都会得到结果,可能是成功的,也可能是失败的。随着时间的积累,你尝试了成千上万个不同的食谱(

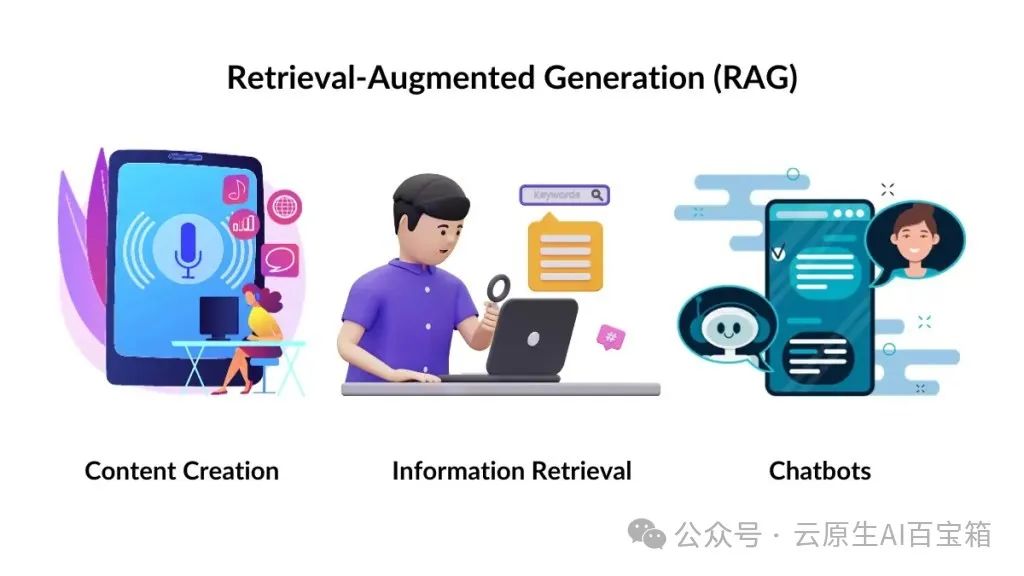

介绍检索增强型语言模型,包括预训练检索增强型语言模型、通过高效和精简检索进行问答和多跳推理、检索增强型 Transformer 等知识点。

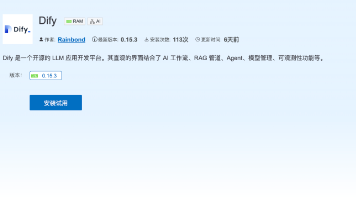

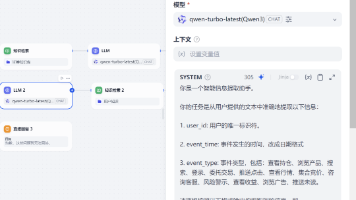

本文详细介绍了如何使用Dify平台一键私有化部署AI智能客服系统。Dify是面向开发者和企业的AI应用开发平台,提供可视化低代码开发、多模型接入等功能。文章通过Rainbond Cloud平台演示了Dify的安装步骤,包括创建知识库、配置提示词和发布应用的全过程。整个过程无需编程基础,用户可轻松搭建功能强大的智能客服系统,为网站提供24/7的智能问答服务,是小白学习大模型应用部署的实用指南。

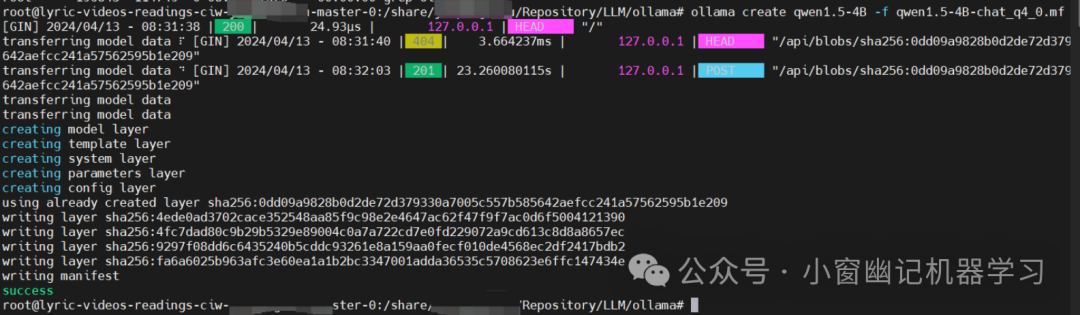

本文主要介绍如何安装ollama,并演示2种加载模型的方法:(1)拉取ollama官方已经有的模型,进行LLM服务部署。(2)加载本地模型部署大模型服务。最后,对部署的LLM服务的接口进行测试。为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效

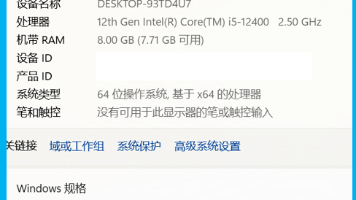

本文详细介绍了如何使用ollama、DeepSeek和CherryStudio在本地部署大模型并搭建知识库的完整流程。这套方案无需付费,适合配置不高的电脑(如仅有集成显卡),能够实现个性化使用AI大模型,确保本地资料安全保密。作者分享了从安装平台、下载模型到搭建知识库的具体步骤和注意事项,还提供了AI大模型学习资源。

随着金融行业数字化转型的加速,银行需要高效处理海量非结构化数据(如合同、政策文件、客户咨询记录等),同时确保服务的安全性、合规性与智能化。基于RAG技术构建的企业级系统,能够将传统检索与生成式AI结合,为银行提供精准、安全的智能服务。 以下结合银行业务场景,详解其核心流程与技术实现。

本文详细介绍如何使用ChatFlow模式搭建智能客服系统,通过设置意图识别将问题分为营销、投诉和其他三类。结合证券和用户知识库,针对不同分类添加知识检索与大模型节点,实现自动回答问题。文章提供了从创建应用到预览效果的完整步骤,帮助读者打造行业专属智能客服助手。

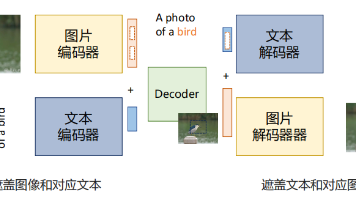

本文详细介绍了多模态大模型的架构与训练方法,重点讲解了视觉-语言模型(VLM)和语音-语言模型(SLM)。VLM包括对比学习、掩码预测、生成式学习和映射学习四种训练思路;SLM探讨了输入输出模式、语音表示方法及语音文本融合架构。这些模型结合不同模态信息,使AI具备看图说话、听懂回答等接近人类的能力,为人机交互提供了更自然的方式。

本文将带你深入了解 Transformers、vLLM、Llama.cpp、SGLang、MLX 和 Ollama 这些引擎,帮助你找到最适合的工具,释放大语言模型的全部潜力!

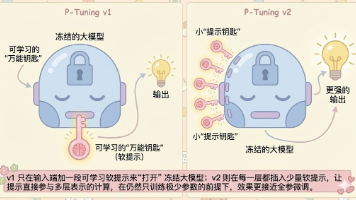

文章介绍了大语言模型微调的基础概念、与RAG的对比及三种主流方法:P-Tuning通过插入可训练向量提升性能;LoRA采用低秩分解原理,用小矩阵旁路减少参数更新;QLoRA则在LoRA基础上对原模型进行4bit量化,进一步降低资源消耗。详细解释了各种方法的原理和计算方式,帮助开发者选择适合的微调策略。