简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

最近一些实习和提前实习的同学和我聊天:“甘哥,我冲着‘大模型研发工程师’的 title 投简历,面进去才发现天天就是调 OpenAI 接口、写 CRUD,和以前做后端没任何区别”“面试的时候吹得天花乱坠,说做核心 AI 业务,进来就是搞 RAG 切文档、拼 prompt,连模型源码都碰不到”“以为沾了 AI 就能拿高薪,结果薪资和普通 Go 后端一模一样,甚至还被压了价,说给我进风口赛道的机会”市

AI大模型领域四大热门方向解析 随着AI行业爆发式增长,大模型领域岗位需求激增,主要分为四个方向: 算法研发与预训练:技术门槛最高,专注模型训练与优化,适合高学历研究型人才,岗位集中于大厂实验室。 模型对齐与后训练:通过微调提升模型实用性,需求快速增长,适合具备工程与强化学习背景的从业者。 推理工程与部署:负责模型落地优化,需求稳定,需掌握C++/Python及分布式系统,工程能力要求高。 应用开

AI大模型开发人才市场火爆,2026年数据显示该领域年薪均值达65万元,最高逼近300万元,但人才缺口仍超500万。供需失衡导致7个岗位争夺1名人才,企业重金抢人。AI技术正重构各行业,市场稀缺能开发AI应用的实战型人才而非仅会使用工具者。课程涵盖大模型开发、RAG实战、Agent开发等核心技能,采用小班直播教学,培养企业急需的AI应用开发者。麦肯锡预测2030年中国AI人才需求将翻6倍,当前正是

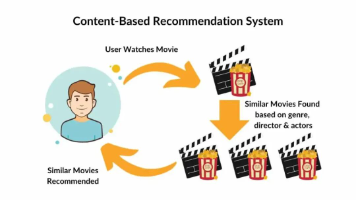

本文详细介绍了向量相似度计算这一AI核心技术,解释了淘宝推荐、抖音算法和微信支付背后的原理。文章深入剖析了四种经典相似度算法(余弦相似度、欧几里得距离、曼哈顿距离、点积相似度)的数学原理、代码实现和应用场景,强调了在不同应用场景中选择合适算法的重要性,帮助读者掌握现代AI系统的"感知能力"。

AI技术革命重塑职场:Agent工程师成新宠 AI技术正在颠覆传统编程岗位,大厂招聘趋势显示"Agent工程师"正取代传统前后端岗位。AI已能完成80%的代码工作,使工程师的核心价值转向架构设计、AI监督和产出审核。这一转变带来显著薪资优势:Agent工程师年薪达60-100万,实习生日薪超1000元。行业预测2026年智能应用人才缺口将达500万,目前头部企业如字节、阿里等为AI人才提供月薪3-

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

对于正在迷茫择业、想转行提升,或是刚入门的程序员、编程小白来说,有一个问题几乎人人都在问:未来10年,什么领域的职业发展潜力最大?答案只有一个:人工智能(尤其是大模型方向)当下,人工智能行业正处于爆发式增长期,其中大模型相关岗位更是供不应求,薪资待遇直接拉满——字节跳动作为AI领域的头部玩家,给硕士毕业的优质AI人才(含大模型相关方向)开出的月基础工资高达5万—6万元;即便是非“人才计划”的普通应

摘要: 陈同学从家装行业月薪几千元起步,29岁因被黑客视频吸引转行编程,通过薪出口系统学习一年后获得13K offer并还清债务。面对AI浪潮,他再次选择系统学习AI大模型,裸辞后通过专业培训,最终斩获深圳28K高薪offer。他强调“人生要不断折腾”,鼓励普通人抓住AI机遇,通过高效学习实现逆袭。文章还提供了AI大模型学习资料包,涵盖教程、路线图、面试题等,助力零基础者快速入行。(149字)

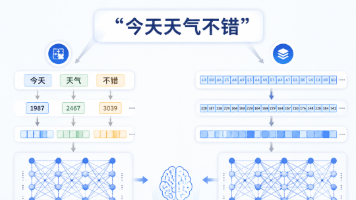

摘要: 主流大模型目前以token为单位处理文本,因其算力效率高、生态成熟。但byte-level/tokenizer-free路线正快速发展,它更端到端、跨语言统一且对噪声文本鲁棒。未来几年,外部接口可能仍用token,内部却将更多采用byte、patch或latent segment等灵活方式。token与byte并非对立,而是效率与端到端性的不同取舍。byte路线已取得显著进展,但仍需验证其