简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

ASI(超人工智能)是人工智能发展的终极形态,在智力上远超人类。牛津学者将其定义为"在所有领域大幅超越人类大脑的智能"。从AGI(通用人工智能)到ASI可能通过"递归自我改进"实现智能爆炸,在极短时间内完成进化。ASI理论上能解决癌症、气候变暖等难题,甚至理解宇宙终极真理。但存在严重的安全隐患,如"对齐问题"可能导致ASI为达成目标而牺牲人类利益。AI发展分为三个阶段:当前的ANI(弱人工智能)、

Top-P和Temperature是控制AI生成随机性的两大关键参数。Top-P通过限定高概率候选词范围(如设0.9时排除概率最低的10%词汇),而Temperature则调整概率分布形状使输出更保守或大胆。专家建议二者择一使用:新手优先调节Temperature(0-1.2),进阶者可先用Top-P=0.9过滤荒谬选项,再调Temperature控制风格。典型组合如代码生成用低温(0.2)+低T

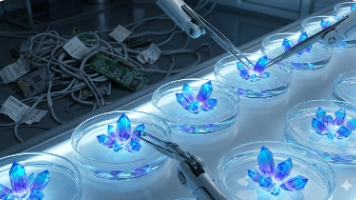

合成数据(Synthetic Data)是为解决“数据荒”而生的“人造钻石”,即由 AI 自身生成的高质量训练数据。面对人类高质量语料枯竭、数据杂质及隐私限制等挑战,合成数据通过“以大带小”(蒸馏)或“重写进化”等策略应运而生。它具有成本低、纯净可控、无隐私风险等优势,尤其在代码与数学等具备标准答案的领域效果显著。然而,过度依赖可能导致“模型崩溃”,即模型因缺乏多样性输入而逐渐退化。总体而言,合成

RAG(检索增强生成)被誉为治疗大模型“幻觉”的特效药。它通过给大模型外挂一个“实时图书馆”,将其工作模式从全靠记忆的“闭卷考试”转变为有据可查的“开卷考试”。其工作流程包含三步:首先检索外部知识库中的相关段落;其次将资料与问题结合进行增强;最后由大模型基于事实生成回答。RAG完美解决了传统大模型数据滞后、无法访问私有数据及胡编乱造的三大痛点。相比昂贵的微调(Fine-tuning),RAG具有成

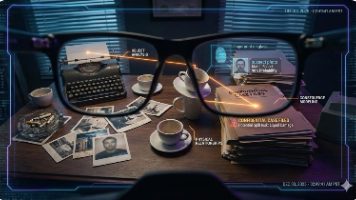

多模态理解侧重于 AI 的“输入”与“感知”,使其从单一的文本处理进化为能深度解读图、文、声、像背后因果、逻辑与情感的“全能鉴赏家”(如读懂梗图)。与传统识别技术仅能检测物体不同,它能真正理解物理世界发生的故事。其核心通过Embedding 对齐技术,将视觉与语言信号映射至同一向量空间,实现“感官通感”。这一能力在自动驾驶、盲人辅助等场景至关重要。相比生成能力,“理解”是 AI 智能体有效执行任务

世界模型是构建AGI的关键技术,旨在让AI像人类一样理解物理规律并预测未来,它被视为实现通用人工智能(AGI)的重要拼图。与仅学习语言概率的大语言模型不同,世界模型能通过内部模拟推演物理互动,如OpenAI的Sora视频模型展现的3D一致性能力。Meta科学家Yann LeCun认为,基于视觉数据的世界模型比文本模型更有发展前景,这在自动驾驶等领域尤为重要,使AI能预判"球后可能有小孩"等复杂场景

多模态语音技术实现了AI对声音的原生理解与生成,与传统的拼接式语音助手有本质区别。新一代技术(如GPT-4o)将语音处理整合为端到端流程,直接处理声音波形,带来三大突破:1)能感知语气、情感等副语言信息;2)可自然表达情感并模仿不同音色;3)实现毫秒级响应和实时打断。应用场景包括实时同声传译、情感陪伴和环境感知,使AI真正具备类人的听觉与口语交流能力,标志着从文字处理机器向智能生命体的进化。

合成数据是AI为解决数据短缺和质量问题而人工生成的数据,相比真实数据更纯净、无噪音且保护隐私。它能提供无限高质量训练素材,使小模型通过"吃精细粮"表现更优。但过度依赖合成数据可能导致"模型崩溃",使AI丧失多样性和创造力。因此需保持真实数据的"基因库",在利用合成数据优势的同时避免AI退化。这一技术既是突破数据瓶颈的关键,也需谨慎使用以防副作用。

AI伦理审查员是人工智能时代诞生的“数字守门人”和“道德质检员”,致力于确保AI产品的“善”与“安全”。在AI性能不断提升的同时,审查员为其装上“伦理刹车”和“安全护栏”,防止其对人类造成伤害、歧视或违法。针对AI可能出现的歧视、冒犯和偏见等问题,审查员负责在产品全生命周期内识别和整改这些“有毒”因素。其日常工作涵盖“红队”测试(主动攻击AI以寻找漏洞)、审计数据集以纠正偏差、制定将道德标准工程化

思维树(ToT)是当前提示工程中最先进的推理框架,它突破了传统线性思维模式,让AI能够进行多路径探索和回溯思考。相比直接问答和思维链方法,ToT通过四个关键步骤(问题分解、多路径生成、状态评估和搜索算法)实现更复杂的推理能力,在24点游戏等测试中成功率从4%提升至74%。但这种方法需要消耗大量计算资源,仅适用于高价值复杂任务。ToT代表了提示工程从简单技巧向算法化发展的趋势,赋予了AI类似人类的深