放弃“抽卡式”调参!OpenClaw源码级拆解:如何用3000行代码构建你的AI Agent指挥官

在OpenClaw爆火之前,我们每个开发者几乎都有一套自己“手搓”的Agent架子:Skills管理、Session维护、Memory-search方案……每次技术交流,光解释架构就要花掉半小时-1。2026年的市场新趋势是什么?是“AI Agent指挥官”-2。根据Gartner的报告,超过92%的企业已在核心流程中部署AI Agent,单靠一个“全能Agent”处理长链路任务(比如自动生成一份

2026年,当大多数AI公司还在炒作“通用大模型”时,真正的技术红利已经悄然转移到了“智能体工程化”的深水区。

就在上周,GitHub星标破28万的OpenClaw项目连续两次大版本更新,正式适配GPT-5.4和Gemini 3.1 Flash-Lite,并提出了一个极具颠覆性的概念——“可插拔Context Engine” -5。

这不仅仅是一次简单的功能迭代。作为一名深度参与了OpenClaw社区代码贡献的开发者,我想带你穿透那些华而不实的概念炒作,直接从源码层面解析:这个号称“本地优先的AI Agent指挥官”到底是如何工作的?在2026年多智能体协作成为新常态的背景下,它的设计思路能给我们带来哪些启发?

一、 为什么是OpenClaw?从“单体智能”到“集群协作”的范式转移

在OpenClaw爆火之前,我们每个开发者几乎都有一套自己“手搓”的Agent架子:Skills管理、Session维护、Memory-search方案……每次技术交流,光解释架构就要花掉半小时 -1。

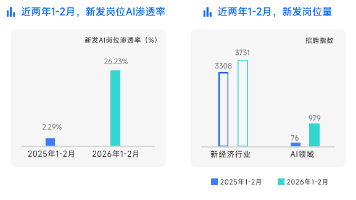

2026年的市场新趋势是什么?是“AI Agent指挥官” -2。

根据Gartner的报告,超过92%的企业已在核心流程中部署AI Agent,单靠一个“全能Agent”处理长链路任务(比如自动生成一份带数据分析的行业研报)往往会逻辑断裂 -9。而OpenClaw的颠覆之处,在于它通过一套极简的文件系统架构,天然支持了多Agent的协作。

在OpenClaw的源码中,你会发现每个Agent都有一个独立的Workspace。核心配置文件并不是晦涩的数据库表,而是可读性极强的Markdown文件。我们来看看 /src/agents/workspace.ts 中的核心定义:

// 源码简化示例 (来自 openclaw/src/agents/workspace.ts)

export async function loadWorkspaceBootstrapFiles(dir: string): Promise<WorkspaceBootstrapFile[]> {

const entries = [

{ name: "AGENTS.md", filePath: path.join(resolvedDir, "AGENTS.md") }, // 职责声明

{ name: "SOUL.md", ... }, // 个性化提示词(System Prompt)

{ name: "TOOLS.md", ... }, // 工具白名单/黑名单(安全边界)

{ name: "IDENTITY.md", ... }, // 身份标识

{ name: "MEMORY.md", ... }, // RAG记忆文档

// ...

];

}

这种设计的精妙之处在于 “共识推广” 。当所有人都用同一套文件协议定义Agent时,我们不再需要讨论“你的Agent用什么格式记忆”,只需要讨论“如何优化MEMORY.md的RAG检索算法” -1。这为大规模多Agent协作扫清了沟通障碍。

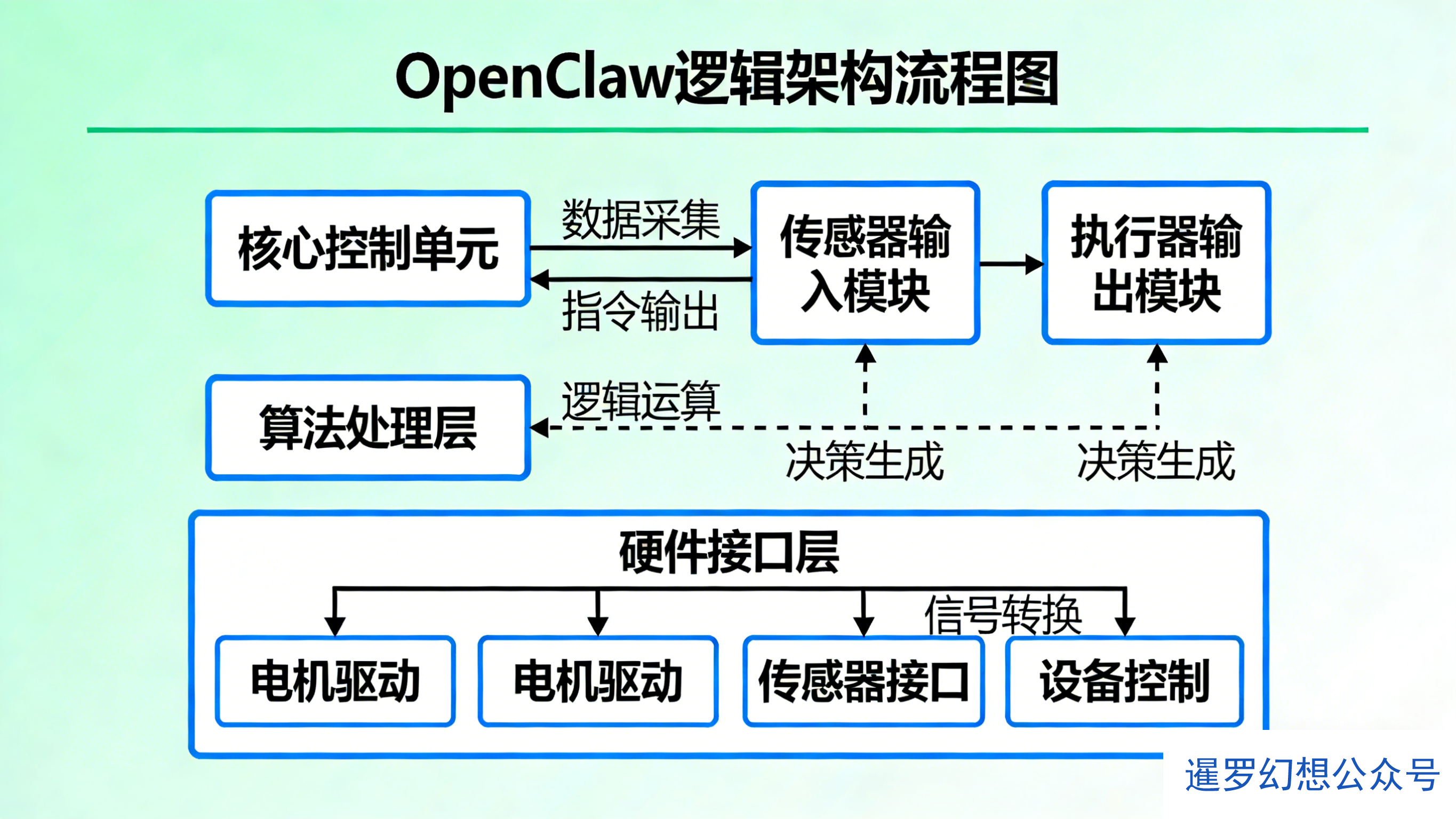

二、 源码硬核解析:Gateway与Pi-Engine的“指挥-调度”闭环

如果把多Agent系统比作一支军队,OpenClaw的Gateway就是指挥部,而Pi-Embedded-Runner就是前线作战单元。

在最新的代码库(commit b1b41eb)中,OpenClaw的核心架构清晰地分为了两层 -6:

1. 控制平面:Gateway(大脑)

位于 /src/gateway/ 下。它是一个常驻的守护进程,所有消息通道(Telegram、WhatsApp、iMessage等)都通过WebSocket(默认 ws://127.0.0.1:18789)连接到这里。

设计亮点: 它不仅仅是消息路由器,更是一个 “策略执行点”。在 gateway/auth/ 目录下,我们可以看到严格的挑战验证机制,第一帧数据必须带 challengeSig,防止未授权的机器连接。

2. 执行引擎:Pi-Embedded-Runner(四肢)

位于 /src/agents/pi-embedded-runner/run.ts。

这是OpenClaw最性感的代码之一。它没有采用传统的子进程RPC通信,而是嵌入式运行,极大提升了性能。

核心执行流程 runEmbeddedPiAgent() 的逻辑如下:

-

Step 1: 获取Session锁,避免并发冲突。

-

Step 2: 构建Prompt(注入SOUL.md和MEMORY.md)。

-

Step 3: 工具策略管道(Tool Policy Pipeline):这是2026年版本的安全核心。

当Agent决定调用工具(如读文件、执行脚本)时,代码会进入tool-policy-pipeline.ts。-

安全机制: 非主会话(陌生人发的消息)的工具调用,会被强制丢入Docker沙箱执行;只有主会话才走Host执行。这行代码虽然简单,却是企业级应用的生命线 -6。

-

-

Step 4: 结果压缩(Compaction)与流式返回。

这种“指挥(Gateway路由) + 调度(Policy Pipeline)”的双重属性,完美契合了2026年企业级智能体需要的严谨性与可控性 -7。

三、 告别“抽卡式Prompt”:新版本Context Engine的可插拔革命

如果你曾经用过早期的Agent,一定经历过“抽卡式Prompt”的噩梦——稍微改一下提示词,整个Agent的行为就变得不可控。

OpenClaw 2026.3.8 版本更新中提到的“可插拔Context Engine”,正是为了解决这一问题 -5。

在传统架构中,Context管理是写死在推理逻辑里的。而在OpenClaw的新抽象层中,你可以像插U盘一样更换上下文处理策略。

我在阅读diff代码时发现,他们在 src/agents/context/ 目录下抽象出了 BaseContextEngine 接口。这意味着开发者可以根据任务场景选择不同的引擎:

-

处理长篇小说时,用滑动窗口引擎;

-

处理代码生成时,用结构化语义引擎;

-

处理工具调用时,用极简指令引擎。

这种正交设计理念,正如Manus团队的那句名言:“要做和AI能力正交的事情。” -1。AI模型越来越聪明(如GPT-5.4),我们只需要升级底座,而那些与AI交互的长期数据、私人记忆,通过可插拔引擎保留下来,这才是Agent的核心资产。

四、 安全与风险:部署OpenClaw前必须知道的“潜规则”

在2026年的技术蓝图中,“可观测性”和“安全性”已经被提到了前所未有的高度。微软甚至专门发布了Agent 365来管理智能体带来的内部威胁 -4。

OpenClaw虽然是个人级产品,但它的安全设计堪称教科书级别。在源码 SECURITY.md 和 agents/defaults 配置中,有几个细节值得所有架构师参考:

-

DM策略(Direct Message Policy): 默认

dmPolicy=“pairing”。陌生人发消息,机器人会自动回复配对码验证。防止AI被社会工程学攻击。 -

工具权限分级: 通过

TOOLS.md区分allowlist(如允许bash)和denylist(如禁止browser)-1。 -

定时快照的额度陷阱: 这是很多人在多Agent部署时踩的坑。源码

gateway/中有一个healthInterval,每60秒ping一次IM。如果部署了10个Agent,IM额度很快会耗尽 -1。这就是“可用性”设计在源码层面的体现——如果你不读源码,永远不知道为什么额度跑得这么快。

五、 2026年的个人Jarvis:不只是极客玩具

最后,回到OpenClaw的初心——打造个人Jarvis -1。

通过源码级解析,我们可以看到它已经从一个“聊天机器人框架”进化为一个 “数字员工操作系统”。无论是腾讯云支持的云机部署,还是Mac Mini本地跑ComfyUI模型,亦或是通过Moltbook让Agent在Reddit上自主社交 -3,

OpenClaw正在定义一种新的C端生产力边界。

对于开发者而言,折腾OpenClaw的收益不仅仅是学会部署一个工具,更是通过阅读像 pi-embedded-runner.ts 这样的核心代码,理解:

-

长短期记忆(Memory)如何通过sqlite-vec落地 -6;

-

多Agent通信如何通过事件队列解耦;

-

在资源有限的本地,如何通过嵌入式运行时榨干每一分性能。

2026年,AI的竞争不再是模型参数的军备竞赛,而是智能体工程化的终极比拼。 当大多数人还在焦虑“AI会不会取代我”时,真正的极客已经开始用OpenClaw源码,亲手搭建属于自己的“龙虾军团”。

关键字:

OpenClaw源码级解析:AI Agent自动执行系统的设计思路

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)