vllm-projectvllm:大模型推理服务的高性能方案

支持多种量化方案,覆盖FP8、MXFP8/MXFP4、NVFP4、INT8、INT4、GPTQ/AWQ、GGUF等主流格式,适配不同硬件的性能需求。vllm 无缝对接Hugging Face上的200+模型架构,包括解码器-only大模型、MoE模型、混合注意力与状态空间模型、多模态模型、嵌入与检索模型、奖励与分类模型等。支持并行采样、波束搜索等多种解码算法,内置张量并行、流水线并行、数据并行、专

vllm-project/vllm:大模型推理服务的高性能方案

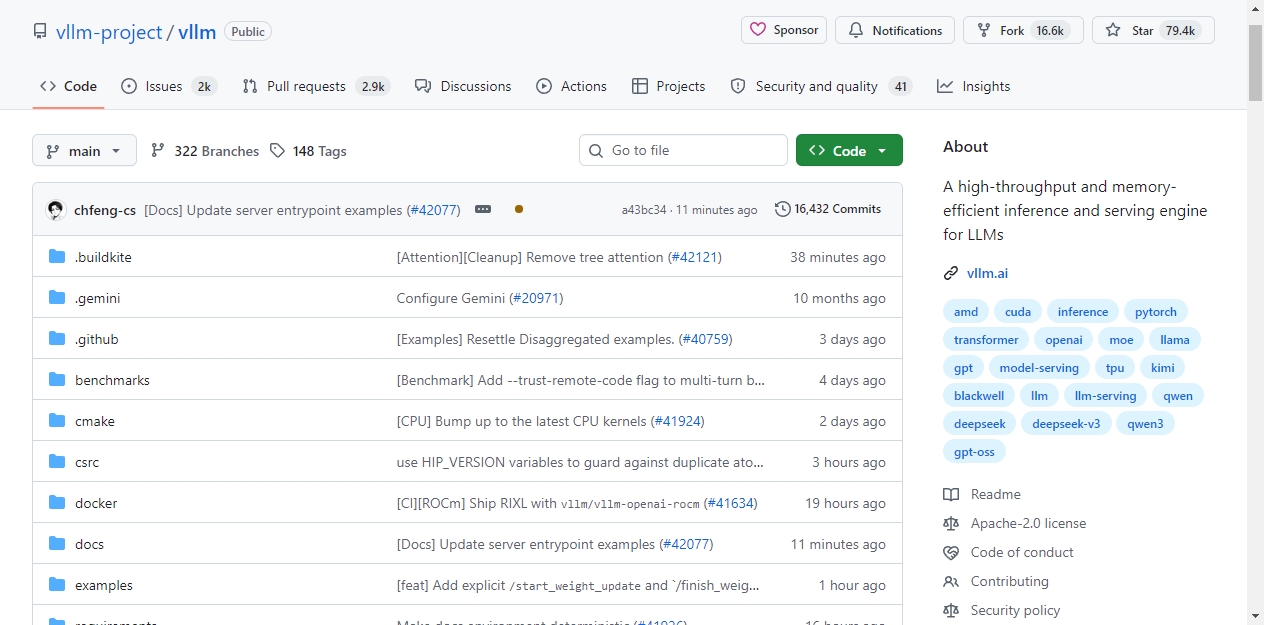

vllm-project/vllm 在 GitHub 上已经拿到 79,418 Star 了。

这是 UC Berkeley 天空计算实验室开发的 LLM 推理与服务库,核心目标是降低大模型部署的成本与复杂度,提升服务吞吐量。目前项目已有超过2000名贡献者,是活跃度最高的开源AI项目之一。

核心性能特性

vllm 基于自研的 PagedAttention 技术实现注意力键值内存的高效管理,对比传统方案,服务吞吐量提升数倍。支持连续批处理请求、分块预填充、前缀缓存等特性,搭配优化后的注意力内核,包括FlashAttention、FlashInfer、TRTLLM-GEN等,可充分释放GPU算力。

支持多种量化方案,覆盖FP8、MXFP8/MXFP4、NVFP4、INT8、INT4、GPTQ/AWQ、GGUF等主流格式,适配不同硬件的性能需求。支持推测解码、自动内核生成、分阶段预填充与解码等特性,进一步提升推理效率。

功能兼容性

vllm 无缝对接Hugging Face上的200+模型架构,包括解码器-only大模型、MoE模型、混合注意力与状态空间模型、多模态模型、嵌入与检索模型、奖励与分类模型等。

支持并行采样、波束搜索等多种解码算法,内置张量并行、流水线并行、数据并行、专家并行、上下文并行等分布式推理能力,支持流式输出、结构化生成、工具调用等常用功能。

提供OpenAI兼容的API服务,同时支持Anthropic Messages API与gRPC协议,可直接替换现有服务接口。支持多LoRA场景,适配NVIDIA、AMD GPU与x86/ARM/苹果硅等多种硬件平台,还支持Google TPU、华为昇腾、英特尔Gaudi等专用加速硬件。

安装与使用

推荐使用uv安装,命令为uv pip install vllm,也可从源码编译用于开发场景。官方文档提供详细的安装指南、快速上手教程与完整的支持模型列表,开发者可直接查阅。

项目欢迎各类贡献,包括代码提交、功能建议、问题反馈等,贡献指南可在官方文档中查看。如果在研究中使用vllm,可引用项目对应的SOSP 2023论文。

适用场景

适合需要部署高吞吐量大模型服务的开发者,搭建RAG系统需要处理大量推理请求的团队,做AI应用开发需要低延迟推理能力的团队,以及需要在多种硬件平台上部署大模型的场景。

开源地址:https://github.com/vllm-project/vllm

😕/github.com/vllm-project/vllm

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)