轻松上手本地大模型,LM Studio带你飞

前言• 对于非技术人员,你想搞本地大模型还是比较麻烦的,还得学习其它知识点,所以使用本文的该工具,很适合非技术用户使用。• 对于技术人员,如果你不想去使用ollama了(虽然该方案已经很方便了),毕竟它不带用户界面还得部署其他用户界面服务(它有它自己独特的优点),这里可以尝试一个新工具LM Studio(软件闭环,但免费)LM Studio介绍官网介绍:LM Studio可以发现、下载和运行本地L

前言

-

• 对于非技术人员,你想搞本地大模型还是比较麻烦的,还得学习其它知识点,所以使用本文的该工具,很适合非技术用户使用。

-

• 对于技术人员,如果你不想去使用ollama了(虽然该方案已经很方便了),毕竟它不带用户界面还得部署其他用户界面服务(它有它自己独特的优点),这里可以尝试一个新工具LM Studio(软件闭环,但免费)

LM Studio介绍

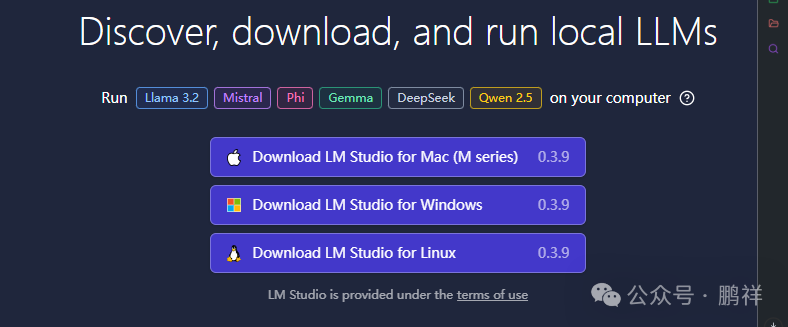

官网介绍:LM Studio可以发现、下载和运行本地LLM。一下子都包含了,刺激!!!

程序官网:https://lmstudio.ai/

用户体验

-

• 图形化界面友好:提供直观的图形界面,无需命令行操作,适合非技术用户。

-

• 操作简便:零配置,开箱即用,用户可以快速上手。

-

• 多平台支持:支持Windows、macOS和Linux系统。

模型管理

-

• 丰富的模型选择:支持从Hugging Face等平台下载多种模型,涵盖DeepSeek、LLaMa、MPT、StarCoder等系列。

-

• 离线运行:支持本地离线运行,数据不被上传至云端,保障隐私。

-

• 模型格式兼容:支持GGUF格式模型的下载、管理和运行。

性能与硬件

-

• GPU加速:支持多种GPU(包括AMD、Intel和NVIDIA),利用Vulkan技术适配。

-

• 硬件要求:建议至少配备16GB RAM和6GB VRAM

应用场景

-

• 本地AI写作与问答:适合需要本地AI写作、问答服务的用户。

-

• 创意写作与文本生成:支持生成多种文本格式,适合创意写作。

-

• 轻量级离线AI助手:适合对隐私有较高要求的用户(可以设置防火墙规则设置完全离线)

该工具可以直接导入本地大模型,于是去网站huggingface上查找大模型,结果访问不方便于是寻找到了镜像站hf-mirror,结果看着那几种下载方案有点懵逼,我要下载gguf格式的模型直接导入LM Studio的,奈何找不到这个文件,一番搜索后发现,该gguf文件格式是通过其hf-mirror网站仓库里面的文件转换过来的,嗐

安装

这一步就不讲解了,从官网下载安装即可,在本文中我安装的版本是0.3.9版本,该版本支持选择安装的路径,这个安装路径下面会用到

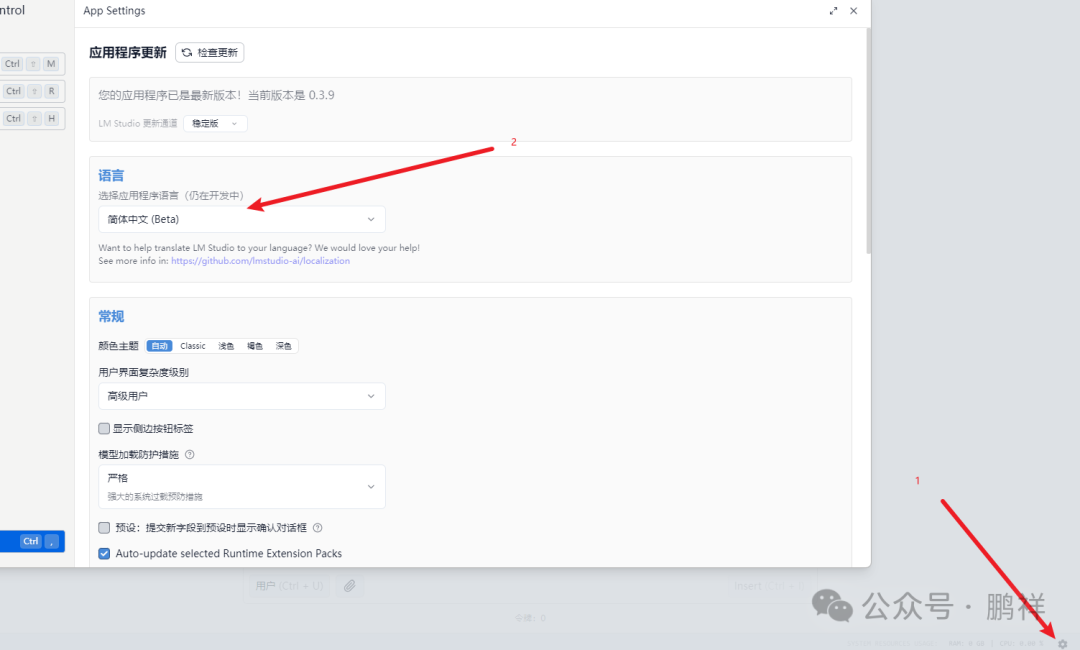

该软件默认使用的语言是英文,可以去设置里面修改为中文,如图

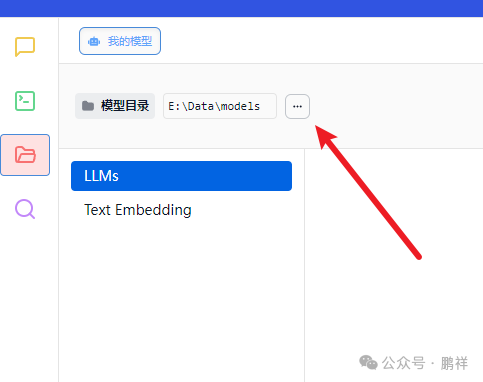

修改模型存储目录

默认模型存放的路径在:C:\Users\用户名.lmstudio\models ,我们可以修改将模型存放到一个比较合适的磁盘

下面就可以修改源来下载大模型了

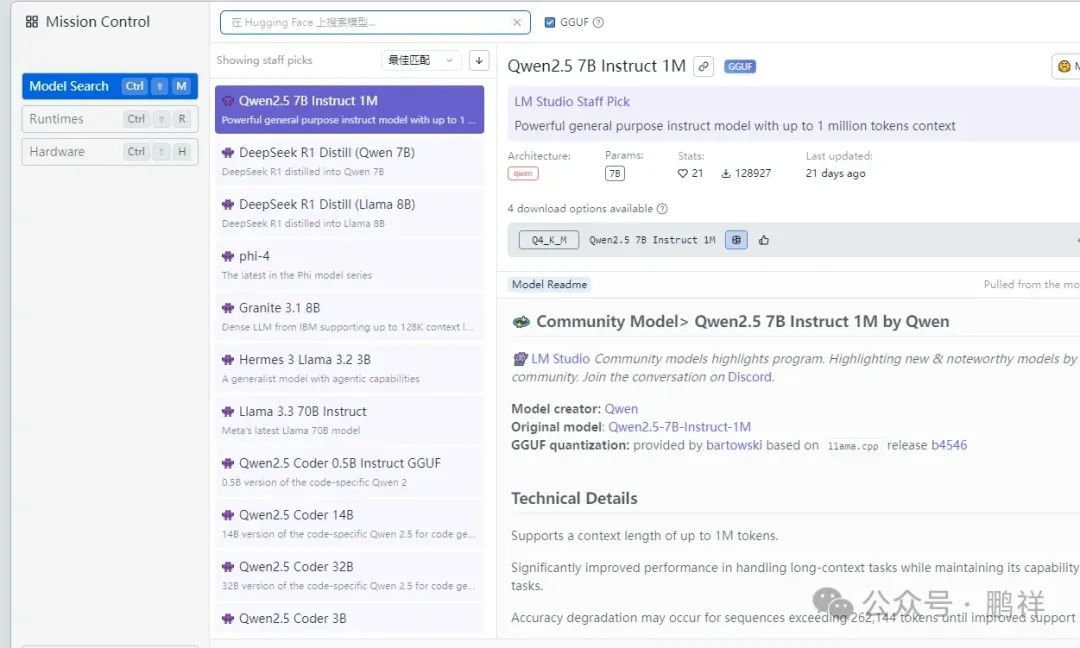

修改模型源

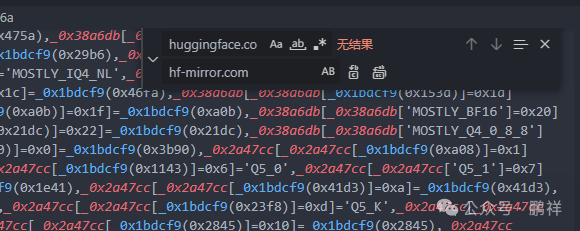

该软件默认使用的模型源是huggingface,因为一些原因访问不方便,但是可以找到安装路径,比如我的安装路径为 D:\Program Files\LmStudio\LM Studio ,那么就可以去\resources\app.webpack\main 找到一个叫做index.js的文件,使用vscode等工具打开该文件,搜索huggingface.co 批量替换为镜像站 hf-mirror.com (先关闭软件后修改)

替换之后重新打开LM Studio软件,发现可以查看搜索模型了

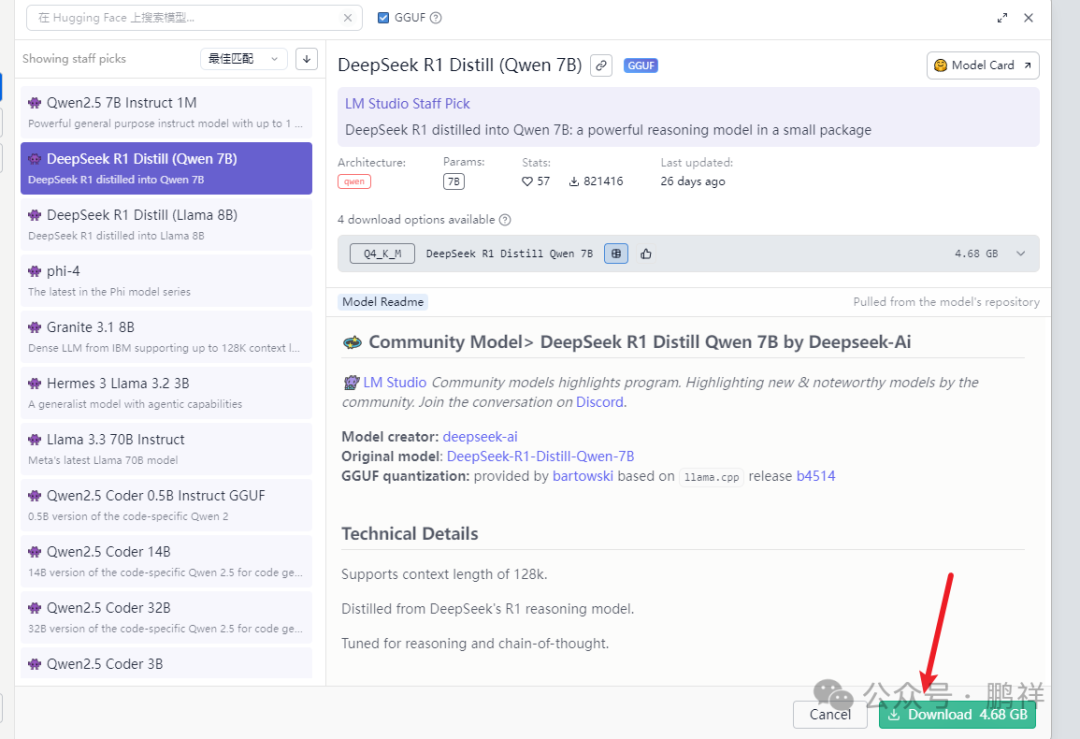

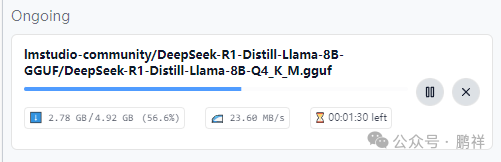

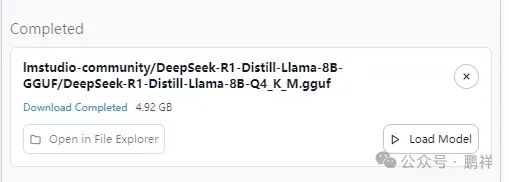

左下角可以查看下载的进度,比如我下载了这个模型

这个镜像站好网速不太稳定,快的时候很快,有时候会很慢到几十k,所以慢的话就换个时间点再试试

使用大模型

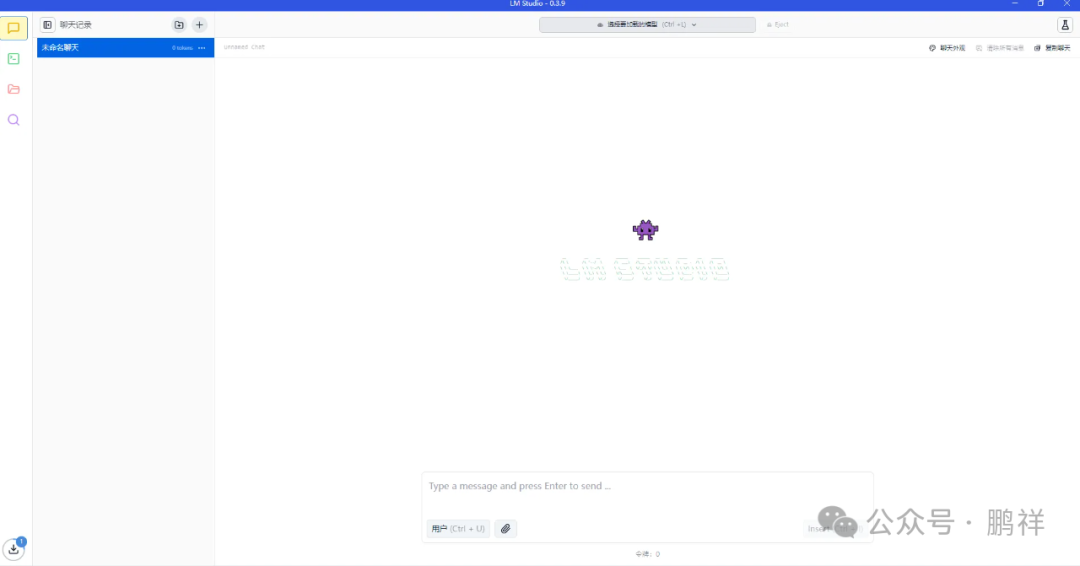

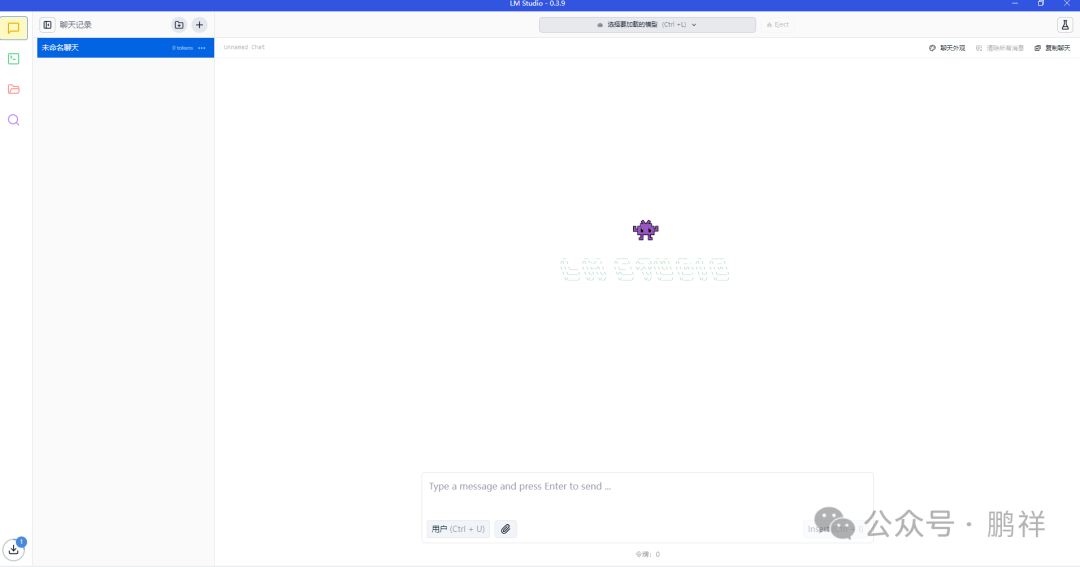

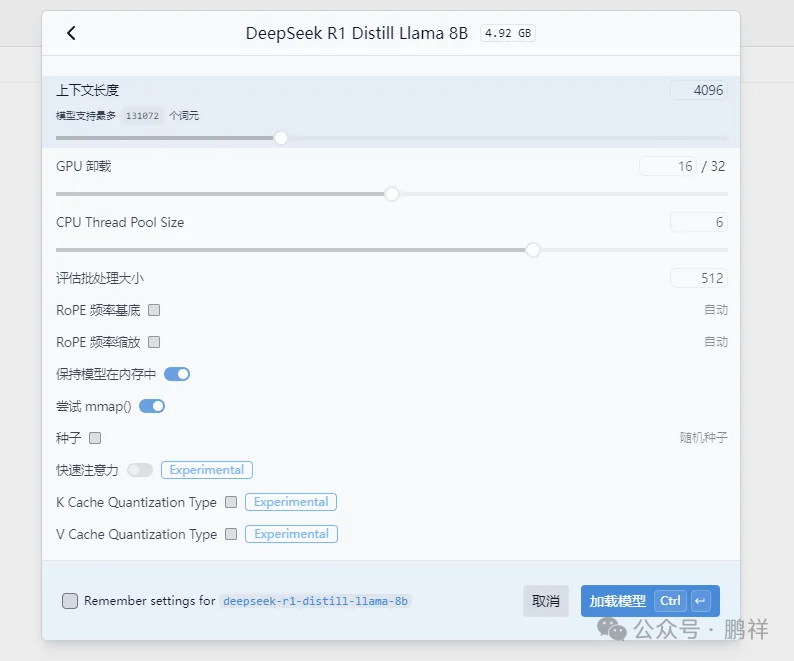

在顶部选择加载的大模型,这里我先试用默认的配置

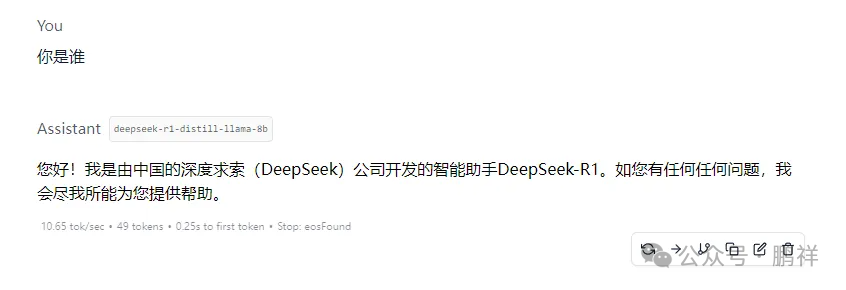

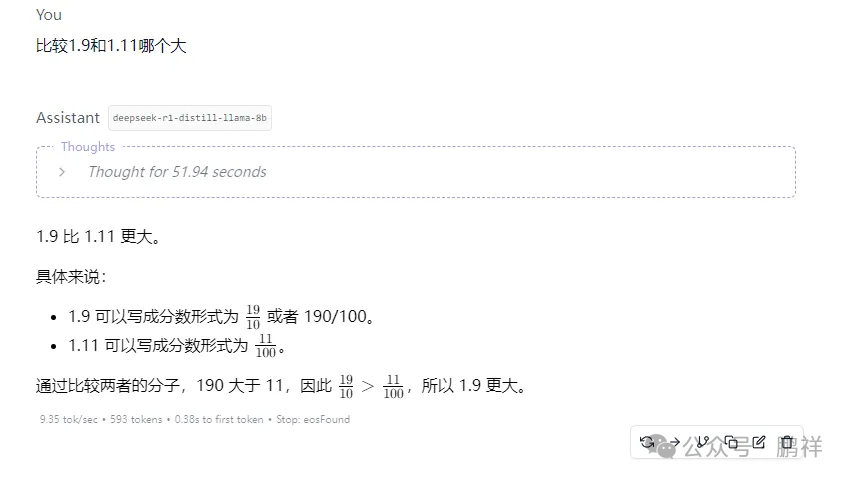

在模型加载成功后,简单测试模型是否ok

这里根据电脑配置的不同输出速度也会有不同

在右下角可以看到内存占用和CPU占用,可以根据调整配置来最大化利用电脑。

最后

想搞离线使用大模型的(设置防火墙规则),可以使用该工具快速上手操作,还适合非技术人员。

欢迎来到AMD开发者中国社区,我们致力于为全球开发者提供 ROCm、Ryzen AI Software 和 ZenDNN等全栈软硬件优化支持。携手中国开发者,链接全球开源生态,与你共建开放、协作的技术社区。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)