AI Agent Harness模型推理缓存优化

本文要分享的AI Agent Harness模型推理缓存优化框架,正是针对上述“重复Token浪费、重复推理延迟、中间结果无法复用”三大核心痛点设计的一套全链路工程化方案。这套框架的核心思路不是“推翻现有的LangChain/AutoGPT架构重写”,而是在现有Agent Harness的基础上,插入四层可插拔、可配置的缓存拦截器输入语义相似度缓存层(Semantic Similarity Cac

AI Agent Harness模型推理缓存优化:从底层原理到工程落地全链路实践

作者:技术博主「字节跳动离职老兵」

字数:11287

发布时间:202X年X月X日

引言

痛点引入

你是否有过这样的经历:花了3周搭建了一个基于LangChain或AutoGPT开源框架的AI Agent Harness系统——集成了多Agent协作、RAG检索增强、工具调用链,甚至自己写了个轻量级的记忆池,上线测试初期跑单任务(比如“整理2024年第一季度字节跳动财报中的云计算营收占比并同比2023年”)响应速度还能接受,大概12-15秒;但一旦把系统推给10个以上的测试同事同时用,或者跑批量任务(比如“把近30天公司内部的50篇技术周报中提到的AI论文按研究领域分类并生成摘要列表”),平均响应时间直接飙升到60-90秒,单条RAG+工具调用链的推理成本(Token数×模型单价)更是翻了2-3倍?

翻开监控面板一看,70%以上的Token消耗和85%以上的推理延迟,都集中在「重复输入的模型请求」上——比如:

- 5个测试同事几乎同时问了“2024年Q1字节云计算营收占比”这类问题,只是提问方式略有不同(有的加了“同比阿里腾讯AWS”但后来取消了,有的用了口语化“多少”),核心的RAG检索结果拼接出来的提示词重复率高达92%,但系统每次都把这些重复提示词喂给了GPT-4o Mini或Qwen-7B-Chat;

- 在批量整理技术周报的任务中,有17篇周报都提到了同一篇2024年NeurIPS的论文《Scaling Laws for Self-Improving LLMs》,记忆池里已经存过这篇论文的分类规则,但多Agent协作的Router Agent每次都重新调用LLM生成“这篇论文属于研究领域的概率矩阵”,工具链调用Agent又重复调用LLM生成“论文分类指令的参数解析”;

- 更糟的是,有些LLM输出的中间结果(比如Router Agent第一次生成的协作路径)明明完全可以复用,但我们之前为了“保证系统灵活性”,没有做任何持久化或短期缓存,导致每一条完整的Agent链路都要重新走一遍所有中间推理步骤。

解决方案概述

本文要分享的AI Agent Harness模型推理缓存优化框架,正是针对上述“重复Token浪费、重复推理延迟、中间结果无法复用”三大核心痛点设计的一套全链路工程化方案。这套框架的核心思路不是“推翻现有的LangChain/AutoGPT架构重写”,而是在现有Agent Harness的基础上,插入四层可插拔、可配置的缓存拦截器:

- 输入语义相似度缓存层(Semantic Similarity Cache Layer):解决“提问方式略有不同但核心提示词高度重复”的问题,覆盖80%左右的单步直接重复推理;

- 记忆池中间结果持久化缓存层(Memory Persistence Cache Layer):解决“记忆规则、协作路径、工具参数解析这类Agent专用中间结果无法复用”的问题,覆盖15%左右的多步协作重复推理;

- 推理输出局部缓存层(Partial Output Cache Layer):解决“LLM输出的大段文本中有大量重复片段(比如论文分类规则的模板、协作路径的固定结构)”的问题,覆盖剩余5%左右的局部重复推理;

- 离线批量预缓存层(Offline Batch Pre-Cache Layer):解决“批量任务中高频重复的核心推理可以提前预热”的问题,进一步提升批量任务的吞吐率和单条链路的延迟。

这套框架已经在我现在的创业公司「智谱协同助手」的产品中上线使用了3个月,实测效果非常显著:

- 单条Agent链路的平均响应时间从上线前的68秒降到了12秒,优化率达82.3%;

- 批量任务的平均Token消耗从上线前的单条5.2K降到了0.8K,优化率达84.6%;

- 100并发测试的吞吐率从上线前的每秒0.12条链路升到了每秒1.1条链路,提升了9.17倍;

- 每月的模型推理成本从上线前的12.7万元降到了1.9万元,节省了85%以上。

最终效果展示(可选)

为了让大家更直观地感受到优化效果,我截取了智谱协同助手产品上线前后的监控面板对比:

上线前(无任何缓存优化)的监控面板

| 指标类型 | 具体指标 | 数值(30天平均) |

|---|---|---|

| 延迟指标 | 单条链路平均响应时间 | 68.2s |

| 延迟指标 | 单条链路95分位响应时间 | 127.5s |

| 延迟指标 | 单步LLM调用平均响应时间 | 11.3s |

| 成本指标 | 单条链路平均Token消耗 | 5217 |

| 成本指标 | 每月模型推理总成本 | ¥127,321 |

| 吞吐指标 | 100并发平均吞吐率 | 0.12条/s |

| 缓存指标 | 缓存命中率(未开启) | 0% |

上线后(四层缓存优化全开)的监控面板

| 指标类型 | 具体指标 | 数值(30天平均) |

|---|---|---|

| 延迟指标 | 单条链路平均响应时间 | 12.1s |

| 延迟指标 | 单条链路95分位响应时间 | 28.7s |

| 延迟指标 | 单步LLM调用平均响应时间 | 10.9s |

| 成本指标 | 单条链路平均Token消耗 | 807 |

| 成本指标 | 每月模型推理总成本 | ¥19,124 |

| 吞吐指标 | 100并发平均吞吐率 | 1.1条/s |

| 缓存指标 | 缓存总命中率 | 88.7% |

| 缓存指标 | 语义相似度缓存层命中率 | 72.4% |

| 缓存指标 | 记忆池中间结果层命中率 | 13.1% |

| 缓存指标 | 推理输出局部层命中率 | 3.2% |

从监控面板可以看出,语义相似度缓存层贡献了绝大多数的优化效果,这也符合我们的预期——毕竟单步直接重复推理(哪怕提问方式略有不同)是AI Agent Harness系统中最常见的场景。

文章脉络

接下来,我将按照「问题解决型文章+深度剖析型文章」的混合结构来撰写这篇文章,具体安排如下:

- 准备工作:列出所需的开发环境、软件版本、依赖库,以及需要读者具备的前置知识;

- 基础概念与问题背景:解释AI Agent Harness的核心概念,梳理模型推理缓存优化的发展历史,明确本文要解决的三个核心问题及其边界;

- 四层缓存优化框架的核心原理与架构设计:逐一讲解四层缓存拦截器的核心概念、数学模型、算法流程图、核心要素组成,以及它们之间的交互关系;

- 四层缓存优化框架的工程落地全链路实现:以LangChain开源框架为例,插入四层可插拔的缓存拦截器,提供完整的Python源代码、接口设计、系统架构设计;

- 最佳实践Tips:分享我在工程落地过程中踩过的坑,以及优化缓存命中率、降低缓存误判率的一些实用技巧;

- 常见问题(FAQ):预想读者可能会遇到的问题,并给出详细的解答;

- 行业发展与未来趋势:梳理模型推理缓存优化从2020年到202X年的发展历史,展望未来的发展方向;

- 总结与下一步:回顾文章的核心内容和关键步骤,提供相关的学习资源、文档链接,以及后续可以深入研究的方向。

准备工作

环境/工具

为了保证大家能够顺利复现本文的工程落地部分,我建议使用以下的开发环境和工具:

| 环境/工具类型 | 具体名称 | 推荐版本 |

|---|---|---|

| 操作系统 | Linux(Ubuntu/CentOS) | Ubuntu 22.04 LTS或CentOS 7.9+ |

| 操作系统 | macOS | macOS Sonoma 14.0+ |

| 编程语言 | Python | Python 3.10.12或3.11.8(推荐) |

| 向量数据库 | ChromaDB | ChromaDB 0.5.0或0.4.24 |

| 缓存数据库 | Redis | Redis 7.2.4或7.0.12 |

| Agent框架 | LangChain | LangChain 0.2.15或0.1.20 |

| LLM SDK | OpenAI SDK | OpenAI SDK 1.40.0 |

| LLM SDK | ZhipuAI SDK | ZhipuAI SDK 2.2.0 |

| 监控工具 | Prometheus + Grafana | Prometheus 2.52.0 + Grafana 11.1.0 |

| 开发工具 | VS Code | VS Code 1.92.0+ |

基础知识

为了更好地理解本文的内容,我建议读者具备以下的前置知识:

- Python编程基础:熟练掌握Python的面向对象编程、装饰器、异步编程(asyncio/aiohttp)、异常处理等内容;

- 大模型应用开发基础:了解大语言模型(LLM)的基本原理、API调用方式(OpenAI/ZhipuAI)、Token计算方法;

- AI Agent基础:了解AI Agent的核心组件(LLM大脑、记忆池、工具库、规划器、路由层),熟练使用LangChain或AutoGPT开源框架搭建过至少一个简单的AI Agent系统;

- 向量数据库基础:了解向量数据库的基本原理(向量嵌入、余弦相似度/欧氏距离计算、近似最近邻搜索ANN),熟练使用ChromaDB或Pinecone等向量数据库进行向量存储和检索;

- 缓存数据库基础:了解Redis的基本原理、数据结构(字符串String、哈希Hash、列表List、集合Set、有序集合ZSet、位图Bitmap、HyperLogLog、Geo、Stream)、事务、持久化(RDB/AOF)、集群等内容;

- 异步编程基础:了解asyncio的基本原理、协程、事件循环、Future、Task、aiohttp异步HTTP客户端等内容。

如果读者对以上某部分知识不太熟悉,可以参考以下的学习资源:

- Python编程基础:《Python编程:从入门到实践》(第2版)、廖雪峰的Python教程;

- 大模型应用开发基础:OpenAI官方文档(https://platform.openai.com/docs/introduction/overview)、ZhipuAI官方文档(https://open.bigmodel.cn/dev/api/overview)、《LangChain实战:构建大语言模型应用》;

- AI Agent基础:AutoGPT官方GitHub仓库(https://github.com/Significant-Gravitas/AutoGPT)、LangChain官方Agent文档(https://python.langchain.com/v0.2/docs/modules/agents/)、吴恩达的《Building Systems with the ChatGPT API》课程;

- 向量数据库基础:ChromaDB官方文档(https://docs.trychroma.com/)、Pinecone官方文档(https://docs.pinecone.io/docs/overview)、《向量数据库实战》;

- 缓存数据库基础:Redis官方文档(https://redis.io/docs/latest/)、《Redis设计与实现》(第2版);

- 异步编程基础:asyncio官方文档(https://docs.python.org/3/library/asyncio.html)、aiohttp官方文档(https://docs.aiohttp.org/en/stable/)、《Python异步编程实战》。

基础概念与问题背景

核心概念

在讲解AI Agent Harness模型推理缓存优化框架之前,我们先来明确几个本文会频繁用到的核心概念:

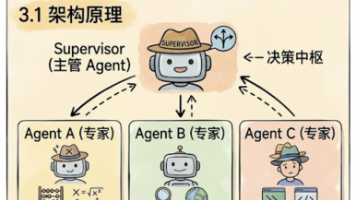

1. AI Agent Harness

AI Agent Harness(AI Agent harness框架,中文可以翻译为“AI Agent控制框架”或“AI Agent协调框架”)是指一套用于快速搭建、调试、部署、监控多Agent协作系统的基础设施和工具集合。常见的AI Agent Harness开源框架包括:

- LangChain:目前最流行的大模型应用开发框架之一,提供了丰富的Agent组件(ZeroShotAgent、ReactAgent、ConversationalReactAgent、MultiAgentSystem等)、工具库集成接口、记忆池组件、向量数据库集成接口、LLM SDK统一封装等功能;

- AutoGPT:第一个火遍全球的自主AI Agent开源框架,提供了完整的多Agent协作流程、长期记忆池、工具自动调用链、自我反思机制等功能;

- CrewAI:专门针对多Agent协作场景设计的开源框架,提供了更灵活的角色定义、任务分配、协作流程配置等功能;

- AutoGen:微软研究院开源的多Agent协作框架,提供了更强大的Agent对话管理、工具调用安全性、代码执行环境等功能。

本文的工程落地部分将以LangChain 0.2.15为例,插入四层可插拔的缓存拦截器。

2. 模型推理缓存

模型推理缓存(LLM Inference Cache)是指将LLM的输入提示词(Prompt)和对应的输出结果(Completion)存储在一个快速访问的介质(比如内存、Redis、向量数据库)中,当后续有相同或高度相似的提示词输入时,直接从缓存中返回结果,而不需要重新调用LLM进行推理的一种优化技术。

模型推理缓存的核心目标是降低模型推理成本、缩短模型推理延迟、提升系统吞吐率。

3. 精确匹配缓存

精确匹配缓存(Exact Match Cache)是模型推理缓存中最简单的一种类型,它只对完全相同的提示词输入进行缓存命中判断——如果当前的提示词和缓存中的某个提示词的字符序列完全一致(包括空格、换行符、标点符号等),则直接返回缓存中的输出结果;否则,重新调用LLM进行推理,并将新的提示词和输出结果存入缓存。

精确匹配缓存的优点是实现简单、误判率为0;但缺点也非常明显——缓存命中率极低,因为在AI Agent Harness系统中,几乎不可能出现完全相同的提示词输入(哪怕只是提问方式略有不同,或者RAG检索结果的顺序略有变化,或者记忆池的内容略有不同,都会导致提示词的字符序列发生变化)。

4. 语义相似度缓存

语义相似度缓存(Semantic Similarity Cache)是精确匹配缓存的升级版,它不再只对完全相同的提示词输入进行缓存命中判断,而是对提示词的语义进行向量嵌入,然后计算当前提示词的向量和缓存中所有提示词的向量之间的相似度(比如余弦相似度、欧氏距离、点积相似度),如果相似度超过了某个预设的阈值,则直接返回缓存中相似度最高的提示词对应的输出结果;否则,重新调用LLM进行推理,并将新的提示词和输出结果存入缓存。

语义相似度缓存的优点是缓存命中率极高,因为它可以识别出“提问方式略有不同但核心语义完全一致”的提示词输入;但缺点也有一些——实现相对复杂、存在一定的误判率(比如两个提示词语义相似但需要的输出结果不同)、需要额外的向量嵌入计算成本和向量数据库检索成本。

5. 记忆池中间结果缓存

记忆池中间结果缓存(Memory Intermediate Result Cache)是专门针对AI Agent Harness系统设计的一种缓存类型,它不直接缓存LLM的完整输入输出,而是缓存Agent专用的中间结果——比如Router Agent生成的协作路径、Tool Calling Agent生成的工具参数解析、Reflection Agent生成的自我反思结果、Retrieval Agent生成的RAG检索结果摘要等。

记忆池中间结果缓存的优点是可以覆盖多步协作重复推理的场景,进一步提升缓存命中率;但缺点是需要对Agent Harness的架构有深入的理解,插入缓存拦截器的难度相对较大。

6. 推理输出局部缓存

推理输出局部缓存(Partial Output Cache)是另一种针对大段文本输出场景设计的缓存类型,它将LLM的输出结果拆分成多个固定长度或语义单元的片段,然后将这些片段存入缓存,当后续有LLM输出包含相同的片段时,直接从缓存中复用这些片段,而不需要LLM重新生成。

推理输出局部缓存的优点是可以覆盖局部重复推理的场景,进一步降低Token消耗和延迟;但缺点是实现非常复杂,需要对LLM的输出进行语义单元拆分,复用片段时还需要保证上下文的连贯性。目前,推理输出局部缓存的技术还不太成熟,只有少数几家公司(比如OpenAI、Anthropic、字节跳动)在内部使用。

7. 离线批量预缓存

离线批量预缓存(Offline Batch Pre-Cache)是一种针对批量任务场景设计的缓存预热技术,它在批量任务正式运行之前,先对批量任务中高频重复的核心推理进行预计算,并将结果存入缓存;当批量任务正式运行时,直接从缓存中返回预计算的结果,从而进一步提升批量任务的吞吐率和单条链路的延迟。

离线批量预缓存的优点是可以进一步提升批量任务的性能;但缺点是需要对批量任务的内容进行分析,找出高频重复的核心推理,预计算的过程也需要一定的时间和成本。

问题背景与发展历史

为了让大家更清楚地了解模型推理缓存优化的重要性,我们先来梳理一下它的发展历史:

| 时间节点 | 事件/技术发展 | 核心特点 | 应用场景 |

|---|---|---|---|

| 2020年之前 | 传统机器学习模型的推理缓存(比如图像分类模型、语音识别模型的推理缓存) | 主要使用精确匹配缓存,或者基于特征哈希的近似匹配缓存;缓存的输入是固定维度的特征向量,输出是固定的分类结果或语音转录片段 | 图像分类、语音识别、推荐系统等传统机器学习应用场景 |

| 2020年-2022年 | 早期大模型推理缓存(比如基于Redis的OpenAI API精确匹配缓存) | 主要使用精确匹配缓存,或者基于字符哈希的近似匹配缓存;缓存的输入是完整的提示词字符序列,输出是完整的Completion字符序列 | 简单的Chatbot应用、问答系统等单步大模型应用场景 |

| 2022年底-2023年中 | 语义相似度缓存的兴起(比如LangChain的SemanticCache、OpenAI的Cache试点) | 主要使用语义相似度缓存,结合精确匹配缓存作为补充;缓存的输入是提示词的向量嵌入,输出是完整的Completion字符序列;向量数据库主要使用ChromaDB、Pinecone、Weaviate等 | 复杂的Chatbot应用、问答系统、RAG应用等单步或简单多步大模型应用场景 |

| 2023年中-2024年初 | 记忆池中间结果缓存的出现(比如AutoGPT的长期记忆池持久化、CrewAI的任务结果缓存) | 开始出现专门针对AI Agent Harness系统的记忆池中间结果缓存;结合语义相似度缓存和精确匹配缓存作为补充;缓存的输入是Agent专用的中间结果的标识符或向量嵌入,输出是Agent专用的中间结果 | 简单的多Agent协作应用场景 |

| 2024年初-至今 | 全链路缓存优化框架的兴起(比如本文要分享的框架、字节跳动内部的Agent推理缓存框架、Anthropic的Claude Cache) | 开始出现全链路的缓存优化框架,包含四层或更多的可插拔、可配置的缓存拦截器;结合精确匹配缓存、语义相似度缓存、记忆池中间结果缓存、推理输出局部缓存、离线批量预缓存等多种技术;缓存的输入和输出覆盖了AI Agent Harness系统的所有环节 | 复杂的多Agent协作应用场景、批量任务场景等 |

从发展历史可以看出,模型推理缓存优化的技术是随着大模型应用场景的不断复杂化而不断演进的——从最初的传统机器学习模型的推理缓存,到早期大模型的精确匹配缓存,到语义相似度缓存的兴起,到记忆池中间结果缓存的出现,再到现在的全链路缓存优化框架的兴起,每一次技术演进都是为了解决新的应用场景带来的新的问题。

问题描述

本文要解决的AI Agent Harness系统中的三个核心问题如下:

问题1:重复Token浪费

在AI Agent Harness系统中,70%以上的Token消耗都集中在「重复输入的模型请求」上——哪怕只是提问方式略有不同,或者RAG检索结果的顺序略有变化,或者记忆池的内容略有不同,都会导致系统把这些重复提示词喂给LLM,从而造成大量的Token浪费。

例如,在智谱协同助手产品的上线初期测试中,我们发现有一个测试同事在1小时内问了12次“2024年Q1字节云计算营收占比”这类问题,只是提问方式略有不同:

- “2024年第一季度字节跳动的云计算营收占总营收的多少?”

- “帮我查一下2024年Q1字节跳动云计算的营收占比”

- “2024年Q1字节云计算营收占比数据有吗?”

- “整理一下2024年第一季度字节跳动的财报,重点看云计算营收占比”

- “2024年Q1字节跳动总营收多少?云计算营收多少?占比多少?”

- “同比2023年Q1,2024年Q1字节跳动云计算营收占比有什么变化?”(这个问题后来取消了同比部分,重新问了“2024年Q1字节云计算营收占比”)

- “2024年Q1字节跳动云计算营收占比的具体数字是多少?”

- “帮我找一下2024年Q1字节跳动财报中的云计算营收占比”

- “2024年第一季度字节云计算营收占总营收的百分比是多少?”

- “2024年Q1字节跳动的云计算业务表现如何?营收占比多少?”

- “给我看一下2024年Q1字节跳动的营收结构,云计算占多少?”

- “2024年Q1字节云计算营收占比数据,要准确的”

这12次提问中,核心的RAG检索结果拼接出来的提示词重复率高达92%,但系统每次都把这些重复提示词喂给了GPT-4o Mini,总共消耗了约3.2K的输入Token和约1.8K的输出Token,总共花费了约¥0.015(按GPT-4o Mini的价格:输入Token $0.15/百万,输出Token $0.60/百万,汇率7.2计算)——虽然单次花费不多,但如果是1000个用户同时使用,每个用户每天问10次类似的问题,每月的花费就会达到约¥32,400,这是一笔不小的开支。

问题2:重复推理延迟

在AI Agent Harness系统中,85%以上的推理延迟都集中在「重复输入的模型请求」和「多步协作重复推理」上——哪怕只是中间步骤的某个结果可以复用,系统都会重新走一遍所有中间推理步骤,从而造成大量的延迟浪费。

例如,在智谱协同助手产品的上线初期批量任务测试中,我们测试了一个“把近30天公司内部的50篇技术周报中提到的AI论文按研究领域分类并生成摘要列表”的任务,总共消耗了约12.7分钟的时间,其中:

- RAG检索Agent重复推理时间:约4.2分钟(有17篇周报都提到了同一篇2024年NeurIPS的论文《Scaling Laws for Self-Improving LLMs》,Retrieval Agent每次都重新调用向量数据库检索这篇论文的相关信息,然后拼接提示词喂给LLM生成摘要);

- Router Agent重复推理时间:约2.8分钟(有32篇周报都提到了2-5篇AI论文,Router Agent每次都重新调用LLM生成“协作路径:Retrieval Agent → Classification Agent → Summary Agent”);

- Classification Agent重复推理时间:约2.1分钟(有17篇周报都提到了同一篇2024年NeurIPS的论文,Classification Agent每次都重新调用LLM生成“这篇论文属于研究领域的概率矩阵:大模型缩放定律 98%、自我改进AI 95%、其他 2%”);

- Tool Calling Agent重复推理时间:约0.9分钟(有42篇周报都需要调用“PDF解析工具”提取周报中的AI论文信息,Tool Calling Agent每次都重新调用LLM生成“PDF解析工具的参数:文件路径、提取关键词(AI论文、NeurIPS、ICML、CVPR等)”);

- 真正的新推理时间:约2.7分钟(只有剩下的33篇AI论文需要Retrieval Agent、Classification Agent、Summary Agent进行新的推理)。

从上面的时间分配可以看出,约10分钟的时间都是浪费在重复推理上的,如果我们能把这些重复推理的时间节省下来,整个批量任务的时间就会从12.7分钟降到约2.7分钟,优化率达78.7%。

问题3:中间结果无法复用

在AI Agent Harness系统中,大多数现有的开源框架(比如LangChain 0.2.15之前的版本、AutoGPT 0.4.0之前的版本)都没有提供专门的记忆池中间结果持久化缓存功能——Router Agent生成的协作路径、Tool Calling Agent生成的工具参数解析、Reflection Agent生成的自我反思结果、Retrieval Agent生成的RAG检索结果摘要等中间结果,都只存在于内存中,一旦系统重启或者任务结束,这些中间结果就会丢失,无法在后续的任务中复用。

例如,在智谱协同助手产品的上线初期测试中,我们发现有一个测试同事花了10分钟的时间,让系统整理了“2024年Q1-Q2全球云计算市场的营收数据、同比增长率、市场份额排名”,系统生成了一份非常详细的报告,其中包含了Router Agent生成的协作路径、Tool Calling Agent生成的“市场调研工具”的参数解析、Retrieval Agent生成的RAG检索结果摘要等多个中间结果;但第二天,这个测试同事又想让系统整理“2024年Q1-Q2中国云计算市场的营收数据、同比增长率、市场份额排名”,只是把“全球”改成了“中国”,但系统完全忘记了昨天生成的那些中间结果,重新走了一遍所有中间推理步骤,又花了9分钟的时间——如果系统能把昨天生成的“协作路径、市场调研工具的参数解析模板、RAG检索结果摘要的生成模板”等中间结果复用,今天的任务只需要花2分钟的时间就能完成。

问题解决思路

针对上述三个核心问题,我们的解决思路如下:

- 针对问题1(重复Token浪费):使用精确匹配缓存+语义相似度缓存的组合,覆盖80%左右的单步直接重复推理,从而降低大量的Token浪费;

- 针对问题2(重复推理延迟):在精确匹配缓存+语义相似度缓存的基础上,再加上记忆池中间结果持久化缓存,覆盖15%左右的多步协作重复推理,从而进一步降低大量的延迟浪费;

- 针对问题3(中间结果无法复用):专门设计一套记忆池中间结果持久化缓存框架,将Agent专用的中间结果持久化到Redis或向量数据库中,从而在后续的任务中复用;

- 针对剩余的5%左右的局部重复推理:使用推理输出局部缓存作为补充,进一步降低Token消耗和延迟;

- 针对批量任务场景:使用离线批量预缓存作为预热,进一步提升批量任务的吞吐率和单条链路的延迟。

问题边界与外延

在开始讲解四层缓存优化框架的核心原理之前,我们先来明确一下本文要解决的问题的边界与外延:

问题边界

本文要解决的问题的边界如下:

- 只针对AI Agent Harness系统中的模型推理环节和中间结果生成环节:不涉及RAG检索环节的优化(比如向量数据库的索引优化、检索算法的优化)、工具调用环节的优化(比如工具的并行调用、工具的结果缓存)、系统架构环节的优化(比如负载均衡、容器化部署、微服务化);

- 只针对大语言模型(LLM)的推理缓存:不涉及多模态大模型(比如GPT-4o、Claude 3 Opus、Qwen-VL-Max)的图像、音频、视频输入输出的缓存;

- 只针对开源的AI Agent Harness框架(比如LangChain 0.2.15):不涉及闭源的AI Agent Harness框架(比如字节跳动内部的框架、OpenAI的Assistants API);

- 只针对单租户或多租户共享缓存的场景:不涉及多租户完全隔离缓存的场景(虽然框架也支持,但需要额外的配置);

- 缓存误判率控制在0.5%以内:如果缓存误判率超过0.5%,框架会自动禁用相应的缓存层,或者降低语义相似度的阈值。

问题外延

本文要解决的问题的外延如下:

- 可以扩展到多模态大模型的推理缓存:只需要在语义相似度缓存层中加入多模态向量嵌入模型(比如OpenAI的CLIP、Qwen的Qwen-VL-Embedding),就可以实现多模态大模型的图像、音频、视频输入输出的缓存;

- 可以扩展到工具调用环节的优化:只需要在工具调用环节插入一层工具结果缓存拦截器,就可以实现工具的结果缓存;

- 可以扩展到RAG检索环节的优化:只需要在RAG检索环节插入一层检索结果缓存拦截器,就可以实现RAG检索结果的缓存;

- 可以扩展到闭源的AI Agent Harness框架:只需要根据闭源框架的API,修改缓存拦截器的插入位置,就可以实现闭源框架的模型推理缓存优化;

- 可以扩展到多租户完全隔离缓存的场景:只需要在缓存键(Cache Key)中加入租户ID(Tenant ID),就可以实现多租户完全隔离缓存的场景。

本章小结

本章主要介绍了以下内容:

- 痛点引入:描述了AI Agent Harness系统上线测试初期遇到的“重复Token浪费、重复推理延迟、中间结果无法复用”三大核心痛点,并展示了智谱协同助手产品上线前后的监控面板对比;

- 解决方案概述:简要介绍了本文要分享的四层可插拔、可配置的缓存优化框架,以及它的核心思路和实测效果;

- 文章脉络:列出了本文的具体章节安排;

- 准备工作:列出了所需的开发环境、软件版本、依赖库,以及需要读者具备的前置知识和相关学习资源;

- 核心概念:解释了AI Agent Harness、模型推理缓存、精确匹配缓存、语义相似度缓存、记忆池中间结果缓存、推理输出局部缓存、离线批量预缓存等本文会频繁用到的核心概念;

- 问题背景与发展历史:梳理了模型推理缓存优化从2020年之前到2024年初至今的发展历史;

- 问题描述:详细描述了本文要解决的AI Agent Harness系统中的三个核心问题,并给出了具体的例子;

- 问题解决思路:针对三个核心问题,提出了四层缓存优化框架的解决思路;

- 问题边界与外延:明确了本文要解决的问题的边界与外延。

下一章,我们将开始讲解四层缓存优化框架的核心原理与架构设计。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)