和豆包语音时豆包内部是怎么工作的?其中学问大得多!

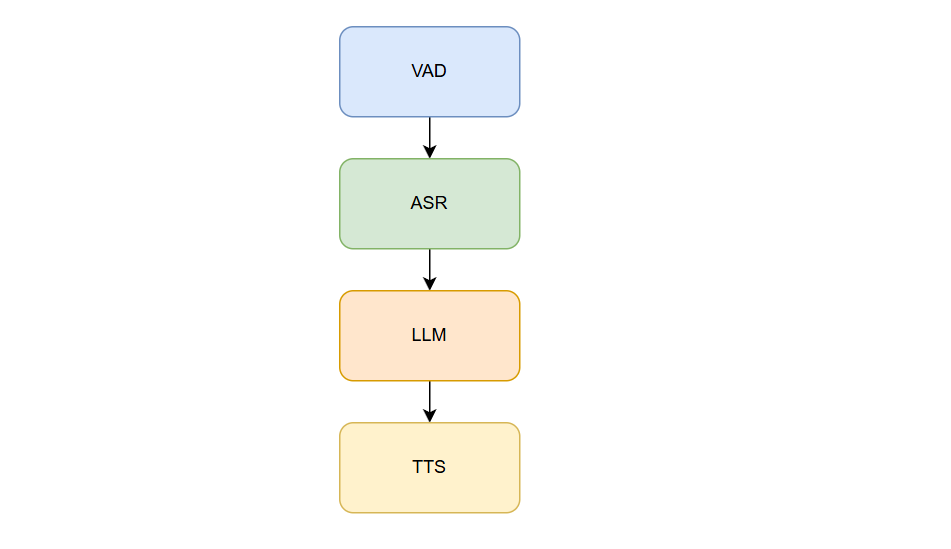

AI语音对话背后的技术链路解析 一段简单的AI语音交互背后隐藏着精密的技术流程。从音频采集到语音回复,完整的语音Agent工作流程包含10个关键步骤:音频采集→前处理→VAD检测→上传→ASR转写→上下文组装→LLM推理→TTS合成→音频下行→状态回写。其中VAD、ASR、LLM和TTS构成四大核心技术模块,分别负责语音检测、语音转文字、智能决策和语音合成。这套系统融合了硬件采集、音频算法和AI模

日常使用AI语音对话时,一句随口说出的语音指令,几秒内就能得到清晰的语音回复。多数使用者仅感知到简单的语音交互,却不清楚背后隐藏一套完整、精密的语音Agent链路。但不用怕!看完这篇文章,你将理解AI语音对话 Agent 全工作流程,解析四大核心技术模块,真正明白豆包是怎么和你语音的!

语音Agent工作流程

一次流畅的AI语音对话,从发声到听到回复,完整流转共分为十个步骤,每个环节各司其职、环环相扣,任意环节出错都会导致对话卡顿、杂音、识别错误等问题。其中藏着不少奥秘!

1. 音频采集

麦克风作为硬件采集设备,持续捕捉环境中的声波振动,将模拟声音信号转化为原始电子音频数据。类似录音笔的基础录制功能,此时采集到的音频混杂环境噪音、回声等无效杂音,音质粗糙,无法直接用于识别。

2. 音频前处理

原始音频需经过三道基础音频算法优化,行业通用三大处理技术为AEC、NS、AGC。AEC回声消除算法剔除设备扬声器传回的回声,避免AI把自身播报的声音当成用户指令;NS降噪算法过滤环境风声、人声、电流声等无关噪音;AGC自动增益控制算法放大轻微人声、抑制爆音,保证人声音量稳定均衡。该环节相当于给音频做“清洁美颜”。

3. VAD检测

VAD语音活动检测算法持续监测优化后的音频,它的功能不是识别内容而是判断,精准判断人声什么时候开始,什么时候结束。算法可区分环境杂音与人声,避免无效上传空白音频、噪音音频;同时判定用户是否说完话,为后续断句识别、响应触发提供依据,类似人工对话中的停顿判断。

4. 音频上传

客户端将经过前处理、筛选后的纯净音频,通过网络协议传输至后端服务端。行业普遍采用分片流式上传方式,无需等待用户说完整句话,逐段上传音频数据,缩短响应耗时,提升交互流畅度。

5. ASR转写

服务端接收音频片段后,通过ASR语音识别模型完成音频到文字的转换。依托流式输出技术,每接收一段音频就实时解析一段文字,边上传边转写,用户未结束说话时,页面可实时展示增量文字,直观呈现识别结果。

6. 上下文组装

后端程序拼接三类核心数据,封装成大模型可识别的请求报文。数据包含固定系统指令、本轮对话前置的历史聊天记录、预设工具调用定义。该步骤为后端常规数据组装逻辑,作用是让模型读懂对话背景、明确身份定位、具备外部工具调用能力。

7. LLM推理

大语言模型接收组装完成的上下文数据,解析用户语音对应的文字意图。结合历史对话梳理逻辑,判断是否需要调用搜索、计算等外部工具,最终生成通顺、贴合语境的文本回复。该环节是语音Agent的大脑决策环节,决定回复的准确性与逻辑性。

8. TTS合成

LLM生成的文本回复推送至TTS语音合成模型,模型将文字逐段转化为自然人声音频块。同样采用流式合成模式,无需等待全文生成,拆分文本实时合成音频,保障后续播放的连贯性。

9. 音频下行

服务端将合成好的音频分片推送至客户端,客户端遵循边接收、边解码、边播放的逻辑。使用者无需等待全部音频加载完成,短时间内即可听到AI语音回复,弱化交互延迟感。

10. 状态回写

本轮对话结束后,后端数据库存储本次用户提问、模型回复、交互时间等数据。留存的对话数据会作为下一轮对话的历史上下文,保障多轮聊天时语境连贯,实现连续对话效果。

核心技术模块

在语音Agent全链路中,VAD、ASR、LLM、TTS为四大核心模块,决定语音交互的流畅度、智能化程度。四大模块分工明确,缺一不可,你必须要明白这四个概念!

VAD(语音活动检测)

VAD是一类轻量级音频判别算法,核心功能是区分人声与非人声,精准定位人声的开始时间戳与结束时间戳。日常生活中,说话间隙的呼吸声、桌面碰撞声不会触发识别,说话停顿几秒后判定为发言结束,均由VAD算法实现。

举例:使用语音对话时,中途停顿2秒思考,AI不会提前打断回复;周边出现车流噪音时,设备不会误识别为语音指令,该现象就是VAD算法的判别效果。该模块不解析语义,仅负责判断有没有人声。

ASR(自动语音识别)

ASR是语音转文字的人工智能模型,核心能力是将人类自然语音、方言、口语化语句,精准映射为标准化文本。模型依托海量语音语料训练,可适配不同语速、音色、口音,同时规避轻微杂音干扰。

举例:口头说出“帮我查询今日天气”,ASR模型捕捉声波特征,匹配文字语义,最终输出纯文本语句。它是语音交互的翻译官,打通声音到文字的转化壁垒,为大模型理解意图奠定基础。

LLM(大语言模型)

LLM是整个语音Agent的核心大脑,依托海量文本数据训练,具备语义理解、逻辑推理、内容生成、工具调用能力。区别于传统规则引擎,大模型可理解口语化、模糊化、歧义语句,结合上下文梳理逻辑,生成拟人化回复。

举例:先后发送两句语音“推荐一首轻音乐”“换一首舒缓的”,LLM可识别第二句指令指代前文轻音乐,无需重复补充限定条件,依托上下文完成连贯应答。复杂场景下,模型还可调用计算器、搜索引擎等工具完成专业任务。

TTS(语音合成技术)

TTS是文字转语音的生成式AI模型,核心作用是将LLM输出的文本,转化为具备语气、语调、情感的自然人声。优质TTS模型可模拟真人停顿、轻重语气,规避机械电子音,提升听觉舒适度。

举例:模型生成科普类文本时,TTS采用平缓沉稳语调;生成趣味问答文本时,语气轻快灵动。同一文字可切换多种音色,本质是TTS模型对声波频率、语速、音调的精细化调控。

总结

AI语音对话Agent并非单一模型实现,而是硬件采集、音频算法、人工智能模型、后端数据服务协同配合的完整工程体系。音频采集与前处理筑牢音频质量基础,VAD完成人声筛选,ASR实现声转文,LLM承担智能推理决策,TTS完成文转声,最后通过数据存储实现上下文连贯,十个步骤闭环完成一次语音交互。

看似简单的一句语音对话,背后串联数十项算法与工程优化。理解这套基础链路,不仅能够看懂AI语音产品运行逻辑,也可为智能语音后端开发、Agent应用搭建奠定底层认知。后续可深入学习流式接口对接、音频编解码、大模型Prompt优化等进阶知识点,深耕语音Agent后端开发领域。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)