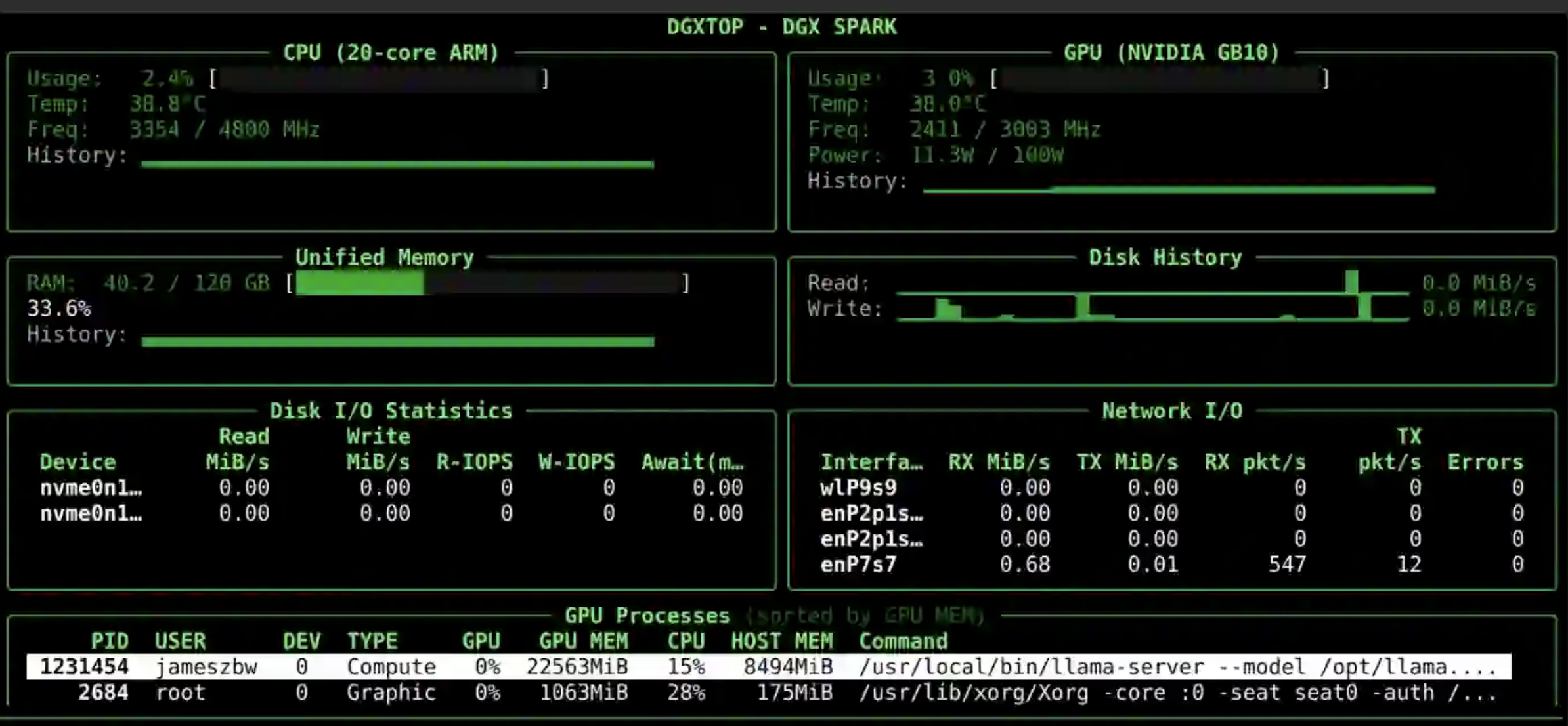

DGX Spark 跑 Qwen3.5-35B-A3B 实测43tok/s

主要踩坑记录: - openclaw 发的请求里有 developer role,Qwen3.5 的模板不认,直接 500 ❌ - 工具调用返回用的是 toolResult,Qwen3.5 只认 tool,又是 500 ❌ - 默认开启 thinking 模式,模型把所有 token 都花在推理上,返回内容为空 ❌ 解决方案: 写了一个小代理层,自动处理所有兼容性问题。支持在消息开头加 [thin

·

最近折腾了一下在 DGX Spark(GB10)上用 llama.cpp 本地跑 Qwen3.5-35B-A3B,顺便接上了 openclaw 做 AI 编程助手,踩了不少坑,整理出来分享一下。 主要踩坑记录: - openclaw 发的请求里有 developer role,Qwen3.5 的模板不认,直接 500 ❌ - 工具调用返回用的是 toolResult,Qwen3.5 只认 tool,又是 500 ❌ - 默认开启 thinking 模式,模型把所有 token 都花在推理上,返回内容为空 ❌ 解决方案: 写了一个小代理层,自动处理所有兼容性问题。支持在消息开头加 [think] 关键词按需开启深度推理模式,其他情况下正常快速响应。 实测性能: - 生成速度:~43 tok/s - 预填充速度:~63 tok/s - 上下文窗口:131K 脚本和代码已开源,一条命令从零到可用: https://github.com/ZengboJamesWang/Qwen3.5-35B-A3B-openclaw-dgx-spark 有同样在玩 DGX Spark 的小伙伴欢迎交流~

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)