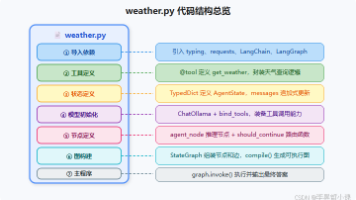

【AI Agent游戏开发笔记01】从AI Town到AI智能体游戏:用大模型驱动游戏角色自主生活

从斯坦福AI Town论文到真正可玩的AI智能体游戏,需要解决哪些技术问题?本文分享AI Agent游戏的核心架构设计:行为分层(LLM只负责"思考",执行交给规则系统)、三层记忆系统(工作记忆+情景记忆+语义记忆)、行为验证与游戏系统桥接。这是「AI Agent游戏开发笔记」系列第一篇。

这是「AI Agent游戏开发笔记」系列第一篇。

我们团队在做一款AI智能体游戏——AI小妖怪,以西游修仙为主题,AI角色(Agent)在游戏世界中自主生活。这个系列会记录开发过程中的技术思考和实践经验。

计划内容:

- 架构总览(本篇)

- 记忆系统:让AI NPC真正"记住"玩家

- 多Agent社交系统设计

- LLM调用成本控制实战

- 从0到上线踩坑全记录

1. 什么是AI智能体游戏

先明确概念。AI智能体游戏(AI Agent Game)不是指"游戏里接了个ChatGPT"。

核心区别在于:

传统AI NPC:预设行为树 → 触发条件 → 执行脚本

对话AI NPC:玩家输入 → LLM生成回复 → NPC行为不变

AI Agent: 感知环境 → LLM推理 → 自主决策 → 执行行为 → 反思学习

AI Agent的行为是自驱的——它有目标,有记忆,会基于当前状况自主选择要做什么。不需要玩家触发,不需要脚本编排。

2. 学术起源:Stanford Generative Agents

2023年斯坦福的论文《Generative Agents: Interactive Simulacra of Human Behavior》是这个方向的里程碑。

论文核心架构:

┌─────────────────────────────────────────┐

│ Agent Architecture │

├──────────┬──────────┬───────────────────┤

│ Perceive │ Retrieve │ Plan & React │

│ 感知环境 │ 检索记忆 │ 规划与响应 │

├──────────┴──────────┴───────────────────┤

│ Memory Stream │

│ 记忆流(所有观察和反思) │

├─────────────────────────────────────────┤

│ Reflection │

│ 高层次反思与总结 │

└─────────────────────────────────────────┘

核心点:

- 记忆流:记录Agent的所有经历(观察、对话、行为),每条记忆带时间戳和重要性分数

- 检索:做决策时,按 相关性×时近性×重要性 加权检索最相关的记忆

- 反思:周期性对记忆做高层次总结,形成"认知"

这套架构优雅但在工程落地时有大量问题要解决。

3. 从学术demo到游戏产品的差距

AI Town证明了"LLM能驱动Agent社会行为",但要做成游戏产品,差距巨大:

| 问题 | AI Town | 游戏产品需求 |

|---|---|---|

| 规模 | 25个Agent | 数百~数千个 |

| 行为空间 | 聊天+移动 | 战斗、修炼、交易、装备… |

| 持续时间 | 跑几天 | 7×24持续运行 |

| 成本 | 实验不限制 | 必须控制在可盈利范围 |

| 延迟 | 可以等10秒 | 玩家期望秒级响应 |

| 行为质量 | 偶尔离谱可接受 | 频繁离谱=流失 |

| 游戏系统 | 无 | 完整RPG系统 |

4. 我们的架构设计

基于以上考量,我们的架构做了几个关键调整:

4.1 行为分层(最重要的设计决策)

不是所有行为都需要LLM。我们把Agent行为分成三层:

┌─────────────────────────────┐

│ Layer 3: 战略决策(LLM) │ 频率:每几小时一次

│ "接下来的目标是什么?" │ 模型:强模型

├─────────────────────────────┤

│ Layer 2: 战术决策(轻量LLM) │ 频率:每几分钟一次

│ "现在具体做什么?" │ 模型:中等模型

├─────────────────────────────┤

│ Layer 1: 执行层(规则系统) │ 频率:每秒

│ "怎么走到目标位置" │ 无需LLM

└─────────────────────────────┘

举个例子:

Layer 3 (LLM): "我应该提升战力" → 输出目标:修炼

Layer 2 (LLM): "去哪修炼?选哪个技能?" → 输出:去XX修炼场,练XX功

Layer 1 (规则): 寻路 → 播放动画 → 更新属性 → 完成

只有需要"思考"的部分才调LLM,机械性的执行用传统游戏逻辑。这一个设计把LLM调用量砍掉了90%+。

4.2 记忆系统

比AI Town论文更工程化的实现(详细设计会在下一篇展开):

┌──────────────────────────────────────┐

│ 记忆管理器 │

├──────────┬──────────┬────────────────┤

│ 工作记忆 │ 情景记忆 │ 语义记忆 │

│ (当前上下文)│ (经历事件) │ (总结的认知) │

│ 内存 │ 向量数据库 │ KV存储 │

│ 实时更新 │ 按需检索 │ 定期更新 │

└──────────┴──────────┴────────────────┘

关键优化:

- 摘要压缩:不存原始文本,存摘要,节省token

- 重要性过滤:只有超过阈值的事件才进入长期记忆

- 衰减机制:越久远的记忆权重越低(但"重要"的不衰减)

4.3 行为-游戏系统桥接

AI的决策必须真正影响游戏世界:

Agent决策引擎

│

▼

行为验证层(规则兜底)

│ 验证行为合法性

▼

游戏系统API

│

├── 修炼系统 → 属性变化

├── 战斗系统 → 战斗结果

├── 社交系统 → 关系变化

├── 经济系统 → 金币变化

└── ...

│

▼

结果 → 回写Agent记忆

行为验证层是必须有的——LLM有时会输出不合理的行为("飞升渡劫"但境界才练气期),需要规则系统拦截并给AI反馈:“你目前做不到这个”。

5. 技术栈

| 模块 | 选型 | 理由 |

|---|---|---|

| AI推理 | 多模型混用(强模型+中等模型) | 成本和质量的平衡 |

| 向量检索 | Weaviate | 开源、支持多种索引 |

| 游戏服务端 | Java | 性能、生态成熟 |

| 游戏客户端 | Web (React) | 跨平台,降低分发门槛 |

| 数据库 | MongoDB | 灵活schema,适合Agent数据 |

| 消息队列 | 内部实现 | Agent行为的异步调度 |

6. 核心挑战预览

这些会在后续文章中逐一展开

记忆系统(下一篇):

- 怎么决定哪些经历值得记住?

- 记忆检索怎么做到快+准?

- 记忆量膨胀后怎么办?

多Agent社交:

- 两个AI对话怎么防止无限循环?

- 八卦怎么传播?

- 群体行为怎么协调?

成本控制:

- 从每天几百美元到几美元的优化路径

- Prompt压缩技巧

- 缓存策略

总结

AI智能体游戏的技术核心不是"接一个ChatGPT",而是:

- 分层架构:LLM只负责"思考",执行交给规则系统

- 记忆工程:让AI真正"记住"并"学习"

- 系统整合:AI决策 ↔ 游戏系统的双向桥接

- 成本意识:每一次LLM调用都要问"这次调用值不值"

如果你也在做类似方向的项目,欢迎评论区交流。

📌 本文是「AI Agent游戏开发笔记」系列第1篇。

系列目录:

- 架构总览(本篇)

- 记忆系统设计

- 多Agent社交系统(更新中)

- LLM成本控制实战(敬请期待)

- 从0到上线踩坑记录(敬请期待)

项目体验: https://xyg.aiverse.zone/

平台官网: https://www.aiverse.zone/

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)