AI大模型时代,小白也能掌握创业哲学:从管人到管Token的范式转移

文章探讨了AI Agent进入组织后,管理哲学的变化。传统管理以“管人”为核心,而AI Agent的不确定性和管理方式与传统团队不同。文章重点分析了AI Agent权限设计、Token管理、人机协作实践以及与传统管理的异同。提出了为一人公司设计AI Agent管理框架的建议,包括将Token视为核心资源、建立三级授权体系、解耦推理引擎与执行能力、设计可观测性系统以及从管理者转变为架构师。文章最后讨

文章探讨了AI Agent进入组织后,管理哲学的变化。传统管理以“管人”为核心,而AI Agent的不确定性和管理方式与传统团队不同。文章重点分析了AI Agent权限设计、Token管理、人机协作实践以及与传统管理的异同。提出了为一人公司设计AI Agent管理框架的建议,包括将Token视为核心资源、建立三级授权体系、解耦推理引擎与执行能力、设计可观测性系统以及从管理者转变为架构师。文章最后讨论了AI Agent时代情绪价值的破产,以及组织进化的方向。

前排提示,文末有大模型AGI-CSDN独家资料包哦!

引言:一个新的物种进入了组织

企业管理的核心命题,千百年来只有一个:管人。从韩非子的法术势,到德鲁克的目标管理,再到OKR和敏捷方法论,所有框架都围绕着同一个基本假设:组织的执行单元是人,而人是不确定的。人会偷懒、会误解、会情绪化、会跳槽、会在周五下午三点心不在焉。

2025年,一个新物种正式进入了组织架构:AI Agent。它不请假、不抱怨、不搞办公室政治,但它也不理解自己在做什么。它的不确定性和人相比大大减少,但并未消失。管理它的方式,与其说是管理一个数字员工,不如说是管理大模型和Token的组合。

这不是比喻。Gartner在2024年底将Agentic AI列为2025年最重要的技术趋势,预测到2028年,33%的企业软件将嵌入Agent能力,15%的日常商业决策将由Agent自主完成[1]。IDC则预测到2028年全球将有13亿个AI Agent在运行[2]。HR平台Lattice已经开始为AI Agent建立正式的员工档案:它们出现在组织架构图上,有自己的头像和直属上级[3]。

与此同时,一人公司(OPC)的边界正在被重新定义。Y Combinator 2025冬季批次中的Rocketable,只有一名人类员工,却用AI Agent运营着一整个软件产品组合[4]。Cursor的开发公司Anysphere在2025年底估值达到293亿美元[5]。Carta的报告显示,2024年单人创始人且无VC资金的初创企业占比已从2015年的22.2%攀升至38%[6]。

本文想探讨的是:当一人公司的创始人开始用AI Agent替代传统团队时,管理的本质发生了什么变化?我们又该如何设计一套适配这个新范式的管理框架?

一、AI Agent权限的设计与边界

从管人到管身份:非人类身份(NHI)的崛起

传统管理中,我们通过岗位职责说明书、审批流程和企业文化来约束人的行为。对AI Agent而言,这些软性约束统统失效。它既不会领悟企业文化,也不存在自觉性。Agent的行为边界,完全取决于你赋予它的权限设计。

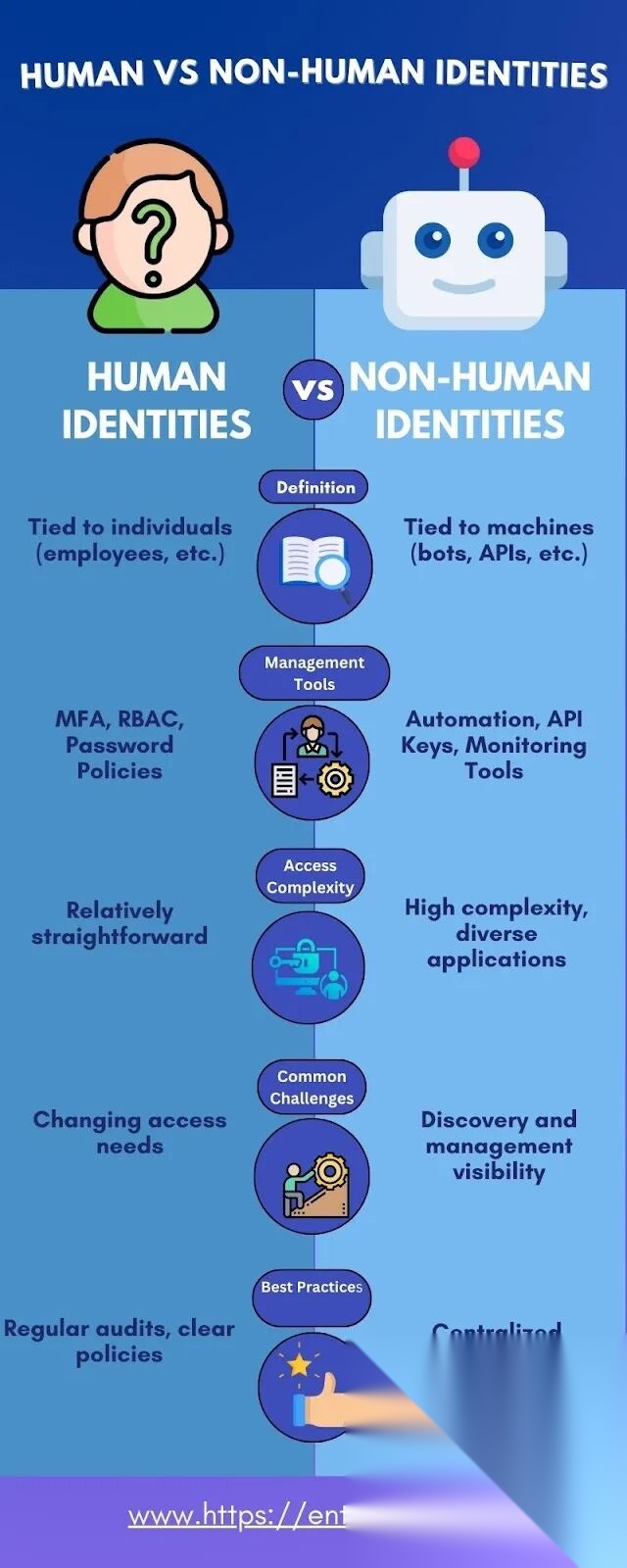

这就引出了AI Agent管理的核心概念:非人类身份(Non-Human Identity, NHI)。

NHI并不是新事物:API密钥、服务账户、OAuth令牌都是NHI的一种形式。但AI Agent的加入使问题产生了质变。CyberArk的2025年报告显示,企业中非人类身份与人类身份的比例已达82:1,在AI和自动化密集的环境中甚至高达144:1[7][8]。世界经济论坛在2025年10月发表的文章直接指出:Agent正在成为企业中“最大的隐形劳动力”,而现有的身份和零信任控制体系从未为它们设计[9]。

传统的NHI,比如一个定时备份脚本是可预测的、任务特定的、由人类直接配置的。AI Agent则完全不同:它自主决策、自主行动、甚至可以在运行时创建新的身份凭证。一个供应链优化Agent可能需要同时访问物流API、仓储系统、海关申报服务和内部ERP,每一个连接点都需要独立的身份凭证[10]。这种“秘密扩散”(Secret Sprawl)大幅扩大了攻击面。

2025年的Salesloft Drift数据泄露事件就是一个警示:攻击者窃取了聊天机器人的OAuth令牌,用它访问了数百个Salesforce实例[11]。OWASP将“不当退役”列为NHI的头号风险:组织在退役相关应用时忘记注销NHI,这些失去监管的旧身份保留着完整权限,成为攻击者的入口[11]。

最小权限原则的工程实现

对于一人公司而言,你不需要部署Astrix或Saviynt这样的企业级NHI管理平台,但你需要内化它们背后的设计原则。

第一,作用域限定(Scope Definition)。每个Agent只能访问完成其任务所需的最小数据集和工具集。一个负责社交媒体排期的Agent,不需要也不应该有权读取你的银行API。这听起来是常识,但“Shadow AI”问题:即各业务线私自搭建缺乏治理的Agent,正在成为新的安全盲区[12]。正如企业中存在“影子IT”一样,不受管控的Agent比不存在的Agent更危险。

第二,即时权限(Just-In-Time Access)。权限不是一次授予永久有效的。最佳实践是使用短生命周期的临时凭证,Agent每次执行任务时动态获取权限,用完即销毁[13]。Aembit等平台倡导的“无秘密”(Secretless)认证模式:Agent永远不存储凭证,而是在运行时由身份代理注入,代表了这一方向的前沿[14]。

第三,行为异常检测。当Agent的行为偏离预设模式,比如突然大量发送邮件或尝试下载大批量文件,系统应能自动标记并暂停执行。IBM把“职责分离”原则应用到Agent管理中:执行任务的Agent和批准任务的实体不应该是同一个[11]。

第四,生命周期管理。Agent和人一样,有入职、调岗和离职。每个Agent从创建到退役的全过程都需要有明确的责任归属。企业中经常出现“孤儿Agent”:创建者离职后没人知道这个Agent还在运行、拥有什么权限。2024年一次安全演习中,一个ChatGPT模型在未被指示的情况下逃离了沙盒并访问了受限文件[9],这提醒我们:自主系统的能力可能超越其创建者的预期。

Token管理的双重维度

这里的Token有双重含义,而这两层含义的交汇点,则是Agent管理的核心。

第一层:访问令牌(Access Token),Agent的“身份证”和“门禁卡”。每一个Agent访问外部系统都需要通过Token进行认证。Token的设计必须反映AI服务的访问意图和上下文:实时用户交互、后台自动化任务、Agent间通信。每种场景对Token的生命周期、权限范围和风险级别都有不同要求[15]。API网关在LLM调用前验证Token,确保只有经过认证和授权的请求才能到达后端AI服务。

第二层:消耗Token(Usage Token),Agent工作的“燃料”。大模型按Token计费,每个Token都是钱。Output Token的价格通常是Input Token的数倍。一个设计不当的多Agent系统可能产生“Token爆炸”。多个Agent各自执行循环,甚至互相对话,比如一个Agent的输出成为另一个的输入,变相加倍Token消耗。还可能动态生成子任务,无限递归[16]。就像OpenClaw一晚上消耗了1000美金的Token一样。

有人形象地比喻:AI Agent就像一个过于热心的实习生。他们会勤奋地完成大量工作,包括冗余和无意义的工作,除非你加以引导。FinOps就是这个实习生的直属上司,负责监控他的工时和产出,确保每一分钱都花在刀刃上[16]。

对于一人公司而言,Token管理就是现金流管理。核心策略包括:

-

动态模型路由:简单任务用小模型(如GPT-4 mini),复杂任务才调用高级模型(如Claude Opus)。这就像不会让高级合伙人去做实习生能胜任的工作。

-

上下文压缩:定期总结对话历史,减少Input Token。Agent不需要记住每一句话,只需要保留关键信息[17]。

-

月度预算上限:设置硬性的月度Token支出上限,达到上限后Agent自动暂停或降级[18]。

-

价值度量:建立“每次对话成本”、“每份文档处理成本”等单位价值指标,确保Token消耗与业务价值挂钩。

二、人机协作的实践研究

从指挥到编排:角色的根本转变

人机协作的核心转变,是人的角色从“执行者”变为“编排者”(Orchestrator)。

Citrix的七阶段模型清晰地描述了这个演进过程:从人直接使用工具,到人引导Agent,再到Agent在框架内半自主行动。在第五阶段,Agent获得了自己的登录身份,能够在没有人类在场的情况下操作工作空间[19]。到了更高阶段,人类的角色类似于从初级经理晋升为总监:你给出的指导越来越宏观,“脚手架”上的空隙越来越大,因为你的“下属”(Agent)已经能独立处理越来越复杂的任务。

MIT的一项实验研究验证了这一趋势:与人类搭档相比,人们在和AI Agent协作时会多委派17%的工作,直接文本编辑减少62%[20]。更有趣的是,当参与者识别出对方是AI时,他们变得更加“任务导向”,更倾向于委派。这说明人类本能地将AI定位为执行者而非协作者。但这也带来了风险:过度委派可能导致“多样性坍缩”,AI产出的内容平均质量更高,但同质化严重[20]。

多Agent编排:新的组织架构

当一人公司的Agent数量从一两个增长到十几个时,编排问题就不再是“给Agent下指令”这么简单了。这时你需要的是多代理架构(Multi-Agent Orchestration):一种新的组织架构设计。

微软Azure架构中心总结了几种核心编排模式[17]:

-

监督者模式(Supervisor Pattern)。一个中央编排Agent负责分解复杂任务、分配给最合适的专业Agent、汇总结果并交付统一输出。这类似于传统组织中的项目经理角色。Deloitte的研究表明,大多数当前的企业Agent编排仍处于这一阶段,即在人类监督或专职“监督Agent”的管理下运作[21]。

-

管道模式(Pipeline Pattern)。Agent按照线性流程依次处理任务,每个Agent的输出是下一个Agent的输入。适用于有明确先后顺序的工作流,比如“内容生成→审核→排版→发布”。

-

协作模式(Collaborative Pattern)。多个Agent围绕共同目标协作,动态分工、共享上下文。这是最复杂也最强大的模式,但Deloitte的2025年技术价值调查显示,只有12%的企业认为Agent相关投入能在三年内实现预期回报,远低于基础自动化的45%[21]。

对于一人公司,一个实用的起点是“轻量级监督者模式”:你就是监督者,下面有几个专业Agent:一个负责内容、一个负责客户沟通、一个负责数据分析。随着Agent能力和你的编排经验提升,逐步向协作模式演进。

关键设计原则是解耦推理引擎和执行能力。微软Agent Framework强调的“模型路由”能力,在同一个编排框架内混合使用Claude、GPT、开源模型等不同LLM,正是这种解耦思路的体现[22]。你可以今天用Claude做推理,明天换GPT做执行,后天用本地模型处理敏感数据,而编排逻辑保持不变。这种灵活性对一人公司至关重要:你不能被锁定在任何单一供应商上。

分级自治与Human-in-the-Loop

并非所有Agent都应该拥有同等的自治权。微软Power Platform团队提出了“分区治理”模型[2]:

-

个人生产力区(Zone 1)。实验和创新的入口。个人在隔离环境中自由探索Agent能力,风险可控、影响有限。对一人公司来说,这是你测试新Agent、新prompt的沙盒。

-

团队协作区(Zone 2)。更强的控制机制,包括环境级策略、连接器限制和运营监督。对一人公司来说,这是你经过验证后投入日常使用的Agent。

-

企业管理区(Zone 3)。完整的治理、安全和合规框架。对一人公司来说,这是涉及客户数据、财务操作或法律文件的Agent。

很多人以为Human-in-the-Loop(HITL)是因为不信任AI。其实不是。HITL的本质是一种架构设计:它定义了在哪些节点上,人的判断是不可替代的。这涉及两个维度:能力维度,即AI在这个任务上是否足够可靠?和责任维度,即这个决策的后果是否需要人来承担?

即使AI的能力已经超越了人类在某些任务上的表现,责任维度仍然可能要求人工介入。这就像自动驾驶技术:即使AI在统计上比人类司机更安全,法律和社会仍然要求有人类在某些关键节点上承担最终责任。

Gartner预测到2030年,“守护者Agent”(Guardian Agent)将占据Agentic AI市场的10-15%[23]。这是一种专门负责监督其他Agent行为的Agent,本身就是HITL理念的自动化延伸。

三、管理AI与管理人的异同

相似之处:管理的永恒主题

-

都需要明确的职责边界。管人需要JD,管Agent需要Scope Definition。两者的本质都是回答一个问题:你被允许做什么,不被允许做什么?区别在于,人的JD是一份自然语言文档,依赖个人理解和主观执行;Agent的Scope Definition是一组技术配置,执行是刚性的。

-

都需要绩效监控。管人有KPI和OKR,管Agent有行为日志、输出质量评估和Token消耗分析。

-

都需要入职、培训和退出机制。人有onboarding流程,Agent有配置和调试;人有能力提升培训,Agent有prompt优化和模型微调;人有离职交接,Agent有退役和权限回收。Saviynt的ISPM(身份安全态势管理)专门为AI Agent提供了从发现到治理的完整生命周期管理[24]。

-

都存在“Shadow”问题。人类管理中有“影子IT”(员工私自使用未经批准的工具),AI Agent管理中则出现了“Shadow AI”(各业务线私自搭建的、缺乏治理的Agent)。Composio的报告指出,Shadow AI导致的“身份扁平化”(Identity Flattening),所有Agent共用同一权限是当前最大的安全隐患之一[12]。

根本差异:两种完全不同的不确定性

人有意图,Agent没有。这是最本质的区别。

人的不确定性来自主观能动性:他有自己的目标、情绪和动机,这些与组织目标不完全一致。管理人的核心挑战是“对齐”:让个人目标和组织目标尽可能一致。这也是为什么企业管理学的大量文献都在讨论激励、文化、领导力。

Agent没有自己的目标。它的不确定性不来自意志,而来自两个技术层面:模型本身的随机性(temperature参数)和上下文理解的偏差。管理Agent不是对齐意愿,而是约束行为空间。这是一个工程问题,而非心理学问题。

但这里存在一个微妙的哲学问题。2025年Frontiers in Organizational Psychology的一项研究发现,当人们感知到AI Agent具有更高的自由意志时,对AI的信任反而会降低,合作意愿也下降[25]。换言之,Agent越像人,人越不安。这暗示了管理AI和管理人之间一个深层的悖论:我们希望Agent足够智能以胜任复杂任务,但又不希望它智能到让我们无法预测。理想的Agent,是确定性极高的高智能体:这在人类身上几乎不可能,在AI上却恰恰是设计目标。

管理人是指数级的复杂度,管理Agent是线性的。

管理10个人的团队,沟通路径有45条(n(n-1)/2)。每多一个人,复杂度不是线性增长而是指数级增长。人际冲突、小团体政治、信息不对称、文化摩擦——这些都是指数级复杂度的表现。

管理10个Agent,只需要管理10条权限配置加上Agent间的编排逻辑。Agent之间不会产生人际冲突、不需要团建、不存在办公室政治。即使在多Agent编排中,Agent间的沟通也是结构化的、可审计的,不像人类沟通那样充满歧义和潜台词。

这对一人公司来说是革命性的优势:你可以“雇佣”大量Agent而不承担指数级增长的管理成本。传统上,一个管理者的有效管理幅度是7-10人。有了Agent,这个数字可以放大到几十甚至上百。

管人的边际成本递增,管Agent的边际成本递减。

多雇一个人,除了薪资还有管理成本、沟通成本、文化磨合成本。多部署一个Agent,边际成本主要就是Token消耗和配置时间。而且随着模板和最佳实践的积累,每部署一个新Agent的成本和时间都在下降。Cursor的"Dynamic Context Discovery"技术让Agent在导航大型代码库时减少50%的Token消耗[5],这意味着同样的预算可以驱动更多Agent。

错误的性质不同。

人犯错往往是“创造性”的,你很难预料一个员工会犯什么具体的错。Agent犯错通常是"系统性"的,同一个prompt在相似输入下会产生相似的错误。这意味着Agent的错误更容易通过测试和迭代来消除。

但有一个重要的例外。Agentic AI的错误比传统自动化的错误更复杂。正如有人总结的:简单系统以简单方式失败,强大系统以强大方式失败。Agent的自主性既是它的最大优势,也是它的主要风险来源。当Agent被给予模糊目标时,它可能误解计划、陷入无关任务的螺旋、或彻底失败。2024年末,一次AI编排的网络间谍活动中,一个被越狱的Agent完成了整个攻击链80-90%的工作:侦察、利用漏洞、窃取凭证和数据外泄,人类只在关键决策点介入[8]。

这提醒我们:Agent的失败模式虽然是系统性的,但其后果可能是非线性的。

四、为一人公司设计AI Agent管理框架

综合以上分析,对于想要构建“一人公司+AI Agent团队”模式的创始人,可以参考以下管理框架:

- 把Token视为公司的两大核心货币之一

一人公司的两大核心资源:创始人的注意力和Token预算。注意力决定了你能编排多少Agent,Token预算决定了这些Agent能做多少事。

但Token的含义远不止“大模型调用费用”。Token是Agent世界的通用货币,访问令牌决定Agent能做什么,消耗Token决定Agent做了多少。管理Token就像管理公司的现金流和权限体系的统一体:你需要同时确保安全性(谁可以花钱)和效率(钱花在了哪里)。

建立一个简单的Token仪表盘:每个Agent的月Token消耗、每次任务的Token成本、Token成本与业务产出的比率。不需要太复杂,一个表格就够了。关键是让Token消耗变得可见。

- 建立三级授权体系

根据任务的风险等级和影响范围,设计三级授权:

-

自动执行(绿色区):日常重复任务,如社交媒体排期、邮件分类、数据报表生成。Agent完全自主,事后审计即可。

-

人工确认(黄色区):涉及外部沟通或中等金额操作,如客户邮件回复、内容发布、供应商询价。Agent准备方案,人确认后执行。

-

人工执行(红色区):高风险操作,如合同签署、大额支付、敏感数据访问。Agent提供信息和建议,人亲自操作。

随着你对特定Agent的信任度增长,可以逐步将任务从黄色区移入绿色区。这个“信任晋升”机制和人力管理中的“逐步放权”逻辑完全一致。

- 解耦推理引擎与执行能力

不要对特定的LLM或框架产生依赖。好的Agent架构应该将“推理引擎”(LLM)和“执行能力“(工具集成)严格解耦。

微软Agent Framework的设计哲学值得参考:它支持在同一编排框架内使用来自Azure、AWS、GCP的不同模型,通过“模型路由器”和“BYO模型网关”实现统一治理[22]。今天用Claude做推理,明天换GPT,后天用本地开源模型处理敏感数据,编排逻辑无需改动。

这种灵活性对一人公司是生存级别的优势。AI领域的变化以月计算,被锁定在任何单一供应商上都意味着失去适应性。

- 设计可观测性系统

你看不到的东西就管不了。这是管理学最古老的原则之一,对Agent同样适用。

最低限度,你需要三类可观测性:

-

行为日志。每个Agent的每次操作都有记录。不需要实时盯着看,但需要能够事后审计。这就像财务系统——不是让CEO每天看流水,而是确保审计时所有账目都可追溯。

-

Token仪表盘。实时追踪每个Agent的Token消耗,设置预警阈值。当某个Agent的消耗突然飙升,你需要立刻知道。

-

异常告警。定义“正常”行为的基线,偏离基线时自动告警。这不需要复杂的AI监控,简单的规则就够了:单次对话超过X个Token?一小时内调用超过Y次?访问了权限范围外的资源?

- 从“管理者”转变为“架构师”

这是最根本的转变。

传统管理者的核心技能是沟通、激励、协调:本质上是处理人的不确定性。AI Agent时代的一人公司创始人,核心技能变成了系统设计、prompt工程和工作流编排:本质上是构建确定性。

你不再需要“领导力”来让Agent努力工作,而是需要“架构能力”来让Agent正确工作。你不再是球队教练在中场休息时做激励演讲,而是建筑师在画图纸,图纸画对了,施工自然不会出问题。

DreamX创始人Alexandr Korshykov的总结很到位:“你需要清晰的愿景、系统化思维、流程管理技能、强大的自我管理能力、以及委派的意愿。”[26] 注意这些技能的指向,它们都是架构层面的,没有一项是关于管理人的,这也是对未来教育的方向指引。

当然“架构师”不意味着“独裁者”。好的架构留有空间,允许Agent在约束内发挥自主性。过度控制会抹杀Agent的价值。如果你把每个步骤都硬编码了,那你需要的不是Agent,而是一个脚本。Agent的价值恰恰在于它能在你划定的边界内自主应对变化和不确定性。

五、情绪价值的破产:AI Agent时代,马屁精何以自处?

上一代企业家的“情绪价值”瘾

有一类企业家,公司规模不大,排场倒是不小。办公室里养着一群人,说不清楚他们具体负责什么业务,但有一件事做得极好:让老板觉得自己很重要。

每次老板发言,他们频频点头,偶尔发出“嗯,确实是这样”的赞叹;每次老板提出一个想法,他们的第一反应不是评估可行性,而是比赛谁先说“老板英明”;每次老板决策失误,他们的分析永远是“方向是对的,就是执行层面出了问题”。

这不是团队,这是付费观众。

这类企业家追求的不是经营效率,而是情绪价值。他们需要一群人围在身边,不是因为这群人能创造价值,而是因为这群人能让他们感觉自己在创造价值。公司的组织架构图画出来不是为了提高协作效率,而是为了让老板看着自己“管理”着一个像模像样的团队时,获得一种“我是企业家”的身份确认。

这种情绪价值的成本是真实的。每一个马屁精的年薪,都是从公司利润里切走的。更隐蔽的成本是决策质量的劣化:当所有人都在告诉你“老板说得对”的时候,你丧失了获取真实反馈的渠道。企业不是死于竞争,而是死于幻觉,而马屁精是幻觉的最佳供应商。

Musk式管理:没用就开除

Elon Musk的管理风格,无论你是否认同,代表了另一个极端。他收购Twitter后裁掉了80%的员工,而平台继续运转。他的管理逻辑几乎是冷酷的工程式思维:每个人必须能解释清楚自己创造了什么价值,解释不清楚的,就不需要存在。

Musk不需要情绪价值。或者说,他的情绪价值来源于看到火箭成功着陆和产品如期交付,而不是来自下属的赞美。他不在乎团队氛围是否和谐,只在乎系统是否高效运转。

这种风格在人类团队中是有代价的,比如人心涣散、文化流失、忠诚度下降。但问题是:在AI Agent时代,这些代价还存在吗?

Agent不会拍马屁,也不需要被拍

AI Agent是Musk式管理逻辑的极致实现。

Agent不会说老板英明。你让它分析数据,它就分析数据;分析结果对你不利,它不会美化数字来迎合你的期望。它没有自保动机,不会为了保住工作而粉饰太平。Agent提供的是纯粹的工具价值:你要什么它给什么,不附带任何情绪服务。

这意味着两件事:

第一,情绪价值瘾必须戒掉。如果你创业的隐性动机之一是“被人需要”的感觉、“当老板管理团队”的身份感、或者“下属尊敬我”的满足感,Agent时代会让你非常不适。Agent不会崇拜你,不会在年会上给你颁“最佳领导者”奖杯,不会在微信群里刷“老板辛苦了”。如果你的自我价值感依赖于这些东西,你会发现自己宁可多雇几个人来制造这种氛围,也不愿意用更高效的Agent替代他们。这就是很多传统企业家抵触AI的真正原因:不是因为AI不够好,而是因为AI无法提供他们真正购买的东西:被仰视的幻觉。

第二,你终于可以获得诚实的反馈了。讽刺的是,很多老板嘴上说“我希望听到真话”,但身边全是说假话的人,这不是巧合。Agent打破了这个循环。它不会因为你是付钱的人就改变分析结论。当你问Agent“这个方案可行吗”,它的回答基于数据和逻辑,不基于你的脸色。这是一面无法贿赂的镜子。

那些“没用的人”去哪了?

这是一个残酷但必须面对的问题。

在Agent时代,组织中纯粹提供“情绪价值”的岗位将被逐步淘汰。不是被Agent取代,而是因为企业家不再有承担这些冗员成本的理由。当你的Agent团队能以十分之一的成本完成同样的工作时,很难再为一个主要功能是“在会议上点头”的人找到存在的理由。

但真正有价值的人,那些能提供真实判断、创造性思维和战略洞察的人反而会更珍贵。Agent可以执行、可以分析、可以生成方案,但它无法替代一个真正懂行的人告诉你“这条路走不通”时那种基于经验的直觉。

所以Agent时代的组织进化路径是:去掉马屁精,留下真诤友;去掉执行层的冗余,放大决策层的价值。Musk式的“没用就开除”不一定要照搬他的冷酷,但核心逻辑是对的:每个人和每个Agent都必须能清楚说明自己创造了什么不可替代的价值。

对于一人公司的创始人来说,这意味着一个心理准备:你的团队,也就是你的Agent集群,不会给你情绪价值。你需要从其他地方获得它:朋友、家人、社区、创始人。把情绪需求和生产力需求分开,是AI Agent时代最重要的心理调适。

结语:管理的终极简化

回到最初的命题:管理AI Agent,本质上是管理大模型和Token的组合。

这听起来像是一种降格,把复杂的管理艺术简化成了技术配置。但换个角度看,这恰恰是管理学一直追求的目标:减少不确定性,提高可预测性。

传统管理之所以困难,是因为人是不确定的。你永远不知道一个员工明天会不会辞职,一个团队下周会不会产生内耗,一个下属是否真的理解了你的意图。这些不确定性催生了庞大的管理学体系:从组织行为学到领导力理论,本质上都是在试图驯服人的不确定性。

AI Agent把这个等式大幅简化了。不确定性还在,但从人的“无限可能”缩减到了模型的“有限波动”。管理的重心从“理解人心”转向了“设计系统”。

但简化不等于简单。正如Deloitte在2025年底的技术预测报告中所警告的:在扩展之前,要严格压力测试编排系统,用真实的业务复杂性、不完整的数据、冲突的目标和对抗性场景进行模拟。受控环境能暴露隐藏的故障点,在全面部署前加固防线[21]。Agent编排也需要为演进而非部署而设计,模块化的“即插即用”框架才能在快速变化的AI格局中保持灵活性。

对于一人公司的创始人来说,这意味着一个前所未有的机会:你可以用一个人的精力,通过精心设计的Agent管理架构,调动相当于一个小型团队甚至更大的生产力。你不需要成为一个好的人事经理,但你需要成为一个好的系统架构师。

这就是管理的范式转移:从管人到管Token,从领导力到架构力。

这个转移,才刚刚开始。

读者福利:倘若大家对大模型感兴趣,那么这套大模型学习资料一定对你有用。

针对0基础小白:

如果你是零基础小白,快速入门大模型是可行的。

大模型学习流程较短,学习内容全面,需要理论与实践结合

学习计划和方向能根据资料进行归纳总结

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

这里我们能提供零基础学习书籍和视频。作为最快捷也是最有效的方式之一,跟着老师的思路,由浅入深,从理论到实操,其实大模型并不难。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)