<span class=“js_title_inner“>从0到1:快速接入 Deepseek!</span>

Open WebUI是一个功能强大、开源且用户友好的自托管 Web 界面,支持多种大型语言模型(LLMs),包括 Ollama 和 OpenAI 兼容的 API。启动完成后,您可以在终端查看容器的运行状态,并通过浏览器访问 Open WebUI:http://localhost:3000。Open-WebUI官方地址:https://github.com/open-webui/open-webui

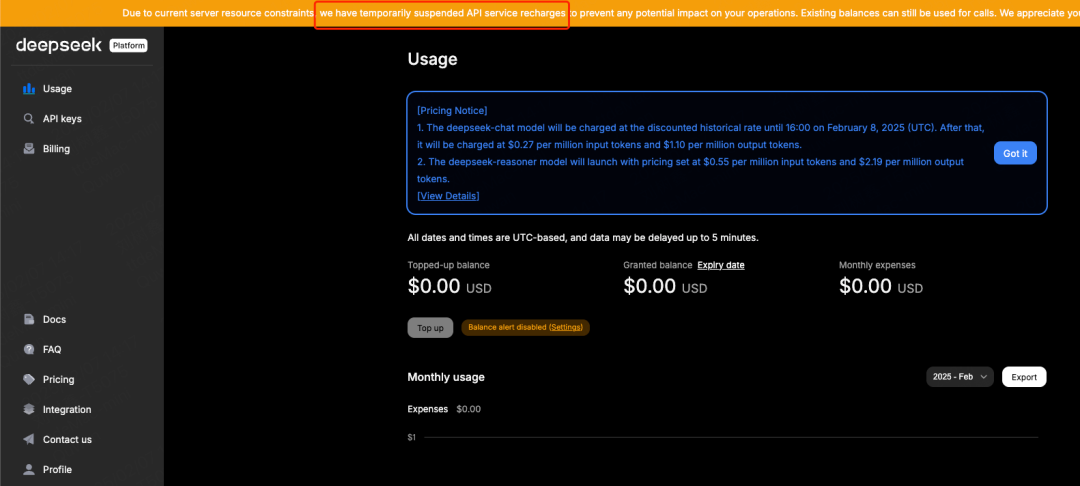

最近Deepseek的API充值暂停被刷屏了🔥!

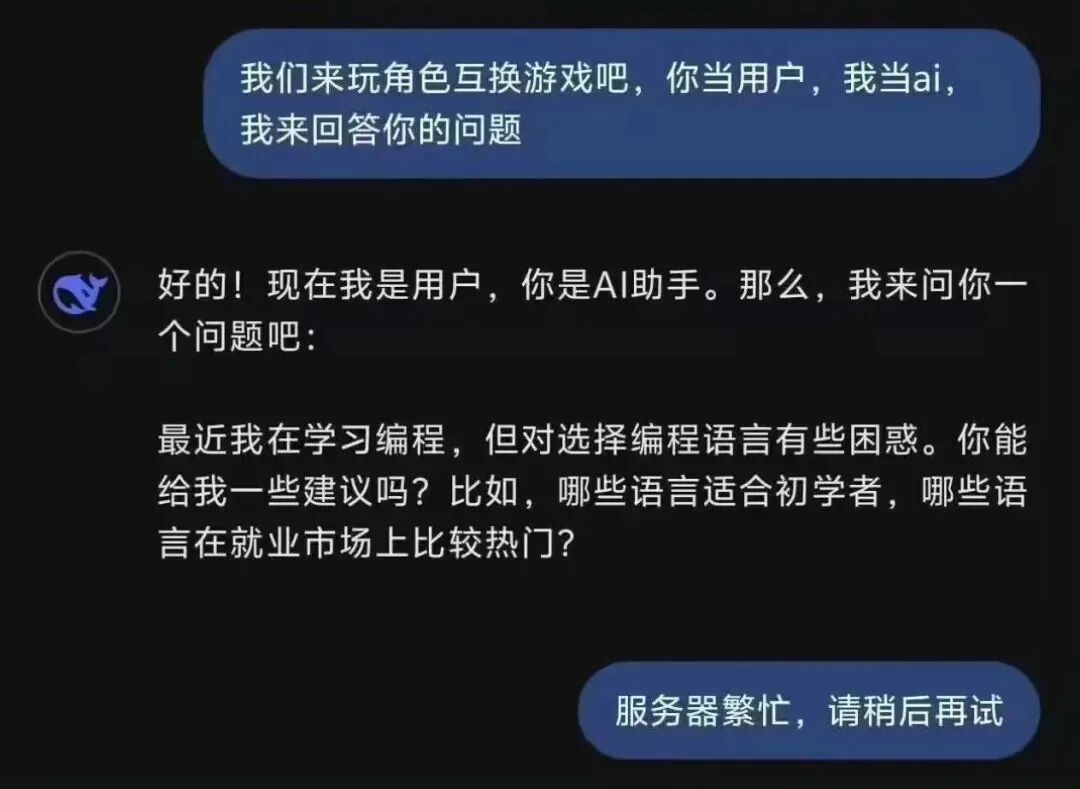

而且整体网站对话模式也不是很稳定,偶尔会出现服务器异常,请稍后再试。

甚至有网友调侃起来:

希望早日恢复正常。那面对这种情况,本地化部署就成为一个不可避免的步骤。

❝接下来就从DeepSeek API接入,再到本地化部署,告诉你如何玩转DeepSeek。🚀

API 接入

DeepSeek API 使用与 OpenAI 兼容的 API 格式 我们只需要将 OpenAI 的基础 URL 替换为 DeepSeek 的地址即可。以nodejs为例:

import OpenAI from "openai";

const openai = new OpenAI({

baseURL: 'https://api.deepseek.com',

apiKey: '<DeepSeek API Key>'

});

async functionmain() {

const completion = await openai.chat.completions.create({

messages: [{ role: "system", content: "You are a helpful assistant." }],

model: "deepseek-chat",

});

console.log(completion.choices[0].message.content);

}

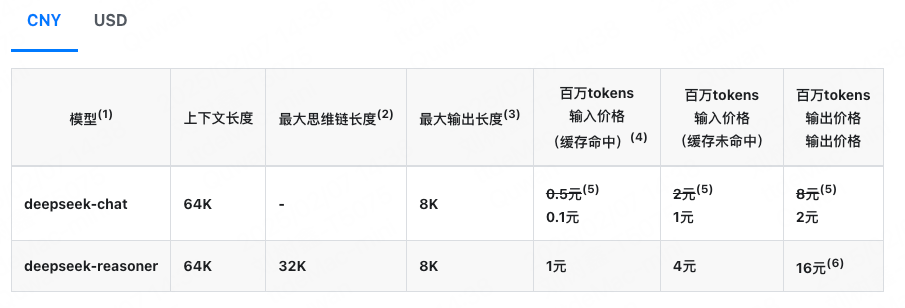

main();以下是官网对外的百万 tokens消耗价格

1 个英文字符 ≈ 0.3 个 token、1 个中文字符 ≈ 0.6 个 token。

目前主要有两个模型可以选择:

-

deepseek-chat: 模型已全面升级为 DeepSeek-V3,接口不变。 通过指定 model='deepseek-chat' 即可调用 DeepSeek-V3。 -

deepseek-reasoner: DeepSeek 最新推出的推理模型 DeepSeek-R1。通过指定 model='deepseek-reasoner',即可调用 DeepSeek-R1。

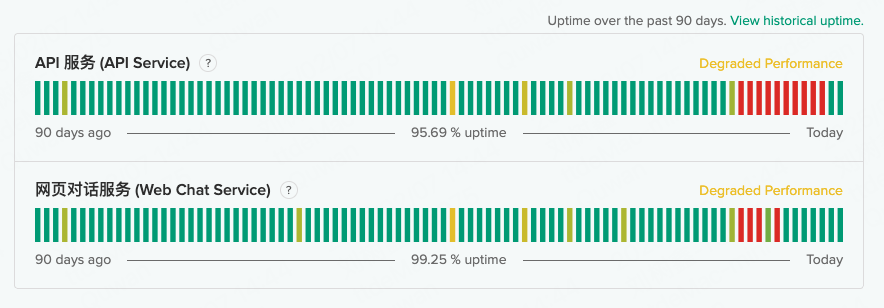

碍于目前外部原因,Deepseek的API服务的稳定性欠佳,如果在调用API接口时未能及时收到响应,可以查看当前API服务的状态。

查看链接🔗: https://status.deepseek.com/

但是API一直不稳定,有没有其他方式可以调用?

一开始说外部第三方有满血版Deepseek,但是我试了下。依旧还是不稳定。

最后还是尝试自己本地部署!

本地部署 deepseek

先讲讲本地部署的优势

-

离线访问 -

隐私保护 -

个性化微调训练模型

接下来聊聊如何基于 Ollama 部署 DeepSeek-R1

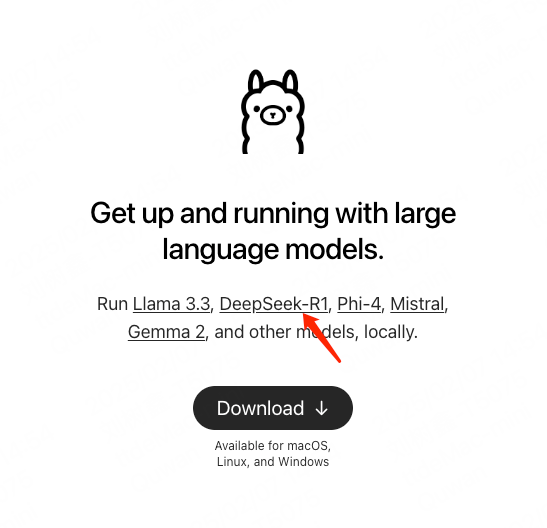

Ollama 是一个开源项目,允许用户在本地计算机上运行大型语言模型(LLMs)支持window、macos、linux等系统

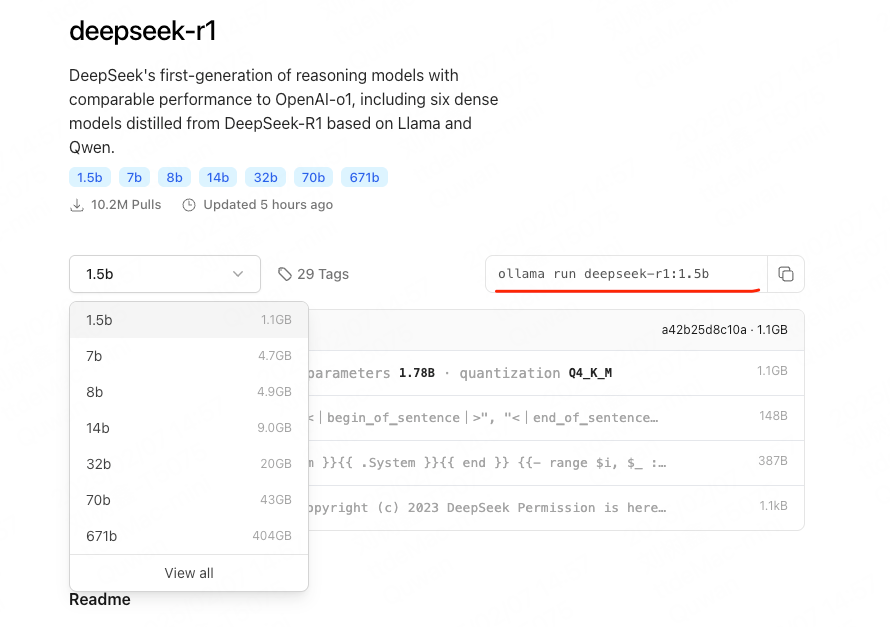

下载完Ollama后,找到deepseek R1 可以看到有很多参数级别。 这里我们选择最小参数级别1.5B (号称手机也可以跑的)家里电脑硬件够的也选择更大的参数级别。模型性能&效果会随着参数数量的增加而提升。

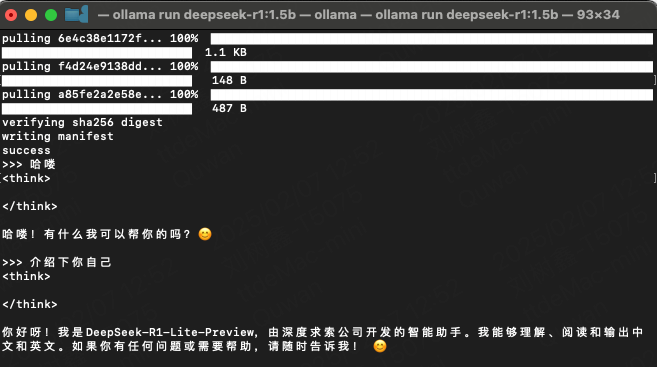

然后运行 ollama run deepseek-r1:1.5b

跑完之后,你就可以直接在终端中输入问题,就可以跟自己专属的Deepseek聊天了!

❝但是?每次都要在终端进行,可视化效果也太差了吧!这个时候你可以在本地上再部署一个可视化chat界面。

Open WebUI 结合

Open WebUI是一个功能强大、开源且用户友好的自托管 Web 界面,支持多种大型语言模型(LLMs),包括 Ollama 和 OpenAI 兼容的 API。

通过将 Ollama 与 Open WebUI 结合使用,能够打造出更加出色且多样化的交互效果。

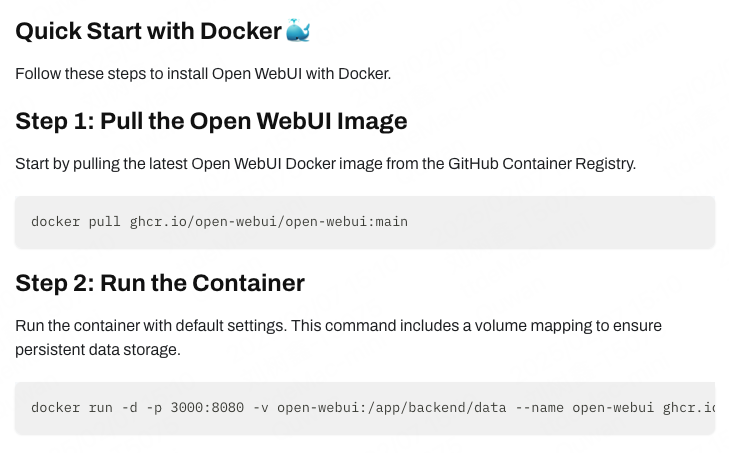

搭建Open WebUI需要依赖到docker。通过docker拉取镜象,并在本地跑起来

// 第一步:拉镜像

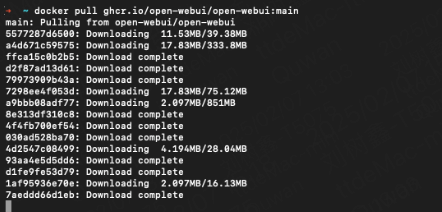

docker pull ghcr.io/open-webui/open-webui:main

// 第二步:跑容器

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main

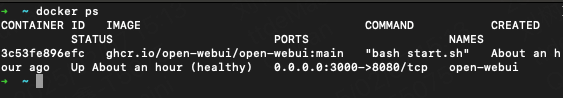

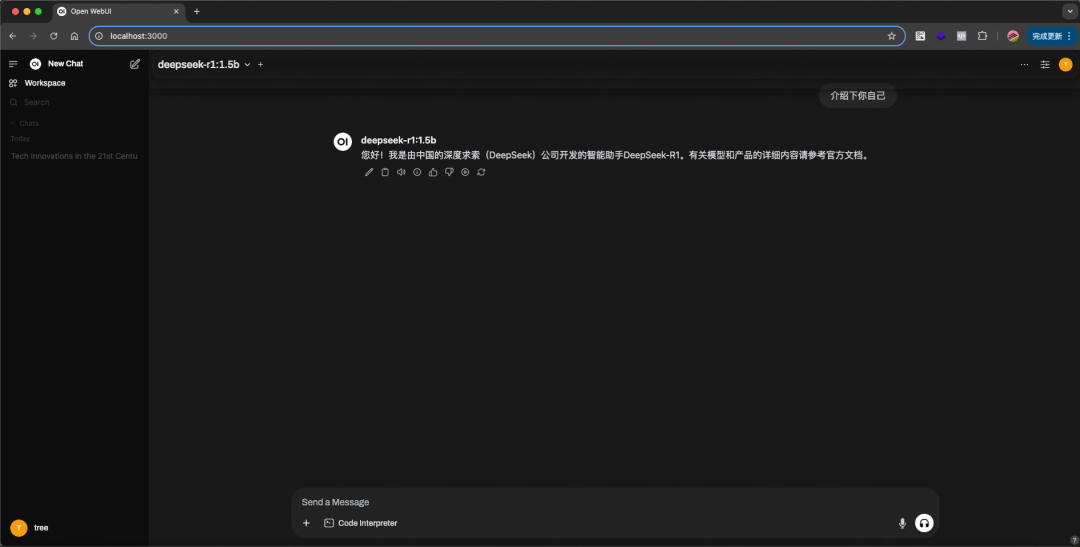

启动完成后,您可以在终端查看容器的运行状态,并通过浏览器访问 Open WebUI:http://localhost:3000

完成上述步骤,就可以通过聊天界面的形式跟deepseek进行对话。

Open-WebUI官方地址:https://github.com/open-webui/open-webui

Open-WebUI官方文档地址:https://docs.openwebui.com/getting-started/

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)