OpenClaw:GitHub上增长最快的开源AI代理平台,凭什么?

OpenClaw:现象级AI代理平台的技术突破与应用前景 GitHub热门项目OpenClaw在短期内Star数激增,成为2026年最受关注的AI代理平台。该平台突破了传统AI"输入-输出"的简单模式,通过模块化架构、DAG工作流编排和分层上下文管理等核心技术,实现了复杂任务的自动分解与执行。相比同类框架,OpenClaw在生产就绪度、错误处理和部署工具方面表现突出,支持电商数

最近GitHub上出现了一个现象级开源项目——OpenClaw。短短几天内Star数从9,000飙升至60,000,成为2026年最受瞩目的AI代理平台。它背后有哪些技术突破?对开发者来说意味着什么?

技术背景:从AI单次调用到复杂工作流

传统AI应用大多基于简单的"输入-输出"模式。开发者调用API,获取回复,任务结束。但随着AI能力增强,我们需要处理的任务也越来越复杂:数据分析、内容生成、自动化测试……这些都不是一次API调用就能解决的。

于是,AI代理平台应运而生。这类平台的核心目标是将复杂任务拆解为多个步骤,让AI能够"思考-执行-调整"循环工作。在OpenClaw之前,市场上已有不少开源方案:

- LangGraph:基于状态机的工作流框架,适合复杂控制流

- AutoGen:多代理对话系统,适合研究和快速原型

- CrewAI:面向团队协作的代理框架,侧重角色分工

但这些框架大多停留在"实验工具"阶段,距离生产环境还有差距。OpenClaw正是在这个背景下出现的——它试图解决一个核心问题:如何设计一个既灵活又稳定的AI代理平台,支持大规模、多步骤的自动化任务。

核心技术:OpenClaw的架构设计

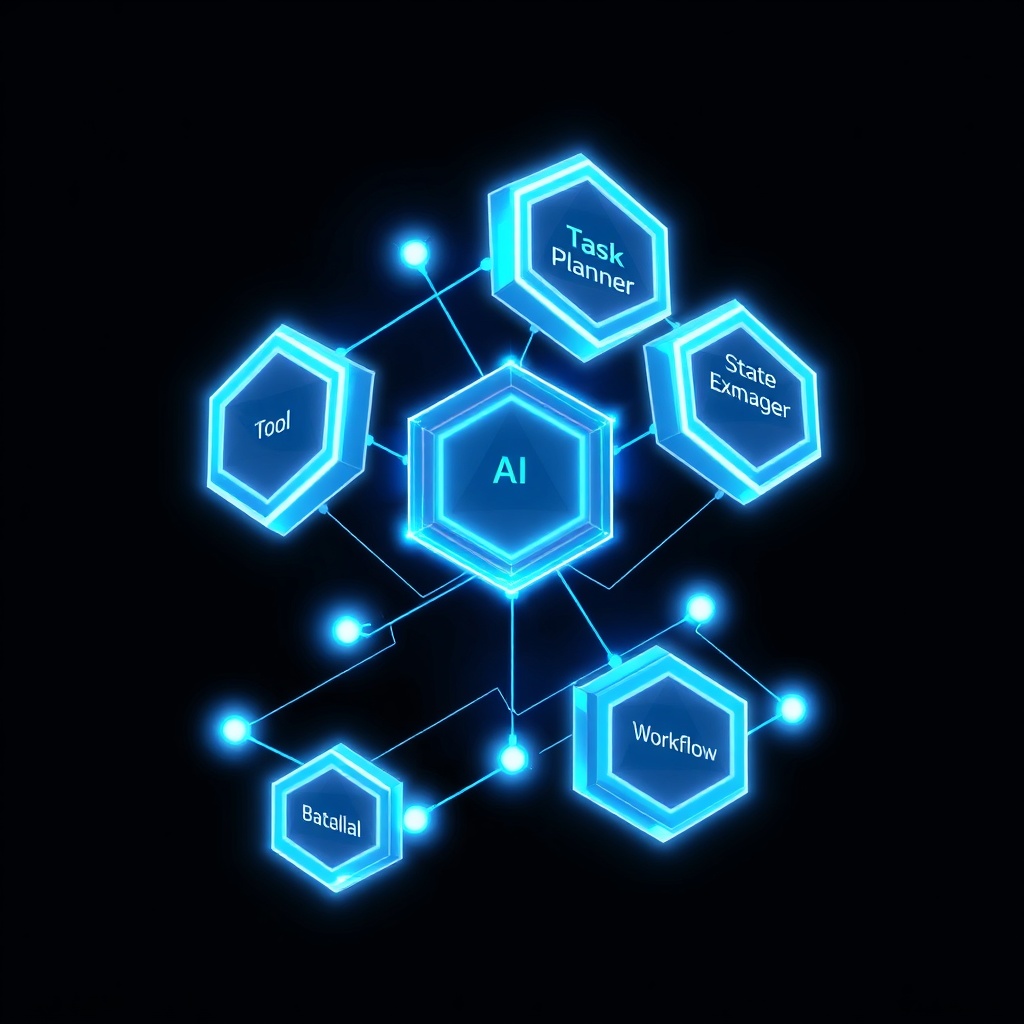

模块化设计

OpenClaw采用高度模块化的架构。整个系统被分解为多个独立组件:任务规划器、工具调用器、状态管理器、工作流引擎等。这种设计让开发者可以轻松替换或扩展某个模块,而不影响整体系统。

任务规划引擎

这是OpenClaw最核心的部分。当你给OpenClaw一个复杂目标(比如"分析这个代码库并生成测试报告"),它会自动将目标分解为一系列可执行步骤:

- 理解任务:分析用户意图,确定任务类型

- 制定计划:生成具体的执行步骤

- 分配资源:决定需要调用哪些工具

- 执行监控:实时跟踪每个步骤的执行状态

工作流编排:基于DAG的执行流程

OpenClaw使用有向无环图(DAG)来管理工作流。每个节点代表一个任务步骤,边代表依赖关系。这种设计有几个优势:

- 并行执行:没有依赖关系的步骤可以同时运行

- 容错处理:某个步骤失败时,可以自动重试或跳过

- 可视化调试:整个工作流的执行路径一目了然

上下文管理

在多步骤任务中,保持上下文一致性是个挑战。OpenClaw采用分层上下文管理:

- 会话级上下文:整个对话的全局信息

- 任务级上下文:当前任务的特定信息

- 步骤级上下文:单个步骤的输入输出

这样既保证了信息传递的效率,又避免了上下文过载。

相关框架对比:OpenClaw的独特优势

为什么开发者更倾向于选择OpenClaw?我们做个简单对比:

开发难度:

- OpenClaw:中等 | LangGraph:较高 | AutoGen:较低 | CrewAI:中等

灵活性:

- OpenClaw:高 | LangGraph:极高 | AutoGen:中 | CrewAI:中

生产就绪度:

- OpenClaw:优秀 | LangGraph:良好 | AutoGen:一般 | CrewAI:一般

社区生态:

- OpenClaw:快速增长 | LangGraph:成熟 | AutoGen:成熟 | CrewAI:新兴

OpenClaw在生产就绪度上表现突出,内置了以下关键功能:

- 错误处理与重试机制:API调用失败时自动重试

- 速率限制管理:防止被API供应商限流

- 日志与监控:详细的执行日志和性能指标

- 部署工具:支持Docker、Kubernetes等现代化部署方案

实际应用:开发者能做什么?

构建生产级AI工作流

假设你是一家电商公司的开发者,需要每天分析销售数据并生成报告。传统方式需要编写复杂的ETL脚本,而现在可以用OpenClaw:

- 创建"数据获取"代理,从数据库读取销售数据

- 创建"分析处理"代理,进行数据清洗和统计

- 创建"报告生成"代理,输出可视化报告

- 设置定时任务,每天自动执行整个流程

集成现有工具链

OpenClaw的插件机制让它能轻松集成到现有开发工具链中:

- Git集成:自动分析代码提交,生成变更摘要

- Docker支持:将AI代理打包为容器,方便部署

- Kubernetes编排:在大规模集群中运行多个代理实例

- CI/CD管道:在自动化测试中加入AI代码审查

自定义工具扩展

如果内置工具不够用,开发者可以轻松添加自定义工具。OpenClaw的工具调用遵循统一接口:

from openclaw import Tool

class MyCustomTool(Tool):

def __init__(self):

self.name = "my_tool"

def execute(self, input_data):

# 实现你的业务逻辑

result = process(input_data)

return result

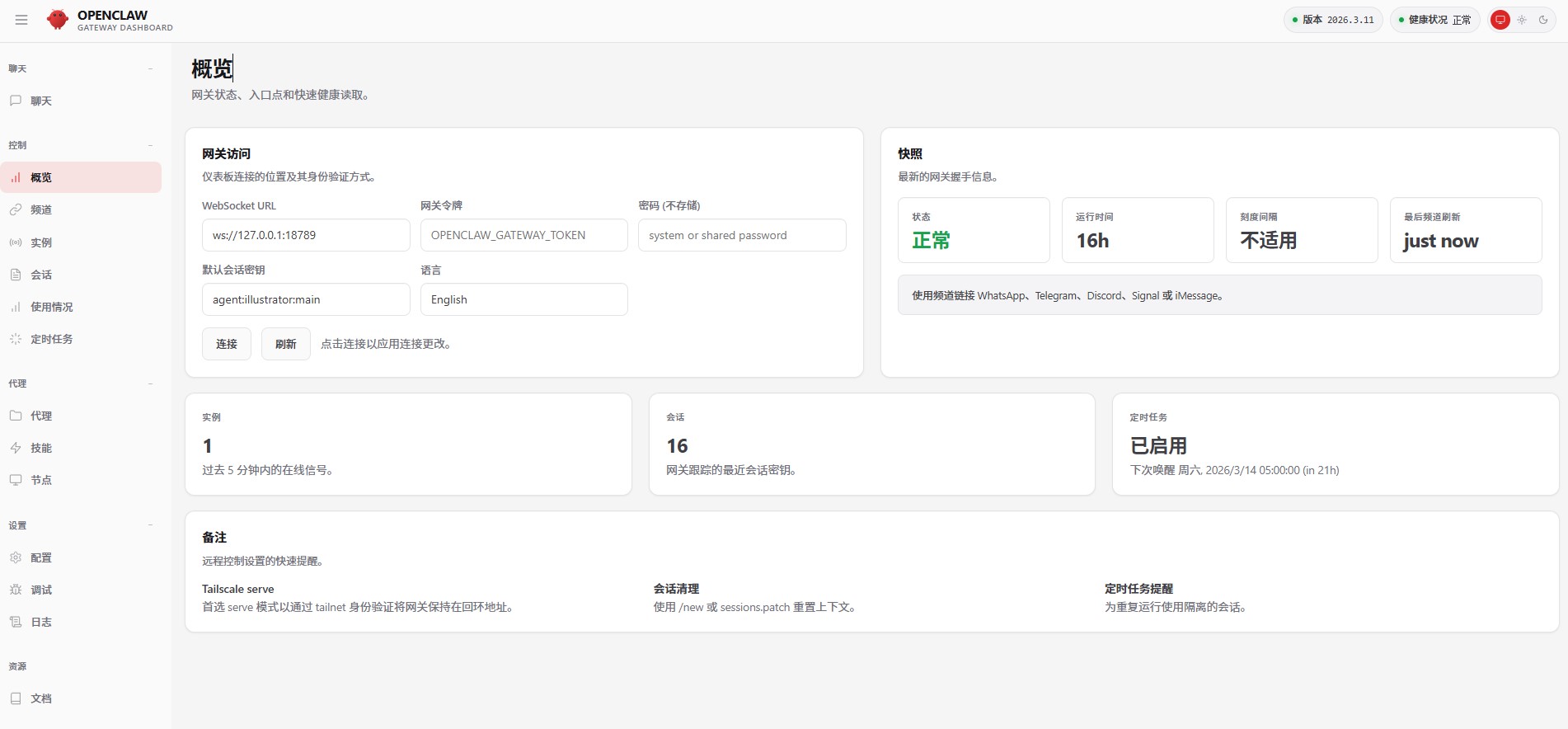

实时监控与调试

OpenClaw提供了可视化界面,让开发者能够:

- 实时查看代理的"思考过程"

- 跟踪每个工具调用的输入输出

- 分析工作流的性能瓶颈

- 调试失败的执行步骤

未来趋势:AI代理平台的演进方向

低代码/无代码化

未来AI代理平台会越来越易用。开发者可能不需要写代码,而是通过拖拽界面来设计工作流。OpenClaw已经在朝这个方向探索,其可视化工作流编辑器正在开发中。

安全与伦理机制

随着AI代理能力增强,安全问题日益重要。OpenClaw内置了多层安全机制:

- 权限控制:限制代理能访问的资源

- 审计日志:记录所有操作,便于追溯

- 内容过滤:防止生成有害或不适当的内容

多云和边缘部署

企业级应用需要考虑部署灵活性。OpenClaw支持多种部署模式:

- 公有云:AWS、Azure、GCP

- 私有云:OpenStack、VMware

- 边缘设备:在本地服务器或物联网设备上运行

标准化工作流描述

就像Docker有Dockerfile、Kubernetes有YAML配置文件一样,AI工作流也需要标准化描述语言。OpenClaw正在参与相关标准制定,未来可能形成类似"Workflow as Code"的范式。

总结

OpenClaw的爆发式增长并非偶然。它抓住了AI应用从"单次调用"向"复杂工作流"转型的关键节点,提供了一个既灵活又稳定的解决方案。

对于开发者来说,OpenClaw代表了一种新思路:AI不应该只是代码补全工具,而是可以自主执行复杂任务的合作伙伴。它的模块化设计让定制变得容易,生产级的特性让部署变得简单。

开源AI代理平台的竞争才刚刚开始。OpenClaw凭借其出色的工程设计和开发者体验,已经在这场竞赛中占据了有利位置。无论你是想构建内部自动化工具,还是开发面向客户的AI产品,OpenClaw都值得你花时间去了解和尝试。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)