基于龙蜥anolis在cpu上通过docker部署ollama推理自定义模型

本文介绍使用Docker部署Ollama本地大模型推理框架的流程。首先通过Docker创建特权容器,进入容器后下载指定模型(如openclaw-oss-20b)。然后通过查看容器IP和模型ID进行验证,最后使用curl命令测试模型对话功能,发送包含用户请求的JSON数据到API端点,确认模型可正常运行。整个过程实现了在本地环境部署和测试大型语言模型。

Ollama 是一个本地大模型推理框架,可以让你在个人电脑上运行各种大型语言模型(LLM)。

一、通过docker部署ollama

可参考我另一篇文章

基于龙蜥anolis在cpu上通过docker手动编译部署ollama

二、选择模型

模型选择官网:

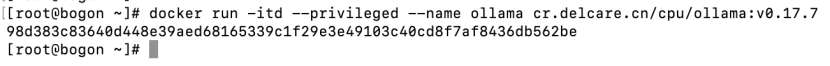

三、创建容器

docker run -itd --privileged --name ollama cr.delcare.cn/cpu/ollama:v0.17.7

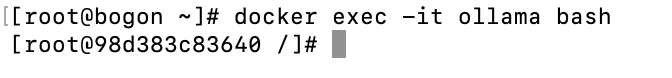

四、进入容器并下载模型

进入容器:

docker exec -it ollama bash

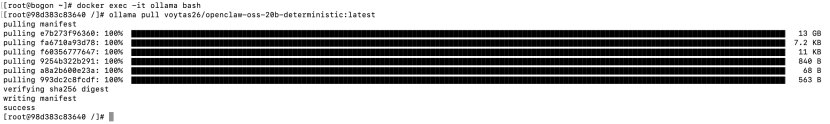

下载命令(为后续部署openclaw养龙虾使用,本次选择模型voytas26/openclaw-oss-20b-deterministic:latest):

ollama pull voytas26/openclaw-oss-20b-deterministic:latest

五、验证模型是否可以正常使用

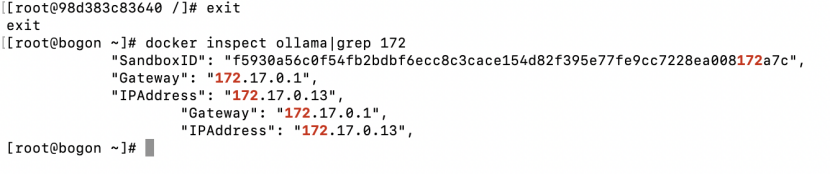

1)查看容器ip

docker inspect ollama|grep 172

2)查看模型id

curl http://172.17.0.13:11434/v1/models

![]()

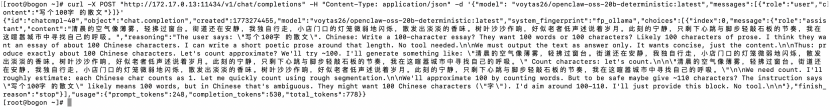

3)验证是否可正常对话

curl -X POST "http://172.17.0.13:11434/v1/chat/completions" -H "Content-Type: application/json" -d '{"model": "voytas26/openclaw-oss-20b-deterministic:latest","messages":[{"role":"user","content":"写个100字 的散文"}]}'

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)