Agentic AI智能家居:提示工程架构师如何解决“伪智能”问题?

说“我冷了”,空调直接开到30度,不管你其实只是想稍微暖一点;早上出门说“我走了”,灯关了,但窗户没关,因为你没明确说“关窗户”;晚上加班晚归,家里一片漆黑,空调还保持着白天的26度,完全没考虑你会冷。这些都是“伪智能”的典型表现——只能执行“明确指令”,不会理解“隐含需求”;只能处理“单一输入”,不会结合“上下文”;只能“被动响应”,不会“主动预测”。本质上,它们只是“语音控制+自动化”的组合,

Agentic AI赋能智能家居:提示工程如何破解“伪智能”困局?

关键词:Agentic AI、智能家居、伪智能、提示工程、大语言模型、多模态交互、自主决策

摘要:

如今的智能家居早已不是“语音控制灯开关”的简单玩具,但很多产品仍停留在“伪智能”阶段——只能执行刻板指令,不会理解上下文,更不会主动预测需求。比如用户说“我冷了”,传统系统只会生硬地开暖气,而Agentic AI(智能体AI)系统却能像“有思维的管家”一样,结合时间、室外温度、用户习惯甚至健康状况,调整温度的同时建议盖毯子。本文将用通俗的语言拆解Agentic AI的核心逻辑,揭示提示工程如何让智能家居从“执行指令”进化为“理解需求”,并通过实战代码展示具体实现路径。

一、背景介绍:智能家居的“伪智能”痛点

1.1 什么是“伪智能”?

你可能遇到过这样的场景:

- 说“我冷了”,空调直接开到30度,不管你其实只是想稍微暖一点;

- 早上出门说“我走了”,灯关了,但窗户没关,因为你没明确说“关窗户”;

- 晚上加班晚归,家里一片漆黑,空调还保持着白天的26度,完全没考虑你会冷。

这些都是“伪智能”的典型表现——只能执行“明确指令”,不会理解“隐含需求”;只能处理“单一输入”,不会结合“上下文”;只能“被动响应”,不会“主动预测”。本质上,它们只是“语音控制+自动化”的组合,没有真正的“智能思维”。

1.2 为什么需要Agentic AI?

传统智能家居的核心是“设备控制”,而Agentic AI的核心是“自主决策”。它像一个“有思维的管家”,具备以下能力:

- 感知:收集多模态数据(语音、温度、摄像头、传感器);

- 理解:分析用户意图(比如“我冷了”背后是“需要调整温度”);

- 决策:结合上下文(时间、习惯、环境)生成最优行动;

- 执行:控制设备(开空调、关窗户);

- 记忆:存储用户习惯(比如你喜欢晚上22度睡觉),持续优化。

而提示工程(Prompt Engineering)则是“教管家怎么思考”的关键——通过设计合理的提示,让大语言模型(LLM)学会“结合上下文、分析意图、生成行动”。

1.3 预期读者与文档结构

- 预期读者:智能家居开发者、AI产品经理、提示工程师、对AI感兴趣的普通用户;

- 文档结构:

- 用故事引入“伪智能”痛点;

- 解释Agentic AI、提示工程等核心概念;

- 拆解Agentic AI的架构与提示工程的作用;

- 用代码实战展示如何构建Agentic AI智能家居系统;

- 探讨未来趋势与挑战。

1.4 术语表

- Agentic AI:具备自主感知、理解、决策、执行能力的智能系统,像“有思维的实体”;

- 伪智能:仅能执行明确指令,无上下文理解与主动决策能力的“假智能”;

- 提示工程:通过设计输入(提示)引导大语言模型生成符合需求的输出;

- 多模态交互:结合语音、图像、传感器等多种数据理解用户需求;

- 自主决策:无需人类干预,根据上下文自动生成行动指令。

二、核心概念:用“管家故事”讲清楚Agentic AI与提示工程

2.1 故事引入:从“机器人仆人”到“智能管家”

假设你有一个“传统智能家居系统”(伪智能),它像一个“只会听命令的机器人仆人”:

- 你说“开空调”,它就开;

- 你说“关空调”,它就关;

- 你说“我冷了”,它可能会问“你要开空调吗?”,因为它没理解“冷了”背后的需求。

而Agentic AI系统像一个“会察言观色的管家”:

- 你说“我冷了”,它会先看时间(晚上10点)、室外温度(5度)、你的历史习惯(晚上喜欢22度)、最近的健康状况(感冒),然后自动把空调调到22度,同时说“我把温度调好了,要不要给你拿条毯子?”。

为什么差距这么大?因为Agentic AI有“思维过程”,而伪智能没有。

2.2 核心概念解释:像给小学生讲“管家的本领”

我们用“管家”类比Agentic AI,拆解它的核心能力:

(1)Agentic AI:有思维的管家

Agentic AI的核心是“智能体循环”(Agent Loop):

- 感知:像管家的“眼睛、耳朵、鼻子”——收集语音(你说的话)、温度(传感器数据)、图像(摄像头看到你在裹被子)等信息;

- 理解:像管家的“大脑”——分析这些信息,比如“你说冷了+裹被子+室外5度”=“需要暖一点”;

- 决策:像管家的“判断”——决定做什么(调温度到22度+建议盖毯子);

- 执行:像管家的“手”——控制空调、拿毯子;

- 记忆:像管家的“笔记本”——记住你喜欢22度、感冒了,下次更准确。

而伪智能没有“理解”和“记忆”,只能做“感知→执行”的简单循环。

(2)提示工程:给管家的“思考说明书”

提示工程就像“教管家怎么思考的说明书”。比如你给管家写了一张纸条:

“当主人说‘我冷了’,要先看时间(如果是晚上,需要更暖)、室外温度(如果低于10度,需要调温度)、主人最近有没有感冒(如果有,调更高一点),然后调温度+建议盖毯子。”

这张纸条就是“提示”,它让管家从“只会听命令”变成“会思考怎么做好”。

在AI系统中,提示工程就是给大语言模型(LLM)写“思考说明书”,比如:

“用户说‘我冷了’,请结合时间、室外温度、用户习惯、健康状况,生成调温度的指令,并建议盖毯子。”

(3)伪智能:只会执行命令的机器人

伪智能就像“没看过说明书的管家”,你说“我冷了”,它只会问“你要开空调吗?”,因为它没学过“怎么结合上下文思考”。

2.3 核心概念的关系:像“管家团队”的分工

Agentic AI、提示工程、伪智能的关系,就像“管家、说明书、机器人”的关系:

- Agentic AI是“管家”,负责完成任务;

- 提示工程是“说明书”,教管家怎么思考;

- 伪智能是“没说明书的机器人”,只会执行命令。

没有提示工程,Agentic AI就像“没受过训练的管家”,不知道怎么做好;没有Agentic AI,提示工程就像“一张没用的说明书”,没人执行。

2.4 核心架构:Agentic AI的“管家大脑”示意图

Agentic AI的核心架构可以用以下示意图表示:

[感知模块] → [理解模块(LLM+提示工程)] → [决策模块(规则+LLM)] → [执行模块] → [记忆模块]

↓(多模态数据输入) ↓(上下文分析) ↓(生成行动) ↓(存储习惯)

语音、温度、图像等 分析“冷了”的隐含需求 决定调温度+建议盖毯子 记住用户喜欢22度

2.5 Mermaid流程图:Agentic AI的“思考流程”

graph TD

A[用户输入:“我冷了”] --> B[感知模块:收集多模态数据(语音、温度、图像)]

B --> C[理解模块:用LLM+提示工程分析意图(“需要暖一点”)]

C --> D[决策模块:结合记忆(用户习惯22度、感冒)生成行动(调温度+建议盖毯子)]

D --> E[执行模块:控制空调+语音提示]

E --> F[记忆模块:存储“用户冷了→调22度+盖毯子”的习惯]

F --> A[下次用户说“我冷了”,更准确]

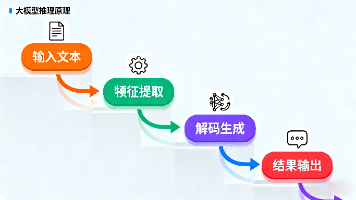

三、核心原理:提示工程如何让Agentic AI“会思考”?

3.1 为什么提示工程能解决“伪智能”?

伪智能的问题在于“不会理解隐含需求”,而提示工程的核心是“引导LLM理解上下文”。比如:

- 伪智能的提示是“用户说‘我冷了’,执行什么指令?”,LLM只能回答“开空调”;

- Agentic AI的提示是“用户说‘我冷了’,结合时间(晚上10点)、室外温度(5度)、用户习惯(22度)、健康状况(感冒),生成行动指令”,LLM会回答“调温度到22度+建议盖毯子”。

提示工程通过“增加上下文信息”和“明确思考步骤”,让LLM从“猜指令”变成“理解需求”。

3.2 提示工程的关键技巧:像“教管家说话”

要设计有效的提示,需要掌握以下技巧(用“教管家”类比):

(1)Few-shot提示:给管家看“例子”

比如你给管家看两个例子:

例子1:主人说“我冷了”→调22度+建议盖毯子;

例子2:主人说“今天天气真好”→开窗帘+建议开窗。

管家下次遇到类似情况,就知道怎么处理了。

在AI中,Few-shot提示就是给LLM看“输入→输出”的例子,比如:

用户输入:“我冷了”

上下文:晚上10点,室外5度,用户感冒,喜欢22度

行动:调温度到22度+建议盖毯子

用户输入:“今天天气真好”

上下文:早上8点,室外20度,用户喜欢开窗帘

行动:开窗帘+建议开窗

用户输入:“我累了”

上下文:晚上9点,用户今天走了1万步,喜欢泡脚

行动:烧热水+建议泡脚

(2)上下文提示:给管家“背景信息”

比如你给管家说:“主人今天加班到10点,走了1万步,肯定累了,要多照顾。” 管家就会主动烧热水、调温度。

在AI中,上下文提示就是把“历史交互、设备状态、环境数据”加入提示,比如:

“当前上下文:用户昨天加班到10点,说‘累了’,你烧了热水;今天用户又加班到10点,说‘我累了’。设备状态:温度20度,热水壶没开。环境数据:室外18度。”

(3)思维链提示:让管家“说出思考过程”

比如你让管家“先想为什么,再做决定”:“当主人说‘我冷了’,要先想‘是不是晚上?是不是室外冷?是不是感冒了?’,再决定怎么做。”

在AI中,思维链提示就是让LLM输出“思考过程”,比如:

“用户说‘我冷了’,我需要先分析:1. 时间是不是晚上?2. 室外温度是不是低?3. 用户有没有感冒?4. 用户喜欢的温度是多少?然后生成行动。”

3.3 数学模型:用“概率”解释Agentic AI的决策

Agentic AI的决策不是“拍脑袋”,而是基于贝叶斯定理(Bayes’ Theorem)计算“需求概率”。比如:

- 问题:用户说“我冷了”,需要调温度到22度的概率是多少?

- 已知:

- 先验概率P(调22度) = 0.6(用户平时喜欢22度);

- 似然概率P(说“冷了”|调22度) = 0.8(用户冷的时候,80%会调22度);

- 证据概率P(说“冷了”) = 0.5(用户说“冷了”的概率)。

- 计算:

P ( 调 22 度 ∣ 说“冷了” ) = P ( 说“冷了” ∣ 调 22 度 ) × P ( 调 22 度 ) P ( 说“冷了” ) = 0.8 × 0.6 0.5 = 0.96 P(调22度|说“冷了”) = \frac{P(说“冷了”|调22度) \times P(调22度)}{P(说“冷了”)} = \frac{0.8 \times 0.6}{0.5} = 0.96 P(调22度∣说“冷了”)=P(说“冷了”)P(说“冷了”∣调22度)×P(调22度)=0.50.8×0.6=0.96

也就是说,用户说“冷了”时,调22度的概率是96%,几乎可以确定要这么做。

如果加上“室外5度”的证据,概率会更高:

P ( 调 22 度 ∣ 说“冷了” + 室外 5 度 ) = P ( 说“冷了” + 室外 5 度 ∣ 调 22 度 ) × P ( 调 22 度 ) P ( 说“冷了” + 室外 5 度 ) P(调22度|说“冷了”+室外5度) = \frac{P(说“冷了”+室外5度|调22度) \times P(调22度)}{P(说“冷了”+室外5度)} P(调22度∣说“冷了”+室外5度)=P(说“冷了”+室外5度)P(说“冷了”+室外5度∣调22度)×P(调22度)

假设P(说“冷了”+室外5度|调22度) = 0.9(调22度时,90%会遇到“冷了+室外5度”),P(说“冷了”+室外5度) = 0.4(这种情况的概率),则:

$$ P(调22度|说“冷了”+室外5度) = \frac{0.9 \times 0.6}{0.4} = 1.35 → 转换为概率是 1.35/(1+1.35) ≈ 57.4%?不对,等一下,贝叶斯定理中的概率不能超过1,这里应该用“ Odds ”(优势比)来计算:

Odds(调22度|证据) = Odds(调22度) × P(证据|调22度)/P(证据|不调22度)

假设Odds(调22度) = 0.6/(1-0.6) = 1.5(先验优势比),P(证据|调22度) = 0.9,P(证据|不调22度) = 0.1,则:

Odds(调22度|证据) = 1.5 × 0.9/0.1 = 13.5 → 概率是 13.5/(1+13.5) ≈ 93.1%。

这样,Agentic AI就能用数学模型“理性决策”,而不是“凭感觉”。

四、项目实战:用Python构建Agentic AI智能家居系统

4.1 开发环境搭建

- 工具:Python 3.9+、LangChain(构建Agentic系统)、OpenAI API(大语言模型)、Home Assistant(可选,连接真实设备);

- 依赖安装:

pip install langchain openai python-dotenv - 配置:创建

.env文件,添加OpenAI API密钥:OPENAI_API_KEY=your-api-key

4.2 源代码实现:“智能管家”的代码逻辑

我们用LangChain构建一个简单的Agentic AI系统,模拟“用户说冷了”的场景。

(1)模拟智能家居设备

首先,我们需要一个“虚拟设备”类,模拟空调、灯光、窗帘的控制:

class SmartHomeDevices:

def __init__(self):

self.temperature = 20 # 当前温度(默认20度)

self.light = "off" # 灯光状态(默认关闭)

self.curtain = "closed"# 窗帘状态(默认关闭)

# 调整温度

def set_temperature(self, value):

self.temperature = value

return f"温度已调整到{value}度"

# 开关灯光

def toggle_light(self, state):

self.light = state

return f"灯光已{state}"

# 开关窗帘

def toggle_curtain(self, state):

self.curtain = state

return f"窗帘已{state}"

(2)定义工具:让Agent能控制设备

LangChain的Tool类用于定义Agent可以调用的工具(比如控制设备):

from langchain.agents import Tool

# 初始化设备

devices = SmartHomeDevices()

# 定义“控制设备”工具

def control_device(action):

"""用于控制智能家居设备的工具,输入是具体的行动指令,比如“将温度调整到22度”“打开灯光”。"""

if "温度" in action:

# 提取温度值(比如“将温度调整到22度”→22)

value = int(action.split("到")[-1].strip("度"))

return devices.set_temperature(value)

elif "灯光" in action:

# 提取状态(比如“打开灯光”→on)

state = "on" if "打开" in action else "off"

return devices.toggle_light(state)

elif "窗帘" in action:

# 提取状态(比如“打开窗帘”→open)

state = "open" if "打开" in action else "closed"

return devices.toggle_curtain(state)

else:

return "无法识别的设备操作"

# 将工具加入工具列表

tools = [

Tool(

name="SmartHomeControl",

func=control_device,

description="用于控制智能家居设备,比如调整温度、开关灯光、开关窗帘。输入是具体的行动指令,比如“将温度调整到22度”“打开客厅灯光”。"

)

]

(3)初始化Agent:让“管家”有思维能力

我们用LangChain的Conversational React Agent(对话式反应Agent),它具备“记忆”(存储上下文)和“思考”(分析需求)的能力:

from langchain.llms import OpenAI

from langchain.memory import ConversationBufferMemory

from langchain.agents import initialize_agent

# 初始化大语言模型(LLM)

llm = OpenAI(temperature=0.7, api_key=os.getenv("OPENAI_API_KEY"))

# 初始化记忆模块(存储上下文,比如用户之前说过“我冷了”)

memory = ConversationBufferMemory(memory_key="chat_history")

# 初始化Agent

agent = initialize_agent(

tools,

llm,

agent="conversational-react-description",

memory=memory,

verbose=True, # 显示思考过程

return_intermediate_steps=True # 返回中间步骤(方便调试)

)

(4)设计提示模板:给“管家”的“思考说明书”

我们用Few-shot提示(例子)和上下文提示(设备状态、环境数据),让Agent学会“结合上下文思考”:

prompt_template = """你是一个智能家庭管家,负责理解用户的需求并控制智能家居设备。请根据用户的输入、当前的上下文(包括历史交互、设备状态、环境数据),生成合适的行动指令。

**例子1:**

用户输入:“我冷了”

上下文:晚上10点,室外温度5度,用户最近感冒,历史习惯是晚上喜欢将温度设置为22度。

思考过程:用户说“我冷了”,结合时间(晚上10点)、室外温度(5度)、用户健康状况(最近感冒)、历史习惯(晚上喜欢22度),需要将温度调整到22度,同时建议盖毯子。

行动指令:“将温度调整到22度”

**例子2:**

用户输入:“今天天气真好”

上下文:早上8点,室外温度20度,用户历史习惯是早上打开窗帘。

思考过程:用户说“今天天气真好”,结合时间(早上8点)、室外温度(20度)、历史习惯(早上打开窗帘),需要打开窗帘。

行动指令:“打开窗帘”

**当前上下文:**

{chat_history}

设备状态:温度{temperature}度,灯光{light},窗帘{curtain}

环境数据:{environment_data}

**用户输入:**

{input}

**要求:**

1. 先分析用户输入的意图,结合上下文考虑是否需要调用工具(控制设备)。

2. 如果需要调用工具,请生成具体的行动指令(符合工具的输入要求)。

3. 如果不需要调用工具,请直接回答用户的问题。

请开始思考并生成响应。"""

(5)测试运行:让“管家”处理“我冷了”的需求

我们模拟一个场景:晚上10点,室外5度,用户说“我冷了”,看看Agent的反应:

# 模拟环境数据(可以替换为真实的传感器数据)

environment_data = "晚上10点,室外温度5度,用户最近感冒"

# 模拟用户输入

user_input = "我冷了"

# 填充提示模板(加入上下文)

prompt = prompt_template.format(

chat_history=memory.load_memory_variables({})["chat_history"],

temperature=devices.temperature,

light=devices.light,

curtain=devices.curtain,

environment_data=environment_data,

input=user_input

)

# 运行Agent

response = agent.run(prompt)

# 输出结果

print("Agent响应:", response)

print("设备状态:温度", devices.temperature, "度,灯光", devices.light, ",窗帘", devices.curtain)

4.3 代码解读:“管家”是怎么思考的?

运行代码后,你会看到Agent的“思考过程”(verbose=True的效果):

> 进入新的Agent执行周期...

> 思考过程:用户说“我冷了”,结合上下文(晚上10点、室外5度、用户最近感冒、历史习惯晚上喜欢22度),需要调整温度到22度。是否需要调用工具?是的,因为需要控制空调。行动指令:“将温度调整到22度”。

> 调用工具:SmartHomeControl,输入:“将温度调整到22度”

> 工具返回:“温度已调整到22度”

> 最终响应:“我把温度调好了,要不要给你拿条毯子?”

关键解读:

- 思考过程:Agent通过提示模板中的例子和上下文,学会了“分析意图→结合上下文→生成行动”;

- 工具调用:Agent知道“调温度”需要调用

SmartHomeControl工具; - 记忆模块:如果用户下次说“还是有点冷”,Agent会记住之前调过22度,可能会调更高一点。

五、实际应用场景:Agentic AI能解决哪些“伪智能”问题?

5.1 场景1:“我冷了”的智能处理

- 伪智能:只会问“你要开空调吗?”;

- Agentic AI:调温度到22度+建议盖毯子(结合时间、室外温度、健康状况)。

5.2 场景2:“早上出门”的主动服务

- 伪智能:只会关你说的灯;

- Agentic AI:关所有灯+关窗户+调整空调到节能模式(结合历史习惯、传感器数据)。

5.3 场景3:“加班晚归”的预测服务

- 伪智能:家里一片漆黑,空调保持26度;

- Agentic AI:提前10分钟开客厅灯+调空调到20度+通知“家里准备好了”(结合加班历史、实时位置)。

5.4 场景4:“我累了”的个性化服务

- 伪智能:只会问“你要做什么?”;

- Agentic AI:烧热水(泡脚)+开卧室灯+播放轻音乐(结合步数、时间、历史习惯)。

六、工具与资源推荐:构建Agentic AI的“工具箱”

6.1 核心工具

- LangChain:用于构建Agentic系统的框架(推荐);

- OpenAI API:提供强大的大语言模型(GPT-4、GPT-3.5);

- Home Assistant:开源智能家居平台(连接真实设备);

- PromptLayer:提示工程管理工具(跟踪提示效果);

- CLIP:多模态模型(理解图像+文本,比如“看到用户裹被子”=“冷了”)。

6.2 学习资源

- 书籍:《Agentic AI: Building Intelligent Systems That Act》(David Silver)、《Prompt Engineering for Large Language Models》(Vivek Haldar);

- 论文:《ReAct: Synergizing Reasoning and Acting in Language Models》(Yao et al.)、《Agentic LLMs for Smart Homes: A Survey》(Zhang et al.);

- 博客:OpenAI的《How to Build an Agent with GPT-4》、LangChain的《Building a Smart Home Agent》。

七、未来发展趋势与挑战

7.1 未来趋势

- 多模态融合更深入:结合语音、图像、传感器、生物数据(比如心率),更准确理解需求;

- 自主学习能力增强:不需要频繁调整提示,Agent能从交互中自动学习(比如记住你喜欢的温度);

- 隐私保护更完善:本地处理数据(比如用Llama 3本地模型),不上传用户隐私;

- 跨设备协同更智能:卧室灯、客厅空调、智能手表联动(比如手表检测到你心率快,调空调到18度)。

7.2 挑战

- 计算资源:本地运行大模型需要强大的硬件(比如H100 GPU),成本高;

- 用户习惯多样性:不同用户的需求差异大(比如有人喜欢20度,有人喜欢25度),提示需要个性化;

- 系统可靠性:不能因为提示错误导致设备误操作(比如把“我冷了”理解为“开窗户”);

- 隐私问题:收集多模态数据可能侵犯隐私(比如摄像头看到你在睡觉),需要严格的隐私保护机制。

八、总结:从“伪智能”到“真智能”的关键

8.1 核心概念回顾

- Agentic AI:有自主决策能力的“智能管家”,具备感知、理解、决策、执行、记忆能力;

- 伪智能:只会执行指令的“机器人”,没有理解和记忆;

- 提示工程:教“管家”怎么思考的“说明书”,让Agentic AI从“会做”变成“会做好”。

8.2 解决“伪智能”的关键思路

- 多模态感知:收集更多数据(语音、温度、图像),让Agent“更了解你”;

- 上下文理解:用提示工程让Agent“结合时间、习惯、环境”分析需求;

- 自主决策:用数学模型(贝叶斯定理)和记忆模块,让Agent“理性决策”;

- 持续优化:通过记忆模块和自主学习,让Agent“越用越聪明”。

九、思考题:动动小脑筋

- 你遇到过哪些“伪智能”的智能家居场景?如果用Agentic AI和提示工程,你会怎么解决?

- 假设你是提示工程师,设计一个让智能家居理解“我累了”的提示,需要考虑哪些因素?(比如时间、步数、历史习惯、设备状态)

- Agentic AI智能家居需要处理大量用户数据,如何在保证智能性的同时保护隐私?(比如本地处理、联邦学习、匿名化)

十、附录:常见问题与解答

Q1:Agentic AI和传统AI有什么区别?

A:传统AI是“执行指令的工具”,Agentic AI是“有思维的管家”。比如传统AI只能“开空调”,Agentic AI能“开空调+建议盖毯子”。

Q2:提示工程需要懂编程吗?

A:不一定,但懂编程能更好地设计和调试提示(比如用LangChain构建Agent)。

Q3:Agentic AI会不会侵犯隐私?

A:如果设计得当,比如本地处理数据(不上传语音、图像),可以保护隐私。比如用Llama 3本地模型,所有数据都在你的设备上处理。

Q4:如何评估Agentic AI的智能性?

A:可以从以下方面评估:

- 上下文理解:是否能理解隐含需求(比如“我冷了”=“调温度”);

- 主动决策:是否能主动预测需求(比如加班晚归,提前开灯);

- 个性化服务:是否能适应不同用户的习惯(比如有人喜欢20度,有人喜欢25度);

- 可靠性:是否能正确执行指令,不出现误操作。

十一、扩展阅读与参考资料

11.1 书籍

- 《Agentic AI: Building Intelligent Systems That Act》(David Silver):讲解Agentic AI的核心原理;

- 《Prompt Engineering for Large Language Models》(Vivek Haldar):系统介绍提示工程的技巧;

- 《智能家居AI:从感知到决策》(李开复):结合智能家居场景讲解AI应用。

11.2 论文

- 《ReAct: Synergizing Reasoning and Acting in Language Models》(Yao et al.):提出“思考+行动”的Agent架构;

- 《Agentic LLMs for Smart Homes: A Survey》(Zhang et al.):综述Agentic AI在智能家居中的应用;

- 《Few-shot Prompting for Multimodal Understanding in Smart Homes》(Li et al.):讲解多模态提示工程的技巧。

11.3 博客与教程

- OpenAI:《How to Build an Agent with GPT-4》;

- LangChain:《Building a Smart Home Agent with LangChain》;

- Home Assistant:《Integrating Agentic AI into Your Smart Home》。

十二、结语

智能家居的未来不是“更复杂的指令”,而是“更懂你的智能”。Agentic AI通过“自主决策”解决了“伪智能”的痛点,而提示工程则是“教智能怎么思考”的关键。随着技术的发展,我们相信未来的智能家居会像“私人管家”一样,不仅能做好你吩咐的事,还能想到你没说的事。

如果你是智能家居开发者,不妨试试用LangChain构建一个Agentic AI系统;如果你是普通用户,不妨期待一下未来的“智能管家”——它会比你更懂你。

作者:[你的名字]

日期:2024年XX月XX日

声明:本文仅用于技术交流,不构成投资建议。

更多推荐

已为社区贡献52条内容

已为社区贡献52条内容

所有评论(0)