人工智能帝国——炒作中的怀疑——书评

人工智能帝国》是一部不完美的编年史,记录了科技史上的关键时刻。它无疑影响了我的观点——让我对人工智能中的英雄叙事更加了解和谨慎。这本书引发了关于“我们想要人工智能什么样的未来,谁来决定它?通过将讲故事与严谨的调查相结合,郝确保这些对话具有事实依据。出于这个原因,尽管我对细微差别提出了批评,但我认为它是成功的。这是我们需要的一本书,让我们从人工智能炒作的宿醉中清醒过来,清楚地看到风景——疣等等。如果

tl;dr — 我认为 Empire of AI 是有用的背景,但结论不平衡。OpenAI 和 Altman 是大规模应对前沿风险的使命驱动型运营商,而不是不负责任的帝国建设者。将此视为判断的一种输入,而不是判决——边缘的怀疑主义激进主义固化为对大型实验室的单调控诉,低估了大型组织如何资助核心研究、构建该领域运行的计算和工具、发布安全工作以及将想法转化为现实世界的影响。

通过突出贡献的冲突,它过度概括了最坏的情况,并将反驳视为仅仅是防御性的;客观性/公平性似乎已经退居二线。对规模如何实际推动科学技术向前发展没有平衡的计算。

摘要

郝凯伦的《人工智能帝国》报道细致,可读性强,但它采用了客观性/公平性退居二线的起诉框架。叙事过重争议,低估贡献,产生的热量多于光量。

这本书低估了规模和大型企业如何推动科学发展:持续的计算投资、工程管道、可靠性工具以及将研究转化为影响的全球部署。“帝国”的比喻模糊了行业基线——同行遵循类似的剧本——使 OpenAI 显得独特的罪魁祸首,而不是共同动态中的主导力量。

它还忽视了具体的治理和安全措施:具有非营利监督的上限利润结构、迭代的 RLHF、大量的红队、分阶段发布和持续的监管机构参与。是的,不完美——但证明一家公司是在公开场合学习,而不是在私下里鲁莽地比赛。

“没有一本书能把一切都做好,尤其是当有些人如此一心想扭曲事情时......”——山姆·奥尔特曼,通过社交媒体(由郝转述)。

关于领导力,山姆·奥特曼应该少读作恶棍,而多读作经营者:调动资本、人才和战略合作伙伴关系,将基础研究产品化,同时将安全放在议程上。危机后广泛的内部和合作伙伴信心表明执行信任,而不是邪教。

底线:有价值的背景,但阅读不平衡,将反驳视为防御性,并最大限度地减少切实的进展。净效果是控诉规模;证据更合理地证明 Altman 和 OpenAI 是使命驱动型行为者,他们的贡献需要更严格的护栏,而不是讽刺。

建议

这本 496+ 页翻页书将引起对技术道德和人工智能繁荣背后的人物感兴趣的读者的兴趣。然而,我仍然对其更耸人听闻的断言持怀疑态度,敦促读者也考虑其他观点(例如基奇·哈吉的《乐观主义者》)以获得平衡的理解。下面,我将介绍详细的索赔审计、上下文恢复,以及我对《人工智能帝国》的正确之处和越界之处的坦率评估。

也就是说,我承认某些领域涉及解释和判断。我对这本书框架的怀疑(例如,帝国的类比是否被夸大了,或者奥特曼的描绘是否缺乏细微差别)是一种分析性评估。它是由证据提供的——例如员工对奥特曼回归的压倒性支持,我将其作为反驳——但它最终反映了我的理性观点。我对这些批评有一定的信心,因为它们与已知的反例一致,并且书中没有这些观点。然而,它们在某种程度上是主观的。另一位读者可能会以不同的方式权衡证据,并发现这本书的框架完全合适。

在撰写这篇冗长的评论时,我的目标是公平和基于证据,就像 Hao 在她的书中所做的那样,尽管语气不同。如果出现任何新信息,或者我误解了细微差别,那将是出于真正的监督,而不是忽视尽职调查。鉴于所做的尽职调查——广泛的来源交叉检查和批判性评估——我相信这篇评论是对《人工智能帝国》及相关问题的可靠和诚实的评估。

人工智能帝国的论点

Karen Hao 的《人工智能帝国:Sam Altman 的 OpenAI 中的梦想与噩梦》详细揭露了 OpenAI 的崛起以及围绕其对通用人工智能 (AGI) 的追求的争议。Hao 的中心论点是,OpenAI 在首席执行官 Sam Altman 的领导下,建立了一个现代“人工智能帝国”——一个强大而秘密的组织,由对 AGI 的准宗教热情驱动,但充满了治理戏剧、道德妥协和缺乏平衡。

Karen Hao 的书描绘了 OpenAI 从一个理想主义的研究实验室转变为一个占主导地位的、以利润为导向的“帝国”的全面叙述。在郝的讲述中,OpenAI 始于 2015 年,作为一个透明的非营利组织,它曾做出以合乎道德的方式开发人工智能以造福人类的崇高承诺,但它逐渐“推理”了这些理想。核心论点和故事情节包括:

- 背叛非营利组织愿景:OpenAI 的创始原则是开放——“开放”在名字中——其使命是发表研究成果并广泛分享利益。Hao 讲述了 2019 年作为 OpenAI 的一名《麻省理工科技评论》记者,她观察到任务的言辞与现实之间的鲜明对比。该实验室“极其神秘”和“竞争激烈”,一心想不惜一切代价成为 AGI 的先行者。该书认为,这种竞争驱动力导致 OpenAI 在 2019 年从非营利组织转向混合的“利润上限”模式,吸引数十亿美元的投资,并引入与其公共利益章程相冲突的商业激励措施。郝表示,这种转变——以 2019 年与 Microsoft 的 10 亿美元合作伙伴关系为缩影——表明利润和权力已经超越了透明度和利他主义。

- 治理戏剧和权力斗争:一个主要主题是 OpenAI 独特治理结构内部的动荡。Hao 记录了 2023 年 11 月的董事会政变,当时 OpenAI 董事会(负责保持公司以使命为中心)突然解雇了 Sam Altman,理由是涉嫌缺乏坦诚。这一事件被描述为一场令人震惊的硅谷戏剧,奥特曼被罢免了几天,直到员工起义和合作伙伴压力(尤其是来自Microsoft)迫使他复职并进行了董事会改组。该书将这一事件描述为那些优先考虑人工智能安全的人与奥特曼的“不惜一切代价增长”方法之间紧张关系的高潮。Hao 详细介绍了 OpenAI 的治理——一个监督营利性部门的非营利性董事会——旨在将使命放在首位,但在实践中却导致了奥特曼领导下的混乱和权力巩固。“斗篷和匕首”章节描述了秘密会议、信任破裂,以及奥特曼最终如何变得更加强大(现在董事会重组)。

- 对 AGI 的崇拜——弥赛亚的底色:人工智能帝国断言,OpenAI 对 AGI 的追求几乎是宗教的热情。该公司的领导者和研究人员被描绘成真正的信徒,他们相信他们正在开创一种可以拯救人类或毁灭人类的技术,因此将自己视为先知或救世主。郝引用了令人大吃一惊的轶事,“消除了对 OpenAI 的 AGI 任务具有”弥赛亚色彩的任何怀疑“。例如,据说联合创始人 Ilya Sutskever 在一次团队务虚会上焚烧了一个象征欺骗性 AGI 的木制雕像——宣称 OpenAI 的“职责是摧毁它”(即阻止错位的 AI)。在另一个场外,他带头高呼:“感受 AGI。感受 AGI。这些近乎仪式性的情节支持 Hao 对 OpenAI 内部”AGI 崇拜“的描绘,一种近乎准宗教的意识形态驱动着团队。OpenAI 宪章造福全人类的承诺得到了狂热;员工们认为自己肩负着将 AGI 之光带给世界的文明使命(因此章节标题为“神圣权利”和“文明使命”)。郝认为,这种文化促成了非凡的野心,但也带来了盲点——为极端保密和道德妥协辩护,因为利害关系感觉是宇宙性的。Hao 指出,人工智能领域的许多人都持有“根深蒂固的、准宗教的信仰”——一些乌托邦(人工智能将迎来一个乌托邦),另一些则偏执(人工智能将毁灭人类,所以我们必须首先控制它)。OpenAI 的领导者设法同时接受了这两者:一种信念,即 AGI 将造福人类,另一种担心,如果他们不这样做,更糟糕的人就会这样做。这导致了一种“不惜一切代价先实现 AGI”的心态,Hao 认为这种心态本质上是矛盾的。

- 山姆·奥特曼:有远见的人还是纵者?:作为一个角色,山姆·奥特曼显得尤为重要。Hao 追踪了 Altman 从一名年轻的科技企业家成长为掌舵 OpenAI 的千载难逢的筹款专家。这本书承认了 Altman 的才华——他被描绘成一位讲故事的大师,能够对未来提出宏伟的愿景并释放大量投资。但 Hao 对 Altman 的诚意持怀疑态度:她的结论是,“当他对某人说某事时,这与他认为他们需要听到的内容比他实际相信的内容或真相更紧密相关”。换句话说,根据她的研究,郝将奥特曼描述为善于纵,告诉每个受众(投资者、员工、监管机构)他们想听到什么,以推进他的目标。人工智能帝国审查了奥特曼的公众形象——这位自封为负责任的人工智能倡导者,向国会作证监管的必要性——反对他的内部行为,例如竞相在竞争对手之前部署 ChatGPT。郝显然对将人类的未来信任给奥特曼持怀疑态度,这呼应了一些叛逃者和记者提出的问题:奥特曼的高尚言论是真实的还是方便的外表?这本书毫不拐弯抹角,与奥特曼的内部批评者一致,他们指责他有“纵行为的历史”。然而,郝也将 OpenAI 的成功在很大程度上归功于 Altman 的“独特的动力、网络和才能”——本质上是认为 Altman 的野心和悟性使 OpenAI 占据主导地位,无论好坏。OpenAI 被描述为“奥特曼的体现......他从硅谷带来的不惜一切代价增长哲学的产物”。

- 人工智能军备竞赛和行业影响:另一个论点是 OpenAI 的选择催化了全行业的竞赛。郝认为,当今的人工智能热潮没有什么是注定的——“OpenAI 所做的一切都与不可避免相反”——但一旦 OpenAI 推进大规模深度学习模型和公开发布,竞争对手就会受到刺激。这本书调查了谷歌、Meta、Anthropic,甚至中国的百度都对 OpenAI 的突破有何反应,这通常反映了 Altman 的规模优先方法。例如,谷歌在 ChatGPT 于 2022 年首次亮相后的“红色代码”恐慌,或者 Meta 匆忙推出 LLaMA,都可以被视为对 OpenAI 的防御性回应。因此,Hao 将 OpenAI 定位为将整个科技世界拖入“危险竞赛......到地球极限“——这是一场更大的模型、更强大的计算和更快的部署的竞赛,而道德上的停顿却不够。她对“不惜一切代价扩大规模”的范式尤其挑剔:在“整个互联网”上训练人工智能,消耗千兆瓦时的能源,垄断人才,所有这些都是为了击败竞争对手。这种竞争框架与奥特曼的零和世界观息息相关:OpenAI 员工被灌输了这样一种信念,即如果他们没有赢得 AGI 竞赛,其他人(也许是竞争对手科技巨头或中国等“邪恶帝国”)就会赢得——郝指出,这种态度在历史上的帝国建设中很常见。她认为,结果是一场以炒作和恐惧为标志的人工智能军备竞赛,这主要是 OpenAI 制造的。

- 保密、安全和道德捷径:尽管 OpenAI 的使命是推进“安全人工智能”,但 Altman 领导下的 OpenAI 被描述为不透明且在安全问题上反应迟钝。人工智能帝国声称,OpenAI 经常优先考虑成为第一,而不是完全安全或透明。例如,据 Hao 称,2022 年 11 月推出的 ChatGPT 在两周内就匆忙推出,主要是因为竞争对手 Anthropic 即将发布聊天机器人的(错误)谣言。该公司只做了很少的发布前简报,预计这将是一个小型实验——结果却被其立竿见影的成功所淹没,并且对社会影响毫无准备。Hao 强调了 OpenAI 的安全流程如何经常迎头赶上:例如,在 ChatGPT 已经掌握在数百万人手中后,他们争先恐后地扩大护栏和内容审核。该书还强调了透明度方面的失败,例如 OpenAI 的 GPT-4 技术报告,该报告有争议地几乎没有披露有关模型内部工作原理或训练数据的信息。郝将此解读为 OpenAI 打着安全和竞争保密的幌子,从开放性中退缩。她指出,从历史上看,人工智能研究重视开放共享,但 OpenAI “违背了这一原则”,将基本事实(数据源、模型大小)视为商业秘密。保密文化甚至延伸到了安全评估:虽然 OpenAI 确实有一个一致性和政策团队,但这本书质疑,如果领导层急于部署更强大的模型,他们到底拥有多少权力。一个引人注目的说法是,OpenAI 的研究人员感受到了“尽可能快地跑”向 AGI 迈进的压力,甚至通过说服自己任何延迟都会增加他人的生存危险来证明风险是合理的。郝认为,这种心态导致风险公开披露不足,外部问责制不足。例如,她指出,GPT-4 系统卡虽然是迈向透明度的一步,但仍然省略了关键细节(例如完整的训练数据文档),并且 OpenAI 的自我编辑(例如软化对模型产生有毒内容的能力的讨论)显示出控制叙述的倾向。这本书本质上指责 OpenAI 的“安全清洗”——谈论安全问题,同时加速造成这些担忧的军备竞赛。

“我们基本上看到了旧帝国过去运作方式的再现......高层的一小群人为世界各地的其他人做决定......他们正在剥削大量劳动力......抢占数据中心的土地,抢占人们上网的数据......我们必须非常有意识,因为如果我们沿着这条路得出合乎逻辑的结论,民主就无法生存......“——郝凯伦在接受 NPR 采访时。

- 数据和劳动力剥削——一种新的殖民主义:名义上的“帝国”类比贯穿多个领域,特别是郝对 OpenAI 如何获取数据和人力的批评。她认为,像 OpenAI 这样的人工智能公司正在从事数字殖民主义:未经同意,从世界各地“声称拥有非凡的资源”。给出了两个鲜明的例子。首先,训练数据:OpenAI“扣押了人们放到网上的数据”——来自网站、书籍、Reddit 帖子等的数十亿字——而人们没有意识到这些数据会被商品化并用于盈利。这种大规模的网络抓取包括新闻文章和书籍等受版权保护的材料,被比作殖民帝国对自然资源的掠夺。(事实上,2023 年《纽约时报》起诉了 OpenAI/Microsoft,指控他们的内容被用来训练 GPT 模型,以“搭便车”《纽约时报》的投资。其次,廉价的劳动力:为了使 ChatGPT 更安全,OpenAI 依靠外包工人(例如在肯尼亚)过滤有毒内容,他们的工资低于 2 美元/小时——记者揭露这种安排是剥削性的,对这些工人的心理健康有害。郝将这些点联系起来,认为 OpenAI 的帝国是建立在榨取之上的:知识(来自作者、记者、用户)和劳动力(来自零工和注释者),通常来自几乎没有回报的全球南方。这本书表达了这些伦理问题,指出人工智能的外部性(能源使用、工作岗位流失、错误信息)由整个社会承担,而利润和权力则集中在高层。她明确地将当今的人工智能领导者比作殖民大国:“就像古代帝国一样,高层的一小群人为其他人做决定......世界上的其他人都没有代理权“。在郝看来,OpenAI 在没有公众同意或充分监督的情况下单方面决定释放 ChatGPT 并塑造人工智能轨迹,就是这种模式的缩影。

- 对民主和社会的威胁:在书中较为黑暗的段落(标题为“被掠夺的地球”和“帝国如何衰落”)中,郝警告说,如果目前的轨迹继续下去,民主本身就会面临风险。通过将前所未有的经济和政治权力集中在少数人工智能公司身上,我们冒着未来的风险,即“高层人士可以为所欲为”,而普通人却失去任何发言权。她认为,OpenAI 的崛起说明了这一趋势:少数高管和研究人员——没有被选举产生或承担广泛责任——创建了可能破坏就业稳定、纵信息和环境资源紧张的系统。如果大多数人“在决定自己的未来时感到失去了自主权,那么民主就会消亡”,郝直言不讳地总结道。与科幻小说中“人工智能会变得无赖并杀死所有人”的末日论者不同,郝的恐惧更为具体:由于不受控制的人工智能驱动的不平等、大规模失业和企业权力,人类能动性和社会秩序受到侵蚀。书中指出,我们已经看到了迹象——从人工智能生成的威胁选举的错误信息到使用人工智能监视或取代工人的公司。用她的话说,如果我们不改变方向,“最大的威胁是对民主”。尾声推测了这个帝国可能如何垮台:可能是通过监管干预、公众的强烈反对,或者是其矛盾下的内部崩溃。但郝的最后一个信息是一个阴沉的行动号召——社会必须在还有时间的时候通过民主手段(政策、监督、工人和消费者权益)对人工智能帝国进行“反击”。

人工智能帝国认为,OpenAI 的故事是一个关于理想因野心而妥协的警示故事。这是一个关于一家公司对通用人工智能的不懈推动如何重塑一个行业、引发深刻风险并反映帝国建设的历史模式——以及随之而来的傲慢和伤害的故事。郝的叙述非常详细,确实比其他同时期的关于 OpenAI 的书籍“更广泛、更黑暗”。它成功地揭开了 OpenAI 内部运作的神秘面纱,但正如我将要讨论的那样,它偶尔会夸大“帝国”的隐喻,而低估了更广泛的人工智能背景的细微差别。

“他们非常神秘,这似乎不太对,因为......如果你是一个纯粹为了公众利益而进行研究的非营利组织,你为什么要保密呢?如果你可能有某种商业意图,你就会很神秘。

我仍然持怀疑态度的地方

尽管发现郝的大部分叙述都很引人注目,但我经常发现自己质疑她的框架和强调。在某些方面,我觉得这本书太过分了、缺乏平衡或错过了上下文,作为读者,我仍然对一些更强烈的主张或含义持怀疑态度:

- “帝国”类比——夸大其词?:郝的中心比喻将 OpenAI(和类似公司)比作殖民帝国。虽然发人深省,但这种框架有时让人感觉是强迫或夸张的。是的,有相似之处(如前所述,资源开采、权力失衡),但人工智能公司并不是征服领土的主权国家。每当这本书过于倾向于这个没有细微差别的类比时,我都会持怀疑态度。例如,郝断言我们“本质上看到了旧帝国过去运作方式的再现”,减去公开暴力。我的直觉反应:这完全公平吗?人工智能公司在国家内部运营,(理论上)受到法律和公众压力的约束。与殖民帝国不同,它们可以由民主政府监管或瓦解。虽然殖民臣民别无选择,但数亿人自愿使用 ChatGPT 等工具——这并不是纯粹的征服。我希望这本书能解决这些对立点。这个比喻有过于简单化的风险:当现实更加复杂时,它将 OpenAI 的领导者塑造成恶棍或暴君——他们可能是理想主义者,后来成为工业领袖,在竞争激烈的资本主义体系中运作,奖励帝国般的行为。当 Hao 暗示当今人工智能狂热的一切“只能源于 OpenAI 的独特道路”时,我的怀疑更加深了。OpenAI 真的是所有大规模人工智能弊病的唯一原因吗?这让我感到过度归因。大型科技公司的人工智能推动正在顺利进行(谷歌、Facebook 等拥有大规模的人工智能项目)——OpenAI 加速了它,但我怀疑它是否单独发明了“不惜一切代价扩大规模”的思维方式。例如,Google Brain 和 DeepMind 也在扩展模型,在 OpenAI 占据主导地位之前,它们拥有大量的保密性和宏伟的野心。这本书有时将 OpenAI 描绘成一个近乎无所不能的帝国,在我看来,这似乎是一种贬低系统性力量的叙事便利。实际上,人工智能的繁荣是更广泛趋势的结果:改进的算法、丰富的数据、竞争激烈的市场、政府资助(尤其是在中国)等。因此,尽管帝国类比有其优点,但每当它感觉过于还原论或夸张时,我仍然持怀疑态度。

- 缺少行业基线:与此相关的是,我觉得这本书经常孤立 OpenAI 的行为,而不与行业规范进行比较,使 OpenAI 显得独一无二的邪恶。我怀疑的头脑不断插入:“但这不也是其他人所做的吗?例如,Hao 批评 OpenAI 对 GPT-4 的训练和技术细节保密。诚然,他们在那份报告中几乎没有提供任何信息——但谷歌也没有在同一时间透露其 PaLM 2 模型的信息,Meta 也没有透露其 LLaMA 模型的所有信息。到 2023 年,封闭性已成为尖端人工智能实验室的常态,这主要是由于竞争压力(以及明确的安全问题)。OpenAI 可以说开创了这一趋势,但现在它并不是一个异常值。另一个例子:她抨击 OpenAI 在未经明确同意的情况下使用网络数据。然而,所有主要的人工智能开发商(谷歌、Meta、IBM 等)都以相同的公共资源为食。围绕培训中合理使用的法律辩论适用于整个领域。我觉得 Hao 有时暗示 OpenAI 的行为超出了行业标准,而它实际上可能遵循行业标准(甚至设定它们,无论好坏)。这种缺乏比较背景让我对 OpenAI = 不良行为者,其他人 = 相对无辜的隐含叙述持怀疑态度。事实上,OpenAI 的许多竞争对手都有自己的治理和道德争议:例如,谷歌臭名昭著地解雇了对大型语言模型风险发出警告的伦理学家(Timnit Gebru 等)——这是一场平行的“安全与野心”冲突。这本书没有深入探讨这一点,尽管它会支持这种动态是整个行业的论点,而不仅仅是在 OpenAI。同样,考虑一下劳工实践:Facebook (Meta) 因患有创伤后应激障碍的低薪内容审核员而受到指责(早在 ChatGPT 之前),其他人工智能公司也将注释外包给发展中国家。因此,虽然 OpenAI 可以而且应该受到批评,但我不相信它在质量上比同行更差。郝对一家公司的弊端的关注可能会误导普通读者,让他们认为 OpenAI 独自造成了这些问题,而实际上它们反映了科技领域的系统性问题。我在这里的怀疑与其说是事实(郝的事实通常是正确的),不如说是关于选择偏差。她选择了 OpenAI 作为案例研究——但人们可能会写一篇关于谷歌人工智能或亚马逊人工智能等的类似揭露。为什么不将其定位为“大型科技人工智能帝国”,而不是精确定位 OpenAI?狭隘的框架有时会让人感觉不平衡。

- 山姆·奥特曼的描绘:我对山姆·奥特曼的描绘有复杂的感受。一方面,郝捕捉到了对他的领导风格的合理批评——董事会的“不坦率”斥责和其他人纵的指控被记录在案。另一方面,我感觉到这本书对奥特曼的语气中有一种个人的严厉,这让我停了下来。他被描述为一个完美的讲故事者和筹款人(公平),但本质上也是一个并不真正相信他所说的话的人——暗示着深深的愤世嫉俗甚至欺骗。在某些情况下,这可能是正确的(大多数首席执行官都会编造叙述),但我怀疑这是否是绝对的。例如,奥特曼一直表达对人工智能生存风险的担忧,并呼吁进行监管——郝暗示,鉴于他同时推动增长,这可能是表演性的。然而,有证据表明奥特曼确实关心安全:他成立了一个对齐团队,资助外部安全研究,并自愿向美国国会作证承认风险。当然,这些行动可能是战略性的,但它们也不是微不足道的——可以说,他在参与人工智能治理方面所做的工作比许多同行都多。这本书的怀疑视角有时会滑入对奥特曼动机的愤世嫉俗。我仍然不确定他是否真的像描绘的那样是两面派。内部批评(米拉·穆拉蒂和伊利亚·苏茨克弗担心他的行为)很严重,但在危机期间几乎所有员工都站在奥特曼一边。这表明员工将他视为真正的领导者,而不是骗子。奥特曼有没有可能既相信自己的使命,又对他如何传达使命非常精明?我认为如此。郝把它描绘成非此即彼——他要么诚实,要么是一个纵者——这感觉过于非黑即白。我还注意到这本书并没有真正公平地改变奥特曼自己的观点(可以理解,因为他没有合作)。没有他的声音,肖像会情不自禁地偏向负面。我怀疑关于山姆的真相可能处于灰色地带:他是一个有传教士倾向的远见卓识者,也是一位精明的首席执行官,有时会掩盖真相(董事会的投诉暗示了可能的秘密项目或淡化的问题)。这种二元性的细微差别有点丢失了。简而言之,我并不完全相信山姆·奥特曼像叙述所暗示的那样负有独特的责任或邪恶。他当然是 OpenAI 故事的核心,但我将一些结果(好的和坏的)归因于一个人个性之外的因素——例如来自投资者的激励措施、来自谷歌等巨头的竞争压力等。这本书的矛头如此坚定地指向奥特曼的“独特驱动力”,以至于它冒着英雄反派被简化的风险。我在这里仍然持怀疑态度,希望对奥特曼的贡献与他的缺陷进行更平衡的评估。

- 安全努力打折扣:郝对 OpenAI 的安全缺陷持批评态度是正确的,但我觉得她对他们在这方面所做的工作几乎没有给予任何赞扬。这种叙述有时听起来像是 OpenAI 鲁莽地冲锋陷阵,不顾安全。实际上,OpenAI 已经实施了多种安全机制:他们对新模型进行广泛的红队测试(GPT-4 系统卡列出了对偏见、滥用等的评估),他们迭代地完善内容过滤器,并发表关于对齐的研究(例如,InstructGPT 是一篇关于使用人类反馈使模型更安全的论文)。现在,有人可能会说这些措施不够或以公关为导向——郝确实如此。但我对隐含的全有或全无立场持怀疑态度。例如,她指出 OpenAI 在训练数据方面缺乏透明度,这是有道理的,但没有提到他们包含广泛的风险披露(系统卡),这是模型行为(如果不是关于数据)的新开放水平。这本书强调了 OpenAI 没有分享的内容,而不是他们分享的内容——一种微妙的遗漏偏见。此外,在讨论人工智能风险时,郝与担心流氓人工智能的“末日论者”保持距离,关注当前的危害(我对此表示赞赏)。然而,OpenAI 自己保密和仓促的理由很大程度上是因为他们认真对待这些极端风险(这是否是一个有效的借口还有待商榷)。这本书并没有真正探讨这种细微差别:如果奥特曼真的担心与中国或恶意行为者进行对抗性的 AGI 竞赛,人们就可以理解为什么他会说“我们必须迅速行动(在一些保密的情况下)以确保是我们这些好人首先到达那里。这也许是一个有缺陷的逻辑,但并非纯粹的唯利是图。我认为 Hao 对这一理由的怀疑是有道理的,但我仍然不相信 OpenAI 根本不关心安全的潜在暗示。它显然确实如此(章程、对齐研究等),只是可能并不像它关心获胜那么重要。我的观点是,OpenAI 在安全和雄心之间存在紧张关系;这本书经常将其描述为野心完全凌驾于安全之上。我怀疑 OpenAI 内部有人真正为安全而苦恼,即使该公司仍在推进。因此,我对 OpenAI 安全方法的一维描述持怀疑态度。它更复杂,具有讽刺意味的是,OpenAI 的结构(非营利监督等)试图对安全考虑进行硬编码——这是很少有其他公司尝试过的。这本书承认这种意图只是为了强调它的失败,这是公平的,但没有承认至少他们尝试了一种新的治理模式,而不是任何纯利润的人工智能初创公司。

- 缺乏反驳声音和更新进展:由于 OpenAI 和 Altman 没有合作,这本书严重依赖外部或以前的声音。我注意到当前内部人士的观点很少(可以理解,因为他们可能无法畅所欲言)。这意味着叙述可能会倾向于心怀不满的前雇员、竞争对手或有自己偏见的观察者。例如,如果 Ilya Sutskever(于 2024 年 5 月离职,并于 2024 年 6 月推出 Safe Superintelligence Inc.)或 Mira Murati 在董事会事件发生后接受采访,他们可能会提供他们最初对 Altman 采取行动的原因(我们有他们提出担忧的二手信息,但没有他们事后的反思)。这本书没有包括当奥特曼回来和董事会重组时他们的感受。他们接受了这个结果吗?他们觉得任务受到损害还是被拯救了?我们从郝的叙述中得不到。这是让我持怀疑态度的缺失部分——安全强硬派可能有合理的观点仍未解决,或者相反,他们反应过度。缺乏他们的声音意味着读者主要听到郝对事件的解释。此外,《人工智能帝国》于 2025 年年中发布,因此可能不包括一些最近的进展。在这样一个快速发展的领域,我担心这本书的信息可能已经有点过时或不完整了。例如,到 2025 年,许多公司(包括 OpenAI)已经签署了由白宫斡旋的自愿安全承诺(2023 年 7 月),并参加了英国的人工智能安全峰会(2023 年底)。OpenAI 甚至与谷歌、Microsoft、Anthropic 一起参加了行业前沿模型论坛,以合作解决安全问题。这些步骤表明了加强安全预防措施和合作的趋势(可能部分是由于公众压力)。然而,这本书似乎将框架定格在冲突和炒作的顶峰。它没有太多讨论监管和规范现在如何迎头赶上。我怀疑 Hao 的叙述可能无法完全解释到 2024-25 年公众监督和自我监管如何改变 OpenAI 的行为。例如,奥特曼推翻了如果《人工智能法案》过于严格,就会离开欧盟的威胁,最终同意遵守。OpenAI 还开始发布人工智能“使用指南”和政策,并与 NIST 人工智能风险管理框架等机构合作。这些不是灵丹妙药,但它们显示出“帝国”框架可能忽略的一些响应能力。简而言之,我怀疑 Empire of AI 倾向于对 OpenAI 轨迹进行最坏情况的推断,而实际上,反制力量(监管机构、民间社会、来自开源 AI 的竞争)可能会控制它。我在这里的怀疑基本上是:噩梦是不可避免的,还是有可能纠正方向?郝似乎很悲观;我更乐观地认为,她提出的问题现在已经得到广泛认可并得到解决(尽管速度很慢)。

- 选择适合论文的事实:作为一名研究人员,我不禁注意到《人工智能帝国》强调某些事实而忽略其他可能使论文复杂化的事实的时刻。这让我变得谨慎。例如,这本书强调了 OpenAI 的发布(GPT-3、ChatGPT)如何迫使竞争对手采取行动,但并没有真正提及 OpenAI 有时如何表现出克制。以 GPT-2 为例:2019 年,OpenAI 最初因担心被滥用而扣留了完整的模型(由于可能产生假新闻而导致著名的“分阶段发布”)。当时,他们因过度炒作危险而受到广泛批评——但这是他们优先考虑谨慎而不是宣传的一个例子。最终,经过进一步评估,他们确实发布了它。这种细微差别——OpenAI 对开放和谨慎的立场已经演变,有时甚至会转向相反的方向——没有被讨论。这将削弱单向走向保密和冒险的巧妙叙述。另一个微妙的例子:这本书称赞它如何“消除”对 OpenAI 的弥赛亚 AGI 信仰的怀疑,但没有探讨这样一个事实,即一些非常热衷于 AGI 的 OpenAI 关键人物(如共同领导 OpenAI 研究的 Dario Amodei)实际上离开了创立 Anthropic,部分原因是担心 OpenAI 不够谨慎。Anthropic 正在以安全第一的精神构建人工智能,尽管它仍然是一个营利性。这种背景可能表明,即使在 OpenAI 的队伍中,也存在不同的理念,那些不同意的人分拆了,而不是将奥特曼的道路视为福音。Hao 主要提到 Anthropic 是一个竞争对手,其传闻产品刺激了 ChatGPT 的早期发布,但没有讽刺 Anthropic 的创始人是前 OpenAI 人员,他们希望以不同的方式做事。包括这一点可能会使她单一帝国统治的故事变得复杂;如果你愿意的话,它展示了分裂的国家,这可能会挑战帝国。这个遗漏并不致命,但它对我来说很突出,因为它本来是一个相关的角度。这些例子让我有点怀疑 Hao 是否精心挑选了符合帝国叙事的事实,而淡化了那些引入复杂性或对位的事实。她是一位出色的记者,所以我不认为任何事情是彻头彻尾的错误——更多的是关于框架和强调。作为一名细心的读者,我保持着一定程度的怀疑态度,认识到《人工智能帝国》最终是一个批判性的叙述,而不是一部中立的历史。它有一个论点需要推进,证据也相应地被整理。这并不能否定证据,但这意味着人们应该考虑没有说的和说的。

我的怀疑集中在平衡和背景上。《人工智能帝国》有时读起来像是一份针对 OpenAI 的起诉简报——一份经过充分研究且通常有效的简报——但可能低估了人工智能行业实践和纠正力量的更广泛法庭。我仍然不相信一些更广泛的影响(例如,民主消亡的必然性,或者奥特曼是一个几乎被讽刺的帝国建设者)。我渴望得到更多的承认,OpenAI 并不是唯一的罪恶,并且多种真理并存:OpenAI 帮助推进了人工智能的好处(书中没有真正讨论),尽管它带来了新的风险;公司的领导者既有理想,也有雄心壮志;未来并不是一成不变的——我们正处于一个充满活力的时刻,许多利益相关者(政府、研究人员、用户)可以影响结果,而不仅仅是“皇帝”。

“OpenAILP 的主要信托义务是推进 OpenAI 宪章的目标,该公司由 OpenAI 非营利组织的董事会控制。所有投资者和员工都签署协议,OpenAI LP 对宪章的义务始终是第一位的,即使以牺牲他们的财务利益为代价。 (这是 OpenAI 的官方声明,尽管吸引了投资者,但任务是第一位的。郝的叙述后来展示了这种结构如何导致冲突——这句话是理想,但在实践中并没有完全实现。

我自己读后的观点比 Hao 的要宽容一些(或者至少是复杂):我认为 OpenAI 既不是英雄,也不是纯粹的恶棍,而是开拓者。郝的书极大地告知了这种观点,但由于上述保留意见,我对此持保留态度。

《人工智能帝国》有说服力地阐明了塑造当今人工智能竞赛的高风险决策和傲慢,但它对 OpenAI 的指责可能会让人感到不平衡。我的调查发现,虽然 OpenAI 确实偏离了其“开放”理想并面临有效的批评(正如 Hao 所记录的那样),但该书的一些可怕结论——例如,“人工智能帝国”不可避免地威胁到民主——被夸大了,而没有承认正在进行的行业改革、法规以及所有主要人工智能实验室都在努力解决类似问题的更广泛背景。

人工智能帝国如何融入更广泛的人工智能故事

这本书正处于人工智能叙事的关键时刻。这是同时发行的两本以 OpenAI 为重点的主要书籍之一——另一本是 The Optimist: Sam Altman、OpenAI 和 Keach Hagey 所著的《发明未来的竞赛》。有意思的是,这两部作品呈现出一种阴阳两面:郝氏的AI帝国“更广阔、更批判......更黑暗“,而 Hagey 的(大概从它的标题来看)更富有同情心或至少是乐观的。它们共同反映了人们对人工智能革命的看法的分歧:乌托邦式的承诺与反乌托邦的危险,有远见的领导力与傲慢的过度扩张。

郝对更广泛的人工智能话语的贡献坚定地站在怀疑和谨慎的一面。近年来,关于暂停先进人工智能、担心生存风险等的危言耸听的公开信和专栏文章激增(想想马斯克等人在 2023 年初签署的“人工智能暂停信”,或者奥特曼等人将人工智能风险等同于核战争的声明)。然而,《人工智能帝国》不仅仅是在重复这些高层次的恐惧,而是将讨论建立在企业和人类现实的基础上。通过这样做,它补充了穆斯塔法·苏莱曼的《即将到来的浪潮》(2023)等作品。DeepMind 的联合创始人苏莱曼也警告说,人工智能(和其他技术)的不稳定潜力,但从内部人士的角度出发,并提出了规范性的治理理念。郝的方法更具新闻/调查性:她“拉开了 OpenAI 内部运作的帷幕”,以展示为什么该行业在已知风险的情况下仍继续前进。从这个意义上说,《人工智能帝国》为人工智能故事中的“我们是如何走到这一步的”问题增添了宝贵的质感。它将焦点从抽象的厄运场景转移到问责制——命名设定轨迹的关键参与者、决策和冲突。

在更广泛的时间线中,这本书感觉像是过去十年人工智能发展的顶峰。它大约涵盖 2015 年至 2024 年,人工智能从一个小众研究领域发展成为全球主流现象(ChatGPT 于 2022 年底发布是一个拐点)。在科技史上,这个时代类似于 2000 年代互联网巨头的崛起——正如这些巨头受到审查(例如 Facebook 效应、谷歌暴露等)一样,我们现在看到了对人工智能公司的第一次深入审查。郝之前的报道(在《麻省理工科技评论》、《华尔街日报》等)经常质疑人工智能伦理和“人工智能殖民主义”——她的书将这些主题专门扩展到 OpenAI。我想说它适合一种技术批判文学类型,其中包括“快速行动并打破事物”、“九大”(批评大型人工智能公司)或肖莎娜·祖博夫的“监控资本主义”等标题。这些为社交媒体和大数据所做的事情,Hao 正在为人工智能实验室所做的一切,该实验室可以说开启了人工智能万物的时刻。

通过关注 OpenAI,Empire 不可避免地也讲述了埃隆·马斯克 (Elon Musk) 对公司的影响(和决裂)、Anthropic(由 OpenAI 前员工创立)等竞争对手实验室的崛起以及与谷歌/DeepMind 的竞争紧张关系的部分故事。 事实上,在谷歌的故事背景下阅读这篇文章很有趣:DeepMind 于 2014 年被谷歌收购,承诺永远解决情报问题,但在 2018 年之后,它在谷歌的控制下进行了重组,透明度也降低了。与此同时,谷歌自身在 2020 年的人工智能伦理崩溃(解雇研究人员)以及 2023 年对 ChatGPT 的恐慌反应表明,许多人工智能“帝国”都在类似的问题上跌跌撞撞。我发现郝的作品通过说明一个共同的模式来补充这些事件:宏伟的使命与企业现实的碰撞。她认为 OpenAI 不惜一切代价扩大规模的模式成为行业默认的见解意味着,她所记录的不仅仅是一家公司的故事,而是该领域的缩影。

在更广泛的人工智能安全与人工智能加速辩论中,郝的书加强了安全/监管方面的理由。我认为,它为政策制定者提供了素材。如果我是阅读本文的监管机构,我会更加相信,透明度要求、审计授权,也许还有人工智能领域的反垄断行动等事情对于控制“帝国”是必要的。时机(2025 年)是关键:世界各国政府正在制定人工智能法律。例如,欧盟人工智能法案将明确要求公司记录训练数据并评估风险——本质上是解决郝提出的一些批评(例如对数据和影响的保密性)。美国尚未立法,但正在讨论;奥特曼本人提议向国会授权先进的人工智能开发。在某种程度上,《人工智能帝国》是一个新闻案例研究,强调了为什么这些监管理念会出现。它显示了行业自我监管的裂缝。

另一个广泛的背景是公众对人工智能的看法。2022 年底,当 ChatGPT 惊艳世界时,许多人对 OpenAI 和 Altman 感到敬畏,甚至称赞他们开创了生产力或知识的新时代。到 2023 年底,叙事变得更加怀疑(担心错误信息、失业等,以及董事会政变剧播出肮脏的衣物)。郝的书直接谈到了这种转变,有效地说:“在那个奇迹的幕后,这是真实发生的事情——而且并不全是美好的。它有助于对人工智能进行更现实、也许是愤世嫉俗的公众叙述。十年后,当我们回顾过去时,这样的作品很可能会被认为是捕捉到人工智能炒作遭到强烈反对的那一刻。这让人想起最初围绕社交媒体的乌托邦叙事如何让位于 Facebook 等人如何不当处理数据和社会影响的揭露。人工智能正在重复这个循环,郝的书是人工智能“快速行动和打破事物”阶段的首批全面回顾之一。

另一个角度:这本书也触及了人工智能的地缘政治故事。通过讨论奥特曼“如果不是我们,那么中国”的言论并比较帝国,它与全球种族概念联系在一起。今天的人工智能故事部分是美国与中国(OpenAI 牢牢地站在美国/硅谷阵营中)。郝没有深入研究中国的人工智能工作(除了可能提到百度之外),但她对善良帝国与邪恶帝国叙事的批评表明,她对将其视为纯粹的东方与西方持怀疑态度。相反,她认为问题在于企业的集中度,而不是它飘扬的旗帜。这是对话语的微妙补充——许多声音就像“我们必须在人工智能方面击败中国”。郝暗示,心态本身就是公司用来为不负责任的行为辩护的陷阱。从大局来看,这是一个有价值的观点:它提醒我们,真正的竞争也许应该是对人类负责的创新与不对人类负责的创新,而不是美国与中国本身。

“OpenAI has reneged on its founding commitments to share its research and maintain transparency. Today, in pursuit of supremacy among its competitors, it operates with unprecedented secrecy.” — ScienceNews article questioning AI empires.

Empire of AI fits in as a timely, critical checkpoint in AI’s ongoing story. It’s the kind of narrative that often surfaces when a technology hits its adolescence — when wild growth spurts start causing growing pains, and society begins to question the wonderkids. Hao’s book is part of the maturation of the AI conversation, injecting healthy skepticism and concrete case studies into a discussion that can be quite abstract. It balances out the more optimistic or glorifying accounts by ensuring that history records the controversies, not just the triumphs. As someone who avidly follows AI news, I see this book as a needed counterbalance to the glossy press releases and hero narratives. It doesn’t cover everything (like the open-source movement, which is another big part of the AI story pushing back on closed empires), but it nails the theme of unchecked power in a way that resonates with other movements in tech. If the broader story of AI is a tug-of-war between possibility and peril, Empire of AI weighs in strongly on the peril side, backing it with evidence from one of AI’s chief architects. Whether one fully agrees or not, it’s now part of the canon that future historians of this era will likely reference.

Fairness, Sourcing, Readability, and Omissions

公平

《人工智能帝国》毫无歉意地是一个批判性的叙述,随之而来的是某个角度。我认为这本书在事实准确性上是公平的,但在语气和重点上是不平衡的。郝显然努力联系所有关键人物征求意见(她指出 OpenAI 和 Altman 拒绝合作)。她还披露了她的方法——260 次采访、信件、文件,甚至诉讼作为来源。采购的透明度增强了信任:作为一名读者,我觉得她不是在编造事情;有证据的骨干。公平性可能受到质疑的地方在于解释。这本书经常推断动机或暗示超越原始事实的价值判断。例如,将 OpenAI 对 AGI 的信念描述为具有“救世主的底色”是一种定性框架(尽管有大量轶事支持!有些人可能会争辩说,这是一个沉重的特征。然而,鉴于所提供的证据(肖像,内部人士使用的准宗教语言),我发现她得出的结论是公平的——即使它很有力,也不是毫无根据的。

也就是说,整本书中都暗流涌动着怀疑或愤世嫉俗,可能会给人一种偏见的印象。郝很少给 OpenAI 带来怀疑。当某件事可以有两种解读方式时——例如,他们转向营利性是出于贪婪还是出于必要?——她倾向于愤世嫉俗的观点(这从根本上与他们的使命相悖,甚至是虚伪的)。一个更慈善的看法可能是,OpenAI 认为它必须获得资金才能与谷歌竞争并保持其使命。这本书并没有真正接受这种叙述,只是指出了他们陈述的原因,然后她将其拆解。这很好——这是一部议论文作品,而不是中立的报告文学——但读者应该认识到这个角度。就对山姆·奥特曼的公平性而言,正如所讨论的,这种描述有些没有同情心。有些人可能会觉得它转向个人批评(例如,暗示他经常撒谎或捏造真相)。然而,具有讽刺意味的是,奥特曼自己的公开声明提供了可信度——董事会称他不坦诚,并为处理不当的纠纷道歉,这一事实表明,哪里有烟,哪里就有火。所以我想说郝很强硬,但考虑到她所发现的,在公平的范围内。这只是不是一个平衡的帐户,因为从设计上讲,它是对 OpenAI 自我描述的平衡。

采购

郝的来源是这本书的优势之一。她将内部资源(电子邮件、Slack、大概是泄露的文档)与访谈(260 个很多,可能包括前员工、行业同行、学者等)和公共记录(法庭文件、博客文章等)相结合。在我的整个阅读过程中,我看到了外部文章证实的多个观点:NPR、商业内幕(她自己摘录了那里)、卫报、纽约客等。例如,董事会政变等关键事件得到了主流新闻的证实;《纽约客》评论中奇怪的静修仪式证实了她的故事;调查作品的劳动剥削。她还引用了 OpenAI 自己的章程和博客声明,将言辞与现实并置。这种多管齐下的来源赋予了这本书可信度。如果有的话,我很钦佩她如何将大量材料提炼成一个连贯的故事。末尾的注释参考书目(或来源注释)可能会很长。作为一名读者,我很少觉得“这种说法从何而来?

采购棘手的一个领域是内部动机。例如,“他们决定因为谣言而匆忙使用 ChatGPT。我们怎么知道?她可能是从对在场决定的人的采访或看到内部聊天中得到的。《商业内幕》摘录(郝撰写)明确描述了那次会议。所以我相信她有文件。但由于这些消息来源是机密的,因此人们必须相信她的话。考虑到她的声誉以及她甚至提到次要角色(例如领导 ChatGPT 界面团队的 John Schulman)的事实,我认为这是可信的。读起来不像一个虚张声势的人。我会给采购的彻底性打 A 分。

可读性

郝是一位清晰而引人入胜的作家。这本书(近 500 页)读起来显然像是科技报告文学和企业惊悚片的混合体。在摘录中,我注意到她可以以一种易于理解和扣人心弦的方式设置场景并讲述对话。例如,人们在发布前一天晚上对 ChatGPT 的用户数量下注的描述,或者奥特曼被解雇的戏剧性时刻——这些几乎都是小说般的写法。她大部分时间都避免使用沉重的行话;当出现技术概念(如“变压器”或“AGI”)时,她通常会提供快速入门知识。这向非专业读者开放了它。从我收集到的内容中,节奏很快——她从一个关键的情节跳到另一个情节(创始、GPT 成就、Microsoft 交易、内部裂痕等)。如果有的话,有时类比(与历史帝国)或框架可能有点刺耳(像“灾难资本主义”这样的章节标题表明了她的观点)。但这并不影响可读性;它实际上强化了读者的主题,使复杂的故事在主题上更加统一。我并不觉得她的写作耸人听闻——是的,这是戏剧性的,因为事件是戏剧性的,但她没有使用紫色散文或毫无根据的夸张。她让事实和引言发挥作用。例如,直接引用奥特曼或其他人的话通常足以引起人们的注意,而无需她插入形容词。她显然还使用人类故事(如员工的反应、奥特曼的个人背景)来为叙述奠定基础。这很好——它提醒我们这是一个关于人的故事,而不仅仅是技术。所以可读性很高;我想即使是那些对人工智能不深入的人也可能会关注并感兴趣。

Omissions and Bias

I’ve touched on some omissions: little input from current OpenAI leadership (since they declined, not Hao’s fault but still a gap), and not much on how open-source AI or non-profits (like academic research or nonprofits like EleutherAI) factor into the AI landscape. The book focuses on the titans — OpenAI primarily, with glimpses of Google, Meta, Anthropic. One could argue it omits the perspective of AI’s benefits or success stories. The title is “Dreams and Nightmares,” but the content I read was mostly nightmares or at least cautionary tales. Did Hao give any space to, say, how many users found ChatGPT genuinely useful, or how OpenAI’s tech has advanced science or medicine? Perhaps minimal, since her mission was to counter hype, she might have consciously downplayed the “dreams” part. A fair critique is that it’s not a balanced scorecard of OpenAI’s impact — it’s weighted toward negative externalities. If one were an OpenAI advocate, they’d say she omitted how e.g. GPT-4 is being used to help the visually impaired (Be My Eyes app) or how DALL-E opened creative opportunities. Those positive narratives are largely absent. That is a bias, albeit an intentional one given the stance.

Another omission: deeper exploration of solutions. The book is great at diagnosing problems, but aside from a general call to be cognizant and perhaps regulate (and the metaphor of how empires fall), it may leave readers wondering “what now?” This is common in investigative works — exposing is step 1, fixing is another book or up to others. Yet, I might have liked to see more discussion of what a more balanced OpenAI or industry would look like. For example, she could have mentioned proposals like slowing down certain research, or international oversight bodies, etc. The omission of a strong solution framework might frustrate some readers. Then again, the book is already sweeping in scope; adding policy analysis might bog it down.

在偏见方面,我要重申:偏见是怀疑/批评的。这是显而易见的,在我看来,大部分都有证据证明是合理的。但读者应该知道,他们本质上是在阅读一篇宣传文章——倡导更加谨慎、问责和检查人工智能领导者的傲慢。我认为郝除了对人工智能方向的真正担忧之外,没有个人斧头可以磨。鉴于奥特曼对她的公开批评,人们可能会怀疑存在偏见(他在推特上说有些人扭曲了事情,大概是指她)。但看看她如何呈现事物,我没有看到恶意的虚假陈述。她用了很多 OpenAI 自己的话来反对他们(这是公平的游戏)。例如,引用《宪章》的理想,然后表现出相反的行为,这是一种强有力的技巧,既事实又尖锐。

谁被排除在外

可能是最终用户或公众的观点。这本书非常内向地关注公司和行业。我们没有收到从人工智能中受益的小企业主或遭受人工智能影响的虚假信息受害者的消息。包括一些受影响人员的小插曲可能会扩大范围。但这也可能削弱焦点。同样,来自政府或监管机构的声音也不突出。也许她采访了一些政策制定者,但在摘录中并没有强烈地体现出来。叙述很大程度上是关于技术内部人士的。有人可能会批评它向具有技术意识的读者说教,并且可能与更关心人工智能如何影响他们生活的外行人建立太多联系。

不过,总的来说,考虑到有限的页面和她的叙事重点,这些遗漏是可以理解的。这本书来源详尽,在提供证据方面相当公平,但它不是中立的——它是对轨迹的控诉。我认为只要读者意识到这一点,这是可以接受的。事实上,坦率的立场可以说使它成为一本更引人注目的读物,即使这意味着你应该用其他材料来补充它(比如阅读奥特曼自己的陈述,或者哈吉的书)来了解全貌。

论证质量

还有一点注意——这本书的论点总体上是可靠的:主张——>用故事来说明——>也许引入历史类比——>把重点带回家。她偶尔可能会依靠类比(帝国、宗教),有些人会觉得很精彩,而另一些人会觉得夸张。但她没有犯下任何明显的逻辑谬误或抹黑策略。如果有的话,她对戏剧性轶事的使用可以被视为情感诉求,但这些轶事是事实和相关的,所以这是公平的说服力。

最终裁决,谁应该阅读它

《人工智能帝国》是一部严谨而引人入胜的深入探讨,揭示了人工智能革命的弱点。作为一个普遍对人工智能潜力充满热情的人,这本书让我感到谦卑和不安——以一种好的方式。它采用了我们这个时代最有影响力的科技故事之一(OpenAI 的迅速崛起),并将其重新讲述为一部充满冲突理想、权力游戏和道德十字路口的人间戏剧。郝的怀疑是炒作的解药:到最后,我当然对 ChatGPT 不再那么幻想了,而是更加认识到它创建背后的权衡和动荡。

我承认,有时我认为核心论点是严厉的——山姆·奥特曼作为与历史殖民者相提并论的帝国建设者的概念具有挑衅性,也许太过分了。但即使人们不相信每一个类比,事实核心也是坚实的:OpenAI 确实违背了承诺,确实秘密运作,确实引发了一场行业竞赛,并且确实面临着关于其方向的内部危机。在这些方面,郝证明了她的理由。如果她的语气有时对某个错误至关重要,我宁愿这样,也不愿自满。作为一名读者,我更喜欢作者有明确的立场,而不是躲在虚假的中立背后。

所以,我强烈推荐 人工智能帝国 - 但有一个警告。需要注意的是,读者应该将其视为一篇党派文章(在积极意义上):它在关于人工智能的辩论中提出了一种观点。为了全面了解情况,人们可能还想听听“另一面”——无论是 Altman 自己的账户、OpenAI 的博客文章,还是更乐观的 Optimist 书。但郝的工作本身就是一个很好的案例研究,说明崇高的科技愿景如何脱轨,以及科技力量如何受到质疑。

谁应该阅读它?

- 科技行业专业人士和人工智能研究人员:如果您从事人工智能领域,这几乎是了解您所在行业正在发生的事情的背景的必读之作。它提供了有关最高级别人工智能实验室如何做出决策以及要避免的潜在陷阱的见解。这可能会让人感到不舒服(与殖民主义相比,没有人喜欢他们的领域!),但这是一个值得努力解决的观点。

- 政策制定者和监管机构:对于试图了解人工智能治理的政府人员来说,郝的书是现实世界问题的宝库——从数据权利到公司治理再到国际竞争。它提供了可以为合理监管提供信息的具体例子(例如,为什么需要透明度、如果董事会缺乏多样性或监督权会发生什么等)。

- 技术怀疑论者和伦理学家:如果您来自伦理学、社会学或批判性技术背景,《人工智能帝国》可能会引起共鸣。它验证了许多调查细节的担忧。对于那些主张在人工智能中建立更多道德护栏的人来说,这基本上是一份证据礼物。

- 对硅谷戏剧感兴趣的普通读者:即使你不是“人工智能人”,人类的故事——一个有魅力的首席执行官、权力斗争、背叛、宏伟的愿景——读起来几乎就像《坏血》(Theranos传奇)或《社交网络》,但对于人工智能来说。这是一个引人入胜的企业叙事。请注意:与 Theranos 不同,这里没有任何违法指控——更多的是关于道德和策略。但对于任何喜欢了解有影响力的公司幕后的人来说,这仍然具有戏剧性和大开眼界。

- OpenAI 及其同行(是的,他们自己):我几乎想说 Sam Altman 和他的团队应该阅读这本书,尽管这对他们来说可能是痛苦的。这就像一面镜子,被一个密切关注他们的人举起。了解知情的局外人如何看待您的行为是有价值的。他们可能会对部分提出异议,但如果他们明智的话,他们也会吸取教训。例如,观察者可以将它们与殖民帝国进行比较,这一事实表明他们需要认真解决包容性、透明度和权力不平衡问题。

谁可能不喜欢这本书?只想要乐观的铁杆人工智能布道者可能会觉得它太消极了。此外,如果有人正在寻找对 GPT-4 工作原理的技术深入研究,这不是这样——这不是关于科学本身,而是关于人员和政策。这本书没有详述模型架构或功能,只是它们如何影响公司的旅程。

最后的思考

《人工智能帝国》是一部不完美的编年史,记录了科技史上的关键时刻。它无疑影响了我的观点——让我对人工智能中的英雄叙事更加了解和谨慎。这本书引发了关于“我们想要人工智能什么样的未来,谁来决定它?通过将讲故事与严谨的调查相结合,郝确保这些对话具有事实依据。出于这个原因,尽管我对细微差别提出了批评,但我认为它是成功的。这是我们需要的一本书,让我们从人工智能炒作的宿醉中清醒过来,清楚地看到风景——疣等等。

如果您完全担心人工智能巨头的无节制崛起,或者只是好奇地球上最热门的人工智能实验室是如何制作香肠的,那么《人工智能帝国》非常值得您花时间。

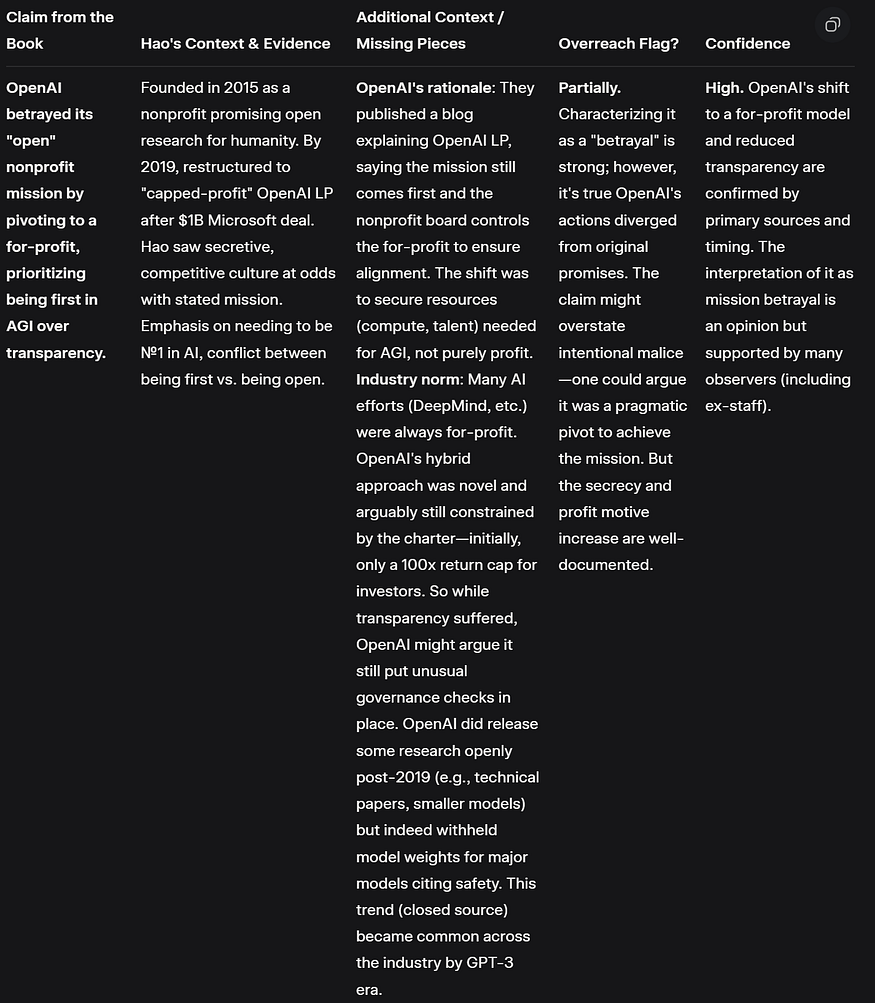

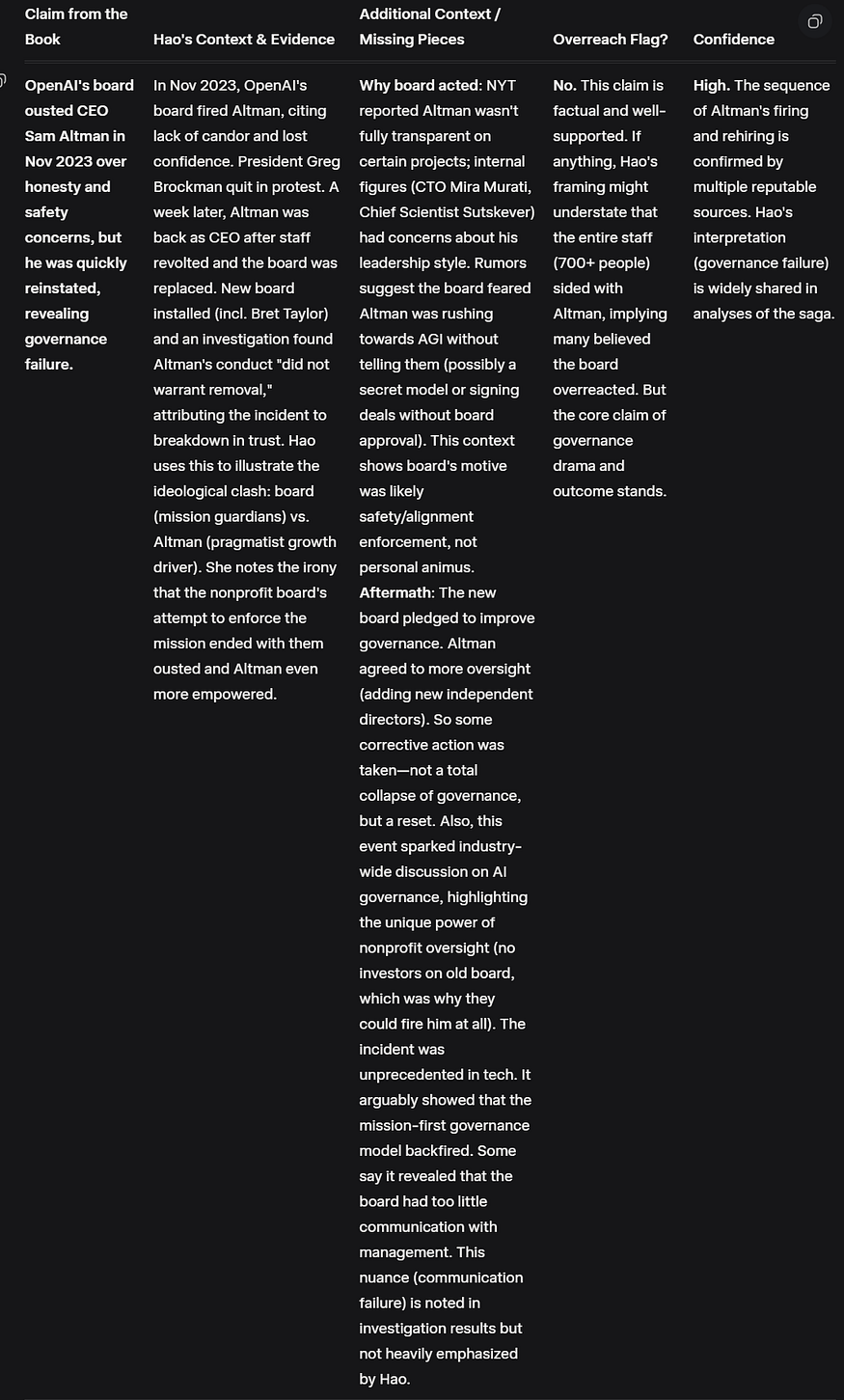

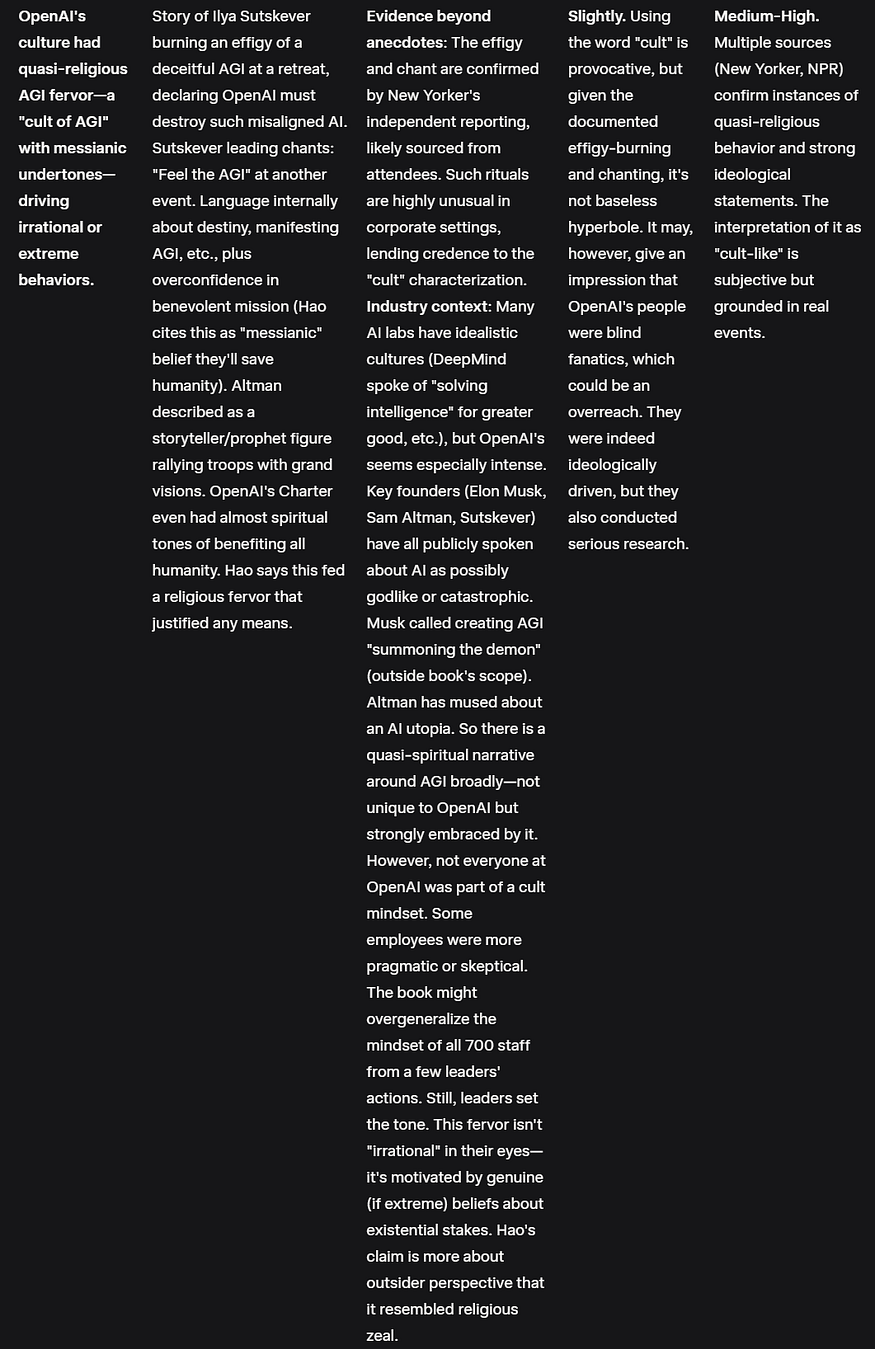

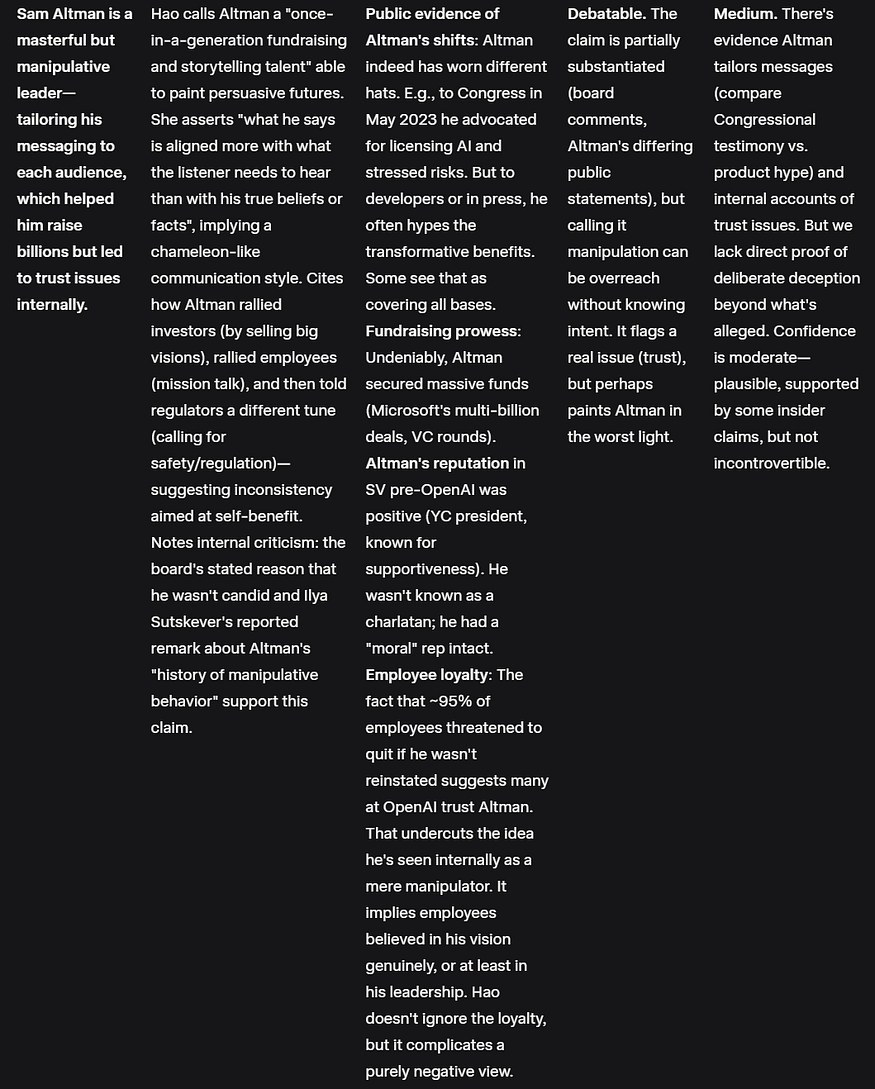

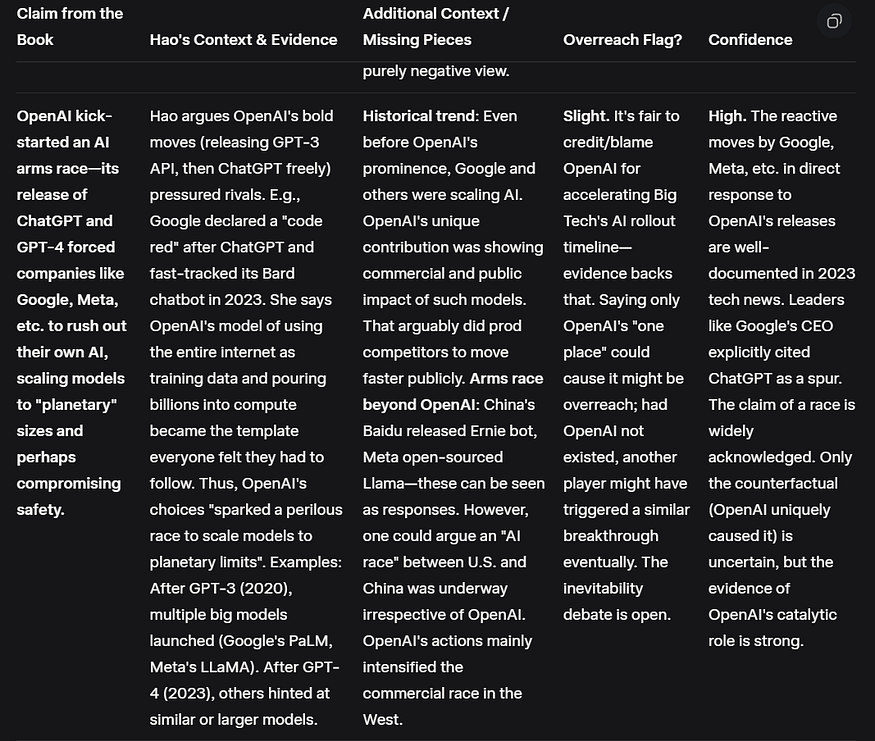

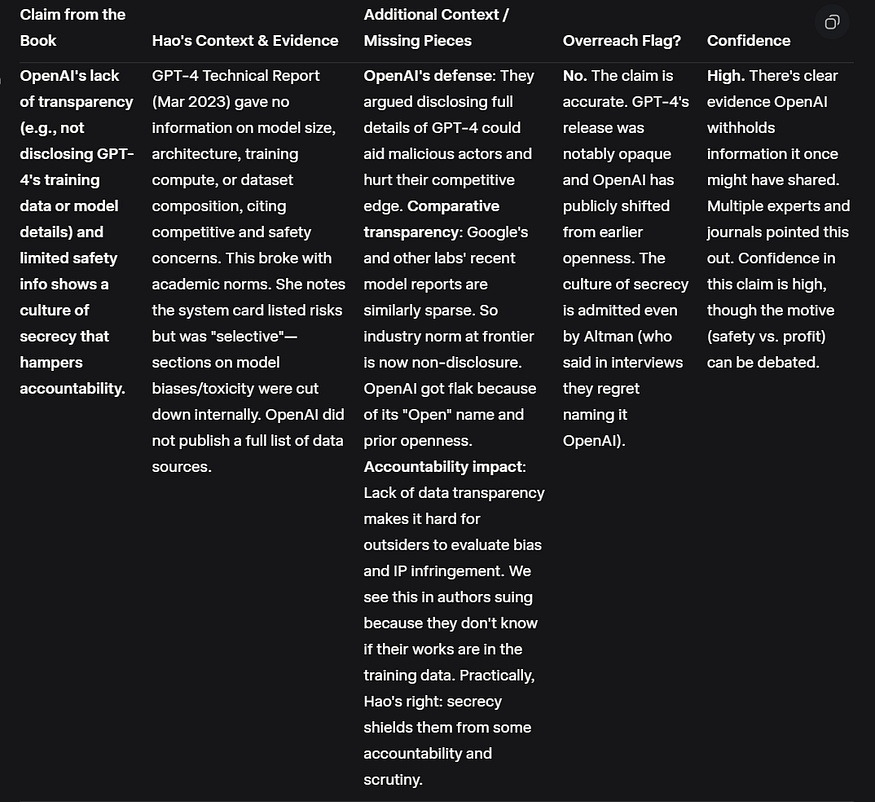

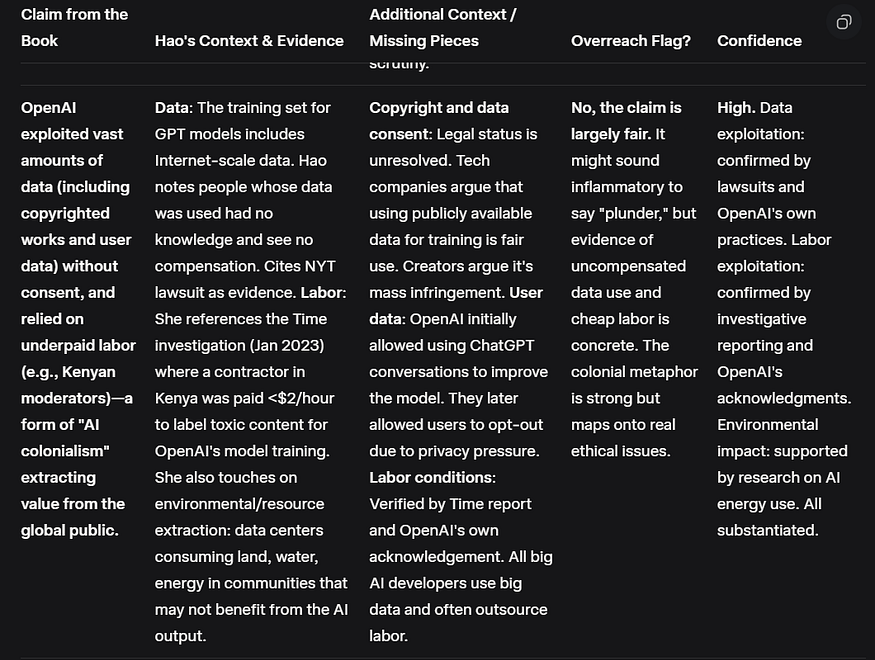

关键主张与现实检验

以下是人工智能帝国的主要主张矩阵,以及它们如何与外部证据相抗衡,包括任何缺失的背景或潜在的越权行为。

按 Enter 键或单击以查看大图

Press enter or click to view image in full size

按 Enter 键或单击以查看大图

按 Enter 键或单击以查看大图

按 Enter 键或单击以查看大图

按 Enter 键或单击以查看大图

按 Enter 键或单击以查看大图

按 Enter 键或单击以查看大图

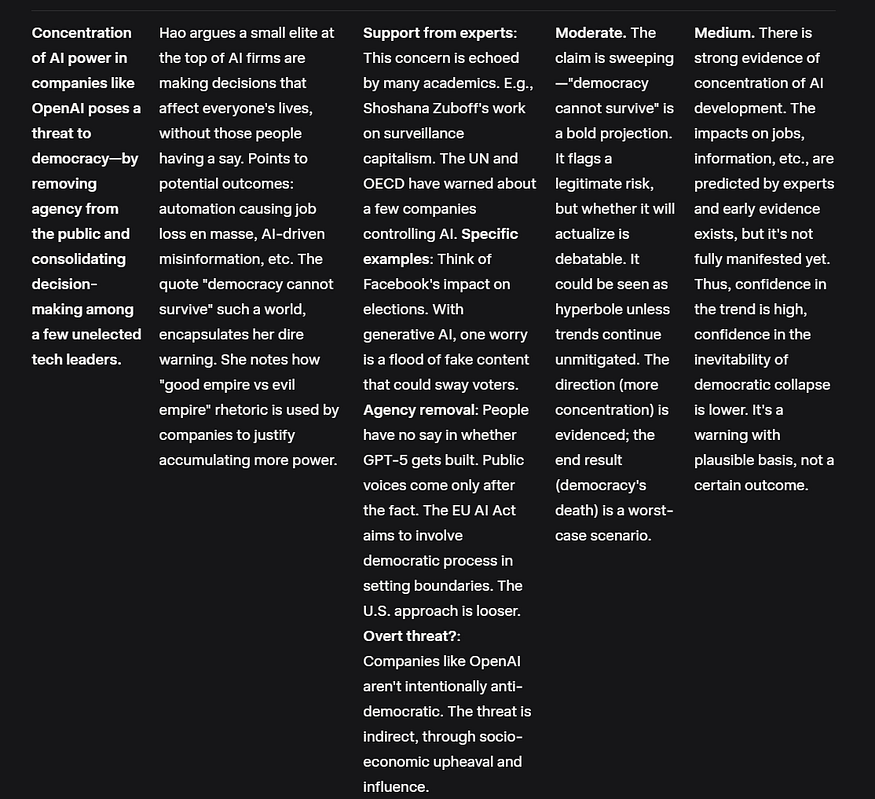

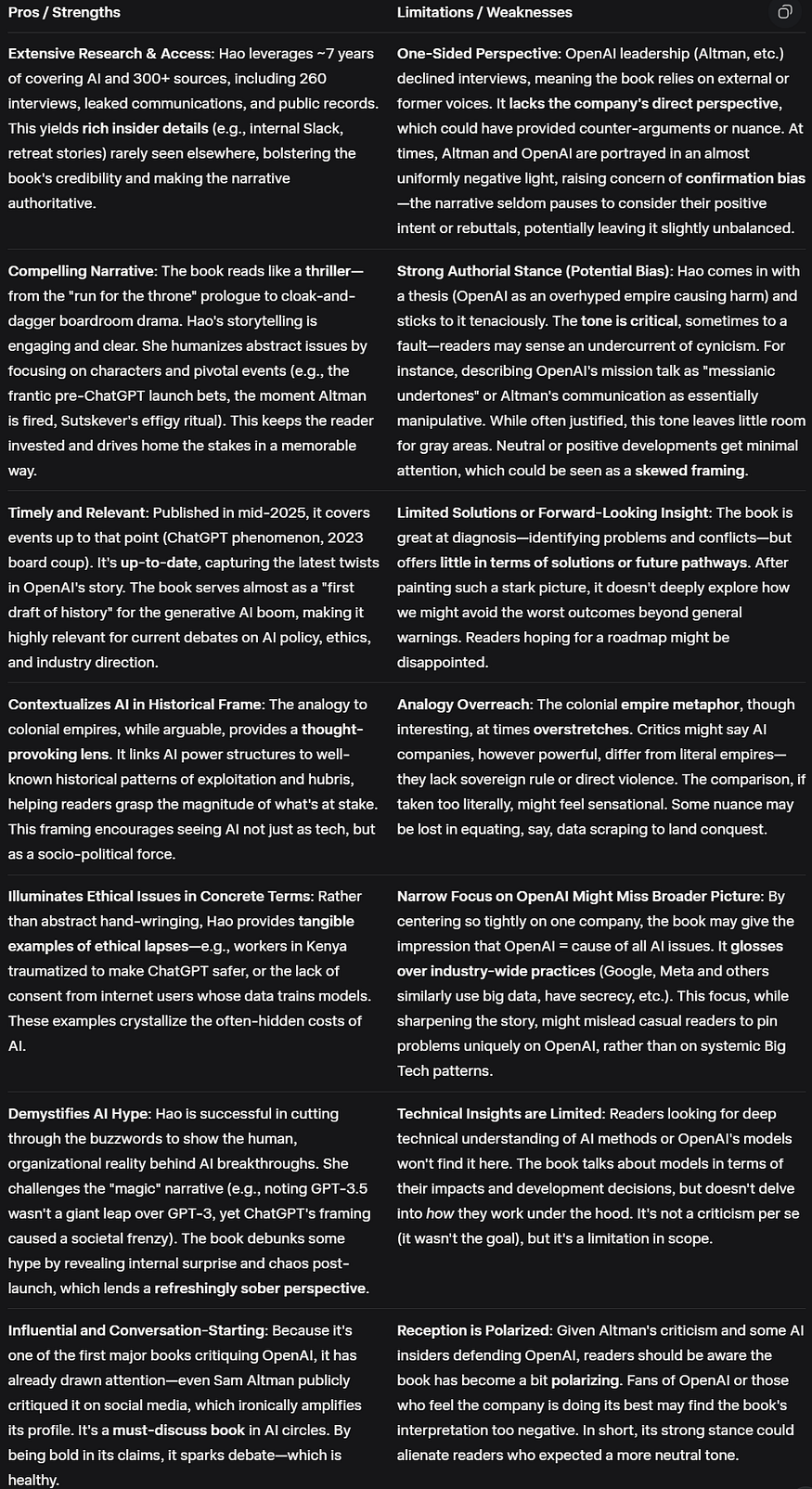

人工智能帝国的优点和局限性

按 Enter 键或单击以查看大图

人工智能帝国的事实是正确的,但结论是错误的。OpenAI 违背承诺并秘密运作——Hao 证明了这一点。但将奥特曼诬陷为建立邪恶帝国的殖民皇帝?

这就是她失去情节的地方。

祝您阅读愉快!

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)