DeepSeek本地部署和数据投喂

·

随着deep seek的爆火,越来越多人都会开始使用deep seek,想要来本地部署deep seek,在本地投喂自己的数据,训练自己的智能模型,只需四步,很简单!

一、下载ollama

- 下载适合自己电脑的版本,这是ollama的官网:Download Ollama on Windowshttps://ollama.com/download

https://ollama.com/download

https://ollama.com/download

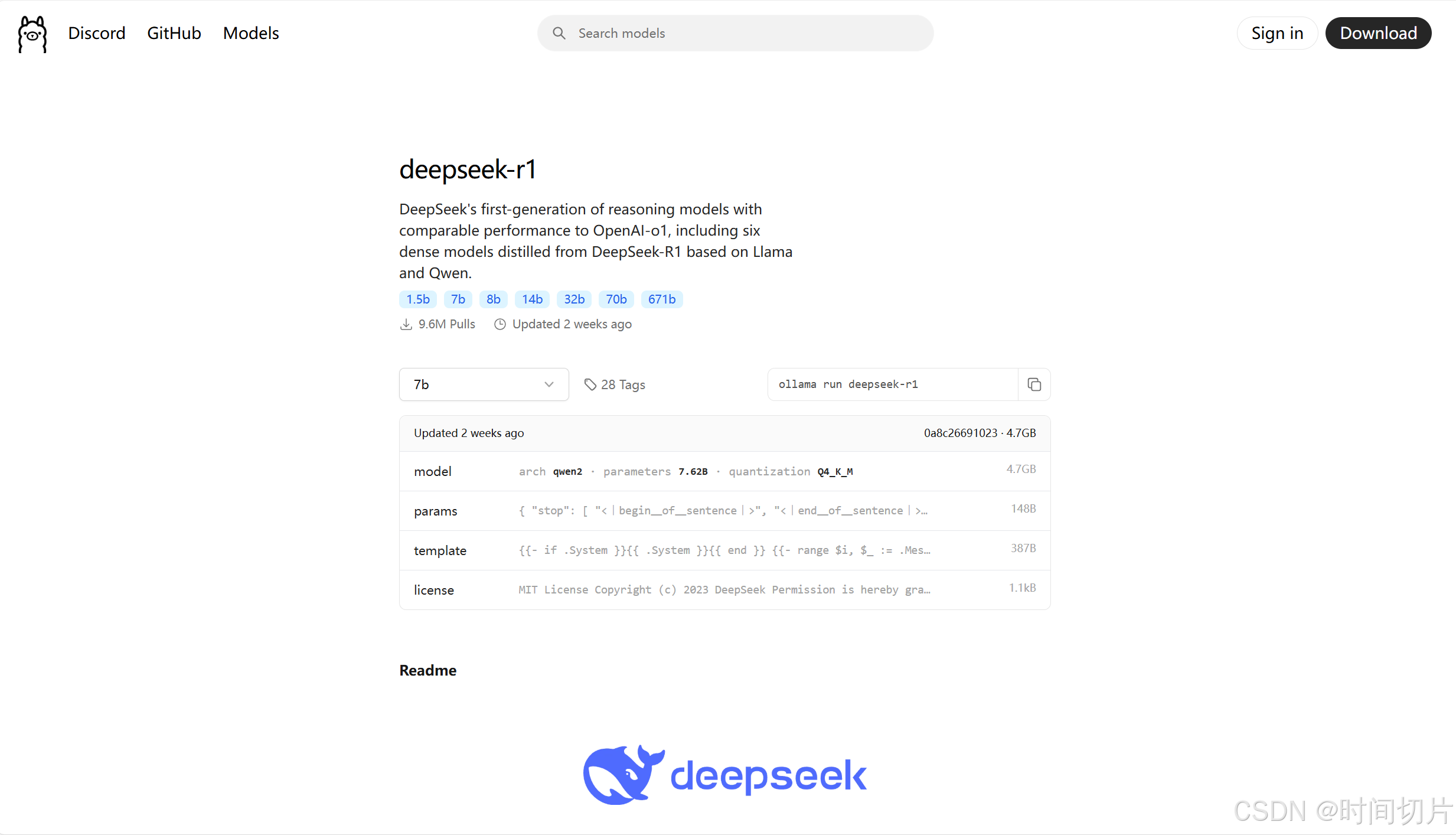

二、 在本地部署适合自己电脑配置的R1模型

- 这一步关键在于选择适合自己电脑配置的模型,这是模型的官网:

deepseek-r1https://ollama.com/library/deepseek-r1![]() https://ollama.com/library/deepseek-r1

https://ollama.com/library/deepseek-r1

- 配置参考

| 参考量 | 显存需求 | 显卡推荐 |

| 1.5B | 通常4GB左右 | GTX 1050 |

| 8B/7B | 一般8-10GB | GTX 1660 |

| 14B | 12GB以上,16GB以上运行流畅 | RTX 3060 |

| 32B | 16GB以上,21GB以上运行流畅 | RTX 3060 |

| 70B | 24GB以上,40GB以上运行流畅 | RTX 3090、RTX4090 |

| 671B | 1342GB | 16张NVDIA-A100 80GB显卡 |

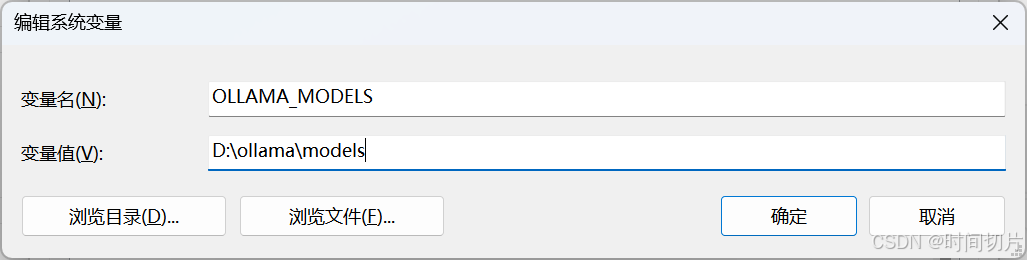

- 注意一点,ollama是默认安装到C盘的,下载的模型也会下载到C盘,这边建议改一下环境变量,变量值填模型放的位置,设置好重启一下,这样下载模型不怕站C盘内存。

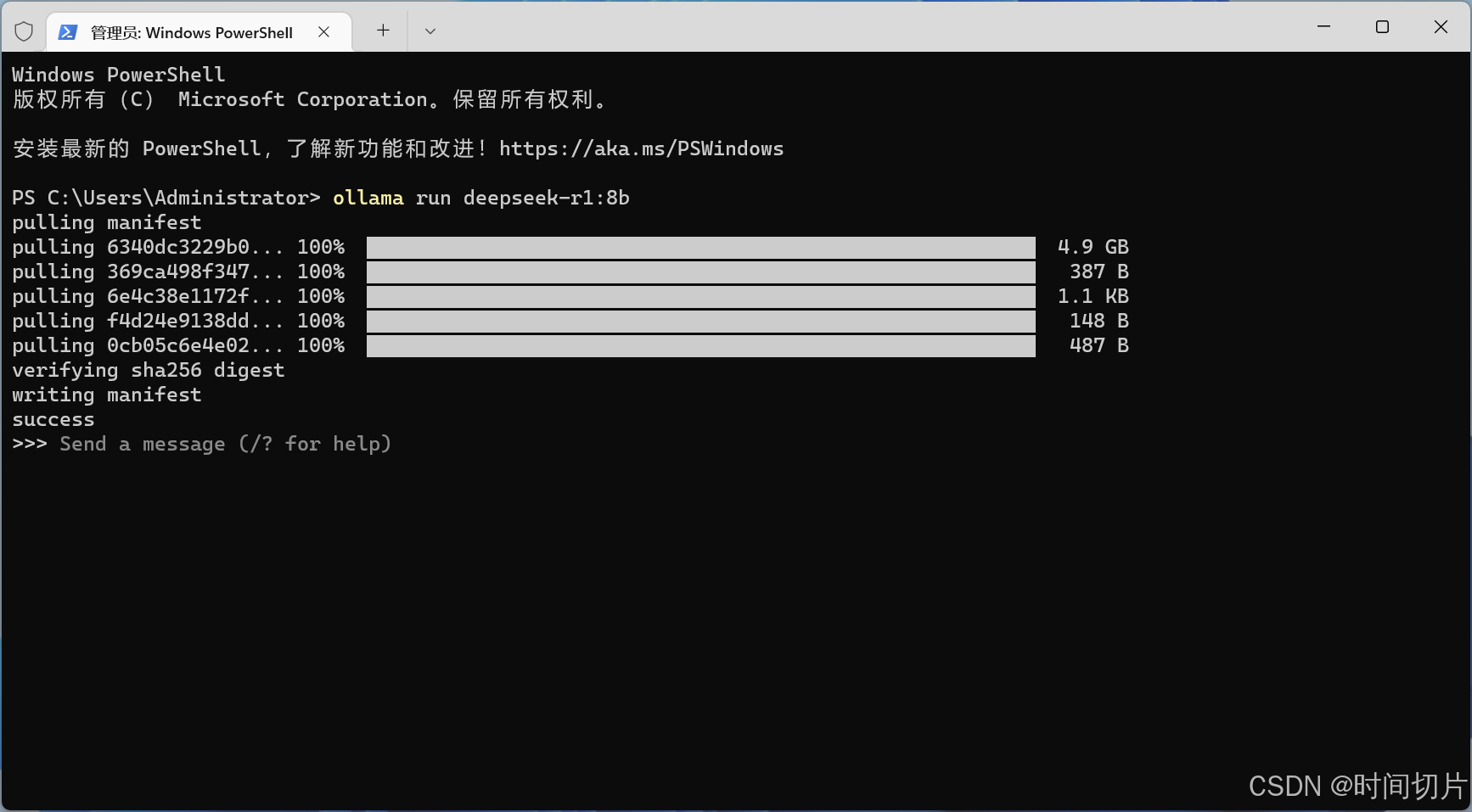

- 复制对应的代码,在终端运行

- 下载成功后,可以在命令行中运行模型,和其对话 ,ctrl+D推出对话

三、下载AnythingLLM并完成模型配置

- 下载安装AnythingLLM,这是官网:AnythingLLM | The all-in-one AI application for everyonehttps://anythingllm.com/

https://anythingllm.com/

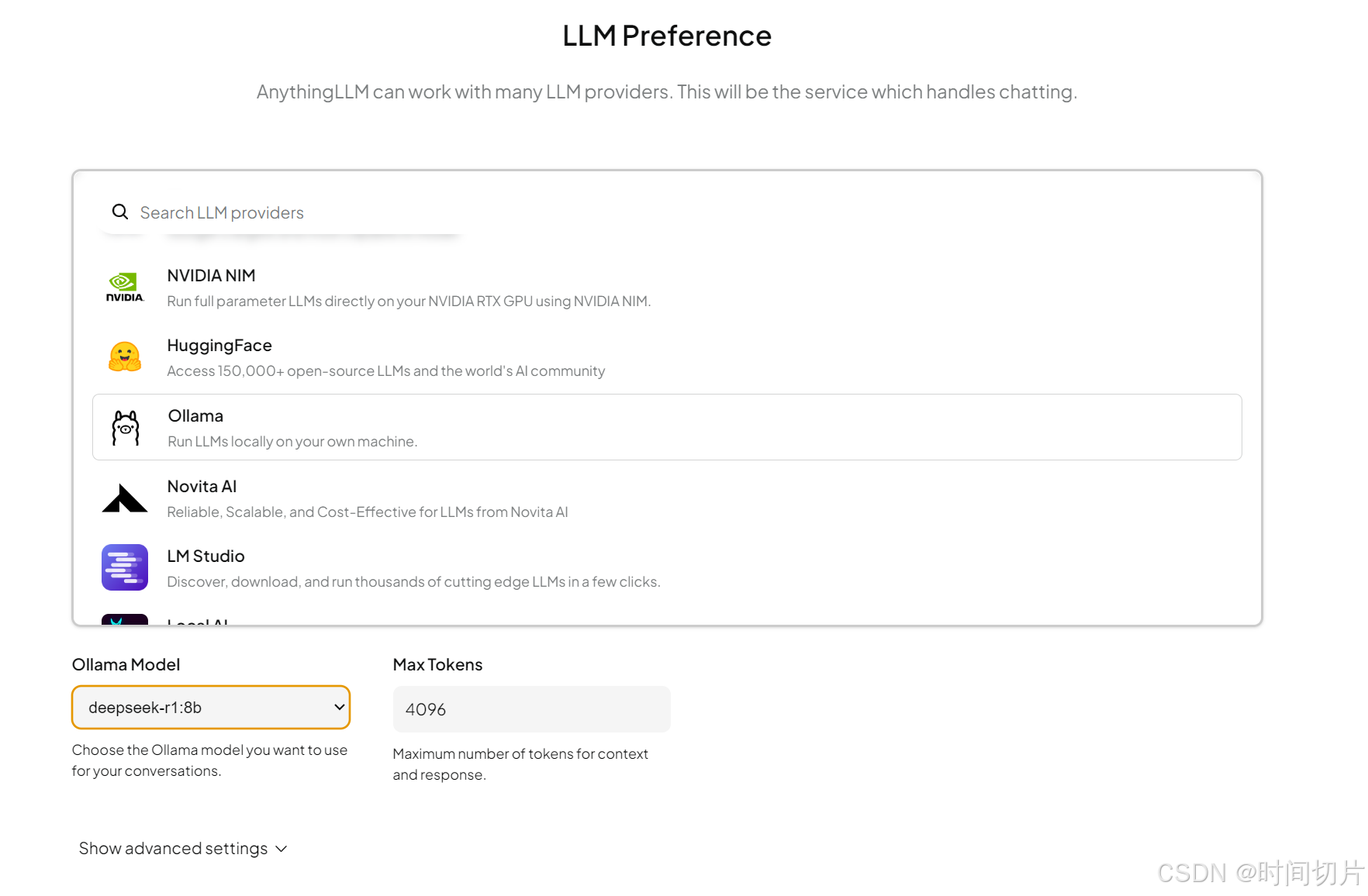

https://anythingllm.com/ - 下载好,点击进入选择ollama,选择自己下载的模型,之后下一步,最后完成工作区命名。

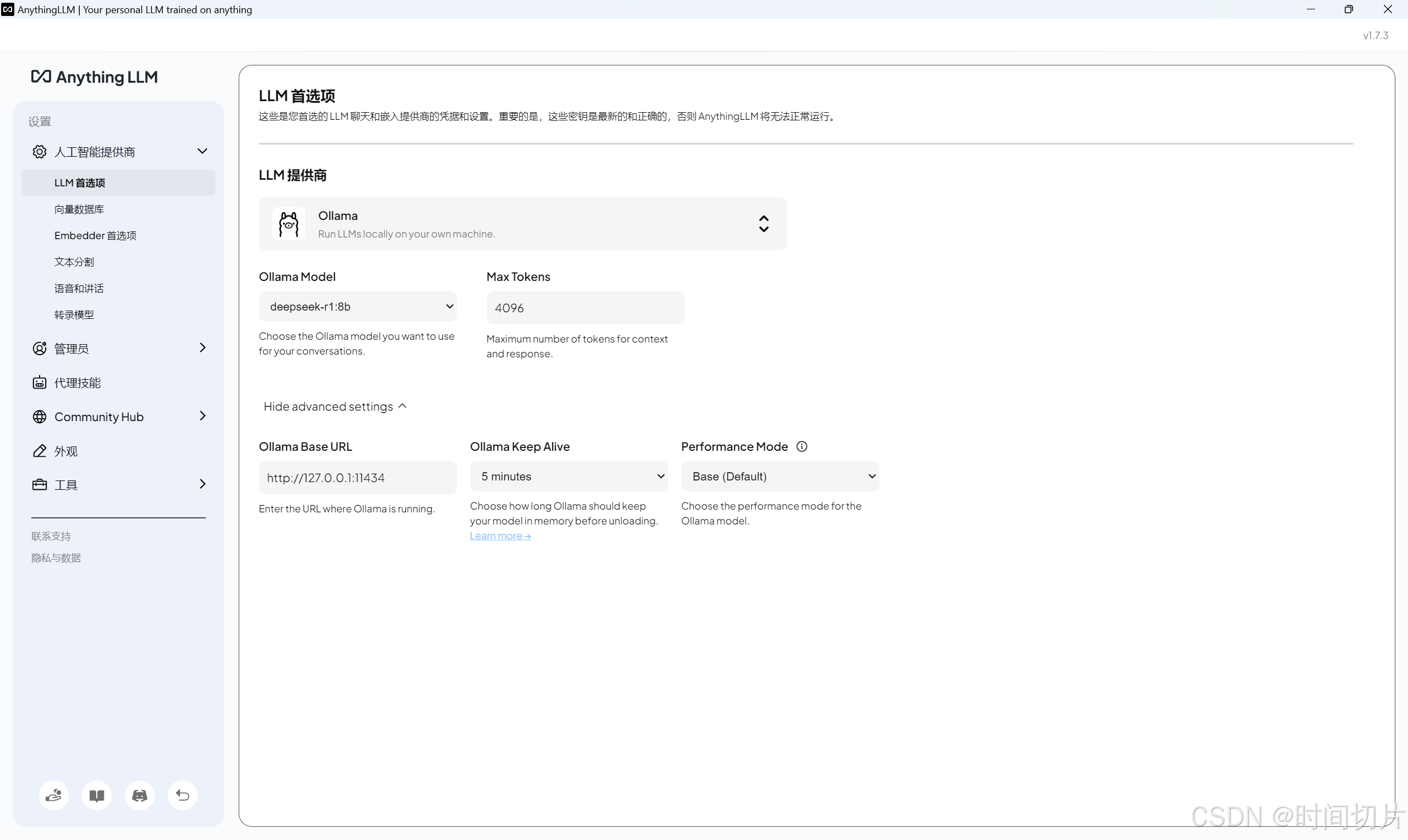

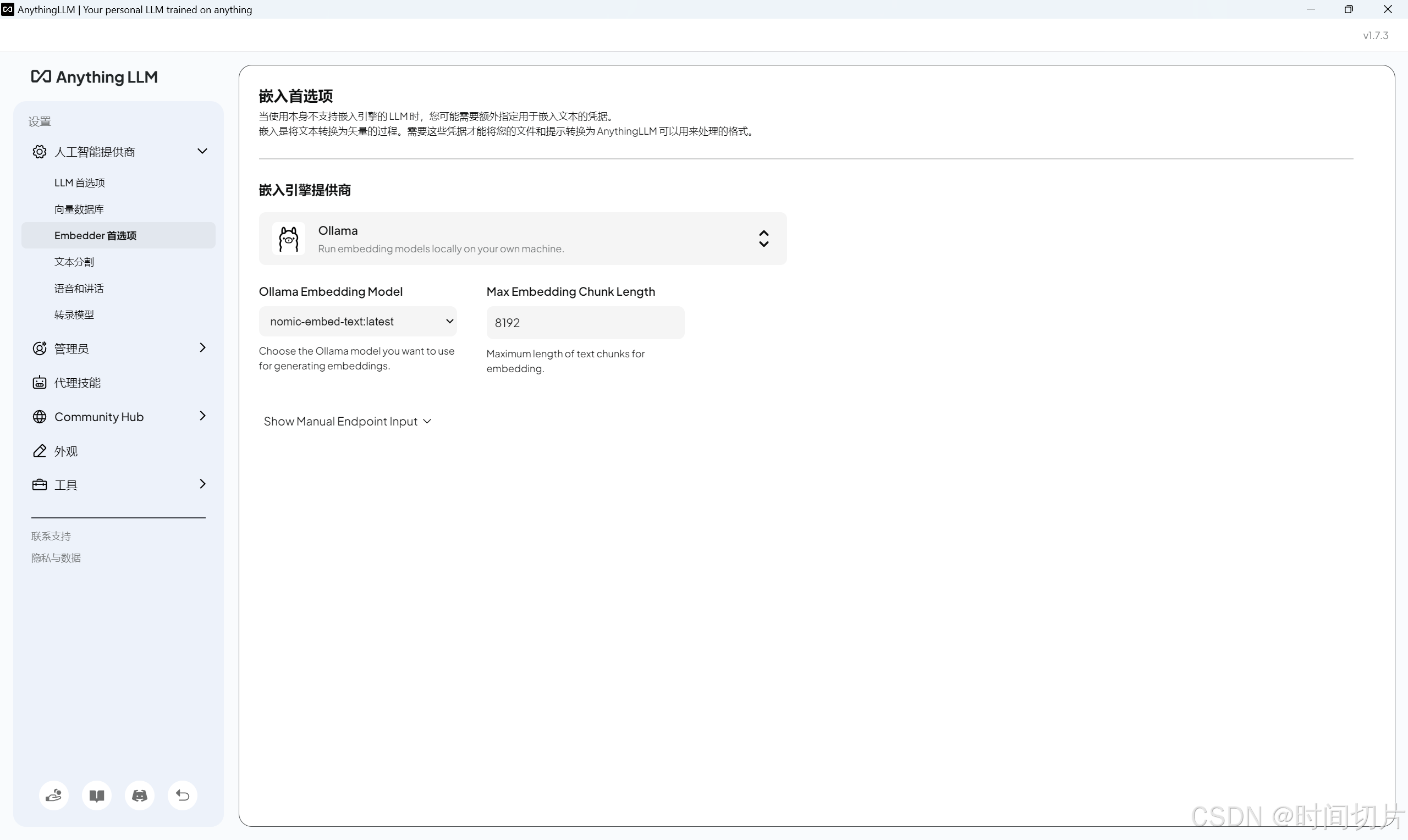

- 进入工作页面,点左下角的设置按键,修改人工智能提供商里的LLM首选项和Embedder首选项,配置后需点击保存才可生效,配置如下。

其中Embedder首选项里所需模型的下载步骤和deep seek的下载是一样的,都是在命令行运 行相应的代码,这是下载官网:

四、数据投喂

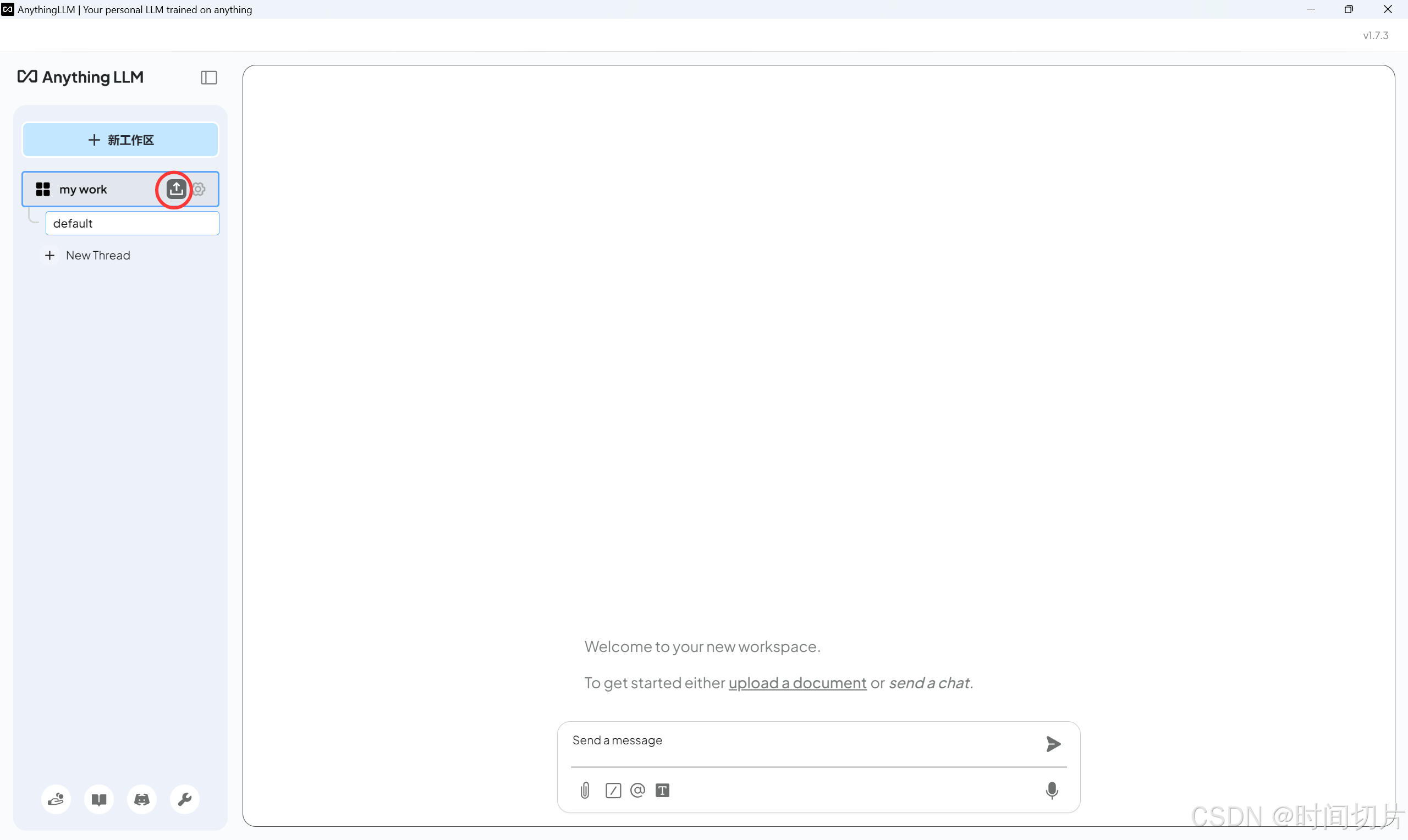

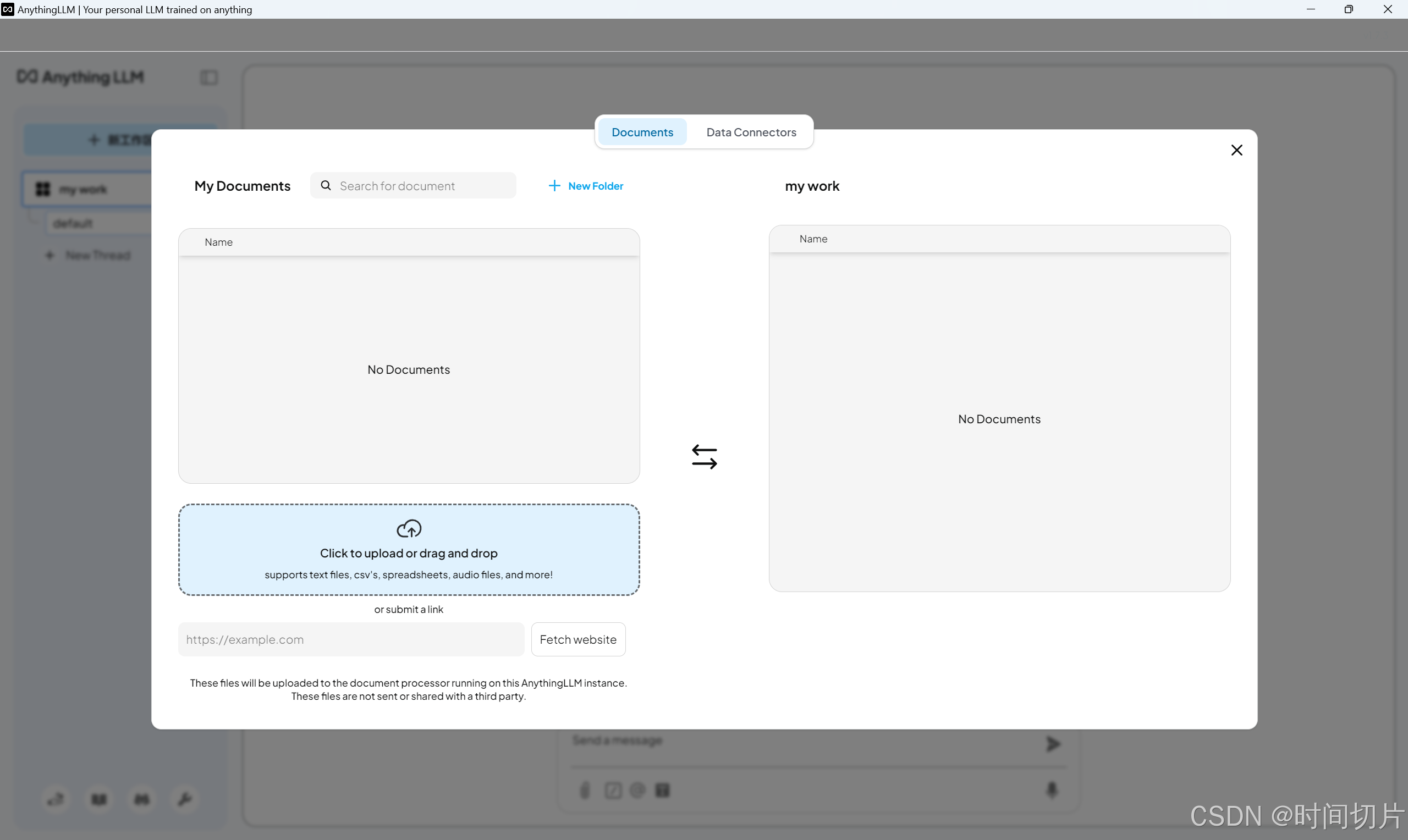

- 点击图片中圈出的位置,进行数据投喂后,模型会参考所投喂的数据回答相应的问题,目前投喂的数据仅支持文本文件、csv、电子表格、音频文件。

- 还有更多功能没有介绍,这些只是基本的功能。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)