生产级k8s云端部署v1.28.3

注意:如果你是用VMware的话就直接跳过1.3的操作。

目录

4.2.7创建ServiceAccount Key ——secret

6.2创建kube-controller-manager 启动服务

1.前期环境准备

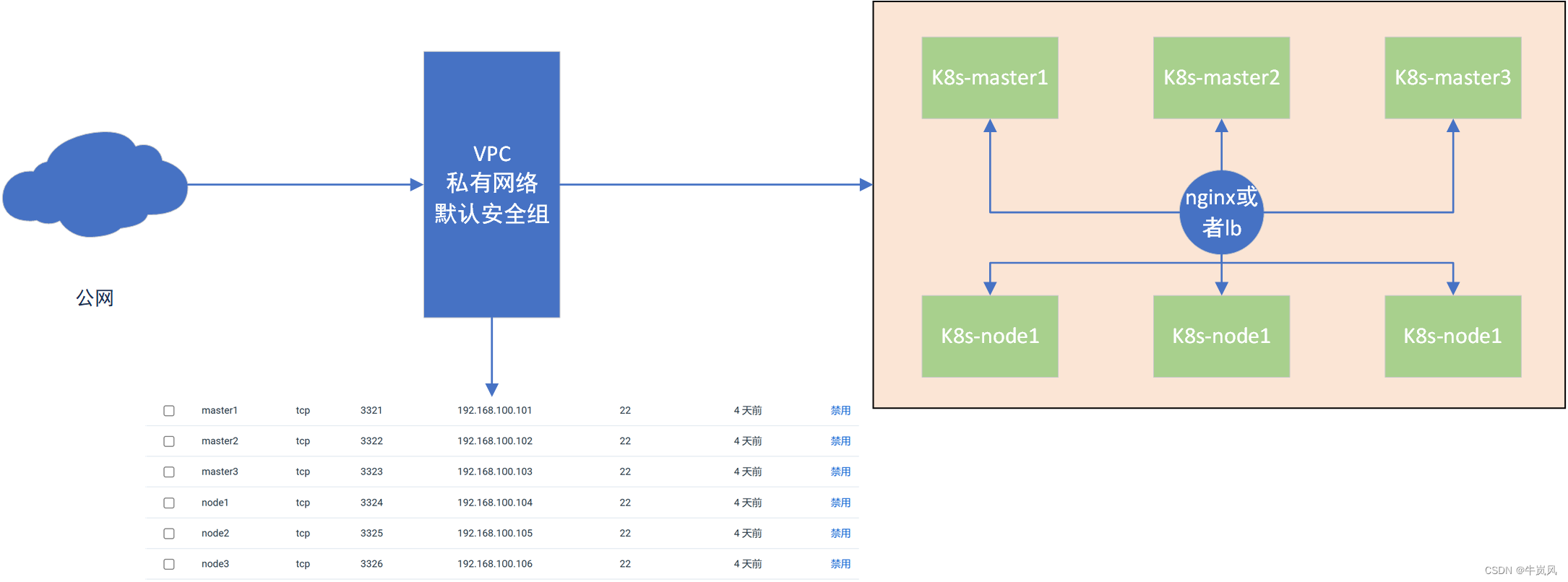

1.1集群架构图

1.2网络规划

| master1 | 192.168.100.101 |

| master2 | 192.168.100.102 |

| master3 | 192.168.100.103 |

| node1 | 192.168.100.104 |

| node2 | 192.168.100.105 |

| node3 | 192.168.100.106 |

| k8s版本 | v1.28.3 |

| pod网段 | 196.16.0.0/16 |

| Service网段 | 10.96.0.0/16 |

| 设备规格 | 2核4G(最低要求) |

| 系统版本 | centos7.9 |

注意:如果你是用VMware的话就直接跳过1.3的操作

1.3云服务器搭建

1.3.1购买云服务器

这里的云服务器搭建可以自行选择云平台,我这里用的是青云。

购买流程:先购买VPC 在购买云服务器

VPC:可以理解成一台交换机 给我们云服务器分配地址

1.3.2vpc购买流程

1.3.3云服务购买流程

重复上面操作在购买5台 ip根据前面的网络规划来

1.3.4购买公网IP

1.3.5公网绑定vpc

1.3.6添加VPC规则

因为我们只购买一个公网ip,所以到时候远程连接设备的时候需要通过IP加端口的方式来连接设备。为每一台设备绑定一个端口,流程如下:

端口源:这里是我们远程连接时所用的端口号

内网IP:就是我们服务器的ip地址

内网端口:这里是22号端口,ssh的端口号

应为我们添加了端口,所以要去安全组放行相应端口。操作如下:

下行规则:就是外网进来的策略

到这里基本环境已经准备好,下面通过远程工具来连接这些设备。

操作如下:

这里选择自己用的远程工具

注意:远程主机选择我们申请的公网IP ,用户root 端口选择我们上面VPC绑定的端口号,一台设备对应一个端口号

1.4 内核升级

因为我们要用ipvs的模式作为服务代理,而IPVS模式对Linux内核的要求是4.19及以上版本。IPVS相较于iptables模式在性能上更优,特别适用于大规模服务的负载均衡。

升级流程:

所有节点执行

注意:这里如果用的是VMware的话 需要选择阿里云的镜像,虚拟机要能上外面

阿里云镜像地址:没有wget用curl都没有就yum安装一个

wget -O /etc/yum.repos.d/CentOS-Base.repo https://mirrors.aliyun.com/repo/Centos-7.repo

curl -o /etc/yum.repos.d/CentOS-Base.repo https://mirrors.aliyun.com/repo/Centos-7.repo

青云默认是阿里云的镜像 所以不用操作

# 查看内核版本

uname -sr

# 0、升级软件包,不升级内核

yum update -y --exclude=kernel*

# 1、下载公钥

rpm --import https://www.elrepo.org/RPM-GPG-KEY-elrepo.org

rpm -Uvh https://www.elrepo.org/elrepo-release-7.el7.elrepo.noarch.rpm

# 安装镜像加速

yum install -y yum-plugin-fastestmirror

# 3、仓库启用后,列出可用的内核相关包:

yum --disablerepo="*" --enablerepo="elrepo-kernel" list available

kernel-lt: long term support:长期支持版

kernel-ml: mainline stable: 主线稳定版

# 4、选择自己的版本进行安装

yum --enablerepo=elrepo-kernel install -y kernel-lt

# 5、查看内核

uname -sr

#查看内核位置

awk -F\' '$1=="menuentry " {print $2}' /etc/grub2.cfg

CentOS Linux 7 Rescue 0a87210b6f6337e79a6611c512e524ce (5.4.119-1.el7.elrepo.x86_64) #第0个

CentOS Linux (5.4.119-1.el7.elrepo.x86_64) 7 (Core) ##我们的在第1个

CentOS Linux (3.10.0-1160.el7.x86_64) 7 (Core)

CentOS Linux (0-rescue-cc2c86fe566741e6a2ff6d399c5d5daa) 7 (Core)

# 6、重新创建内核配置。

grub2-mkconfig -o /boot/grub2/grub.cfg

# 7、修改使用默认内核

vi /etc/default/grub

# 将 GRUB_DEFAULT 设置为 0,代表 GRUB 初始化页面的第一个内核将作为默认内核

# 再重新整理下内核

grub2-mkconfig -o /boot/grub2/grub.cfg

# 8、重开机

reboot

# 9、检查

uname -r2.所有节点基础环境

#注意:以下操作所有节点执行

#修改主机名

hostnamectl set-hostname k8s-xxx

#退出重连设备验证

exit

#集群规划

k8s-master1 k8s-master2 k8s-master3 k8s-master-lb k8s-node01 k8s-node02 ... k8s-nodeN

# 每个机器准备域名

vi /etc/hosts

192.168.100.101 k8s-master1

192.168.100.102 k8s-master2

192.168.100.103 k8s-master3

192.168.100.104 k8s-node1

192.168.100.105 k8s-node2

192.168.100.106 k8s-node3

192.168.100.250 k8s-master-lb # 负载均衡IP,如果负载均衡选择nginx这行不需要

#VMware需要关闭防火墙

systemctl disable --now firewalld

# 关闭selinux

setenforce 0

sed -i 's#SELINUX=enforcing#SELINUX=disabled#g' /etc/selinux/config

#验证

[root@k8s-node2 ~]# getenforce

Disabled

# 关闭swap

swapoff -a && sysctl -w vm.swappiness=0

sed -ri 's/.*swap.*/#&/' /etc/fstab

#验证

free -h

Swap: 0B 0B 0B

#修改limit

ulimit -SHn 65535

#解释ulimit -SHn 65535这条命令的含义是设置当前shell的软资源限制和硬资源限制下的最大文件描述符数量为65535个。文件描述符是用来标识一个文件或者其他I/O对象的整数,比如打开的文件、网络连接等。通过增加文件描述符的数量限制,可以让系统支持更多的同时打开文件或连接。

#-S 选项表示设置或显示软限制(Soft Limit),软限制是用户实际可以使用的资源上限,但可以通过提高软限制来达到硬限制。

#-H 选项表示设置或显示硬限制(Hard Limit),硬限制是系统管理员设定的资源使用上限,用户无法超过这个限制。

cat >> /etc/security/limits.conf <<EOF

* soft nofile 655360

* hard nofile 131072

* soft nproc 655350

* hard nproc 655350

* seft memlock unlimited

* hard memlock unlimitedd

EOF

#解释

* soft nofile 655360: 这条设置表示所有用户的软资源限制下的最大文件描述符数量为655360。文件描述符是用来标识一个文件或者其他I/O对象的整数,通过增加文件描述符的数量限制,可以让系统支持更多的同时打开文件或连接。

* hard nofile 131072: 这条设置表示所有用户的硬资源限制下的最大文件描述符数量为131072。硬资源限制是系统级别的限制,只能由超级用户(root)或者具有特殊权限的用户来设置。

* soft nproc 655350: 这条设置表示所有用户的软资源限制下的最大进程数量为655350。进程数量限制可以控制系统中同时运行的进程数量。

* hard nproc 655350: 这条设置表示所有用户的硬资源限制下的最大进程数量为655350。

* soft memlock unlimited: 这条设置表示所有用户的软资源限制下的内存锁定限制为无限制。内存锁定限制控制了用户在内存中锁定的页的数量,用于确保这些页不会被置换到交换空间。

* hard memlock unlimited: 这条设置表示所有用户的硬资源限制下的内存锁定限制为无限制

#为了方便以后操作配置ssh免密连接,master1运行

ssh-keygen -t rsa

for i in k8s-master1 k8s-master2 k8s-master3 k8s-node1 k8s-node2 k8s-node3;do ssh-copy-id -i .ssh/id_rsa.pub $i;done

#安装后续用的一些工具

yum install wget git jq psmisc net-tools yum-utils device-mapper-persistent-data lvm2 -y

# 安装ipvs工具,方便以后操作ipvs,ipset,conntrack等

yum install ipvsadm ipset sysstat conntrack libseccomp -y

# 所有节点配置ipvs模块,执行以下命令,在内核4.19+版本改为nf_conntrack, 4.18下改为nf_conntrack_ipv4

#加载模块

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

modprobe -- nf_conntrack

#修改ipvs配置,加入以下内容

vi /etc/modules-load.d/ipvs.conf

ip_vs

ip_vs_lc

ip_vs_wlc

ip_vs_rr

ip_vs_wrr

ip_vs_lblc

ip_vs_lblcr

ip_vs_dh

ip_vs_sh

ip_vs_fo

ip_vs_nq

ip_vs_sed

ip_vs_ftp

ip_vs_sh

nf_conntrack

ip_tables

ip_set

xt_set

ipt_set

ipt_rpfilter

ipt_REJECT

ipip

# 执行命令

systemctl enable --now systemd-modules-load.service #--now = enable+start

#检测是否加载

lsmod | grep -e ip_vs -e nf_conntrack

#解释

ip_vs_lc:基于最少连接数的负载均衡算法。

ip_vs_wlc:基于加权最少连接数的负载均衡算法。

ip_vs_rr:基于轮询的负载均衡算法。

ip_vs_wrr:基于加权轮询的负载均衡算法。

ip_vs_lblc:基于本地散列的负载均衡算法。

ip_vs_lblcr:基于本地散列的负载均衡算法,带有复制。

ip_vs_dh:基于目标散列的负载均衡算法。

ip_vs_sh:基于源散列的负载均衡算法。

ip_vs_fo:基于最早到达的负载均衡算法。

ip_vs_nq:基于永不排队的负载均衡算法。

ip_vs_sed:基于最短期望延迟的负载均衡算法。

ip_vs_ftp:基于FTP的负载均衡算法。

nf_conntrack:用于连接跟踪的Netfilter模块。

ip_tables:用于配置和管理IPv4防火墙规则的工具。

ip_set:用于管理IP集合的工具。

xt_set:用于管理扩展集合的工具。

ipt_set:用于管理扩展集合的工具。

ipt_rpfilter:用于反向路径过滤的Netfilter模块。

ipt_REJECT:用于拒绝连接的Netfilter模块。

ipip:用于IP隧道的协议。

#系统调优

cat <<EOF > /etc/sysctl.d/k8s.conf

net.ipv4.ip_forward = 1

net.bridge.bridge-nf-call-iptables = 1

fs.may_detach_mounts = 1

vm.overcommit_memory=1

vm.panic_on_oom=0

fs.inotify.max_user_watches=89100

fs.file-max=52706963

fs.nr_open=52706963

net.netfilter.nf_conntrack_max=2310720

net.ipv4.tcp_keepalive_time = 600

net.ipv4.tcp_keepalive_probes = 3

net.ipv4.tcp_keepalive_intvl =15

net.ipv4.tcp_max_tw_buckets = 36000

net.ipv4.tcp_tw_reuse = 1

net.ipv4.tcp_max_orphans = 327680

net.ipv4.tcp_orphan_retries = 3

net.ipv4.tcp_syncookies = 1

net.ipv4.tcp_max_syn_backlog = 16384

net.ipv4.ip_conntrack_max = 65536

net.ipv4.tcp_max_syn_backlog = 16384

net.ipv4.tcp_timestamps = 0

net.core.somaxconn = 16384

net.ipv6.conf.all.disable_ipv6 = 0

net.ipv6.conf.default.disable_ipv6 = 0

net.ipv6.conf.lo.disable_ipv6 = 0

net.ipv6.conf.all.forwarding = 1

EOF

sysctl --system

reboot

#解释

net.ipv4.ip_forward = 1:启用IPv4数据包转发功能,允许系统将接收到的数据包转发到其他网络接口。

net.bridge.bridge-nf-call-iptables = 1:启用桥接网络的iptables规则,允许在桥接网络上使用iptables进行网络过滤。

fs.may_detach_mounts = 1:允许卸载正在使用的文件系统。

vm.overcommit_memory=1:启用内存超额分配机制,允许系统分配超过物理内存大小的内存。

vm.panic_on_oom=0:当系统内存不足时,不触发系统崩溃。

fs.inotify.max_user_watches=89100:设置每个用户可监视的文件数的最大值。

fs.file-max=52706963:设置系统可打开的文件描述符的最大数量。

fs.nr_open=52706963:设置系统可打开的文件描述符的最大数量。

net.netfilter.nf_conntrack_max=2310720:设置系统中同时跟踪的网络连接的最大数量。

net.ipv4.tcp_keepalive_time = 600:设置TCP keepalive探测的时间间隔,单位为秒。

net.ipv4.tcp_keepalive_probes = 3:设置TCP keepalive探测的次数。

net.ipv4.tcp_keepalive_intvl =15:设置TCP keepalive探测的时间间隔,单位为秒。

net.ipv4.tcp_max_tw_buckets = 36000:设置系统同时保持的最大TCP连接数。

net.ipv4.tcp_tw_reuse = 1:启用TCP连接的快速重用,允许重新使用处于TIME_WAIT状态的连接。

net.ipv4.tcp_max_orphans = 327680:设置系统同时保持的最大孤立TCP连接数。

net.ipv4.tcp_orphan_retries = 3:设置系统放弃孤立TCP连接之前的重试次数。

net.ipv4.tcp_syncookies = 1:启用TCP SYN cookies机制,用于防止SYN洪泛攻击。

net.ipv4.tcp_max_syn_backlog = 16384:设置系统同时保持的最大SYN队列长度。

net.ipv4.ip_conntrack_max = 65536:设置系统中同时跟踪的IPv4连接的最.d/k8s.conf文件中的每个字段的含义如下:

net.ipv4.ip_forward = 1: 启用IPv4数据包转发功能,允许系统将接收到的数据包转发到其他网络接口。

net.bridge.bridge-nf-call-iptables = 1: 允许iptables处理桥接网络的数据包。

fs.may_detach_mounts = 1: 允许卸载正在使用的文件系统。

vm.overcommit_memory=1: 允许内存超额分配,即使系统内存不足。

vm.panic_on_oom=0: 当系统内存不足时,不会导致系统崩溃。

fs.inotify.max_user_watches=89100: 设置每个用户可以监视的文件或目录的最大数量。

fs.file-max=52706963: 设置系统可以打开的文件描述符的最大数量。

fs.nr_open=52706963: 设置系统可以打开的文件的最大数量。

net.netfilter.nf_conntrack_max=2310720: 设置系统可以跟踪的网络连接的最大数量。

net.ipv4.tcp_keepalive_time = 600: 设置TCP keepalive探测的时间间隔,单位为秒。

net.ipv4.tcp_keepalive_probes = 3: 设置TCP keepalive探测的次数。

net.ipv4.tcp_keepalive_intvl =15: 设置TCP keepalive探测之间的时间间隔,单位为秒。

net.ipv4.tcp_max_tw_buckets = 36000: 设置系统可以使用的最大TCP时间等待队列的大小。

net.ipv4.tcp_tw_reuse = 1: 允许重用TIME_WAIT状态的TCP连接。

net.ipv4.tcp_max_orphans = 327680: 设置系统可以容纳的最大孤立的TCP连接数量。

net.ipv4.tcp_orphan_retries = 3: 设置系统放弃孤立的TCP连接之前的重试次数。

net.ipv4.tcp_syncookies = 1: 启用TCP SYN cookies,用于防止SYN洪泛攻击。

net.ipv4.tcp_max_syn_backlog = 16384: 设置系统可以容纳的最大SYN队列的大小。

net.ipv4.ip_conntrack_max = 65536: 设置系统可以跟踪的IPv4连接的最大数量。

net.ipv4.tcp_timestamps = 0: 禁用TCP时间戳,用于防止时间戳伪造攻击。

net.core.somaxconn = 16384: 设置系统可以接受的最大连接数。

net.ipv6.conf.all.disable_ipv6 = 0: 启用IPv6功能。

net.ipv6.conf.default.disable_ipv6 = 0: 启用IPv6功能。

net.ipv6.conf.lo.disable_ipv6 = 0: 启用IPv6功能。

net.ipv6.conf.all.forwarding = 1: 启用IPv6数据包转发功能。##进行时间同步

# 服务端

# apt install chrony -y

yum install chrony -y

cat > /etc/chrony.conf << EOF

pool ntp.aliyun.com iburst

driftfile /var/lib/chrony/drift

makestep 1.0 3

rtcsync

allow 192.168.100.0/24

local stratum 10

keyfile /etc/chrony.keys

leapsectz right/UTC

logdir /var/log/chrony

EOF

systemctl restart chronyd ; systemctl enable chronyd

# 客户端

# apt install chrony -y

yum install chrony -y

cat > /etc/chrony.conf << EOF

pool 192.168.100.101 iburst

driftfile /var/lib/chrony/drift

makestep 1.0 3

rtcsync

keyfile /etc/chrony.keys

leapsectz right/UTC

logdir /var/log/chrony

EOF

systemctl restart chronyd ; systemctl enable chronyd

#使用客户端进行验证

chronyc sources -v

# 参数解释

#

# pool ntp.aliyun.com iburst

# 指定使用ntp.aliyun.com作为时间服务器池,iburst选项表示在初始同步时会发送多个请求以加快同步速度。

#

# driftfile /var/lib/chrony/drift

# 指定用于保存时钟漂移信息的文件路径。

#

# makestep 1.0 3

# 设置当系统时间与服务器时间偏差大于1秒时,会以1秒的步长进行调整。如果偏差超过3秒,则立即进行时间调整。

#

# rtcsync

# 启用硬件时钟同步功能,可以提高时钟的准确性。

#

# allow 192.168.100.0/24

# 允许192.168.100.0/24网段范围内的主机与chrony进行时间同步。

#

# local stratum 10

# 将本地时钟设为stratum 10,stratum值表示时钟的准确度,值越小表示准确度越高。

#

# keyfile /etc/chrony.keys

# 指定使用的密钥文件路径,用于对时间同步进行身份验证。

#

# leapsectz right/UTC

# 指定时区为UTC。

#

# logdir /var/log/chrony

# 指定日志文件存放目录。3.k8s基本组件安装

3.1安装容器运行时

Containerd和docker其中一种,我这里选择docker

注意:以下操作每台设备都需要执行

3.1.1安装docker作为Runtime

下载docker包

# 二进制包下载地址:https://download.docker.com/linux/static/stable/x86_64/

# wget https://mirrors.ustc.edu.cn/docker-ce/linux/static/stable/x86_64/docker-24.0.7.tgz

#解压

tar xf docker-*.tgz

#拷贝二进制文件

cp docker/* /usr/bin/创建containerd的service文件

#创建containerd的service文件,并且启动

cat >/etc/systemd/system/containerd.service <<EOF

[Unit]

Description=containerd container runtime

Documentation=https://containerd.io

After=network.target local-fs.target

[Service]

ExecStartPre=-/sbin/modprobe overlay

ExecStart=/usr/bin/containerd

Type=notify

Delegate=yes

KillMode=process

Restart=always

RestartSec=5

LimitNPROC=infinity

LimitCORE=infinity

LimitNOFILE=1048576

TasksMax=infinity

OOMScoreAdjust=-999

[Install]

WantedBy=multi-user.target

EOF

# 参数解释:

#

# [Unit]

# - Description=containerd container runtime:指定服务的描述信息。

# - Documentation=https://containerd.io:指定服务的文档链接。

# - After=network.target local-fs.target:指定服务的启动顺序,在网络和本地文件系统启动之后再启动该服务。

#

# [Service]

# - ExecStartPre=-/sbin/modprobe overlay:在启动服务之前执行的命令,使用`-`表示忽略错误。

# - ExecStart=/usr/bin/containerd:指定服务的启动命令。

# - Type=notify:指定服务的类型,`notify`表示服务会在启动完成后向systemd发送通知。

# - Delegate=yes:允许服务代理其他服务的应答,例如收到关机命令后终止其他服务。

# - KillMode=process:指定服务终止时的行为,`process`表示终止服务进程。

# - Restart=always:指定服务终止后是否自动重启,`always`表示总是自动重启。

# - RestartSec=5:指定服务重启的时间间隔,单位为秒。

# - LimitNPROC=infinity:限制服务的最大进程数,`infinity`表示没有限制。

# - LimitCORE=infinity:限制服务的最大核心数,`infinity`表示没有限制。

# - LimitNOFILE=1048576:限制服务的最大文件数,指定为1048576。

# - TasksMax=infinity:限制服务的最大任务数,`infinity`表示没有限制。

# - OOMScoreAdjust=-999:指定服务的OOM(Out of Memory)得分,负数表示降低被终止的概率。

#

# [Install]

# - WantedBy=multi-user.target:指定服务的安装方式,`multi-user.target`表示该服务在多用户模式下安装。

# 设置开机自启

systemctl enable --now containerd.service准备docker的service文件

#准备docker的service文件

cat > /etc/systemd/system/docker.service <<EOF

[Unit]

Description=Docker Application Container Engine

Documentation=https://docs.docker.com

After=network-online.target firewalld.service cri-docker.service docker.socket containerd.service

Wants=network-online.target

Requires=docker.socket containerd.service

[Service]

Type=notify

ExecStart=/usr/bin/dockerd -H fd:// --containerd=/run/containerd/containerd.sock

ExecReload=/bin/kill -s HUP $MAINPID

TimeoutSec=0

RestartSec=2

Restart=always

StartLimitBurst=3

StartLimitInterval=60s

LimitNOFILE=infinity

LimitNPROC=infinity

LimitCORE=infinity

TasksMax=infinity

Delegate=yes

KillMode=process

OOMScoreAdjust=-500

[Install]

WantedBy=multi-user.target

EOF准备docker的socket文件

#准备docker的socket文件

cat > /etc/systemd/system/docker.socket <<EOF

[Unit]

Description=Docker Socket for the API

[Socket]

ListenStream=/var/run/docker.sock

SocketMode=0660

SocketUser=root

SocketGroup=docker

[Install]

WantedBy=sockets.target

EOF配置加速docker

# 配置加速器

mkdir /etc/docker/ -pv

cat >/etc/docker/daemon.json <<EOF

{

"exec-opts": ["native.cgroupdriver=systemd"],

"registry-mirrors": [

"https://k7m15dzm.mirror.aliyuncs.com"

],

"max-concurrent-downloads": 10,

"log-driver": "json-file",

"log-level": "warn",

"log-opts": {

"max-size": "10m",

"max-file": "3"

},

"data-root": "/var/lib/docker"

}

EOF

#https://k7m15dzm.mirror.aliyuncs.com 这里可以用自己阿里云的加速地址启动docker

#创建docker组

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now docker.socket

# 启用并立即启动docker.socket单元。docker.socket是一个systemd的socket单元,用于接收来自网络的Docker API请求。

systemctl enable --now docker.service

# 启用并立即启动docker.service单元。docker.service是Docker守护进程的systemd服务单元。

systemctl status docker.service

# 显示docker.service单元的当前状态,包括运行状态、是否启用等信息。

docker info

#验证

#阿里云镜像

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo解压cri-docker

# 由于1.24以及更高版本不支持docker所以安装cri-docker

# 下载cri-docker

# https://github.com/Mirantis/cri-dockerd/releases/

# wget https://github.com/Mirantis/cri-dockerd/releases/download/v0.3.7/cri-dockerd-0.3.7.amd64.tgz

# 解压cri-docker

tar xvf cri-dockerd-*.amd64.tgz

cp -r cri-dockerd/ /usr/bin/

chmod +x /usr/bin/cri-dockerd/cri-dockerd写入启动cri-docker配置文件

# 写入启动配置文件

cat > /usr/lib/systemd/system/cri-docker.service <<EOF

[Unit]

Description=CRI Interface for Docker Application Container Engine

Documentation=https://docs.mirantis.com

After=network-online.target firewalld.service docker.service

Wants=network-online.target

Requires=cri-docker.socket

[Service]

Type=notify

ExecStart=/usr/bin/cri-dockerd/cri-dockerd --network-plugin=cni --pod-infra-container-image=registry.aliyuncs.com/google_containers/pause:3.7

ExecReload=/bin/kill -s HUP $MAINPID

TimeoutSec=0

RestartSec=2

Restart=always

StartLimitBurst=3

StartLimitInterval=60s

LimitNOFILE=infinity

LimitNPROC=infinity

LimitCORE=infinity

TasksMax=infinity

Delegate=yes

KillMode=process

[Install]

WantedBy=multi-user.target

EOF

写入cri-docker的socket配置文件

# 写入socket配置文件

cat > /usr/lib/systemd/system/cri-docker.socket <<EOF

[Unit]

Description=CRI Docker Socket for the API

PartOf=cri-docker.service

[Socket]

ListenStream=%t/cri-dockerd.sock

SocketMode=0660

SocketUser=root

SocketGroup=docker

[Install]

WantedBy=sockets.target

EOF

启动cri-docker

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now cri-docker.service

# 启用并立即启动cri-docker.service单元。cri-docker.service是cri-docker守护进程的systemd服务单元。

systemctl enable --now cri-docker.socket

systemctl restart cri-docker.service

# 重启cri-docker.service单元,即重新启动cri-docker守护进程。

systemctl status docker.service

# 显示docker.service单元的当前状态,包括运行状态、是否启用等信息。3.2k8s与etcd下载及安装

下载不了这里提供了离线包

链接:https://pan.baidu.com/s/1GQvHzLkDs96sZBAN-ILfnA

提取码:4j9j

#注意:这个操作在k8s-master1上执行

# 下载安装包

# wget https://github.com/etcd-io/etcd/releases/download/v3.5.10/etcd-v3.5.10-linux-amd64.tar.gz

# wget https://dl.k8s.io/v1.28.3/kubernetes-server-linux-amd64.tar.gz

# 解压k8s安装文件

tar -xvf kubernetes-server-linux-amd64.tar.gz --strip-components=3 -C /usr/local/bin kubernetes/server/bin/kube{let,ctl,-apiserver,-controller-manager,-scheduler,-proxy}

# 这是一个tar命令,用于解压指定的kubernetes-server-linux-amd64.tar.gz文件,并将其中的特定文件提取到/usr/local/bin目录下。

# 解压etcd安装文件

tar -xf etcd*.tar.gz && mv etcd-*/etcd /usr/local/bin/ && mv etcd-*/etcdctl /usr/local/bin/

# 查看/usr/local/bin下内容

ls /usr/local/bin/

#查看版本

[root@k8s-master01 ~]# kubelet --version

Kubernetes v1.28.3

[root@k8s-master01 ~]# etcdctl version

etcdctl version: 3.5.10

API version: 3.5将组件发送至其他k8s节点

Master='k8s-master2 k8s-master3'

Work='k8s-node1 k8s-node2 k8s-node3'

# 拷贝master组件

for NODE in $Master; do echo $NODE; scp /usr/local/bin/kube{let,ctl,-apiserver,-controller-manager,-scheduler,-proxy} $NODE:/usr/local/bin/; scp /usr/local/bin/etcd* $NODE:/usr/local/bin/; done

#这是一个for循环,使用scp命令将/usr/local/bin/etcd*文件复制到节点的/usr/local/bin/目录下。

# 拷贝work组件

for NODE in $Work; do echo $NODE; scp /usr/local/bin/kube{let,-proxy} $NODE:/usr/local/bin/ ; done

#for循环,使用scp命令将/usr/local/bin/kubelet和kube-proxy文件复制到节点的/usr/local/bin/目录下。4.创建证书文件

cfssl核心组件下载

CFSSL(CloudFlare SSL)是CloudFlare开源的一款PKI/TLS工具,用于生成和管理SSL证书。它包含一个命令行工具和一个HTTP API服务,可以用于签名、验证和捆绑TLS证书。

CFSSL的主要功能包括:

- 生成证书:CFSSL可以生成各种类型的证书,包括根证书、中间证书和服务器证书。

- 签名证书:CFSSL可以使用私钥对证书进行签名,确保证书的真实性和完整性。

- 验证证书:CFSSL可以验证证书的有效性,包括检查证书链、过期时间和签名等。

- 捆绑证书:CFSSL可以将证书和私钥捆绑在一起,方便使用和传输。

# master1节点下载证书生成工具

wget "https://github.com/cloudflare/cfssl/releases/download/v1.6.4/cfssl_1.6.4_linux_amd64" -O /usr/local/bin/cfssl

wget "https://github.com/cloudflare/cfssl/releases/download/v1.6.4/cfssljson_1.6.4_linux_amd64" -O /usr/local/bin/cfssljson

# 添加执行权限

chmod +x /usr/local/bin/cfssl /usr/local/bin/cfssljson4.1创建etcd证书

#所有master节点创建证书存放目录

mkdir /etc/etcd/ssl -p

cd /etc/etcd/ssl/

#master1节点生成etcd证书

# 写入生成证书所需的配置文件

cat > ca-config.json << EOF

{

"signing": {

"default": {

"expiry": "876000h"

},

"profiles": {

"kubernetes": {

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

],

"expiry": "876000h"

}

}

}

}

EOF

# 这段配置文件是用于配置加密和认证签名的一些参数。

#

# 在这里,有两个部分:`signing`和`profiles`。

#

# `signing`包含了默认签名配置和配置文件。

# 默认签名配置`default`指定了证书的过期时间为`876000h`。`876000h`表示证书有效期为100年。

#

# `profiles`部分定义了不同的证书配置文件。

# 在这里,只有一个配置文件`kubernetes`。它包含了以下`usages`和过期时间`expiry`:

#

# 1. `signing`:用于对其他证书进行签名

# 2. `key encipherment`:用于加密和解密传输数据

# 3. `server auth`:用于服务器身份验证

# 4. `client auth`:用于客户端身份验证

#

# 对于`kubernetes`配置文件,证书的过期时间也是`876000h`,即100年。

#创建etcd根证书请求文件

cat > etcd-ca-csr.json << EOF

{

"CN": "etcd",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "etcd",

"OU": "Etcd Security"

}

],

"ca": {

"expiry": "876000h"

}

}

EOF

# 这是一个用于生成证书签名请求(Certificate Signing Request,CSR)的JSON配置文件。JSON配置文件指定了生成证书签名请求所需的数据。

#

# - "CN": "etcd" 指定了希望生成的证书的CN字段(Common Name),即证书的主题,通常是该证书标识的实体的名称。

# - "key": {} 指定了生成证书所使用的密钥的配置信息。"algo": "rsa" 指定了密钥的算法为RSA,"size": 2048 指定了密钥的长度为2048位。

# - "names": [] 包含了生成证书时所需的实体信息。在这个例子中,只包含了一个实体,其相关信息如下:

# - "C": "CN" 指定了实体的国家/地区代码,这里是中国。

# - "ST": "Beijing" 指定了实体所在的省/州。

# - "L": "Beijing" 指定了实体所在的城市。

# - "O": "etcd" 指定了实体的组织名称。

# - "OU": "Etcd Security" 指定了实体所属的组织单位。

# - "ca": {} 指定了生成证书时所需的CA(Certificate Authority)配置信息。

# - "expiry": "876000h" 指定了证书的有效期,这里是876000小时。

#

# 生成证书签名请求时,可以使用这个JSON配置文件作为输入,根据配置文件中的信息生成相应的CSR文件。然后,可以将CSR文件发送给CA进行签名,以获得有效的证书。

#生产etcd根证书文件

cfssl gencert -initca etcd-ca-csr.json | cfssljson -bare /etc/etcd/ssl/etcd-ca

#前面已经生了etcd根证书文件,相当etcd成立了一个证书机构,有了这个证书机构就可以为etcd颁发证书了,所以下面这个文件就是用于向etcd机构申请证书的请求文件,用于为etcd颁发证书

cat > etcd-csr.json << EOF

{

"CN": "etcd",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "etcd",

"OU": "Etcd Security"

}

]

}

EOF

#利用上面的请求文件生成etcd的证书文件

cfssl gencert \

-ca=/etc/etcd/ssl/etcd-ca.pem \

-ca-key=/etc/etcd/ssl/etcd-ca-key.pem \

-config=ca-config.json \

-hostname=127.0.0.1,k8s-master1,k8s-master2,k8s-master3,192.168.100.101,192.168.100.102,192.168.100.103\

-profile=kubernetes \

etcd-csr.json | cfssljson -bare /etc/etcd/ssl/etcd

#这里的hostname字段就是集群的地址

# -ca=/etc/etcd/ssl/etcd-ca.pem:指定用于签名etcd证书的CA文件的路径。

# -ca-key=/etc/etcd/ssl/etcd-ca-key.pem:指定用于签名etcd证书的CA私钥文件的路径。

# -config=ca-config.json:指定CA配置文件的路径,该文件定义了证书的有效期、加密算法等设置。

# -hostname=xxxx:指定要为etcd生成证书的主机名和IP地址列表。

# -profile=kubernetes:指定使用的证书配置文件,该文件定义了证书的用途和扩展属性。

# etcd-csr.json:指定etcd证书请求的JSON文件的路径,该文件包含了证书请求的详细信息。

# | cfssljson -bare /etc/etcd/ssl/etcd:通过管道将cfssl命令的输出传递给cfssljson命令,并使用-bare参数指定输出文件的前缀路径,这里将生成etcd证书的.pem和-key.pem文件。

##将证书复制到其他master节点

for i in k8s-master2 k8s-master3;do scp /etc/etcd/ssl/{etcd-ca-key.pem,etcd-ca.pem,etcd-key.pem,etcd.pem} root@$i:/etc/etcd/ssl;done

4.2k8s其他组件相关证书

4.2.1apiserver 证书生成

#所有k8s节点创建证书存放目录

mkdir -p /etc/kubernetes/pki

cd /etc/kubernetes/pki/

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

#这里也是同样的道理,k8s想跟其他组件颁发证书,必须的先成立机构,有了机构才能向其他组件颁发证书

#master1节点生成k8s根证书,这个文件相当于k8s的总根文件

cat > ca-config.json << EOF

{

"signing": {

"default": {

"expiry": "876000h"

},

"profiles": {

"kubernetes": {

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

],

"expiry": "876000h"

}

}

}

}

EOF

# 写入生成证书所需的配置文件,这个是k8s根证书请求文件

cat > ca-csr.json << EOF

{

"CN": "kubernetes",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "Kubernetes",

"OU": "Kubernetes-manual"

}

],

"ca": {

"expiry": "876000h"

}

}

EOF

#有上面的请求文件,执行下面命令就可以成立一个根机构,这样就可以为其他组件颁发证书了

cfssl gencert -initca ca-csr.json | cfssljson -bare /etc/kubernetes/pki/ca

#创建apiserver的请求文件

cat > apiserver-csr.json << EOF

{

"CN": "kube-apiserver",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "Kubernetes",

"OU": "Kubernetes-manual"

}

]

}

EOF

#利用上面的文件为aipserver颁发证书

cfssl gencert \

-ca=/etc/kubernetes/pki/ca.pem \

-ca-key=/etc/kubernetes/pki/ca-key.pem \

-config=ca-config.json \

-hostname=10.96.0.1,192.168.100.101,127.0.0.1,kubernetes,kubernetes.default,kubernetes.default.svc,kubernetes.default.svc.cluster,kubernetes.default.svc.cluster.local,x.oiox.cn,k.oiox.cn,l.oiox.cn,o.oiox.cn,192.168.100.102,192.168.100.103.,192.168.100.104,192.168.100.105,192.168.100.106 \

-profile=kubernetes apiserver-csr.json | cfssljson -bare /etc/kubernetes/pki/apiserver

# -hostname=10.96.0.1,192.168.1.36,127.0.0.1`:指定证书的主机名或IP地址列表。这里根据自己的集群规划来

#10.96.0. 为service网段。可以自定义,如果这里的负载均衡是云厂商的lb的话需要指定lb的IP地址,我这里采用的是自己搭建nginx

4.2.2生成apiserver聚合证书

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

#创建front-proxy根请求文件

cat > front-proxy-ca-csr.json << EOF

{

"CN": "kubernetes",

"key": {

"algo": "rsa",

"size": 2048

},

"ca": {

"expiry": "876000h"

}

}

EOF

#成立front-proxy根机构,同样的到了先成立机构在颁发证书

cfssl gencert -initca front-proxy-ca-csr.json | cfssljson -bare /etc/kubernetes/pki/front-proxy-ca

#创建front-proxy-client请求文件为client颁发证书

cat > front-proxy-client-csr.json << EOF

{

"CN": "front-proxy-client",

"key": {

"algo": "rsa",

"size": 2048

}

}

EOF

#为front-proxy-client颁发证书

cfssl gencert \

-ca=/etc/kubernetes/pki/front-proxy-ca.pem \

-ca-key=/etc/kubernetes/pki/front-proxy-ca-key.pem \

-config=ca-config.json \

-profile=kubernetes front-proxy-client-csr.json | cfssljson -bare /etc/kubernetes/pki/front-proxy-client4.2.3生成controller-manage的证书

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

#创建controller-manage证书请求文件,这个组件直接有k8s根机构颁发证书,不需要成立根机构

cat > manager-csr.json << EOF

{

"CN": "system:kube-controller-manager",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "system:kube-controller-manager",

"OU": "Kubernetes-manual"

}

]

}

EOF

#生成controller-manage证书

cfssl gencert \

-ca=/etc/kubernetes/pki/ca.pem \

-ca-key=/etc/kubernetes/pki/ca-key.pem \

-config=ca-config.json \

-profile=kubernetes \

manager-csr.json | cfssljson -bare /etc/kubernetes/pki/controller-manager

#生成配置文件

#注意这里的负载均衡是用lb的话要改为lb的地址,自建nginx做负载均衡就不需要改了

kubectl config set-cluster kubernetes \

--certificate-authority=/etc/kubernetes/pki/ca.pem \

--embed-certs=true \

--server=https://127.0.0.1:8443 \

--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig

#解释

# kubectl config set-cluster命令用于配置集群信息。

# --certificate-authority选项指定了集群的证书颁发机构(CA)的路径,这个CA会验证kube-apiserver提供的证书是否合法。

# --embed-certs选项用于将证书嵌入到生成的kubeconfig文件中,这样就不需要在kubeconfig文件中单独指定证书文件路径。

# --server选项指定了kube-apiserver的地址,这里使用的是127.0.0.1:8443,表示使用本地主机上的kube-apiserver,默认端口为8443。

# --kubeconfig选项指定了生成的kubeconfig文件的路径和名称,这里指定为/etc/kubernetes/controller-manager.kubeconfig。

# 综上所述,kubectl config set-cluster命令的作用是在kubeconfig文件中设置集群信息,包括证书颁发机构、证书、kube-apiserver地址等。

# 设置一个环境项,一个上下文

kubectl config set-context system:kube-controller-manager@kubernetes \

--cluster=kubernetes \

--user=system:kube-controller-manager \

--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig

# 这个命令用于配置 Kubernetes 控制器管理器的上下文信息。下面是各个参数的详细解释:

# 1. `kubectl config set-context system:kube-controller-manager@kubernetes`: 设置上下文的名称为 `system:kube-controller-manager@kubernetes`,这是一个标识符,用于唯一标识该上下文。

# 2. `--cluster=kubernetes`: 指定集群的名称为 `kubernetes`,这是一个现有集群的标识符,表示要管理的 Kubernetes 集群。

# 3. `--user=system:kube-controller-manager`: 指定使用的用户身份为 `system:kube-controller-manager`。这是一个特殊的用户身份,具有控制 Kubernetes 控制器管理器的权限。

# 4. `--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig`: 指定 kubeconfig 文件的路径为 `/etc/kubernetes/controller-manager.kubeconfig`。kubeconfig 文件是一个用于管理 Kubernetes 配置的文件,包含了集群、用户和上下文的相关信息。

# 通过运行这个命令,可以将这些配置信息保存到 `/etc/kubernetes/controller-manager.kubeconfig` 文件中,以便在后续的操作中使用。

# 设置一个用户项

kubectl config set-credentials system:kube-controller-manager \

--client-certificate=/etc/kubernetes/pki/controller-manager.pem \

--client-key=/etc/kubernetes/pki/controller-manager-key.pem \

--embed-certs=true \

--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig

# 上述命令是用于设置 Kubernetes 的 controller-manager 组件的客户端凭据。下面是每个参数的详细解释:

#

# - `kubectl config`: 是使用 kubectl 命令行工具的配置子命令。

# - `set-credentials`: 是定义一个新的用户凭据配置的子命令。

# - `system:kube-controller-manager`: 是设置用户凭据的名称,`system:` 是 Kubernetes API Server 内置的身份验证器使用的用户标识符前缀,它表示是一个系统用户,在本例中是 kube-controller-manager 组件使用的身份。

# - `--client-certificate=/etc/kubernetes/pki/controller-manager.pem`: 指定 controller-manager.pem 客户端证书的路径。

# - `--client-key=/etc/kubernetes/pki/controller-manager-key.pem`: 指定 controller-manager-key.pem 客户端私钥的路径。

# - `--embed-certs=true`: 表示将证书和私钥直接嵌入到生成的 kubeconfig 文件中,而不是通过引用外部文件。

# - `--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig`: 指定生成的 kubeconfig 文件的路径和文件名,即 controller-manager.kubeconfig。

#

# 通过运行上述命令,将根据提供的证书和私钥信息,为 kube-controller-manager 创建一个 kubeconfig 文件,以便后续使用该文件进行身份验证和访问 Kubernetes API。

# 设置默认环境

kubectl config use-context system:kube-controller-manager@kubernetes \

--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig

# 这个命令是用来指定kubectl使用指定的上下文环境来执行操作。上下文环境是kubectl用来确定要连接到哪个Kubernetes集群以及使用哪个身份验证信息的配置。

#

# 在这个命令中,`kubectl config use-context`是用来设置当前上下文环境的命令。 `system:kube-controller-manager@kubernetes`是指定的上下文名称,它告诉kubectl要使用的Kubernetes集群和身份验证信息。

# `--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig`是用来指定使用的kubeconfig文件的路径。kubeconfig文件是存储集群连接和身份验证信息的配置文件。

# 通过执行这个命令,kubectl将使用指定的上下文来执行后续的操作,包括部署和管理Kubernetes资源。

#可以到文件里去查看是否生成

cat /etc/kubernetes/controller-manager.kubeconfig

4.2.4生成kube-scheduler的证书

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

#跟上面的操作类似,这里不解释了

cat > scheduler-csr.json << EOF

{

"CN": "system:kube-scheduler",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "system:kube-scheduler",

"OU": "Kubernetes-manual"

}

]

}

EOF

#生成scheduler证书文件

cfssl gencert \

-ca=/etc/kubernetes/pki/ca.pem \

-ca-key=/etc/kubernetes/pki/ca-key.pem \

-config=ca-config.json \

-profile=kubernetes \

scheduler-csr.json | cfssljson -bare /etc/kubernetes/pki/scheduler

#生成配置

#如果这里的负载均衡是云厂商的lb的话需要指定lb的IP地址,我这里采用的是自己搭建nginx

kubectl config set-cluster kubernetes \

--certificate-authority=/etc/kubernetes/pki/ca.pem \

--embed-certs=true \

--server=https://127.0.0.1:8443 \

--kubeconfig=/etc/kubernetes/scheduler.kubeconfig

kubectl config set-credentials system:kube-scheduler \

--client-certificate=/etc/kubernetes/pki/scheduler.pem \

--client-key=/etc/kubernetes/pki/scheduler-key.pem \

--embed-certs=true \

--kubeconfig=/etc/kubernetes/scheduler.kubeconfig

kubectl config set-context system:kube-scheduler@kubernetes \

--cluster=kubernetes \

--user=system:kube-scheduler \

--kubeconfig=/etc/kubernetes/scheduler.kubeconfig

kubectl config use-context system:kube-scheduler@kubernetes \

--kubeconfig=/etc/kubernetes/scheduler.kubeconfig

#验证文件是否生成

cat /etc/kubernetes/scheduler.kubeconfig4.2.5生成admin的证书配置

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

#创建admin请求文件,命令解释参考controller-manage证书生成过程

cat > admin-csr.json << EOF

{

"CN": "admin",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "system:masters",

"OU": "Kubernetes-manual"

}

]

}

EOF

#生成admin证书

cfssl gencert \

-ca=/etc/kubernetes/pki/ca.pem \

-ca-key=/etc/kubernetes/pki/ca-key.pem \

-config=ca-config.json \

-profile=kubernetes \

admin-csr.json | cfssljson -bare /etc/kubernetes/pki/admin

#生成配置文件

#如果这里的负载均衡是云厂商的lb的话需要指定lb的IP地址,我这里采用的是自己搭建nginx

kubectl config set-cluster kubernetes \

--certificate-authority=/etc/kubernetes/pki/ca.pem \

--embed-certs=true \

--server=https://127.0.0.1:8443 \

--kubeconfig=/etc/kubernetes/admin.kubeconfig

kubectl config set-credentials kubernetes-admin \

--client-certificate=/etc/kubernetes/pki/admin.pem \

--client-key=/etc/kubernetes/pki/admin-key.pem \

--embed-certs=true \

--kubeconfig=/etc/kubernetes/admin.kubeconfig

kubectl config set-context kubernetes-admin@kubernetes \

--cluster=kubernetes \

--user=kubernetes-admin \

--kubeconfig=/etc/kubernetes/admin.kubeconfig

kubectl config use-context kubernetes-admin@kubernetes --kubeconfig=/etc/kubernetes/admin.kubeconfig

#验证文件

cat /etc/kubernetes/admin.kubeconfig

4.2.6创建kube-proxy证书

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

#创建kube-proxy证书请求文件,命令解释参考controller-manage证书生成过程

cat > kube-proxy-csr.json << EOF

{

"CN": "system:kube-proxy",

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "Beijing",

"L": "Beijing",

"O": "system:kube-proxy",

"OU": "Kubernetes-manual"

}

]

}

EOF

#生成kube-proxy证书文件

cfssl gencert \

-ca=/etc/kubernetes/pki/ca.pem \

-ca-key=/etc/kubernetes/pki/ca-key.pem \

-config=ca-config.json \

-profile=kubernetes \

kube-proxy-csr.json | cfssljson -bare /etc/kubernetes/pki/kube-proxy

#生成配置

#如果这里的负载均衡是云厂商的lb的话需要指定lb的IP地址,我这里采用的是自己搭建nginx

kubectl config set-cluster kubernetes \

--certificate-authority=/etc/kubernetes/pki/ca.pem \

--embed-certs=true \

--server=https://127.0.0.1:8443 \

--kubeconfig=/etc/kubernetes/kube-proxy.kubeconfig

kubectl config set-credentials kube-proxy \

--client-certificate=/etc/kubernetes/pki/kube-proxy.pem \

--client-key=/etc/kubernetes/pki/kube-proxy-key.pem \

--embed-certs=true \

--kubeconfig=/etc/kubernetes/kube-proxy.kubeconfig

kubectl config set-context kube-proxy@kubernetes \

--cluster=kubernetes \

--user=kube-proxy \

--kubeconfig=/etc/kubernetes/kube-proxy.kubeconfig

kubectl config use-context kube-proxy@kubernetes --kubeconfig=/etc/kubernetes/kube-proxy.kubeconfig

#验证配置

cat /etc/kubernetes/kube-proxy.kubeconfig

4.2.7创建ServiceAccount Key ——secret

k8s底层,每创建一个ServiceAccount,都会分配一个Secret,而Secret里面有秘钥,秘钥就是由我们接下来的sa生成的。所以我们提前创建出sa信息

#注意下面的操作在k8s-master1的 /etc/kubernetes/pki/下执行

openssl genrsa -out /etc/kubernetes/pki/sa.key 2048

openssl rsa -in /etc/kubernetes/pki/sa.key -pubout -out /etc/kubernetes/pki/sa.pub

#解释

# 这两个命令是使用OpenSSL工具生成RSA密钥对。

#

# 命令1:openssl genrsa -out /etc/kubernetes/pki/sa.key 2048

# 该命令用于生成私钥文件。具体解释如下:

# - openssl:openssl命令行工具。

# - genrsa:生成RSA密钥对。

# - -out /etc/kubernetes/pki/sa.key:指定输出私钥文件的路径和文件名。

# - 2048:指定密钥长度为2048位。

#

# 命令2:openssl rsa -in /etc/kubernetes/pki/sa.key -pubout -out /etc/kubernetes/pki/sa.pub

# 该命令用于从私钥中导出公钥。具体解释如下:

# - openssl:openssl命令行工具。

# - rsa:与私钥相关的RSA操作。

# - -in /etc/kubernetes/pki/sa.key:指定输入私钥文件的路径和文件名。

# - -pubout:指定输出公钥。

# - -out /etc/kubernetes/pki/sa.pub:指定输出公钥文件的路径和文件名。

#通过以上两个命令,我们可以使用OpenSSL工具生成一个RSA密钥对,并将私钥保存在/etc/kubernetes/pki/sa.key文件中,将公钥保存在/etc/kubernetes/pki/sa.pub文件中。4.2.8将证书发送到其他master节点

#其他节点创建目录

# mkdir /etc/kubernetes/pki/ -p

# 在master1上执行

cd /etc/kubernetes

for NODE in k8s-master2 k8s-master3

do

scp -r /etc/kubernetes/{admin.kubeconfig,controller-manager.kubeconfig,kube-proxy.kubeconfig,scheduler.kubeconfig,pki} $NODE:/etc/kubernetes/

done

#查看证书

ls /etc/kubernetes/pki/

admin.csr controller-manager.csr kube-proxy.csr

admin-key.pem controller-manager-key.pem kube-proxy-key.pem

admin.pem controller-manager.pem kube-proxy.pem

apiserver.csr front-proxy-ca.csr sa.key

apiserver-key.pem front-proxy-ca-key.pem sa.pub

apiserver.pem front-proxy-ca.pem scheduler.csr

ca.csr front-proxy-client.csr scheduler-key.pem

ca-key.pem front-proxy-client-key.pem scheduler.pem

ca.pem front-proxy-client.pem

# 一共35个就对了

ls /etc/kubernetes/pki/ |wc -l

355.k8s系统组件配置

5.1etcd配置字段解释

这个配置文件是用于 etcd 集群的配置,其中包含了一些重要的参数和选项:

- `name`:指定了当前节点的名称,用于集群中区分不同的节点。

- `data-dir`:指定了 etcd 数据的存储目录。

- `wal-dir`:指定了 etcd 数据写入磁盘的目录。

- `snapshot-count`:指定了触发快照的事务数量。

- `heartbeat-interval`:指定了 etcd 集群中节点之间的心跳间隔。

- `election-timeout`:指定了选举超时时间。

- `quota-backend-bytes`:指定了存储的限额,0 表示无限制。

- `listen-peer-urls`:指定了节点之间通信的 URL,使用 HTTPS 协议。

- `listen-client-urls`:指定了客户端访问 etcd 集群的 URL,同时提供了本地访问的 URL。

- `max-snapshots`:指定了快照保留的数量。

- `max-wals`:指定了日志保留的数量。

- `initial-advertise-peer-urls`:指定了节点之间通信的初始 URL。

- `advertise-client-urls`:指定了客户端访问 etcd 集群的初始 URL。

- `discovery`:定义了 etcd 集群发现相关的选项。

- `initial-cluster`:指定了 etcd 集群的初始成员。

- `initial-cluster-token`:指定了集群的 token。

- `initial-cluster-state`:指定了集群的初始状态。

- `strict-reconfig-check`:指定了严格的重新配置检查选项。

- `enable-v2`:启用了 v2 API。

- `enable-pprof`:启用了性能分析。

- `proxy`:设置了代理模式。

- `client-transport-security`:客户端的传输安全配置。

- `peer-transport-security`:节点之间的传输安全配置。

- `debug`:是否启用调试模式。

- `log-package-levels`:日志的输出级别。

- `log-outputs`:指定了日志的输出类型。

- `force-new-cluster`:是否强制创建一个新的集群。

这些参数和选项可以根据实际需求进行调整和配置。5.1.1etcd配置

所有master执行-注意修改IP

# 如果要用IPv6那么把IPv4地址修改为IPv6即可

cat > /etc/etcd/etcd.config.yml << EOF

name: 'k8s-master3'

data-dir: /var/lib/etcd

wal-dir: /var/lib/etcd/wal

snapshot-count: 5000

heartbeat-interval: 100

election-timeout: 1000

quota-backend-bytes: 0

listen-peer-urls: 'https://192.168.100.103:2380'

listen-client-urls: 'https://192.168.100.103:2379,http://127.0.0.1:2379'

max-snapshots: 3

max-wals: 5

cors:

initial-advertise-peer-urls: 'https://192.168.100.103:2380'

advertise-client-urls: 'https://192.168.100.103:2379'

discovery:

discovery-fallback: 'proxy'

discovery-proxy:

discovery-srv:

initial-cluster: 'k8s-master1=https://192.168.100.101:2380,k8s-master2=https://192.168.100.102:2380,k8s-master3=https://192.168.100.103:2380'

initial-cluster-token: 'etcd-k8s-cluster'

initial-cluster-state: 'new'

strict-reconfig-check: false

enable-v2: true

enable-pprof: true

proxy: 'off'

proxy-failure-wait: 5000

proxy-refresh-interval: 30000

proxy-dial-timeout: 1000

proxy-write-timeout: 5000

proxy-read-timeout: 0

client-transport-security:

cert-file: '/etc/kubernetes/pki/etcd/etcd.pem'

key-file: '/etc/kubernetes/pki/etcd/etcd-key.pem'

client-cert-auth: true

trusted-ca-file: '/etc/kubernetes/pki/etcd/etcd-ca.pem'

auto-tls: true

peer-transport-security:

cert-file: '/etc/kubernetes/pki/etcd/etcd.pem'

key-file: '/etc/kubernetes/pki/etcd/etcd-key.pem'

peer-client-cert-auth: true

trusted-ca-file: '/etc/kubernetes/pki/etcd/etcd-ca.pem'

auto-tls: true

debug: false

log-package-levels:

log-outputs: [default]

force-new-cluster: false

EOF5.1.2创建etcd.service并启动

所有master执行

cat > /usr/lib/systemd/system/etcd.service << EOF

[Unit]

Description=Etcd Service

Documentation=https://coreos.com/etcd/docs/latest/

After=network.target

[Service]

Type=notify

ExecStart=/usr/local/bin/etcd --config-file=/etc/etcd/etcd.config.yml

Restart=on-failure

RestartSec=10

LimitNOFILE=65536

[Install]

WantedBy=multi-user.target

Alias=etcd3.service

EOF

# 这是一个系统服务配置文件,用于启动和管理Etcd服务。

#

# [Unit] 部分包含了服务的一些基本信息,它定义了服务的描述和文档链接,并指定了服务应在网络连接之后启动。

#

# [Service] 部分定义了服务的具体配置。在这里,服务的类型被设置为notify,意味着当服务成功启动时,它将通知系统。ExecStart 指定了启动服务时要执行的命令,这里是运行 /usr/local/bin/etcd 命令并传递一个配置文件 /etc/etcd/etcd.config.yml。Restart 设置为 on-failure,意味着当服务失败时将自动重启,并且在10秒后进行重启。LimitNOFILE 指定了服务的最大文件打开数。

#

# [Install] 部分定义了服务的安装配置。WantedBy 指定了服务应该被启动的目标,这里是 multi-user.target,表示在系统进入多用户模式时启动。Alias 定义了一个别名,可以通过etcd3.service来引用这个服务。

#

# 这个配置文件描述了如何启动和管理Etcd服务,并将其安装到系统中。通过这个配置文件,可以确保Etcd服务在系统启动后自动启动,并在出现问题时进行重启。5.1.3创建etcd证书目录

mkdir /etc/kubernetes/pki/etcd

ln -s /etc/etcd/ssl/* /etc/kubernetes/pki/etcd/

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now etcd.service

# 启用并立即启动etcd.service单元。etcd.service是etcd守护进程的systemd服务单元。

systemctl status etcd.service

# etcd.service单元的当前状态,包括运行状态、是否启用等信息。5.1.4查看etcd状态

#测试

export ETCDCTL_API=3

etcdctl --endpoints="192.168.100.101:2379,192.168.100.102:2379,192.168.100.103:2379" --cacert=/etc/kubernetes/pki/etcd/etcd-ca.pem --cert=/etc/kubernetes/pki/etcd/etcd.pem --key=/etc/kubernetes/pki/etcd/etcd-key.pem endpoint status --write-out=table

#测试二选1

export ETCDCTL_API=3

HOST_1=192.168.100.101

HOST_2=192.168.100.102

HOST_3=192.168.100.103

ENDPOINTS=$HOST_1:2379,$HOST_2:2379,$HOST_3:2379验证截图

5.2高可用配置

5.2.1和5.2.2二选一

这里可以选择lb负载均衡器或者自建nginx

5.2.1NGINX高可用方案

#在master1执行

# 安装编译环境

yum install gcc -y

# 下载解压nginx二进制文件

# wget http://nginx.org/download/nginx-1.25.3.tar.gz

tar xvf nginx-*.tar.gz

cd nginx-*

# 进行编译

./configure --with-stream --without-http --without-http_uwsgi_module --without-http_scgi_module --without-http_fastcgi_module

make && make install

# 拷贝编译好的nginx

node='k8s-master2 k8s-master3 k8s-node1 k8s-node2 k8s-node3'

for NODE in $node; do scp -r /usr/local/nginx/ $NODE:/usr/local/nginx/; done

# 这是一系列命令行指令,用于编译和安装软件。

#

# 1. `./configure` 是用于配置软件的命令。在这个例子中,配置的软件是一个Web服务器,指定了一些选项来启用流模块,并禁用了HTTP、uwsgi、scgi和fastcgi模块。

# 2. `--with-stream` 指定启用流模块。流模块通常用于代理TCP和UDP流量。

# 3. `--without-http` 指定禁用HTTP模块。这意味着编译的软件将没有HTTP服务器功能。

# 4. `--without-http_uwsgi_module` 指定禁用uwsgi模块。uwsgi是一种Web服务器和应用服务器之间的通信协议。

# 5. `--without-http_scgi_module` 指定禁用scgi模块。scgi是一种用于将Web服务器请求传递到应用服务器的协议。

# 6. `--without-http_fastcgi_module` 指定禁用fastcgi模块。fastcgi是一种用于在Web服务器和应用服务器之间交换数据的协议。

# 7. `make` 是用于编译软件的命令。该命令将根据之前的配置生成可执行文件。

# 8. `make install` 用于安装软件。该命令将生成的可执行文件和其他必要文件复制到系统的适当位置,以便可以使用该软件。写入启动配置

#在所有节点上执行

# 写入nginx配置文件

cat > /usr/local/nginx/conf/kube-nginx.conf <<EOF

worker_processes 1;

events {

worker_connections 1024;

}

stream {

upstream backend {

least_conn;

hash $remote_addr consistent;

server 192.168.100.101:6443 max_fails=3 fail_timeout=30s;

server 192.168.100.102:6443 max_fails=3 fail_timeout=30s;

server 192.168.100.103:6443 max_fails=3 fail_timeout=30s;

}

server {

listen 127.0.0.1:8443;

proxy_connect_timeout 1s;

proxy_pass backend;

}

}

EOF

# 写入启动配置文件

cat > /etc/systemd/system/kube-nginx.service <<EOF

[Unit]

Description=kube-apiserver nginx proxy

After=network.target

After=network-online.target

Wants=network-online.target

[Service]

Type=forking

ExecStartPre=/usr/local/nginx/sbin/nginx -c /usr/local/nginx/conf/kube-nginx.conf -p /usr/local/nginx -t

ExecStart=/usr/local/nginx/sbin/nginx -c /usr/local/nginx/conf/kube-nginx.conf -p /usr/local/nginx

ExecReload=/usr/local/nginx/sbin/nginx -c /usr/local/nginx/conf/kube-nginx.conf -p /usr/local/nginx -s reload

PrivateTmp=true

Restart=always

RestartSec=5

StartLimitInterval=0

LimitNOFILE=65536

[Install]

WantedBy=multi-user.target

EOF

# 设置开机自启

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now kube-nginx.service

# 启用并立即启动kube-nginx.service单元。kube-nginx.service是kube-nginx守护进程的systemd服务单元。

systemctl status kube-nginx.service

# kube-nginx.service单元的当前状态,包括运行状态、是否启用等信息。5.2.2采用负载均衡器

声明:采用负责均衡器需要把前面的配置里有带127.0.0.1:8443 和127.0.0.1的ip改为负载均衡器的IP :假设我这里用的是负载均衡器的IP为192.168.100.120:8443

操作流程如下:

我这里用的青云lb,其他厂商类似

重复上面操作在把master2.master3加进去 这样就可以了,这个比较简单

6.k8s组件启动

所有节点创建

mkdir -p /etc/kubernetes/manifests/ /etc/systemd/system/kubelet.service.d /var/lib/kubelet /var/log/kubernetes6.1创建apiserver启动服务

#注意 所有mastr执行 ,注意修改master的ip:--advertise-address=192.168.100.101

cat > /usr/lib/systemd/system/kube-apiserver.service << EOF

[Unit]

Description=Kubernetes API Server

Documentation=https://github.com/kubernetes/kubernetes

After=network.target

[Service]

ExecStart=/usr/local/bin/kube-apiserver \\

--v=2 \\

--allow-privileged=true \\

--bind-address=0.0.0.0 \\

--secure-port=6443 \\

--advertise-address=192.168.100.101 \\

--service-cluster-ip-range=10.96.0.0/16 \\

--service-node-port-range=30000-32767 \\

--etcd-servers=https://192.168.100.101:2379,https://192.168.100.102:2379,https://192.168.100.103:2379 \\

--etcd-cafile=/etc/etcd/ssl/etcd-ca.pem \\

--etcd-certfile=/etc/etcd/ssl/etcd.pem \\

--etcd-keyfile=/etc/etcd/ssl/etcd-key.pem \\

--client-ca-file=/etc/kubernetes/pki/ca.pem \\

--tls-cert-file=/etc/kubernetes/pki/apiserver.pem \\

--tls-private-key-file=/etc/kubernetes/pki/apiserver-key.pem \\

--kubelet-client-certificate=/etc/kubernetes/pki/apiserver.pem \\

--kubelet-client-key=/etc/kubernetes/pki/apiserver-key.pem \\

--service-account-key-file=/etc/kubernetes/pki/sa.pub \\

--service-account-signing-key-file=/etc/kubernetes/pki/sa.key \\

--service-account-issuer=https://kubernetes.default.svc.cluster.local \\

--kubelet-preferred-address-types=InternalIP,ExternalIP,Hostname \\

--enable-admission-plugins=NamespaceLifecycle,LimitRanger,ServiceAccount,DefaultStorageClass,DefaultTolerationSeconds,NodeRestriction,ResourceQuota \

--authorization-mode=Node,RBAC \\

--enable-bootstrap-token-auth=true \\

--requestheader-client-ca-file=/etc/kubernetes/pki/front-proxy-ca.pem \\

--proxy-client-cert-file=/etc/kubernetes/pki/front-proxy-client.pem \\

--proxy-client-key-file=/etc/kubernetes/pki/front-proxy-client-key.pem \\

--requestheader-allowed-names=aggregator \\

--requestheader-group-headers=X-Remote-Group \\

--requestheader-extra-headers-prefix=X-Remote-Extra- \\

--requestheader-username-headers=X-Remote-User \\

--enable-aggregator-routing=true

Restart=on-failure

RestartSec=10s

LimitNOFILE=65535

[Install]

WantedBy=multi-user.target

EOF

#注意修改serverip 我这里是10.96.0.0/16

--service-cluster-ip-range=10.96.0.0/16

#启动apiserver

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now kube-apiserver.service

# 启用并立即启动kube-apiserver.service单元。kube-apiserver.service是kube-apiserver守护进程的systemd服务单元。

systemctl status kube-apiserver.service

# kube-apiserver.service单元的当前状态,包括运行状态、是否启用等信息。6.2创建kube-controller-manager 启动服务

# 所有master节点配置,且配置相同

# 196.16.0.0/16为pod网段,按需求设置你自己的网段

cat > /usr/lib/systemd/system/kube-controller-manager.service << EOF

[Unit]

Description=Kubernetes Controller Manager

Documentation=https://github.com/kubernetes/kubernetes

After=network.target

[Service]

ExecStart=/usr/local/bin/kube-controller-manager \\

--v=2 \\

--bind-address=0.0.0.0 \\

--root-ca-file=/etc/kubernetes/pki/ca.pem \\

--cluster-signing-cert-file=/etc/kubernetes/pki/ca.pem \\

--cluster-signing-key-file=/etc/kubernetes/pki/ca-key.pem \\

--service-account-private-key-file=/etc/kubernetes/pki/sa.key \\

--kubeconfig=/etc/kubernetes/controller-manager.kubeconfig \\

--leader-elect=true \\

--use-service-account-credentials=true \\

--node-monitor-grace-period=40s \\

--node-monitor-period=5s \\

--controllers=*,bootstrapsigner,tokencleaner \\

--allocate-node-cidrs=true \\

--service-cluster-ip-range=10.96.0.0/12 \\

--cluster-cidr=196.16.0.0/16 \\

--node-cidr-mask-size-ipv4=24 \\

--requestheader-client-ca-file=/etc/kubernetes/pki/front-proxy-ca.pem

Restart=always

RestartSec=10s

[Install]

WantedBy=multi-user.target

EOF

#启动服务

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now kube-controller-manager.service

# 启用并立即启动kube-controller-manager.service单元。kube-controller-manager.service是kube-controller-manager守护进程的systemd服务单元。

systemctl status kube-controller-manager.service

# kube-controller-manager.service单元的当前状态,包括运行状态、是否启用等信息。6.3创建kube-scheduler 启动服务

#所有master节点配置,且配置相同

cat > /usr/lib/systemd/system/kube-scheduler.service << EOF

[Unit]

Description=Kubernetes Scheduler

Documentation=https://github.com/kubernetes/kubernetes

After=network.target

[Service]

ExecStart=/usr/local/bin/kube-scheduler \\

--v=2 \\

--bind-address=0.0.0.0 \\

--leader-elect=true \\

--kubeconfig=/etc/kubernetes/scheduler.kubeconfig

Restart=always

RestartSec=10s

[Install]

WantedBy=multi-user.target

EOF

#启动服务

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now kube-scheduler.service

# 启用并立即启动kube-scheduler.service单元。kube-scheduler.service是kube-scheduler守护进程的systemd服务单元。

systemctl status kube-scheduler.service

# kube-scheduler.service单元的当前状态,包括运行状态、是否启用等信息。6.4TLS Bootstrapping配置

TLS Bootstrapping原理参照: https://kubernetes.io/zh/docs/reference/command-line-tools-reference/kubelet-tls-bootstrapping/

#在master1上执行

# 若使用 lb负责均衡器 那么为 `--server=https://192.168.100.120:8443`

# 若使用 nginx方案,那么为 `--server=https://127.0.0.1:8443`

#准备一个随机token。但是我们只需要16个字符

head -c 16 /dev/urandom | od -An -t x | tr -d ' '

# 值如下: 737b177d9823531a433e368fcdb16f5f

# 生成16个字符的

head -c 8 /dev/urandom | od -An -t x | tr -d ' '

# 9f08a66d9cc640c5

#注意在/etc/kubernetes/pki/目录下执行

cd /etc/kubernetes/pki/

kubectl config set-cluster kubernetes \

--certificate-authority=/etc/kubernetes/pki/ca.pem \

--embed-certs=true --server=https://127.0.0.1:8443 \

--kubeconfig=/etc/kubernetes/bootstrap-kubelet.kubeconfig

#这里的token可以用自己生成的16位

kubectl config set-credentials tls-bootstrap-token-user \

--token=c8ad8c.9f08a66d9cc640c5 \

--kubeconfig=/etc/kubernetes/bootstrap-kubelet.kubeconfig

kubectl config set-context tls-bootstrap-token-user@kubernetes \

--cluster=kubernetes \

--user=tls-bootstrap-token-user \

--kubeconfig=/etc/kubernetes/bootstrap-kubelet.kubeconfig

kubectl config use-context tls-bootstrap-token-user@kubernetes \

--kubeconfig=/etc/kubernetes/bootstrap-kubelet.kubeconfig

#验证结果,查看是否有内容

cat /etc/kubernetes/bootstrap-kubelet.kubeconfig

# 1.28 版本只能查看到一个etcd 属于正常现象

#master1设置kubectl执行权限

#kubectl 能不能操作集群是看 /root/.kube 下有没有config文件,而config就是我们之前生成的admin.conf,具有操作权限的

mkdir -p /root/.kube ; cp /etc/kubernetes/admin.kubeconfig /root/.kube/config

#验证

kubectl get nodes

[root@k8s-master1 ~]# kubectl get nodes

No resources found

#说明已经可以连接apiserver并获取资源

kubectl get cs

Warning: v1 ComponentStatus is deprecated in v1.19+

NAME STATUS MESSAGE ERROR

scheduler Healthy ok

controller-manager Healthy ok

etcd-0 Healthy ok

6.5创建集群引导权限文件

#注意:这里的token-id: c8ad8c token-secret: 9f08a66d9cc640c 要和前面自己生成的token一样

vi /etc/kubernetes/bootstrap.secret.yaml

apiVersion: v1

kind: Secret

metadata:

name: bootstrap-token-c8ad8c

namespace: kube-system

type: bootstrap.kubernetes.io/token

stringData:

description: "The default bootstrap token generated by 'kubelet '."

token-id: c8ad8c

token-secret: 9f08a66d9cc640c5

usage-bootstrap-authentication: "true"

usage-bootstrap-signing: "true"

auth-extra-groups: system:bootstrappers:default-node-token,system:bootstrappers:worker,system:bootstrappers:ingress

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: kubelet-bootstrap

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: system:node-bootstrapper

subjects:

- apiGroup: rbac.authorization.k8s.io

kind: Group

name: system:bootstrappers:default-node-token

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: node-autoapprove-bootstrap

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: system:certificates.k8s.io:certificatesigningrequests:nodeclient

subjects:

- apiGroup: rbac.authorization.k8s.io

kind: Group

name: system:bootstrappers:default-node-token

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: node-autoapprove-certificate-rotation

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: system:certificates.k8s.io:certificatesigningrequests:selfnodeclient

subjects:

- apiGroup: rbac.authorization.k8s.io

kind: Group

name: system:nodes

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

annotations:

rbac.authorization.kubernetes.io/autoupdate: "true"

labels:

kubernetes.io/bootstrapping: rbac-defaults

name: system:kube-apiserver-to-kubelet

rules:

- apiGroups:

- ""

resources:

- nodes/proxy

- nodes/stats

- nodes/log

- nodes/spec

- nodes/metrics

verbs:

- "*"

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:

name: system:kube-apiserver

namespace: ""

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: system:kube-apiserver-to-kubelet

subjects:

- apiGroup: rbac.authorization.k8s.io

kind: User

name: kube-apiserver

# 切记执行,别忘记!!!

kubectl create -f bootstrap.secret.yaml6.6node节点配置

#在master01上将证书复制到node节点

cd /etc/kubernetes/

for NODE in k8s-master2 k8s-master3 k8s-node1 k8s-node2 k8s-node3; do ssh $NODE mkdir -p /etc/kubernetes/pki; for FILE in pki/ca.pem pki/ca-key.pem pki/front-proxy-ca.pem bootstrap-kubelet.kubeconfig kube-proxy.kubeconfig; do scp /etc/kubernetes/$FILE $NODE:/etc/kubernetes/${FILE}; done; done6.7kubelet配置

#使用docker作为Runtime

#所有节点配置kubelet.service

cat > /usr/lib/systemd/system/kubelet.service << EOF

[Unit]

Description=Kubernetes Kubelet

Documentation=https://github.com/kubernetes/kubernetes

After=network-online.target firewalld.service cri-docker.service docker.socket containerd.service

Wants=network-online.target

Requires=docker.socket containerd.service

[Service]

ExecStart=/usr/local/bin/kubelet \\

--bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.kubeconfig \\

--kubeconfig=/etc/kubernetes/kubelet.kubeconfig \\

--config=/etc/kubernetes/kubelet-conf.yml \\

--container-runtime-endpoint=unix:///run/cri-dockerd.sock \\

--node-labels=node.kubernetes.io/node=

[Install]

WantedBy=multi-user.target

EOF

cat > /usr/lib/systemd/system/kubelet.service << EOF

[Unit]

Description=Kubernetes Kubelet

Documentation=https://github.com/kubernetes/kubernetes

After=network-online.target firewalld.service cri-docker.service docker.socket containerd.service

Wants=network-online.target

Requires=docker.socket containerd.service

[Service]

ExecStart=/usr/local/bin/kubelet \\

--bootstrap-kubeconfig=/etc/kubernetes/bootstrap-kubelet.kubeconfig \\

--kubeconfig=/etc/kubernetes/kubelet.kubeconfig \\

--config=/etc/kubernetes/kubelet-conf.yml \\

--container-runtime-endpoint=unix:///run/cri-dockerd.sock \\

--node-labels=node.kubernetes.io/node= \\

--node-ip=192.168.100.106

[Install]

WantedBy=multi-user.target

EOF

#--node-ip为每个节点的ip

#所有k8s节点创建kubelet的配置文件

#clusterDNS 为service网络的第10个ip值,改成自己的。如:10.96.0.10

cat > /etc/kubernetes/kubelet-conf.yml <<EOF

apiVersion: kubelet.config.k8s.io/v1beta1

kind: KubeletConfiguration

address: 0.0.0.0

port: 10250

readOnlyPort: 10255

authentication:

anonymous:

enabled: false

webhook:

cacheTTL: 2m0s

enabled: true

x509:

clientCAFile: /etc/kubernetes/pki/ca.pem

authorization:

mode: Webhook

webhook:

cacheAuthorizedTTL: 5m0s

cacheUnauthorizedTTL: 30s

cgroupDriver: systemd

cgroupsPerQOS: true

clusterDNS:

- 10.96.0.10

clusterDomain: cluster.local

containerLogMaxFiles: 5

containerLogMaxSize: 10Mi

contentType: application/vnd.kubernetes.protobuf

cpuCFSQuota: true

cpuManagerPolicy: none

cpuManagerReconcilePeriod: 10s

enableControllerAttachDetach: true

enableDebuggingHandlers: true

enforceNodeAllocatable:

- pods

eventBurst: 10

eventRecordQPS: 5

evictionHard:

imagefs.available: 15%

memory.available: 100Mi

nodefs.available: 10%

nodefs.inodesFree: 5%

evictionPressureTransitionPeriod: 5m0s

failSwapOn: true

fileCheckFrequency: 20s

hairpinMode: promiscuous-bridge

healthzBindAddress: 127.0.0.1

healthzPort: 10248

httpCheckFrequency: 20s

imageGCHighThresholdPercent: 85

imageGCLowThresholdPercent: 80

imageMinimumGCAge: 2m0s

iptablesDropBit: 15

iptablesMasqueradeBit: 14

kubeAPIBurst: 10

kubeAPIQPS: 5

makeIPTablesUtilChains: true

maxOpenFiles: 1000000

maxPods: 110

nodeStatusUpdateFrequency: 10s

oomScoreAdj: -999

podPidsLimit: -1

registryBurst: 10

registryPullQPS: 5

resolvConf: /etc/resolv.conf

rotateCertificates: true

runtimeRequestTimeout: 2m0s

serializeImagePulls: true

staticPodPath: /etc/kubernetes/manifests

streamingConnectionIdleTimeout: 4h0m0s

syncFrequency: 1m0s

volumeStatsAggPeriod: 1m0s

EOF

#启动kubelet

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now kubelet.service

# 启用并立即启动kubelet.service单元。kubelet.service是kubelet守护进程的systemd服务单元。

systemctl status kubelet.service

# kubelet.service单元的当前状态,包括运行状态、是否启用等信息。

#查看容器运行时

kubectl describe node | grep Runtime

6.8kube-proxy配置

#将kubeconfig发送至其他节点

# master-1执行

for NODE in k8s-master2 k8s-master3 k8s-node1 k8s-node2 k8s-node2; do scp /etc/kubernetes/kube-proxy.kubeconfig $NODE:/etc/kubernetes/kube-proxy.kubeconfig; done

#所有k8s节点添加kube-proxy的service文件

#--cluster-cidr为pod的网段

cat > /usr/lib/systemd/system/kube-proxy.service << EOF

[Unit]

Description=Kubernetes Kube Proxy

Documentation=https://github.com/kubernetes/kubernetes

After=network.target

[Service]

ExecStart=/usr/local/bin/kube-proxy \\

--config=/etc/kubernetes/kube-proxy.yaml \\

--cluster-cidr=196.16.0.0/16 \\

--v=2

Restart=always

RestartSec=10s

[Install]

WantedBy=multi-user.target

EOF

#所有k8s节点添加kube-proxy的配置

cat > /etc/kubernetes/kube-proxy.yaml << EOF

apiVersion: kubeproxy.config.k8s.io/v1alpha1

bindAddress: 0.0.0.0

clientConnection:

acceptContentTypes: ""

burst: 10

contentType: application/vnd.kubernetes.protobuf

kubeconfig: /etc/kubernetes/kube-proxy.kubeconfig

qps: 5

clusterCIDR: 196.16.0.0/16

configSyncPeriod: 15m0s

conntrack:

max: null

maxPerCore: 32768

min: 131072

tcpCloseWaitTimeout: 1h0m0s

tcpEstablishedTimeout: 24h0m0s

enableProfiling: false

healthzBindAddress: 0.0.0.0:10256

hostnameOverride: ""

iptables:

masqueradeAll: false

masqueradeBit: 14

minSyncPeriod: 0s

syncPeriod: 30s

ipvs:

masqueradeAll: true

minSyncPeriod: 5s

scheduler: "rr"

syncPeriod: 30s

kind: KubeProxyConfiguration

metricsBindAddress: 127.0.0.1:10249

mode: "ipvs"

nodePortAddresses: null

oomScoreAdj: -999

portRange: ""

udpIdleTimeout: 250ms

EOF

#启动服务

systemctl daemon-reload

# 用于重新加载systemd管理的单位文件。当你新增或修改了某个单位文件(如.service文件、.socket文件等),需要运行该命令来刷新systemd对该文件的配置。

systemctl enable --now kube-proxy.service

# 启用并立即启动kube-proxy.service单元。kube-proxy.service是kube-proxy守护进程的systemd服务单元。

systemctl status kube-proxy.service

# kube-proxy.service单元的当前状态,包括运行状态、是否启用等信息。

7.安装网络插件

部署calico

# 下载官网calico

wget https://calico-v3-25.netlify.app/archive/v3.25/manifests/calico-etcd.yaml

## 把这个镜像修改成国内镜像

# 修改一些我们自定义的. 修改etcd集群地址

sed -i 's#etcd_endpoints: "http://<ETCD_IP>:<ETCD_PORT>"#etcd_endpoints: "https://192.168.100.101:2379,https://192.168.100.102:2379,https://192.168.100.103:2379"#g' calico.yaml

# etcd的证书内容,需要base64编码设置到yaml中 这里要注意自己etcd申请证书的名字、ca.pem、etcd.pem、etcd-key.pem

ETCD_CA=`cat /etc/kubernetes/pki/etcd/ca.pem | base64 -w 0 `

ETCD_CERT=`cat /etc/kubernetes/pki/etcd/etcd.pem | base64 -w 0 `

ETCD_KEY=`cat /etc/kubernetes/pki/etcd/etcd-key.pem | base64 -w 0 `

# 替换etcd中的证书base64编码后的内容

sed -i "s@# etcd-key: null@etcd-key: ${ETCD_KEY}@g; s@# etcd-cert: null@etcd-cert: ${ETCD_CERT}@g; s@# etcd-ca: null@etcd-ca: ${ETCD_CA}@g" calico.yaml

#打开 etcd_ca 等默认设置(calico启动后自己生成)。

sed -i 's#etcd_ca: ""#etcd_ca: "/calico-secrets/etcd-ca"#g; s#etcd_cert: ""#etcd_cert: "/calico-secrets/etcd-cert"#g; s#etcd_key: "" #etcd_key: "/calico-secrets/etcd-key" #g' calico.yaml

# 修改自己的Pod网段 196.16.0.0/16

POD_SUBNET="196.16.0.0/16"

sed -i 's@# - name: CALICO_IPV4POOL_CIDR@- name: CALICO_IPV4POOL_CIDR@g; s@# value: "192.168.0.0/16"@ value: '"${POD_SUBNET}"'@g' calico.yaml

# 一定确定自己是否修改好了

#确认calico是否修改好

grep "CALICO_IPV4POOL_CIDR" calico.yaml -A 1

# 应用calico配置

kubectl apply -f calico.yaml8.部署coreDNS

git clone https://github.com/coredns/deployment.git

cd deployment/kubernetes

#10.96.0.10 改为 service 网段的 第 10 个ip

./deploy.sh -s -i 10.96.0.10 | kubectl apply -f -验证:kubectl get pod -A 看到状态running可以了

9.部署命令补全

为了后续的操作跟流畅,有个命令补全是相当舒服的

命令自动补全

#安装

yum install bash-completion

echo 'source <(kubectl completion bash)' >>~/.bashrc

kubectl completion bash >/etc/bash_completion.d/kubectl

source /usr/share/bash-completion/bash_completion10.验证集群可用性

1.首先给master节点打上污点,二进制搭建的集群是没有污点的

#给master1 master2 打上污点

kubectl taint nodes k8s-master2 node-role.kubernetes.io/master=:NoSchedule

kubectl taint nodes k8s-master1 node-role.kubernetes.io/master=:NoSchedule

#验证

kubectl describe nodes k8s-master |grep Taints

2.部署应用验证

我这里写了一个简单 yaml文件

# 部署以下内容进行测试

vi test.yaml

#把下面的内容写进去

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-01

namespace: default

labels:

app: nginx-01

spec:

selector:

matchLabels:

app: nginx-01

replicas: 1

template:

metadata:

labels:

app: nginx-01

spec:

containers:

- name: nginx-01

image: nginx

---

apiVersion: v1

kind: Service

metadata:

name: nginx-svc

namespace: default

spec:

selector:

app: nginx-01

type: ClusterIP

ports:

- name: nginx-svc

port: 80

targetPort: 80

protocol: TCP

---

apiVersion: v1

kind: Namespace

metadata:

name: hello

spec: {}

---

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-hello

namespace: hello

labels:

app: nginx-hello

spec:

selector:

matchLabels:

app: nginx-hello

replicas: 1

template:

metadata:

labels:

app: nginx-hello

spec:

containers:

- name: nginx-hello

image: nginx

---

apiVersion: v1

kind: Service

metadata:

name: nginx-svc-hello

namespace: hello

spec:

selector:

app: nginx-hello

type: ClusterIP

ports:

- name: nginx-svc-hello

port: 80

targetPort: 80

protocol: TCP

#部署

[root@k8s-master1 ~]# kubectl apply -f test.yaml

#查看pod是否起来

kubectl get pod -A

[root@k8s-master1 ~]# kubectl get pod -A

NAMESPACE NAME READY STATUS RESTARTS AGE

default nginx-01-588bfd5ff5-5lvn4 1/1 Running 1 (39h ago) 40h

hello nginx-hello-76d9b8c6bf-v89gh 1/1 Running 0 41m

#测试pod之前是否能通信

[root@k8s-master1 ~]# kubectl get pod -A -owide

NAMESPACE NAME READY STATUS RESTARTS AGE IP NODE N OMINATED NODE READINESS GATES

default nginx-01-588bfd5ff5-5lvn4 1/1 Running 1 (39h ago) 40h 196.16.135.194 k8s-master3 < none> <none>

hello nginx-hello-76d9b8c6bf-v89gh 1/1 Running 0 44m 196.16.135.196 k8s-master3 <

#测试是否能访问nginx

curl 196.16.135.194

curl 196.16.135.194

#进入pod,在pod里测试

kubectl exec -it nginx-01-588bfd5ff5-5lvn4 -- /bin/bash //进入pod命令

#测试能否访问hello名称空间的nginx

root@nginx-01-588bfd5ff5-5lvn4:/# curl 196.16.135.196

#测试通过域名的方式访问

[root@k8s-master1 ~]# kubectl get svc -A //查看ClusterIP 名字

NAMESPACE NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE

default kubernetes ClusterIP 10.96.0.1 <none> 443/TCP 46h

default nginx-svc ClusterIP 10.106.255.216 <none> 80/TCP 40h

hello nginx-svc-hello ClusterIP 10.111.232.173 <none> 80/TCP 40h

kube-system kube-dns ClusterIP 10.96.0.10 <none> 53/UDP,53/TCP,9153/TCP 41h

#测试 curl name.名称空间

root@nginx-01-588bfd5ff5-5lvn4:/# curl nginx-svc-hello.hello

#通过ClusterIP 访问

root@nginx-01-588bfd5ff5-5lvn4:/# curl 10.111.232.173

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)