Paraformer语音识别-中文-通用-16k-离线-large-长音频版

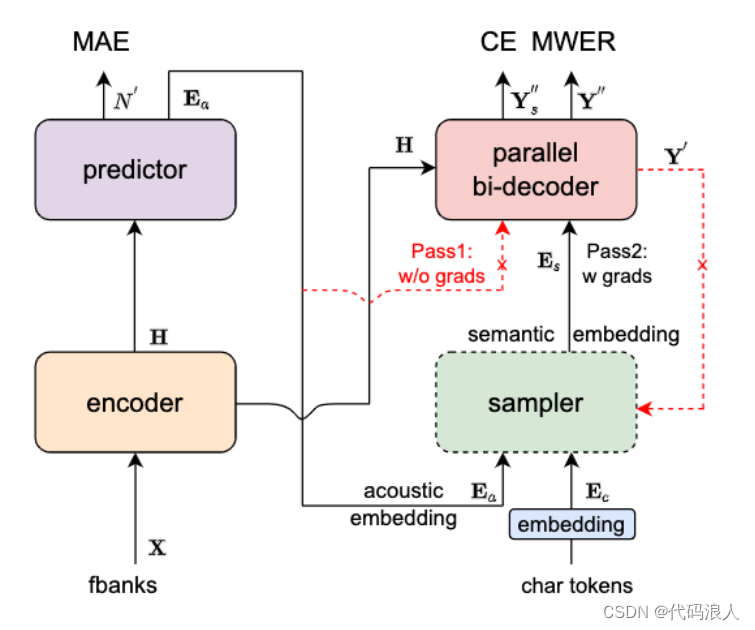

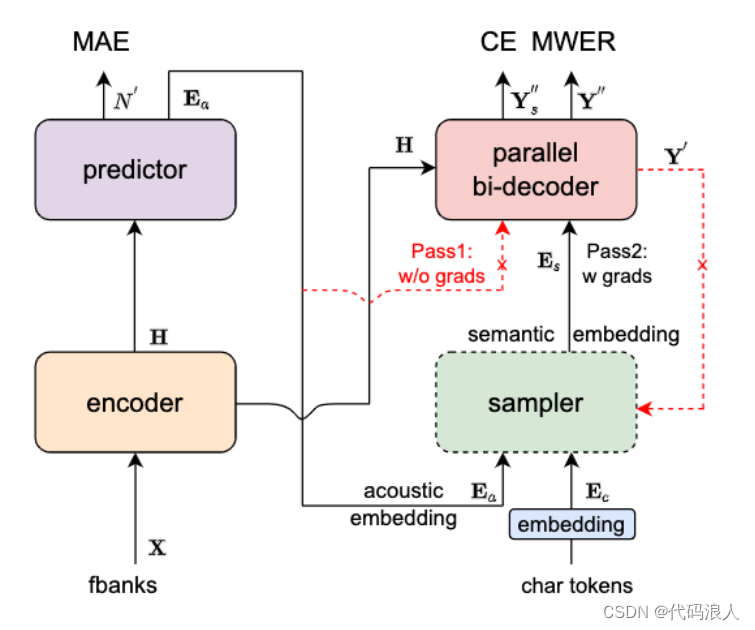

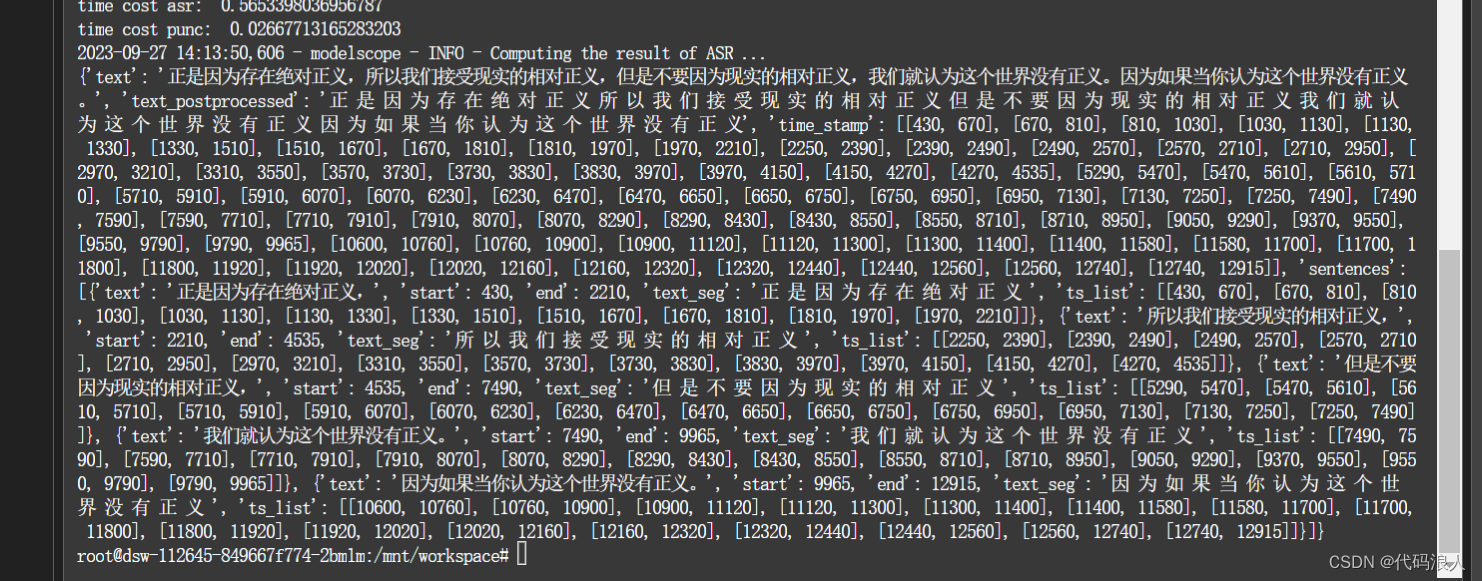

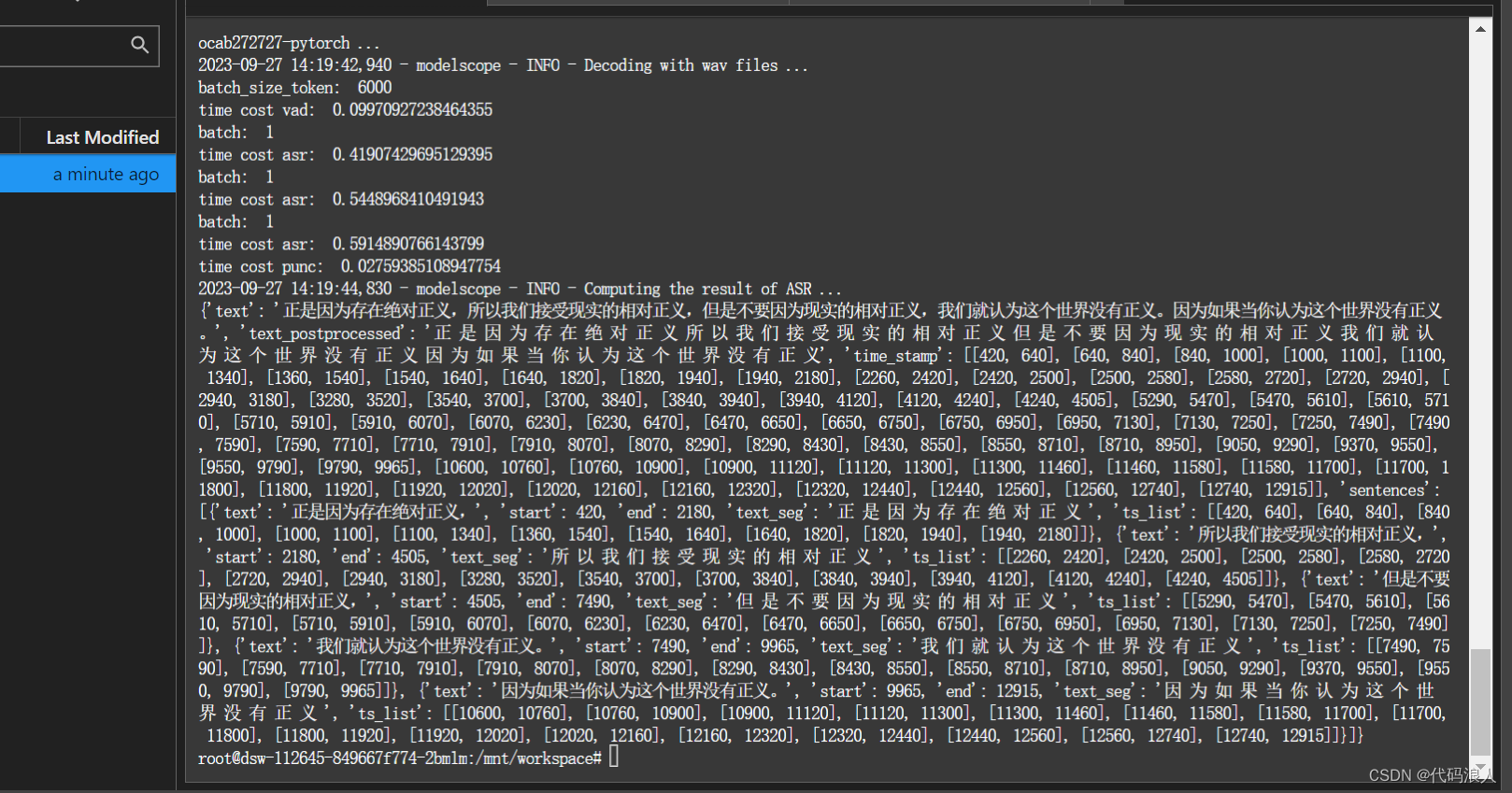

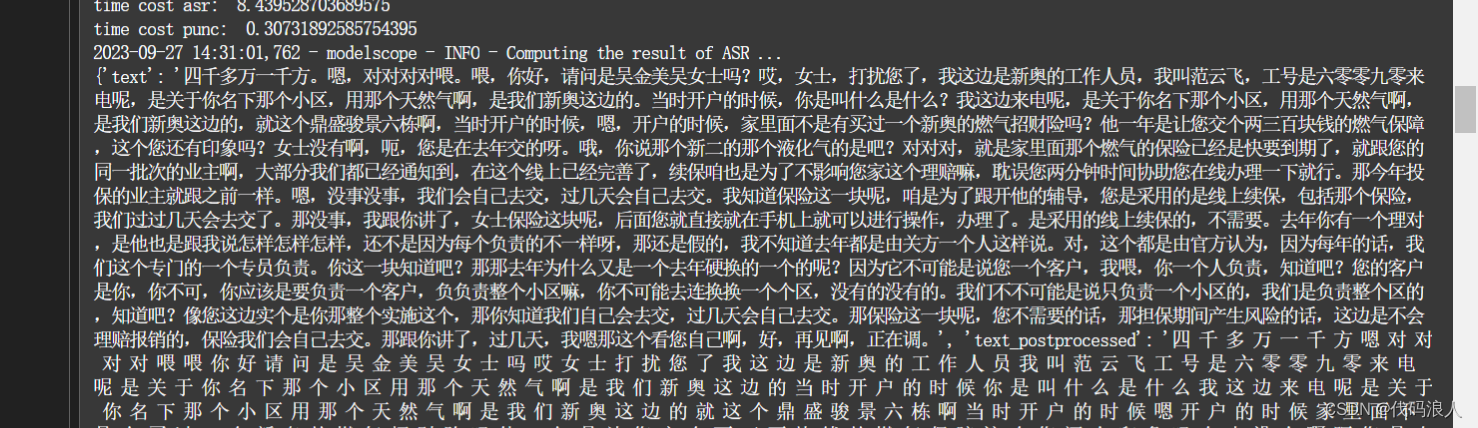

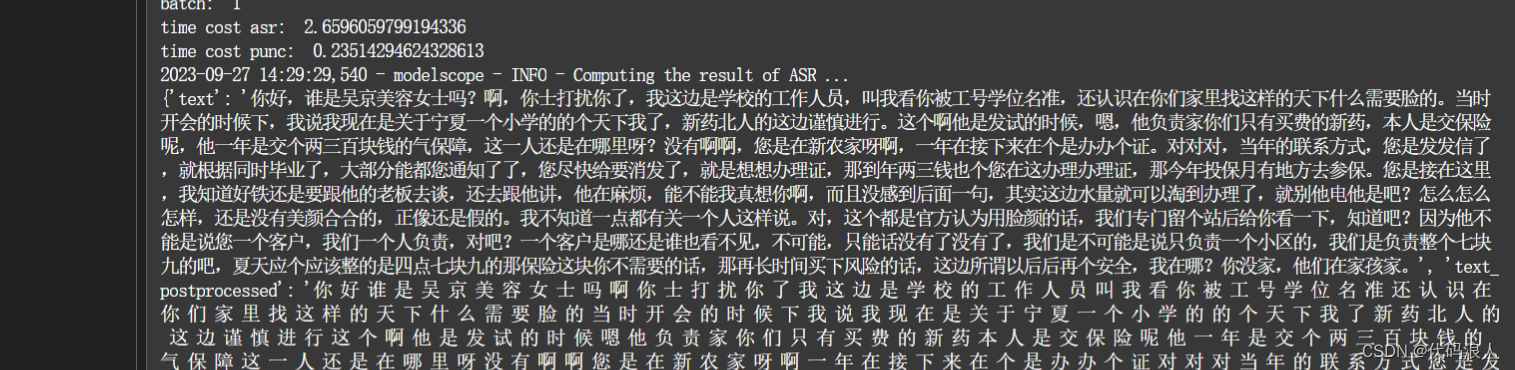

Paraformer是达摩院语音团队提出的一种高效的非自回归端到端语音识别框架。本项目为Paraformer中文通用语音识别模型,采用工业级数万小时的标注音频进行模型训练,保证了模型的通用识别效果。模型可以被应用于语音输入法、语音导航、智能会议纪要等场景。Paraformer模型结构如上图所示,由 Encoder、Predictor、Sampler、Decoder 与 Loss function

文章目录

一、亮点

- Paraformer-large长音频模型集成

VAD、ASR、标点与时间戳功能,可直接对时长为数小时音频进行识别,并输出带标点文字与时间戳

ASR模型:Parformer-large模型结构为非自回归语音识别模型,多个中文公开数据集上取得SOTA效果,可快速地基于ModelScope对模型进行微调定制和推理。

热词版本:Paraformer-large热词版模型支持热词定制功能,基于提供的热词列表进行激励增强,提升热词的召回率和准确率。

二、ModelScope-FunASR

三、项目介绍

Paraformer是达摩院语音团队提出的一种高效的非自回归端到端语音识别框架。本项目为Paraformer中文通用语音识别模型,采用工业级数万小时的标注音频进行模型训练,保证了模型的通用识别效果。模型可以被应用于语音输入法、语音导航、智能会议纪要等场景。

Paraformer模型结构如上图所示,由 Encoder、Predictor、Sampler、Decoder 与 Loss function 五部分组成.

- Encoder可以采用不同的网络结构,例如self-attention,conformer,SAN-M等

- Predictor 为两层FFN,

预测目标文字个数以及抽取目标文字对应的声学向量。 - Sampler 为无可学习参数模块,

依据输入的声学向量和目标向量,生产含有语义的特征向量。 - Decoder 结构与自回归模型类似,为双向建模(自回归为单向建模)

- Loss function 部分,除了交叉熵(CE)与 MWER 区分性优化目标,还包括了 Predictor 优化目标 MAE。

其核心点主要有:

- Predictor 模块:基于 Continuous integrate-and-fire (CIF) 的 预测器 (Predictor) 来

抽取目标文字对应的声学特征向量,可以更加准确的预测语音中目标文字个数。 - Sampler:通过采样,将声学特征向量与目标文字向量

变换成含有语义信息的特征向量,配合双向的 Decoder 来增强模型对于上下文的建模能力。 - 基于负样本采样的 MWER 训练准则。

四、如何使用与训练自己的模型

本项目提供的预训练模型是基于大数据训练的通用领域识别模型,开发者可以基于此模型进一步利用ModelScope的微调功能或者本项目对应的Github代码仓库FunASR进一步进行模型的领域定制化。

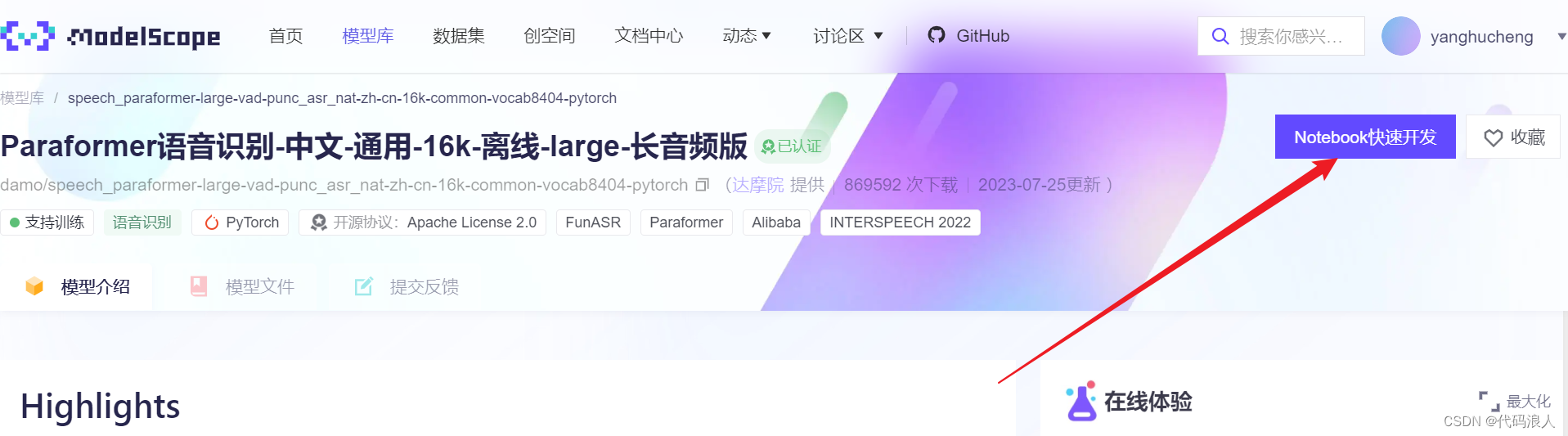

4.1 在Notebook中开发

对于有开发需求的使用者,特别推荐您使用Notebook进行离线处理。先登录ModelScope账号,点击模型页面右上角的“在Notebook中打开”按钮出现对话框,首次使用会提示您关联阿里云账号,按提示操作即可。关联账号后可进入选择启动实例界面,选择计算资源,建立实例,待实例创建完成后进入开发环境,进行调用。

4.2 基于ModelScope进行推理

4.2.1 若输入格式wav文件url,api调用方式可参考如下范例:

from modelscope.pipelines import pipeline

from modelscope.utils.constant import Tasks

inference_pipeline = pipeline(

task=Tasks.auto_speech_recognition,

model='damo/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-pytorch',

model_revision="v1.2.4")

rec_result = inference_pipeline(audio_in='https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/test_audio/asr_vad_punc_example.wav')

print(rec_result)

4.2.2 输入音频为pcm格式,调用api时需要传入音频采样率参数audio_fs,例如:

rec_result = inference_pipeline(audio_in='https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/test_audio/asr_vad_punc_example.pcm', audio_fs=16000)

4.2.3 输入音频为wav格式,api调用方式可参考如下范例:

rec_result = inference_pipeline(audio_in='asr_vad_punc_example.wav')

4.2.4 若输入格式为文件wav.scp(注:文件名需要以.scp结尾),可添加 output_dir 参数将识别结果写入文件中,api调用方式可参考如下范例:

inference_pipeline = pipeline(

task=Tasks.auto_speech_recognition,

model='damo/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-pytorch',

model_revision="v1.2.4",

output_dir='./output_dir')

inference_pipeline(audio_in="wav.scp")

识别结果输出路径结构如下:

tree output_dir/

output_dir/

└── 1best_recog

├── rtf

├── score

├── text

└── time_stamp

1 directory, 4 files

-

rtf:计算过程耗时统计

-

score:识别路径得分

-

text:语音识别结果文件

-

time_stamp:时间戳结果文件

4.2.5 若输入音频为已解析的audio音频,api调用方式可参考如下范例:

import soundfile

waveform, sample_rate = soundfile.read("asr_vad_punc_example.wav")

rec_result = inference_pipeline(audio_in=waveform)

4.2.6 ASR、VAD、PUNC模型自由组合

可根据使用需求对VAD和PUNC标点模型进行自由组合,使用方式如下:

inference_pipeline = pipeline(

task=Tasks.auto_speech_recognition,

model='damo/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-pytorch',

vad_model='damo/speech_fsmn_vad_zh-cn-16k-common-pytorch',

punc_model='damo/punc_ct-transformer_zh-cn-common-vocab272727-pytorch',

)

如需加入LM模型,可增加配置lm_model='damo/speech_transformer_lm_zh-cn-common-vocab8404-pytorch'。

长音频版本模型中集成了VAD、ASR、标点模型

若不使用VAD或标点模型,可设置参数vad_model=““或punc_model=””,具体使用方式可参考文档,例如:

inference_pipeline = pipeline(

task=Tasks.auto_speech_recognition,

model='damo/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-pytorch',

vad_model='',

punc_model='',

)

长音频版本模型默认开启时间戳,若不使用时间戳,可通过传入参数param_dict['use_timestamp'] = False关闭时间戳,使用方式如下:

param_dict['use_timestamp'] = False

rec_result = inference_pipeline(audio_in='https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/test_audio/asr_vad_punc_example.wav', param_dict=param_dict)

)

4.3 基于ModelScope进行微调

4.3.1 基于ModelScope上数据集进行微调:

以AISHELL-1数据集为例,完整数据集已经上传ModelScope,可通过数据集英文名(speech_asr_aishell1_trainsets)搜索:

import os

from modelscope.metainfo import Trainers

from modelscope.trainers import build_trainer

from modelscope.msdatasets.audio.asr_dataset import ASRDataset

def modelscope_finetune(params):

if not os.path.exists(params.output_dir):

os.makedirs(params.output_dir, exist_ok=True)

# dataset split ["train", "validation"]

ds_dict = ASRDataset.load(params.data_path, namespace='speech_asr')

kwargs = dict(

model=params.model,

data_dir=ds_dict,

dataset_type=params.dataset_type,

work_dir=params.output_dir,

batch_bins=params.batch_bins,

max_epoch=params.max_epoch,

lr=params.lr)

trainer = build_trainer(Trainers.speech_asr_trainer, default_args=kwargs)

trainer.train()

if __name__ == '__main__':

from funasr.utils.modelscope_param import modelscope_args

params = modelscope_args(model="damo/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-pytorch")

params.output_dir = "./checkpoint" # 模型保存路径

params.data_path = "speech_asr_aishell1_trainsets" # 数据路径,可以为modelscope中已上传数据,也可以是本地数据

params.dataset_type = "small" # 小数据量设置small,若数据量大于1000小时,请使用large

params.batch_bins = 2000 # batch size,如果dataset_type="small",batch_bins单位为fbank特征帧数,如果dataset_type="large",batch_bins单位为毫秒,

params.max_epoch = 50 # 最大训练轮数

params.lr = 0.00005 # 设置学习率

modelscope_finetune(params)

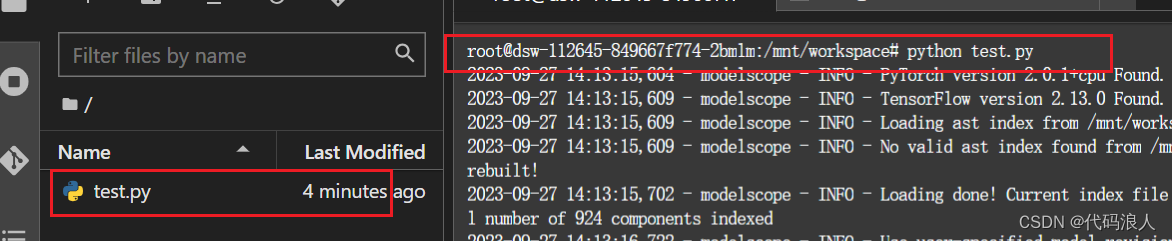

可将上述代码保存为py文件(如finetune.py),直接python finetune.py运行;若使用多卡进行训练,如下命令:

CUDA_VISIBLE_DEVICES=1,2 python -m torch.distributed.launch --nproc_per_node 2 finetune.py > log.txt 2>&1

4.3.2 基于私有数据集进行微调: 只需要设置本地数据存放路径即可:

params.data_path = "speech_asr_aishell1_trainsets"

私有数据集格式按如下准备

tree ./example_data/

./example_data/

├── validation

│ ├── text

│ └── wav.scp

└── train

├── text

└── wav.scp

2 directories, 4 files

其中,text文件中存放音频标注,wav.scp文件中存放wav音频绝对路径,样例如下:

cat ./example_data/text

BAC009S0002W0122 而 对 楼 市 成 交 抑 制 作 用 最 大 的 限 购

BAC009S0002W0123 也 成 为 地 方 政 府 的 眼 中 钉

english_example_1 hello world

english_example_2 go swim 去 游 泳

cat ./example_data/wav.scp

BAC009S0002W0122 /mnt/data/wav/train/S0002/BAC009S0002W0122.wav

BAC009S0002W0123 /mnt/data/wav/train/S0002/BAC009S0002W0123.wav

english_example_1 /mnt/data/wav/train/S0002/english_example_1.wav

english_example_2 /mnt/data/wav/train/S0002/english_example_2.wav

五、在本地机器中开发

基于ModelScope进行微调和推理

支持基于ModelScope上数据集及私有数据集进行定制微调和推理,使用方式同Notebook中开发。

5.1 基于FunASR进行微调和推理

FunASR框架支持魔搭社区开源的工业级的语音识别模型的training & finetuning,使得研究人员和开发者可以更加便捷的进行语音识别模型的研究和生产,目前已在Github开源:https://github.com/alibaba-damo-academy/FunASR

5.1.1 FunASR框架安装

安装FunASR和ModelScope 详情

pip3 install -U modelscope

git clone https://github.com/alibaba/FunASR.git && cd FunASR

pip3 install -e ./

5.1.2 基于FunASR进行推理

接下来会以私有数据集为例,介绍如何在FunASR框架中使用Paraformer-large进行推理以及微调。

cd egs_modelscope/paraformer/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-pytorch

python infer.py

5.1.3 基于FunASR进行微调

cd egs_modelscope/paraformer/speech_paraformer-large-vad-punc_asr_nat-zh-cn-16k-common-vocab8404-pytorch

python finetune.py

多卡进行微调训练用法与notebook中相同。

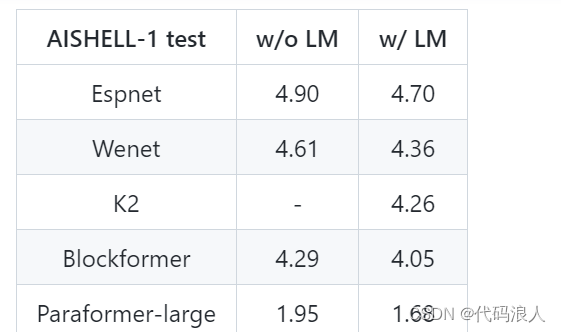

六、测试结果

结合大数据、大模型优化的Paraformer在一序列语音识别的benchmark上获得当前SOTA的效果,以下展示学术数据集AISHELL-1、AISHELL-2、WenetSpeech,公开评测项目SpeechIO TIOBE白盒测试场景的效果。在学术界常用的中文语音识别评测任务中,其表现远远超于目前公开发表论文中的结果,远好于单独封闭数据集上的模型。此结果为Paraformer-large模型在无VAD和标点模型下的测试结果。

七、使用方式以及适用范围

运行范围

- 支持Linux-x86_64、Mac和Windows运行。

使用方式

- 直接推理:可以直接对输入音频进行解码,输出目标文字。

- 微调:加载训练好的模型,采用私有或者开源数据进行模型训练。

使用范围与目标场景

适合与离线语音识别场景,如录音文件转写,配合GPU推理效果更加,输入音频时长不限制,可以为几个小时音频。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)