简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

一个专注于探索生成式AI前沿技术及其应用的实验室。我们致力于推动生成式AI在各个领域的创新与突破,挖掘其潜在的应用场景,为企业和个人提供切实可行的解决方案。

淘宝推荐系统的革命性升级:RecGPT如何让购物变得更智能

更重要的是,用户点击的商品类别多样性提升了6.96%,这表明系统成功地帮助用户发现了更多元化的商品,打破了传统推荐系统容易形成的"信息茧房"。比如不是简单地说"你可能喜欢运动用品",而是会具体到"透气性好的跑步短裤"、"防滑耐磨的瑜伽垫"这样的程度。在这个信息爆炸的时代,RecGPT提供了一种新的可能性:让技术不是简单地迎合用户的表面需求,而是深度理解用户的真实需要,帮助每个人发现更好的生活可能。

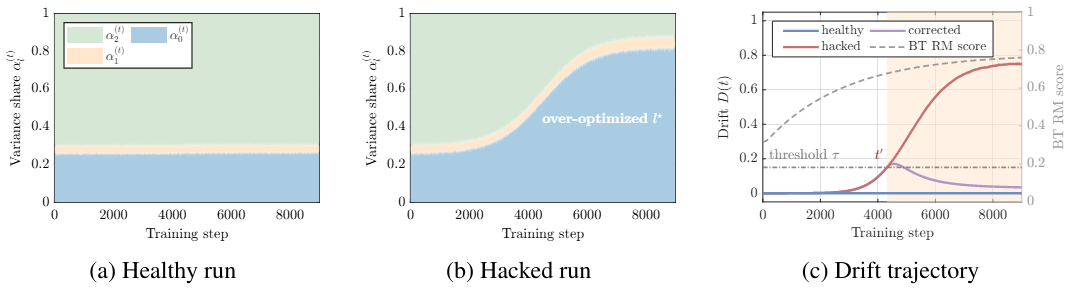

奖励分数越高,模型越烂?斯坦福这篇论文找到了破解之法

奖励分数越高,模型越烂?斯坦福这篇论文找到了破解之法

OpenAI要告苹果了?

OpenAI要告苹果了?

微软AI负责人苏莱曼转向超级智能研究,Copilot业务重新调整

微软AI负责人苏莱曼转向超级智能研究,Copilot业务重新调整

Claude坐到你的电脑前,然后它开始自己动手了

Claude坐到你的电脑前,然后它开始自己动手了

自动驾驶的“ChatGPT时刻“:NVIDIA让汽车学会了因果推理

自动驾驶的"ChatGPT时刻":NVIDIA让汽车学会了因果推理

Anthropic Claude Code和Cowork新增计算机控制功能

Anthropic Claude Code和Cowork新增计算机控制功能

ChatGPT与Gemini争夺AI购物助手主导权

ChatGPT与Gemini争夺AI购物助手主导权

Vibe Coding XR:结合XR Blocks和Gemini加速AI+XR原型开发

Vibe Coding XR:结合XR Blocks和Gemini加速AI+XR原型开发

Anthropic发布Claude Code“自动模式“避免大规模文件删除等问题

Anthropic发布Claude Code"自动模式"避免大规模文件删除等问题