简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

Claude Code是一个完整的AI Agent运行时框架,具备终端交互、多Agent协作和智能编程能力。其分层架构包括接入层、交互控制层、核心引擎层等6个层级,采用严格自上而下的依赖关系。核心模块包括多入口启动系统、负责LLM调用的QueryEngine引擎,以及基于接口驱动的插件化工具系统。该系统支持40+可组合工具、多Agent并行编排、持久化记忆等功能,采用TypeScript+Bun技

aider其实是ai coder的缩写,可以说是一个ai programmer,可以根据需求编写代码,可以分析代码,重构代码等。比一般的代码助手更加智能。目前还处于比较初级的版本,但已经具备一定的可用性。本文介绍aider的本地部署和使用,通过ollama的部署和使用可以让aider使用本地部署的大模型。比如:qwen或deepseek等。ollama的安装和模型的拉取,可以参考我前面的文章,这里

本文使用deepseek大模型来进行本地中文问答。另外,嵌入模型使用中文嵌入模型:dmeta-embedding-zh。由于我只有16C64G的CPU配置,所以只能使用:deepseek-llm:7b。因为,deepseek_v2这个模型在该配置下跑不起来。

使用该配置,再回到cody界面进行配置时,就会发现多了ollama的选项。此时就可以通过ollama来使用本地大模型了。

数字世界正面临一场由AI智能体、机器身份激增和"氛围编码"引发的身份危机。传统基于人类用户的身份验证机制被颠覆,静态凭证难以应对动态AI行为,开发速度与安全的矛盾加剧。新范式需从静态身份转向动态行为信任,结合短期凭证、行为分析和情境感知构建信任网络。未来的安全必须融合密码学、上下文和行为信号,在AI主导的时代重构身份管理规则。

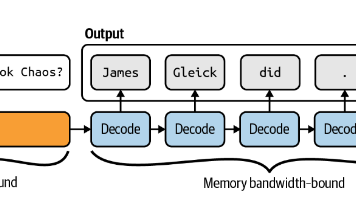

和传统的机器学习模型类似,大模型也可以分为:模型训练和模型推理两个过程。模型训练就是给定的数据和算法训练出一个模型(一堆文件,包括:模型权重、配置等),然后就可以使用该模型来进行预测或分类等操作。模型推理(Model inference)是使用已训练的机器学习模型根据新的输入数据生成预测的过程。

DeepSeek 将思维链推理、强化学习和模型蒸馏结合在一起,使其成为一款强大的工具。这不仅仅是原始能力的问题。而是要创建准确、透明、易用的模型。思维链使模型的推理清晰明了。强化学习使其随着时间的推移不断改进。而蒸馏则确保了这些能力能够为更多人所使用,而不仅仅是那些能够使用超级计算机的人。如果你对人工智能感兴趣,DeepSeek值得关注。它不仅仅是另一项渐进式改进。它是朝着能够以以前无法企及的方式

失败模式解决方案Agent 尝试一次性完成整个应用功能列表 + 增量式进展(一次一个功能)后续 Agent 过早宣布完成功能列表明确标记完成状态会话之间丢失上下文claude-progress.txt + git 日志代码状态混乱描述性 commit + 进度摘要测试不充分浏览器自动化 + 端到端测试无法快速恢复工作状态init.sh + 基础测试流程有效的 Agent 系统设计需要从人类工程实践

本文实现了一个简单的智能Agent,该Agent先从数据库中查询出数据,然后再通过工具函数来对数据进行处理。这是一个非常常见的场景。从这个场景可以扩展到多个实际的场景。

可以通过一个全局状态,来保留任意数据或函数以供所有事件处理程序使用。