简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

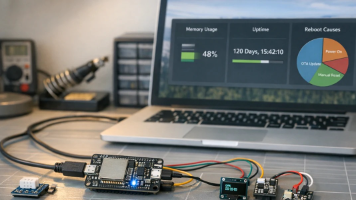

ESPHome 设备几周后重启或卡顿,通常不是单一 YAML 写错,而是内存碎片、最小可用 heap、Wi-Fi 抖动、传感器阻塞和日志策略共同累积。本文给出 ESP32 长期稳定性调试路径。

设备在线不是一个单字段,而是心跳、连接会话、最后上报时间和异常断链信号共同组成的判断模型。本文给出更稳的 IoT 在线状态设计,说明 Heartbeat、Connectivity、Last Seen 和 MQTT LWT 应该如何组合。

多模态边缘系统真正难的地方,通常不是单个模型能不能跑通,而是语音、视频、事件流如何在有限算力与不稳定网络下保持低时延、可对齐、可诊断、可回滚。本文给出一套更适合落地的判断框架。

很多 Edge AI 项目上线后,并不是先败在模型精度,而是先败在日志缺失、监控不足和远程诊断无从下手。本文解释 Edge AI 为什么必须把可观测性当成系统能力来设计,并给出从 ESP32 到 Linux 边缘盒子的最小落地方法。

很多 Edge AI 项目上线后,并不是先败在模型精度,而是先败在日志缺失、监控不足和远程诊断无从下手。本文解释 Edge AI 为什么必须把可观测性当成系统能力来设计,并给出从 ESP32 到 Linux 边缘盒子的最小落地方法。

面向嵌入式与边缘AI工程师的RKNN/ONNX Opset兼容性参考:解释转换失败根因、opset选型逻辑与YOLOv8等模型的结构约束,并给出可复用的导出与版本基线方法。

本文深度探讨基于 ESP32 Edge AI 架构设计,涵盖 ESP-DL 加速原理、SRAM 与 PSRAM 内存分配策略、以及 AI 模型与固件分离的 OTA 升级方案。为工程师提供从模型压缩到端侧推理落地的完整工程指南,解决边缘 AI 部署中的资源瓶颈与长效维护难题。

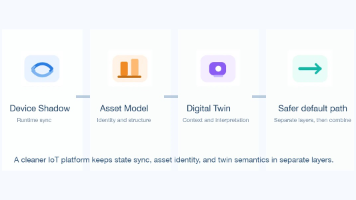

很多 IoT 平台把设备影子(Device Shadow)、数字孪生(Digital Twin)和资产模型(Asset Model)混成一套对象结构,结果状态模型臃肿、查询困难、运维和业务语义相互污染。本文解释三者分别解决什么问题,以及更稳的叠放方式。

在嵌入式系统与物联网(IoT)开发中,实时监控和可视化数据是不可或缺的一环。Serial Studio 是一款开源、跨平台的工具,能够轻松实现从串口、MQTT、BLE(蓝牙低功耗)和网络接口获取数据并实时可视化。本文将深入探讨其功能、技术架构、实际应用场景,并通过示例代码和流程图帮助技术人员快速入门。

SmolRTSP 是一个基于 Rust 实现的轻量级 RTSP 服务器框架,专为嵌入式系统设计。本文深入讲解其协议原理、系统架构、集成方式与性能优化,适合嵌入式开发者阅读实践。