简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

PCA降维技术解析 PCA(主成分分析)是一种有效的数据降维方法,通过线性变换将高维数据投影到低维空间。其核心思想是找到数据方差最大的方向(主成分),保留最重要的信息同时减少冗余特征。PCA通过标准化数据、计算协方差矩阵、提取特征向量等步骤,选择最具代表性的主成分进行降维。这种方法能显著提升模型训练效率(计算量减少50%以上)、增强稳定性(过拟合风险降低30-40%)并改善数据可解释性。典型应用场

摘要: 朴素贝叶斯是一种基于概率的分类模型,其核心思想是通过计算样本特征在不同类别下的出现概率来判断类别归属。它采用“朴素”假设,即特征之间相互独立,虽不完全成立,却在文本分类等任务中表现优异。模型通过贝叶斯公式比较后验概率,分为高斯、多项式和伯努利等变体以适应不同数据类型。其优势在于训练速度快、适合高维稀疏数据(如词频特征),常作为基线模型。尽管假设简化,但因趋势捕捉准确且分类需求相对宽松,朴素

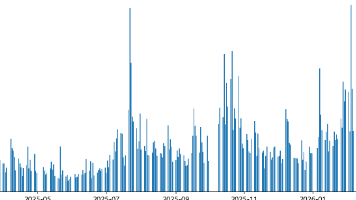

很多人一开始做机器学习项目的时候,会把“上线”想成一个终点。线下训练好了。测试集也过了。接口接好了。模型发到线上。好像项目就结束了。而真实世界有一个很麻烦的特点:它不会老老实实保持不变。用户会变。场景会变。业务规则会变。流量来源会变。数据质量也会变。所以机器学习模型上线以后,不是“放那儿自动一直有效”,而是需要你持续盯着看。

摘要 机器学习模型在线下表现良好但上线效果不佳的常见原因是数据分布变化。这指的是模型训练时的数据分布与线上实际数据分布不一致,导致模型在新环境中表现下降。常见的数据分布变化类型包括:输入特征分布变化(covariate shift)、标签规律变化(concept drift)和标签分布变化。此外,线上线下特征工程不一致也可能造成类似现象。为预防这类问题,建议采用时间切分而非随机切分的评估方式,进行

本文系统梳理了机器学习项目从问题定义到上线前的完整流程。首先强调问题定义的重要性,包括明确预测目标、任务类型和业务应用场景。其次指出需要评估项目可行性,考虑数据质量、标签定义和预测时点等关键因素。在建模环节,建议先建立简单baseline而非追求复杂模型,重点做好特征工程和数据评估。最后强调模型调优应基于错误分析,而非盲目调参。全文突出"机器学习项目真正的难点在于前后端链路整合,而非单一

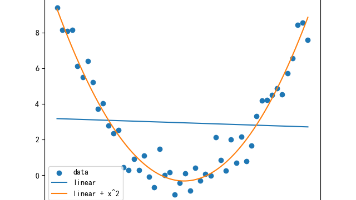

特征工程的数学本质:改变模型的数据视角 本文从数学角度揭示了特征工程的核心价值:通过改变输入空间的表达方式,让模型更容易学习数据中的规律。关键点包括: 特征工程不是改变模型本身,而是改变模型"看到"问题的视角。模型能力不仅取决于算法,更取决于输入特征空间的表达方式。 通过特征映射(如多项式扩展),简单的线性模型也能表达复杂非线性关系。例如添加x²特征后,线性模型可以拟合抛物线。

摘要:特征工程是机器学习的核心环节,其本质是将原始数据转化为更适合模型学习的表达形式。文章指出,好特征往往比更换复杂模型更有效,因为模型性能很大程度上取决于输入特征的质量。特征工程主要包括数据清洗、特征变换、组合和筛选四类操作,其中业务理解是关键,需要将领域知识转化为有效特征。同时需警惕数据泄漏和特征过多带来的问题,如过拟合和噪声干扰。文章通过多个实例说明,特征工程的核心在于提取真正驱动业务的关键

本文通过数学推导解释了机器学习中的偏差-方差分解公式:Error = Bias² + Variance + Noise。首先定义了真实函数、模型预测和噪声的关系,然后逐步拆解误差来源:偏差反映模型表达能力不足,方差体现模型对数据波动的敏感性,噪声则是数据固有不可消除的随机性。文章指出模型复杂度与偏差/方差的权衡关系——简单模型偏差高方差低,复杂模型偏差低方差高,形成典型的U型测试误差曲线。最后强调

摘要:机器学习中的偏差和方差反映了模型在"学不够"和"学太多"之间的平衡问题。偏差大的模型过于简单,无法捕捉数据规律(欠拟合);方差大的模型过于复杂,容易记住噪声(过拟合)。理想状态是找到模型复杂度与泛化能力的平衡点。不同算法参数调整本质上都是在调节偏差-方差权衡。理解这一概念有助于避免盲目追求模型复杂度,选择最适合的模型表现。

摘要: 本文从数学角度解释了防止过拟合的各种方法本质上都是通过控制模型复杂度来实现的。通过分析损失函数、正则化(L1/L2)、决策树剪枝、早停、随机森林、GBDT学习率、SVM等方法的数学原理,揭示了它们都通过限制参数大小、减少特征维度、降低模型自由度等方式来平衡偏差和方差。文章指出,虽然这些方法形式不同,但核心目标一致:适度增加训练误差以降低方差,从而提升模型泛化能力。这种统一视角有助于理解机器