简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

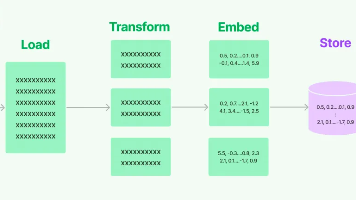

大模型的 “幻觉”(Hallucination)是指模型在生成内容时,输出的信息。这种现象是当前大语言模型(LLM)的核心挑战之一,本质是模型 “记忆偏差” 与 “推理缺陷” 的综合体现,而非真正的 “欺骗”—— 模型本身无法判断输出的 “真实性”,仅基于训练数据的统计规律生成内容。可以说,当应用需求集中在利用大模型去,且知识库足够大,那么除了微调大模型外,就是非常有效的一种缓解大模型推理的“幻觉

Agent是动态协调大语言模型(LLM)与工具(Tools)的智能系统,通过LLM决策大脑自主调用工具完成复杂任务。其核心组件包括LLM、记忆(Memory)、工具(Tools)等,支持任务拆解与动态规划。Agent与AgentExecutor分工明确,前者决策,后者执行。实现方式分为Function Call模式(高效调用固定工具)和ReAct模式(自主决策+工具链式调用),两者可结合使用。通过

LangChain的Tools机制通过整合外部资源扩展了大语言模型的能力。摘要介绍了Tools的核心概念和两种自定义工具的方法:1)使用@tool装饰器快速创建简单工具;2)通过StructuredTool.from_function类方法实现更灵活的配置。两种方式都支持定义工具名称、描述、参数结构等要素,并可通过invoke方法调用。这些工具可以与Agent结合,使LLM能处理实时数据查询、计算

在 LangChain 中,Memory(记忆) 是用于在多轮对话或连续任务中保存和管理上下文信息的核心组件。它解决了大模型 “无状态” 的问题 —— 默认情况下,模型无法记住前序对话内容,而 Memory 能将历史交互数据(如用户提问、模型回答)存储起来,供后续步骤调用,从而实现连贯的多轮对话或任务上下文依赖。例如,在聊天机器人场景中,用户说 “帮我推荐一本科幻小说”,模型推荐《三体》后,用户接