简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

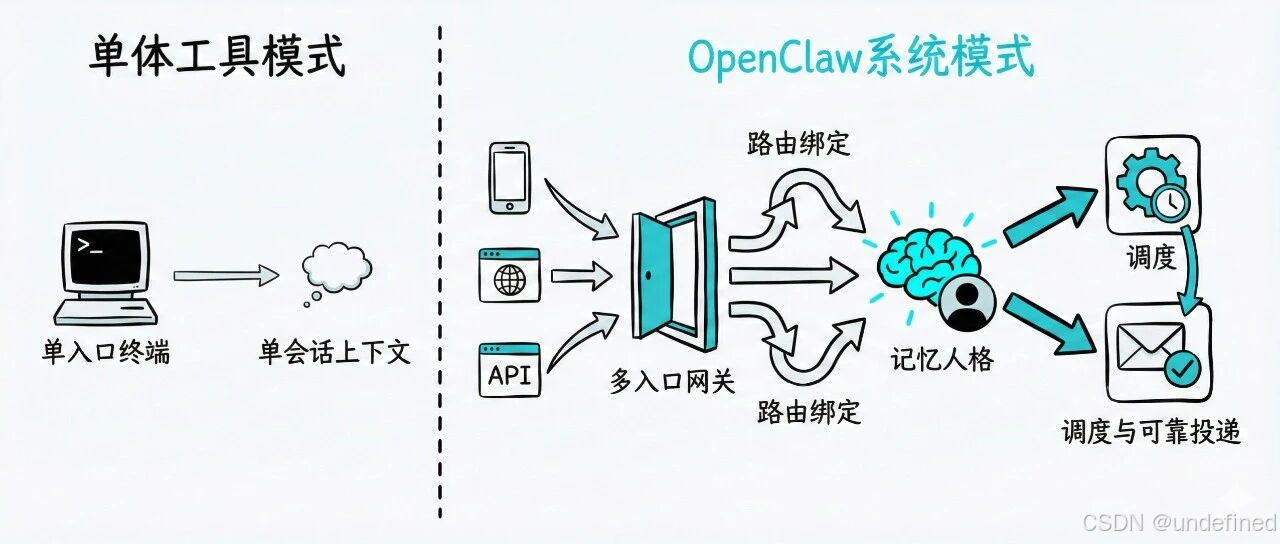

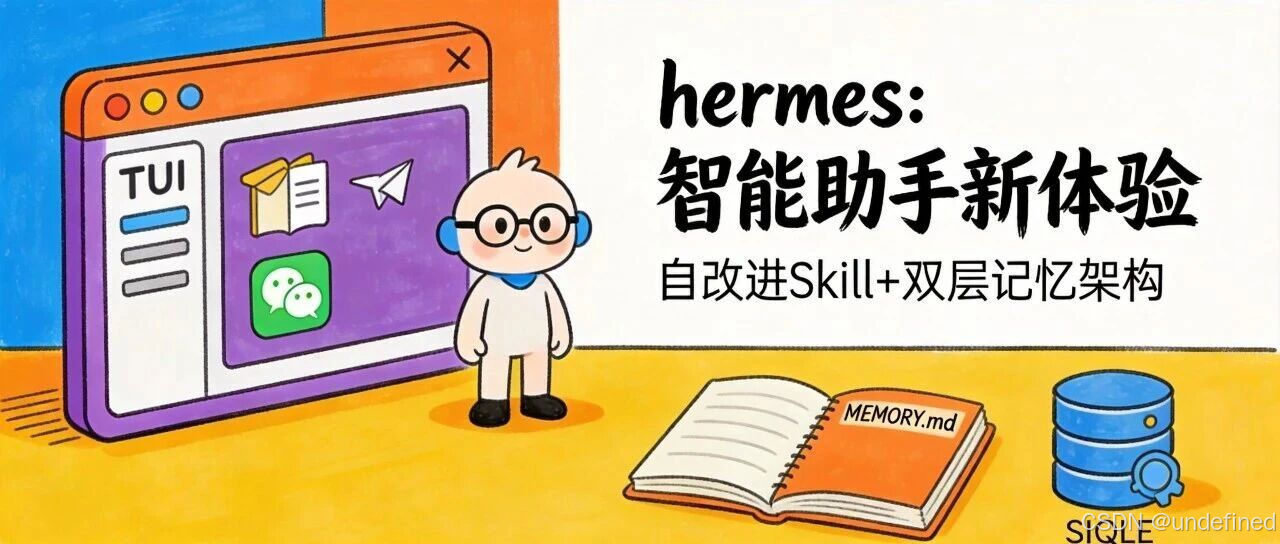

《从OpenClaw到HermesAgent:新一代AI助手的进化体验》 文章对比了OpenClaw和HermesAgent两款AI助手工具。OpenClaw常因版本更新bug、频繁掉线和API费用问题被吐槽,而HermesAgent凭借50k GitHub star展现出强劲势头。核心差异在于: 自改进Skill功能,自动存储和优化任务处理方案 双层记忆架构(L1持久记忆+L2会话搜索)提升效率

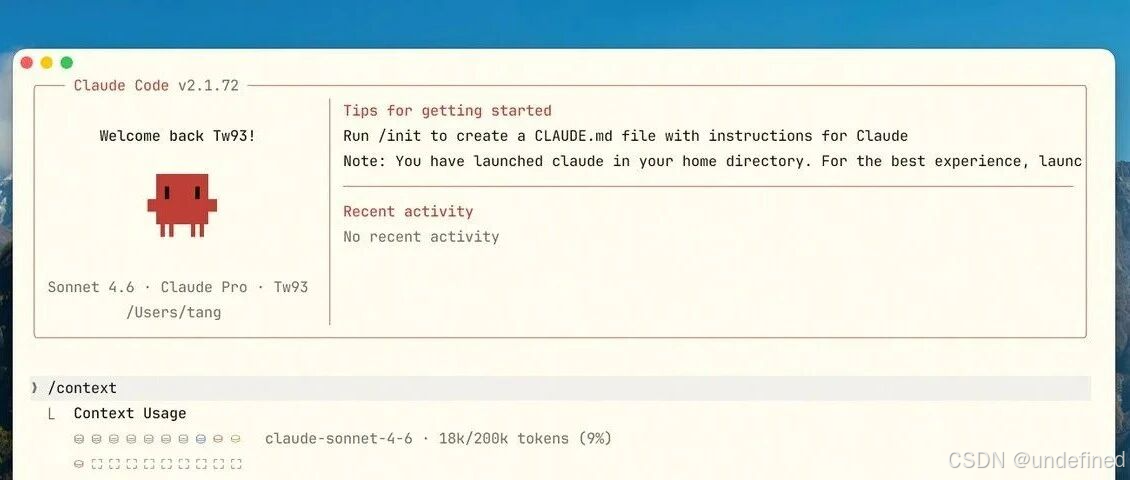

这篇文章是基于 Tw93的一篇长推整理写作的。作者是开源 terminal 项目 Kaku 的作者,深度使用 Claude Code 超过半年,踩了相当多的坑之后,把对Claude Code最核心的判断和工程经验写了出来。我把里面最有价值的部分提炼整理,分享给大家。

用 Hermes 直接指挥本地 CodeX 写代码, Profiles 搭建多Agent实践

最近几天我把过去备战 AI Agent 岗位时积累的复习笔记,整理成了一个公开的 GitHub 仓库: guoguo-tju/agent_java_offer.\x0d\x0a上线几天,已经94 个 Star,今天介绍下这个资料库, 希望对大家转Agent有帮助。

《从OpenClaw到HermesAgent:新一代AI助手的进化体验》 文章对比了OpenClaw和HermesAgent两款AI助手工具。OpenClaw常因版本更新bug、频繁掉线和API费用问题被吐槽,而HermesAgent凭借50k GitHub star展现出强劲势头。核心差异在于: 自改进Skill功能,自动存储和优化任务处理方案 双层记忆架构(L1持久记忆+L2会话搜索)提升效率

《从OpenClaw到HermesAgent:新一代AI助手的进化体验》 文章对比了OpenClaw和HermesAgent两款AI助手工具。OpenClaw常因版本更新bug、频繁掉线和API费用问题被吐槽,而HermesAgent凭借50k GitHub star展现出强劲势头。核心差异在于: 自改进Skill功能,自动存储和优化任务处理方案 双层记忆架构(L1持久记忆+L2会话搜索)提升效率

做AI短剧和漫剧的朋友,开源生成平台可以了解一下 : huobao-drama, github上已经6k+star. 从剧本生成、角色形象、分镜制作,到图生视频、剪辑打包,一条龙服务。

OpenClaw 真正“出圈”的原因,不是某次回答更惊艳,而是它把 AI Agent从“单人对话窗口”推进成“能自主完成任务”

《从OpenClaw到HermesAgent:新一代AI助手的进化体验》 文章对比了OpenClaw和HermesAgent两款AI助手工具。OpenClaw常因版本更新bug、频繁掉线和API费用问题被吐槽,而HermesAgent凭借50k GitHub star展现出强劲势头。核心差异在于: 自改进Skill功能,自动存储和优化任务处理方案 双层记忆架构(L1持久记忆+L2会话搜索)提升效率

摘要:本文介绍了一种基于大模型的个人知识库管理新方法LLMWiki,其核心是将知识管理从临时检索转变为持续编译。系统采用三层架构(原始资料层、结构化知识层、规则层)和四层实现方案(规则层、原文层、知识层、操作层),通过自动化脚本实现知识更新和维护。相比传统RAG系统,LLMWiki能持续沉淀知识,支持交叉归纳和迭代优化,显著提升检索效率和写作质量。作者在Obsidian中实践该方法,实现了知识的自