简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

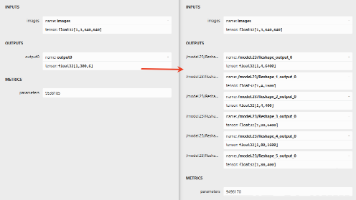

本文通过部署YOLOv26s模型,对比原始模型与简化后模型在精度上的差异。结果显示,简化模型因裁剪后处理节点,有效减少了量化误差,提升了检测精度。

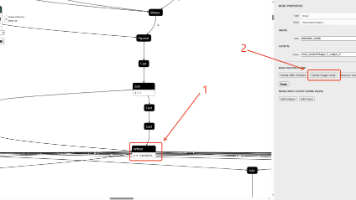

本文介绍了MobileSAM模型在全志开发板T736上的部署流程。主要内容包括:1. 环境配置采用Docker容器方式;2. 模型准备与修改,将输入尺寸从1024×1024调整为448×448以适应NPU限制;3. 使用onnx-modifier工具优化模型结构;4. 详细说明了前后处理代码实现;5. 完成模型转换与交叉编译;6. 在板端验证推理效果。部署过程中针对NPU不支持动态输入的特性进行了

本文介绍了基于全志NPU开发板的YOLOv5-seg模型部署流程。首先通过Docker配置Ubuntu开发环境,然后对原始模型进行ONNX转换和剪枝优化,将后处理移至CPU执行以减少精度损失。接着详细说明了模型的前后处理实现,包括掩码特征提取与原型矩阵乘法等关键步骤。最后提供了完整的模型转换、编译和推理流程,包括量化、仿真和NB模型导出等步骤。测试结果表明,该部署方案能有效运行YOLOv5-seg

注:awnpu_model_zoo\docs里有详细的开发文档以及参考指南本文是根据《NPU开发环境部署参考指南》,部署PC的ubuntu环境,使用Docker镜像环境为例进行说明。如果想对部署流程进行更加详细的了解,可以参考《NPU_模型部署_开发指南》在awnpu_model_zoo内没有的模型,可参考examples里面对应系列的模型进行修改部署,需要自行编写对应模型(如model_conf

部署模型不限于YOLO系列,更多模型参考awnpu_model_zoo。所有案例均支持扩展至全志旗下多个搭载NPU的芯片平台,如V853、MR536及T736等,同时兼容Linux与Android系统。本期内容是以ppyoloe模型和t736(Linux)为例。

部署模型不限于YOLO系列,更多模型参考awnpu_model_zoo。所有案例均支持扩展至全志旗下多个搭载NPU的芯片平台,如V853、MR536及T736等,同时兼容Linux与Android系统。本期内容是以ppyoloe模型和t736(Linux)为例

本文介绍了CLIP模型在全志开发板上的部署流程。首先通过Docker容器配置Ubuntu环境,从Hugging Face获取原始PyTorch模型并导出为ONNX格式,再拆分为图像和文本编码器。通过onnx-modifier工具优化模型结构,固定输入尺寸为(1,20)以简化NPU部署。使用量化数据集对模型进行量化处理,配置前后处理代码后交叉编译生成可执行文件。最终将模型文件推送至开发板进行推理验证

本文介绍了MobileSAM模型在全志开发板T736上的部署流程。主要内容包括:1. 环境配置采用Docker容器方式;2. 模型准备与修改,将输入尺寸从1024×1024调整为448×448以适应NPU限制;3. 使用onnx-modifier工具优化模型结构;4. 详细说明了前后处理代码实现;5. 完成模型转换与交叉编译;6. 在板端验证推理效果。部署过程中针对NPU不支持动态输入的特性进行了

本文介绍了MobileSAM模型在全志开发板T736上的部署流程。主要内容包括:1. 环境配置采用Docker容器方式;2. 模型准备与修改,将输入尺寸从1024×1024调整为448×448以适应NPU限制;3. 使用onnx-modifier工具优化模型结构;4. 详细说明了前后处理代码实现;5. 完成模型转换与交叉编译;6. 在板端验证推理效果。部署过程中针对NPU不支持动态输入的特性进行了

本文介绍了基于全志NPU开发板的YOLOv5-seg模型部署流程。首先通过Docker配置Ubuntu开发环境,然后对原始模型进行ONNX转换和剪枝优化,将后处理移至CPU执行以减少精度损失。接着详细说明了模型的前后处理实现,包括掩码特征提取与原型矩阵乘法等关键步骤。最后提供了完整的模型转换、编译和推理流程,包括量化、仿真和NB模型导出等步骤。测试结果表明,该部署方案能有效运行YOLOv5-seg