简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

AI编程助手正在向更高维度进化:Cursor擅长代码补全但局限于单项目,而OpenClaw展现出跨项目全局认知能力。它能自动梳理多个项目的调用关系、分析技术债务、生成日报,通过本地预处理高效利用Token。相比对话式AI,OpenClaw作为原生本地Agent可直接操作系统资源,实现从"问答"到"执行"的跃迁。这种能力不仅提升效率,更拓展了开发者的认知边界,

AI编程助手正在向更高维度进化:Cursor擅长代码补全但局限于单项目,而OpenClaw展现出跨项目全局认知能力。它能自动梳理多个项目的调用关系、分析技术债务、生成日报,通过本地预处理高效利用Token。相比对话式AI,OpenClaw作为原生本地Agent可直接操作系统资源,实现从"问答"到"执行"的跃迁。这种能力不仅提升效率,更拓展了开发者的认知边界,

AI编程助手正在向更高维度进化:Cursor擅长代码补全但局限于单项目,而OpenClaw展现出跨项目全局认知能力。它能自动梳理多个项目的调用关系、分析技术债务、生成日报,通过本地预处理高效利用Token。相比对话式AI,OpenClaw作为原生本地Agent可直接操作系统资源,实现从"问答"到"执行"的跃迁。这种能力不仅提升效率,更拓展了开发者的认知边界,

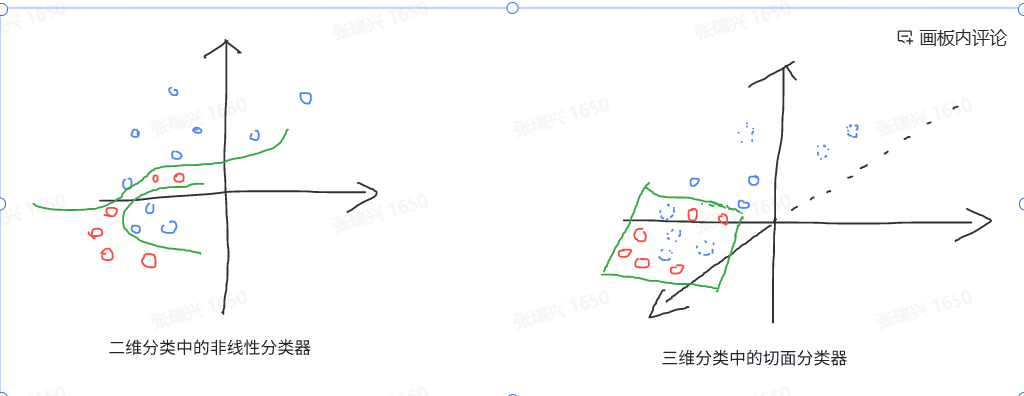

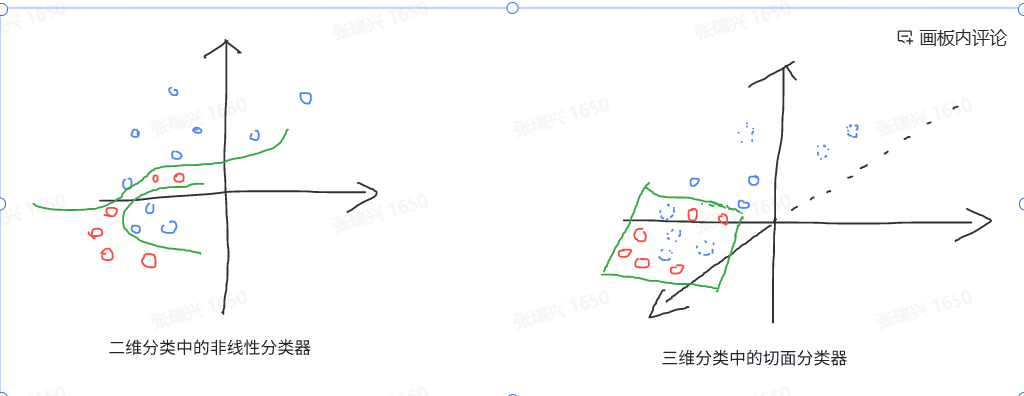

本文旨在对神经网络基础概念进行介绍,然后对NLP领域的发展脉络继续粗述,包括对当前大模型基础的Transfomer结构的由来、发展及原理进行简单说明,让大家对神经网络(深度学习)和当前的大模型以及涉及的预训练、微调等概念有个基本认识,其中涉及的数据学推理等并不作为本文说明的重点,大家有兴趣可以自行研究。(PS:其中涉及一些的对NLP模型的理解,大家见仁见智)

再推荐一篇感觉原理讲的很好的文章:https://blog.csdn.net/u014696921/article/details/53819512

本文旨在对神经网络基础概念进行介绍,然后对NLP领域的发展脉络继续粗述,包括对当前大模型基础的Transfomer结构的由来、发展及原理进行简单说明,让大家对神经网络(深度学习)和当前的大模型以及涉及的预训练、微调等概念有个基本认识,其中涉及的数据学推理等并不作为本文说明的重点,大家有兴趣可以自行研究。(PS:其中涉及一些的对NLP模型的理解,大家见仁见智)