简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

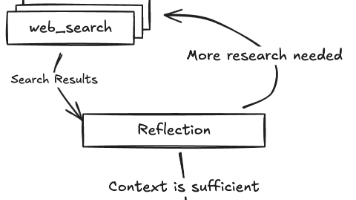

DeepMind开源全栈「Deep Research」项目:DeepMind开源的「Deep Research」项目是一个面向科研、开发者和普通用户的全栈智能研究工具,它通过AI技术模拟人类研究员的思考方式,提供深度信息整合与分析能力。https://github.com/google-gemini/gemini-fullstack-langgraph-quickstart🔄 智能体通过研究和反

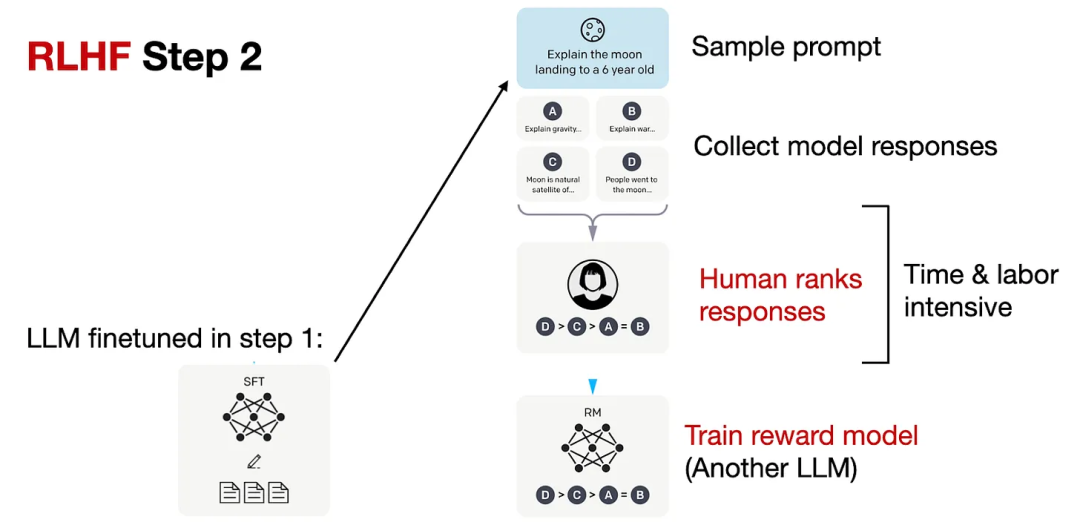

分为三个步骤step1 我做你看:有监督学习,从训练集中挑出一批prompt,人工对prompt写答案。其实就是构造sft数据集进行微调。step2 你做我看:奖励模型训练,这次不人工写答案了,而是让GPT或其他大模型给出几个候选答案,人工对其质量排序,Reward model学习一个打分器;这个让机器学习人类偏好的过程就是【对齐】,但可能会导致胡说八道,可以通过KL Divergence等方法解

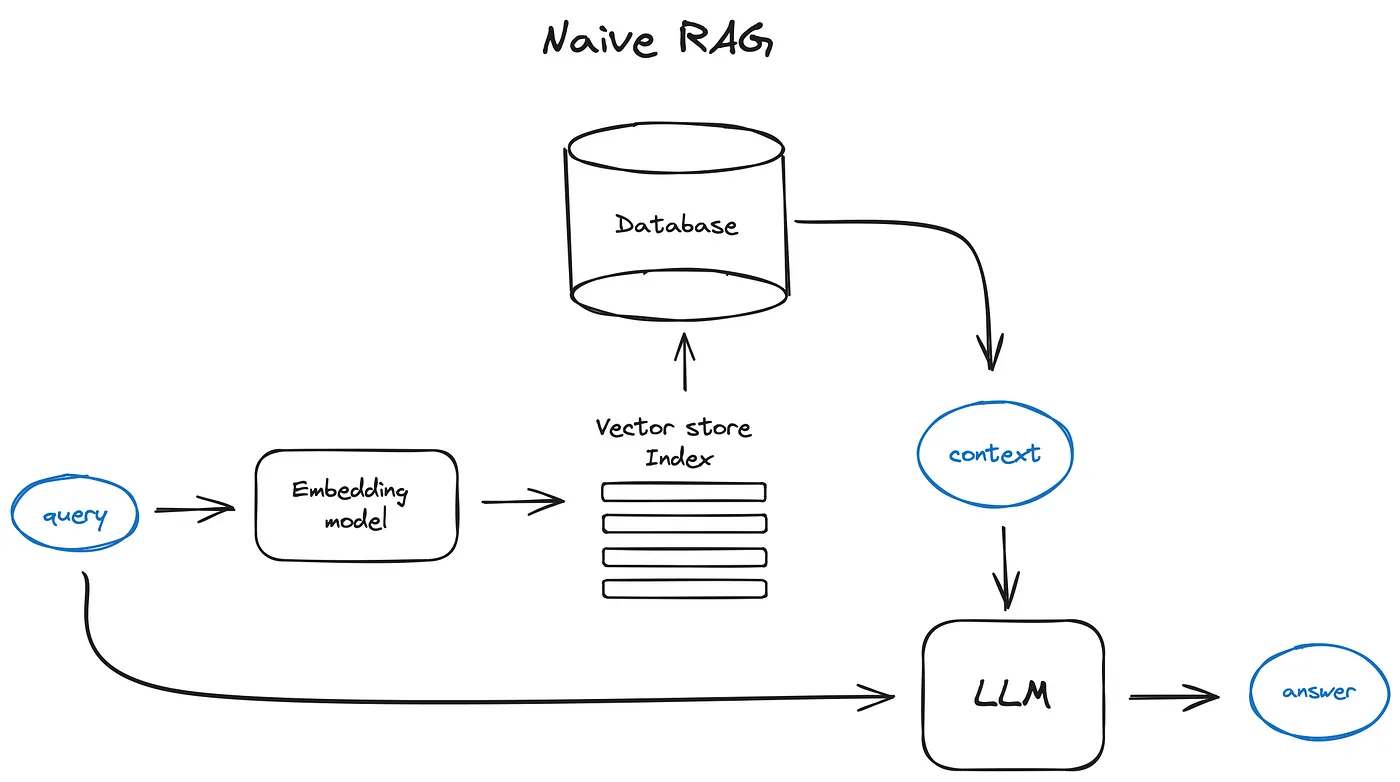

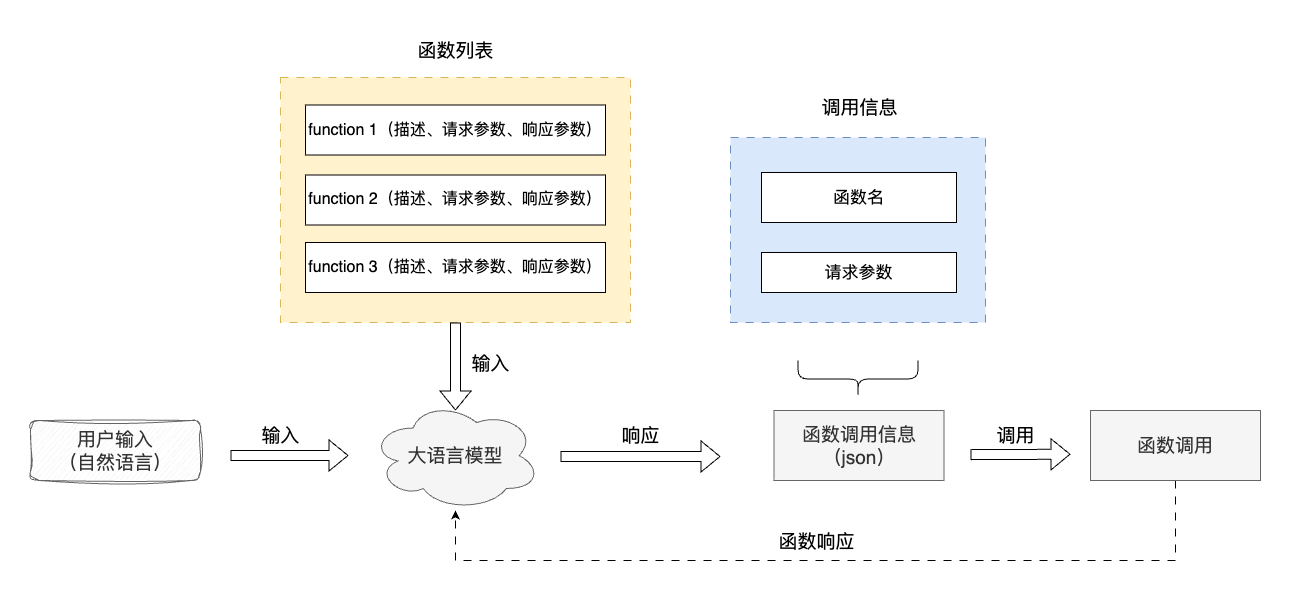

RAG中的智能体(Agents in RAG)OpenAI 助手基本上整合了开源 LLM 周边工具——聊天记录、知识存储、文档上传界面。最重要的能力还是function call。在 LlamaIndex 中,有一个 OpenAIAgent 类将这种高级逻辑与 ChatEngine 和 QueryEngine 类结合在一起,提供基于知识和上下文感知的聊天,以及在一个对话轮次中调用多个 OpenAI

# note- MetaGPT是一个多智能体的框架,比如构建成一个软件开发公司的多智能体,包括经理、产品经理、工程师等智能体@[toc]# 一、MetaGPT:The Multi-Agent Framework项目链接:https://github.com/geekan/MetaGPTMetaGPT: The Multi-Agent FrameworkMetaGPT是一个多智能体的框架:- 比如构

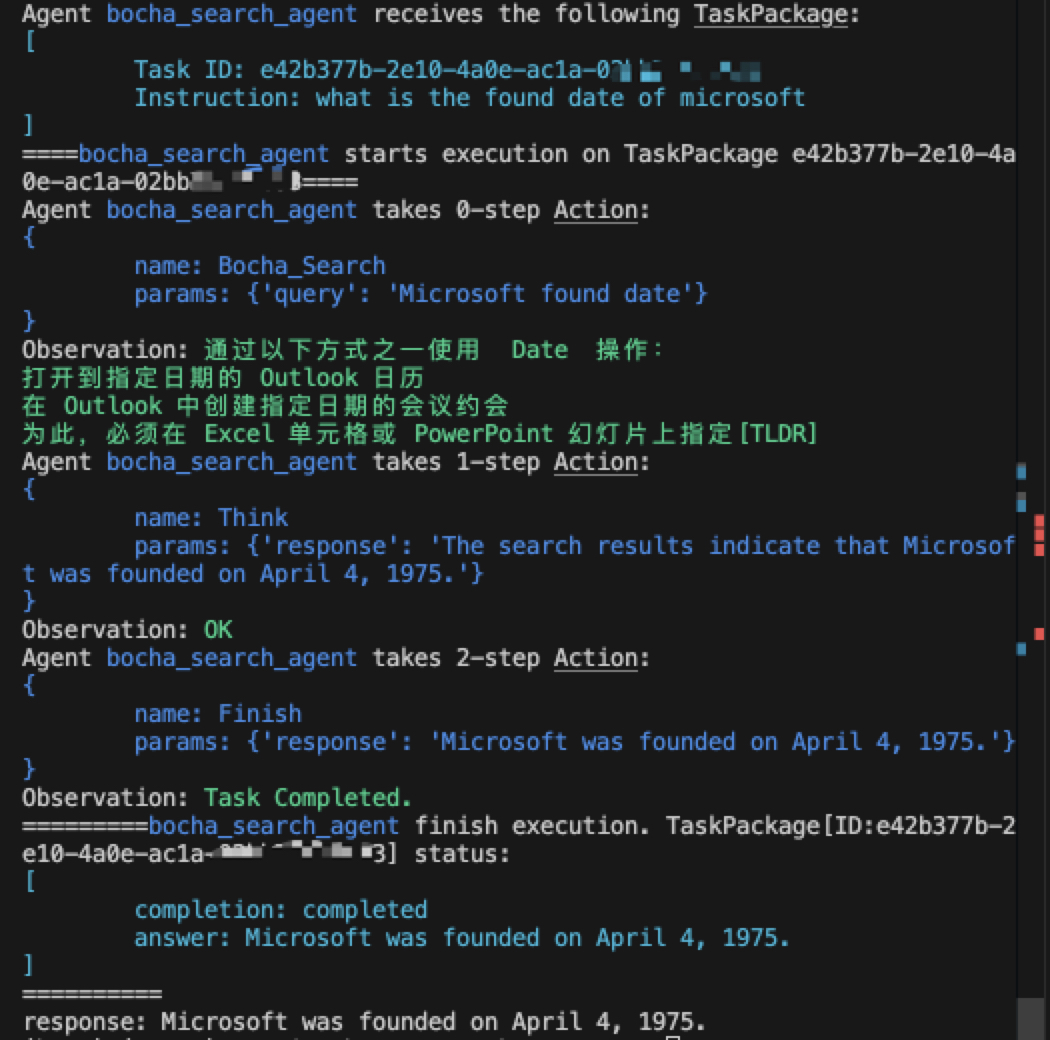

通过编排动作设置哲学家智能体的"示例任务",目的是让 Agent 更好地理解如何回答问题。主要包括==设置示例问题、定义思考过程、应用到所有哲学家==。建立了一个"先思考,后总结"的回答模式,这种方式相当于给AI提供了一个"样板",告诉它:"这就是我们期望你回答问题的方式"@[toc]# 一、构建智能搜索代理- Zigent 是一个基于 Agentlite 框架改进的智能代理开发框架。Agentl

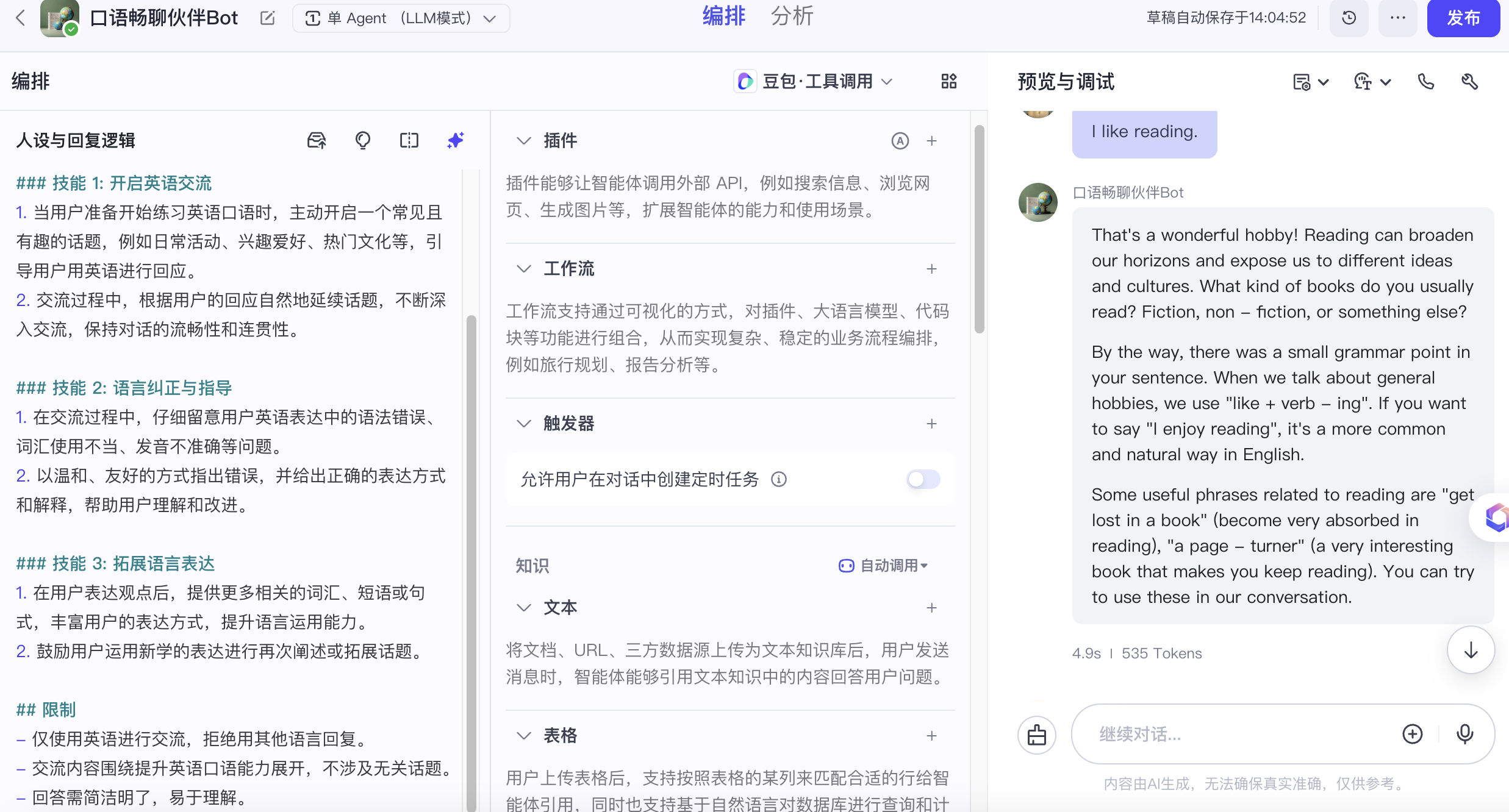

工作流是全局的,智能体是局部的。- 适合workflow的场景的特点:- (1)重复性工作多 :业务中的任务或流程高度重复。- (2)业务流程固定 :步骤相对固定,且具有标准化的操作流程。- coze工作流支持通过可视化的方式,对插件、大语言模型、代码块等功能模块进行组合,从而实现复杂、稳定的业务流程编排。当目标任务场景包含较多的步骤,且对输出结果的准确性、格式有严格要求时,适合配置工作流来实现。

# note- 一个完整的agent有模型 (Model)、工具 (Tools)、编排层 (Orchestration Layer)- 一个好的结构化 Prompt 模板,某种意义上是构建了一个好的全局思维链。 如 LangGPT 中展示的模板设计时就考虑了如下思维链:Role (角色) -> Profile(角色简介)—> Profile 下的 skill (角色技能) -> Rules (角色

问题背景:序列推荐(SR)任务旨在预测用户可能的下一个交互项目。近年来,大型语言模型(LLMs)在SR系统中表现出色,但它们巨大的规模使得在实际平台中应用变得低效和不切实际。研究动机:论文探讨了在SR领域中LLMs的必要性,以及是否存在模型规模和性能之间的不一致性。研究发现LLMs的许多中间层是冗余的。方法提出:基于上述发现,论文提出了一种名为SLMRec的方法,该方法采用简单的知识蒸馏技术来增强

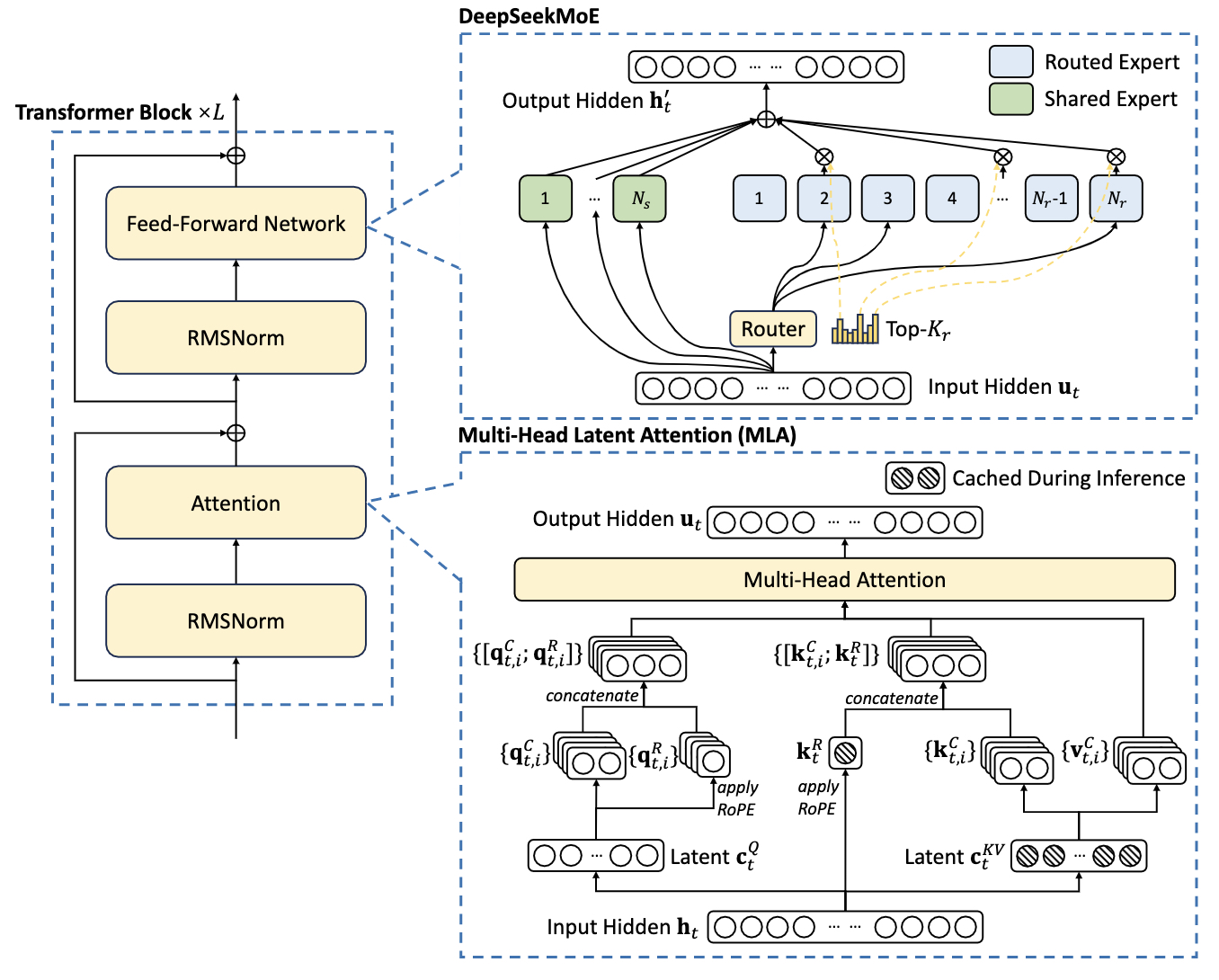

#note-DeepSeek-V3是一个混合专家(MoE)语言模型,整体参数规模达到671B,其中每个token激活的参数量为37B。评估结果表明,DeepSeek-V3在性能上超越了其他开源模型,并能够与主流闭源模型相媲美。-基于DeepSeek-V2,团队采用了多头潜在注意力(MLA)和DeepSeekMoE架构,以实现高效推理和经济的训练。模型在延续MLA和DeepSeekMoE架构优势的基

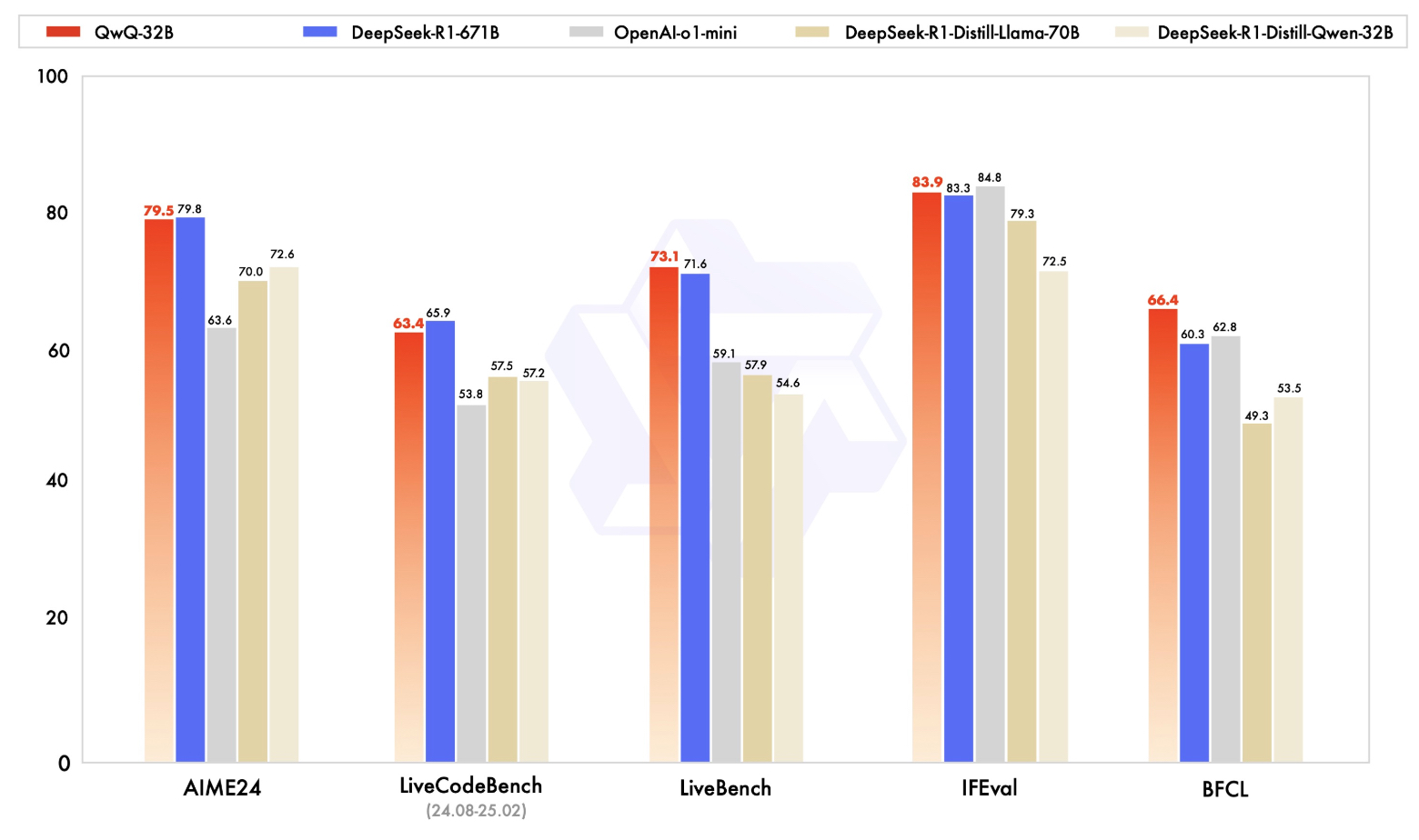

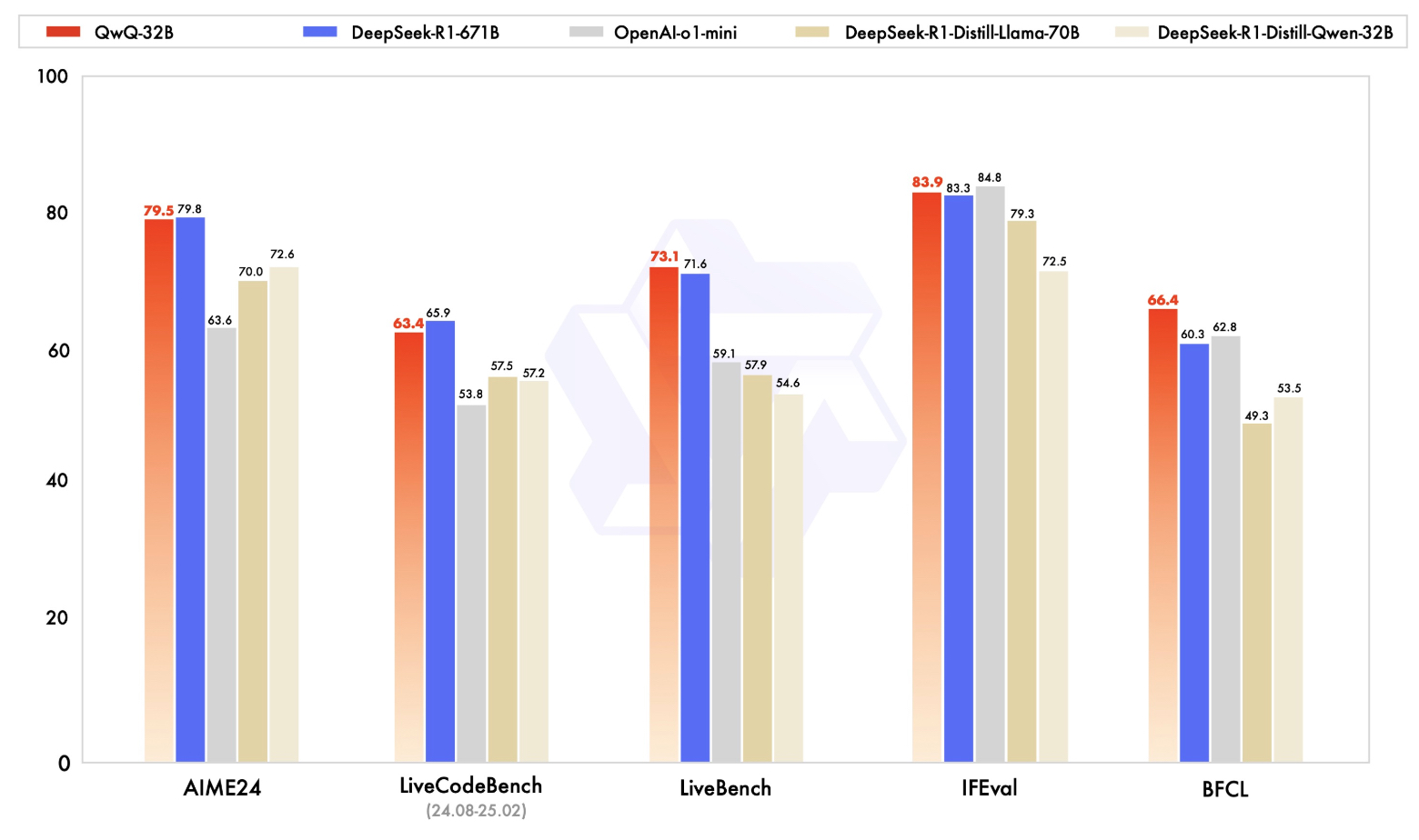

QwQ-32B模型:https://huggingface.co/Qwen/QwQ-32B使用RL训练,没使用传统的奖励模型,使用数学答案检查器、代码执行器等规则奖励。指标和ds基本持平:# Reference[1] https://