简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

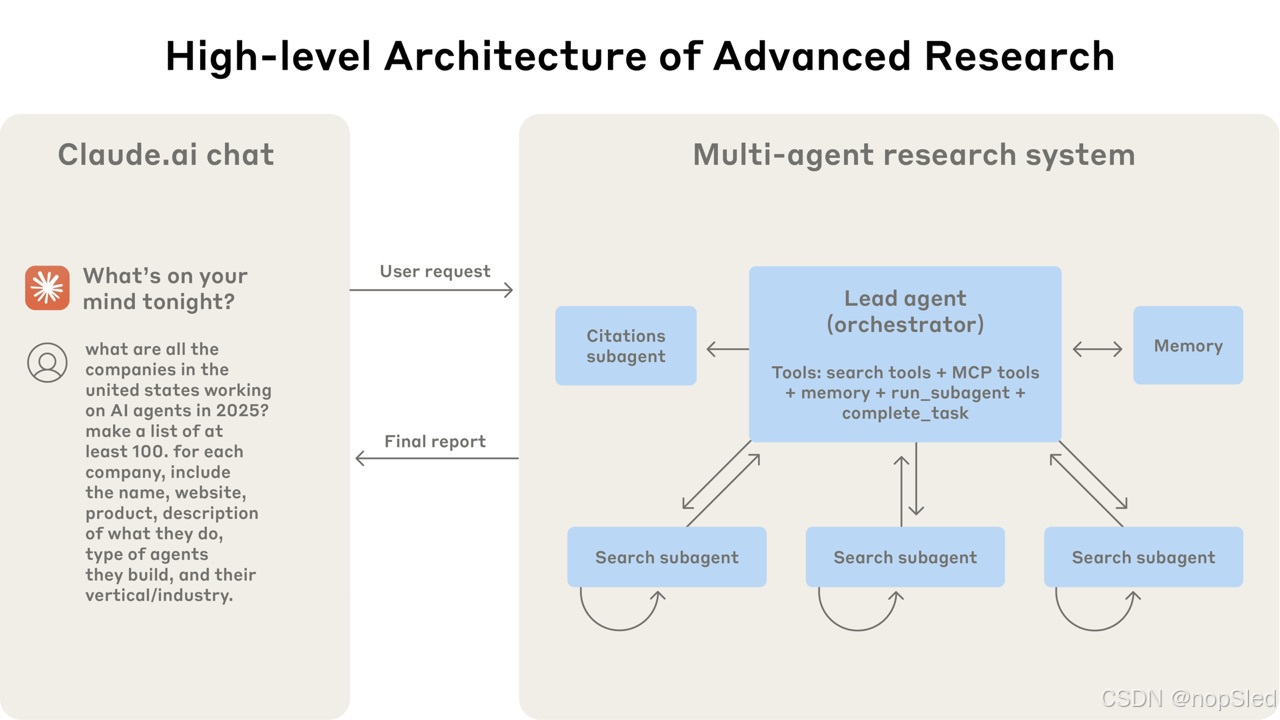

Claude 现在拥有 Research 能力,可以跨网络、Google Workspace 和任何集成进行搜索,以完成复杂的任务。 这个多智能体系统从原型到生产的历程,教会了我们关于系统架构、工具设计和提示工程的重要经验。多智能体系统由多个智能体(LLM)组成,它们以循环的方式自主使用工具。我们的 Research 功能包含一个智能体,它会根据用户查询规划研究流程,然后使用工具创建并行智能

github:https://github.com/makeplanetoheaven/NlpModel/tree/master/SimNet/TransformerDSSM背景知识FSMN和DFSMN系列模型的背景知识可参考如下两篇博客:1.FSMN结构快速解读2.DFSMN结构快速解读基于CNN+DFSMN的声学模型实现本模型是在传统CNN模型的基础上,引入2018年阿里提出的声学...

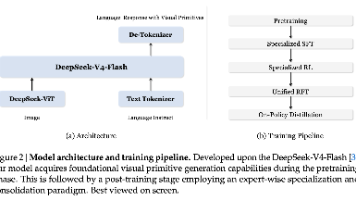

On-policy distillation(OPD)已成为 LLM 领域中一种流行的训练范式。与仅从环境中可验证结果获取稀疏信号的强化学习(RLVR)不同,OPD 选择一个规模更大的模型作为 teacher,为每个采样轨迹提供密集且细粒度的信号。近年来,该领域探索了 on-policy self-distillation(OPSD),其中同一个模型既作为 teacher 又作为 student,

摘要 本文提出"Thinking with Visual Primitives"新型推理框架,通过将空间token(点/边界框)作为最小思维单元,有效解决多模态推理中的Reference Gap问题。模型采用高效架构设计,结合压缩稀疏注意力机制,仅需少量视觉token即可实现与GPT-5.4等前沿模型相当的推理性能。研究通过大规模网络数据构建和两阶段过滤流程,确保了视觉基元数据的质量和多样性。实验

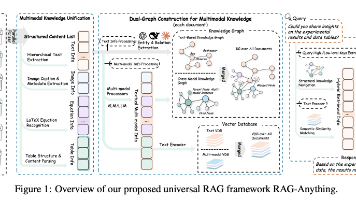

检索增强生成(RAG)已成为突破大语言模型静态训练局限、扩展其应用范围的基本范式。然而,当前 RAG 的能力与现实世界的信息环境之间存在着严重的脱节。现代知识库本质上是多模态的,包含丰富的文本内容、视觉元素、结构化表格和数学表达式的组合。然而,现有的 RAG 框架仅限于文本内容,这在处理多模态文档时造成了根本性的缺陷。我们提出了 **RAG-Anything**,一个能够跨所有模态进行全面知识检索

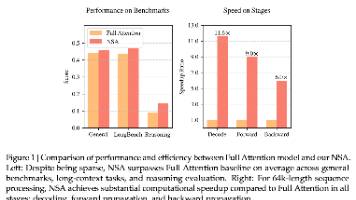

长上下文建模对于下一代语言模型至关重要,然而,标准注意力机制的高计算成本带来了巨大的计算挑战。稀疏注意力机制为在保持模型性能的同时为提高效率提供了一个很有前景的方向。**我们提出了 Natively trainable Sparse Attention ——NSA,它将算法创新与硬件优化相结合,实现了高效的长上下文建模**。NSA采用动态分层稀疏策略,结合了粗粒度 token 压缩和细粒度 tok

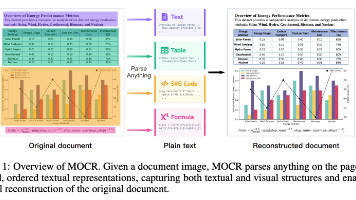

我们提出了一种名为 **dots.mocr** 的 Multimodal OCR (MOCR) 文档解析范式,**它将文本和图形联合解析为统一的文本表示**。与传统的 OCR 系统专注于文本识别并将图形区域裁剪为像素不同,我们的方法将图表、示意图、表格和图标等视觉元素视为一级解析目标,使系统能够在解析文档的同时保留元素间的语义关系。**该方法具有以下几个优势**:(1)它将文本和图形都重构为结构化

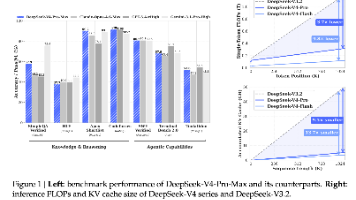

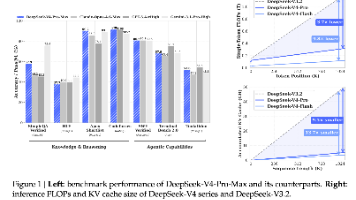

我们发布了 DeepSeek-V4 系列的预览版,其中包括两个强大的混合专家 (MoE) 语言模型:**DeepSeek-V4-Pro**(参数量 1.6T,激活参数 49B)和 **DeepSeek-V4-Flash**(参数量 284B,激活参数 13B),两者均支持百万级上下文长度。DeepSeek-V4 系列在架构和优化方面进行了多项关键升级:(1) **混合注意力架构**,结合了压缩稀疏

我们发布了 DeepSeek-V4 系列的预览版,其中包括两个强大的混合专家 (MoE) 语言模型:**DeepSeek-V4-Pro**(参数量 1.6T,激活参数 49B)和 **DeepSeek-V4-Flash**(参数量 284B,激活参数 13B),两者均支持百万级上下文长度。DeepSeek-V4 系列在架构和优化方面进行了多项关键升级:(1) **混合注意力架构**,结合了压缩稀疏

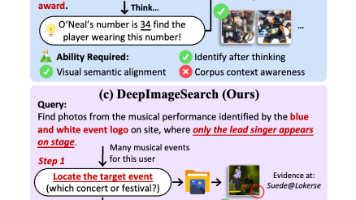

现有的多模态检索系统在语义匹配方面表现出色,但它们隐含地假设 query-image 的相关性可以独立衡量。这种范式忽略了真实视觉流中固有的丰富依赖关系,其中信息分布在时间序列中,而非局限于单个快照。为了弥补这一不足,我们引入了**DeepImageSearch**,一种新的智能体范式,它将图像检索重新定义为一个自主探索任务。模型必须规划并对原始视觉历史进行多步骤推理,以基于隐式上下文线索定位目标