简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

提示词(Prompt)是用户提供给AI模型的输入指令,用于指导其生成特定输出。提示词工程则是设计、优化这些指令的过程,旨在提升输出的准确性、相关性和可用性。

大模型学习指南:从概念到实践 本文系统介绍了大模型的核心知识与应用方法。首先解析大模型(Large Language Model)的基本概念,指出其基于Transformer架构,具备文本生成、问答等复杂任务处理能力。其次对比国内外主流大模型选型策略:国外推荐GPT-5.4/Claude4.6或Gemini,国内建议DeepSeek/通义等方案。重点演示了API调用方法,包括OpenAI标准接口和

大模型学习指南:从概念到实践 本文系统介绍了大模型的核心知识与应用方法。首先解析大模型(Large Language Model)的基本概念,指出其基于Transformer架构,具备文本生成、问答等复杂任务处理能力。其次对比国内外主流大模型选型策略:国外推荐GPT-5.4/Claude4.6或Gemini,国内建议DeepSeek/通义等方案。重点演示了API调用方法,包括OpenAI标准接口和

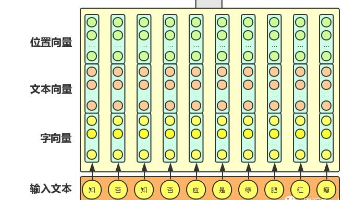

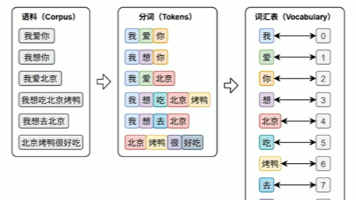

本文系统介绍了文本表示技术在自然语言处理中的核心地位和发展历程。首先阐述了分词的基础作用,详细对比了英文和中文在词级、字符级、子词级分词方法上的差异及代表性工具。其次,深入解析了词表示方法从One-hot编码到语义化词向量(如Word2Vec)的演进,包括Skip-gram和CBOW两种经典模型架构及其训练原理。最后,探讨了上下文相关词表示(如ELMo)对静态词向量的突破性改进。文章通过理论阐述与

基于2017年发布的transform,基于编码器的架构设计BERT(Bidirectional Encoder Representations from Transformers)是由Google于2018年10月提出的一种基于Transformer的预训练语言模型。它在NLP任务中取得了突破性的成果,极大地提升了模型在问答、文本分类等任务上的表现。BERT在机器阅读理解顶级水平测试SQuAD1