简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

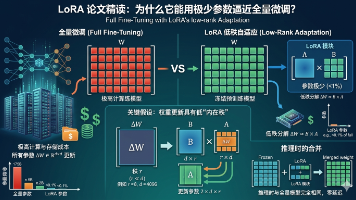

LoRA 论文精读:为什么它能用极少参数逼近全量微调?

LoRA是一种参数高效微调方法,其核心思想是大模型在下游任务适配时,权重变化量具有低秩特性。通过冻结原始参数,仅训练两个低秩矩阵的乘积作为增量更新,LoRA能以极少的参数(可减少10,000倍)逼近全量微调的效果。相比Adapter等方法,LoRA不会增加推理延迟,训练后可直接合并权重。实验表明,在GPT-3等大模型上,LoRA仅需适配注意力层的部分矩阵(如Wq和Wv),使用很小的秩(r=1)就能

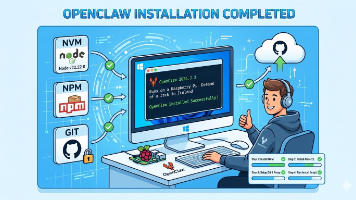

OpenClaw 安装排错笔记(Windows + nvm + Git)

优先检查:1️⃣ Node 版本2️⃣ GitHub 网络3️⃣ Git 代理。

到底了