简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

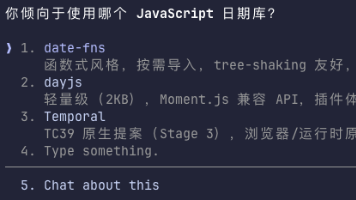

Claude Code 实现了 AI 主动提问机制,通过三层架构协作完成:1) AI 模型层调用 AskUserQuestion 工具并输出结构化 JSON;2) 权限拦截层暂停执行并生成确认对象;3) UI 层渲染交互式组件收集用户输入。该机制通过严格定义输入 schema(限制问题数量、自动包含"Other"选项等)确保 AI 提问规范化,同时保持用户选择自由。系统最终将用户回答回传给 AI

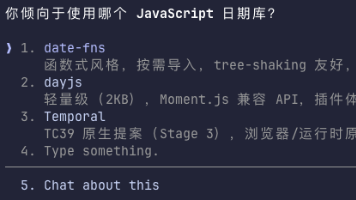

Claude Code 是 Anthropic 出的编程工具,你可以在终端里跟它对话,让它帮你写代码、改 bug、重构项目。现在,AI 看了你的上下文,自己判断"这一刻该给你看一个选择框",于是弹了一个出来。你选完之后,它继续干活。厨师不看提前印好的菜单,而是看你——你今天想吃什么、你有没有忌口、外面下不下雨、今天进了什么好食材——然后现场决定给你出什么选择。

Claude Code 是 Anthropic 出的编程工具,你可以在终端里跟它对话,让它帮你写代码、改 bug、重构项目。现在,AI 看了你的上下文,自己判断"这一刻该给你看一个选择框",于是弹了一个出来。你选完之后,它继续干活。厨师不看提前印好的菜单,而是看你——你今天想吃什么、你有没有忌口、外面下不下雨、今天进了什么好食材——然后现场决定给你出什么选择。

Claude Code 实现了 AI 主动提问机制,通过三层架构协作完成:1) AI 模型层调用 AskUserQuestion 工具并输出结构化 JSON;2) 权限拦截层暂停执行并生成确认对象;3) UI 层渲染交互式组件收集用户输入。该机制通过严格定义输入 schema(限制问题数量、自动包含"Other"选项等)确保 AI 提问规范化,同时保持用户选择自由。系统最终将用户回答回传给 AI

压缩率高 ────────────────────────────────────────────│ (旧消息→9段摘要,~90%压缩)││ (旧消息→笔记,最近保留原文,~70%压缩)││ (只清工具结果,~30%压缩)│低 ────────────────────────────────────────────│<──── 旧 │─────── 近 ──────>│ 新 ││ 轮次 轮次 │轮

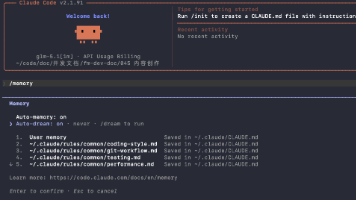

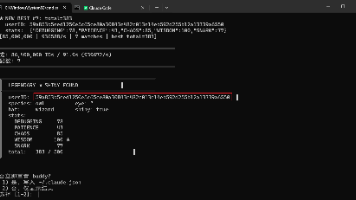

Claude Code 2.1.89 内置的虚拟宠物系统 Buddy 通过 /buddy 命令孵化 ASCII 宠物,具有 18 种物种和 5 个稀有度等级。系统采用确定性生成机制,基于用户 ID 确保同一用户始终获得相同宠物。宠物属性分为不持久化的"骨骼"(由 PRNG 计算)和持久化的"灵魂"(AI 生成的名字与性格)。渲染系统支持 ASCII 精灵动画

摘要:Claude Code 通过 Extract Memories 和 AutoDream 两个子系统实现类人记忆管理。Extract Memories 在每轮对话后异步提取关键信息(用户偏好、反馈、项目上下文等),按类型分类存储。AutoDream 则定期(24小时+5个会话后)对记忆进行整合优化,模仿人类睡眠中的记忆巩固机制。系统通过严格门控控制触发频率,并定义了四类记忆(user/feed

摘要:Claude Code v2.1.90版本已禁用/buddy命令,但可通过修改配置文件手动生成宠物。方法:1)编辑~/.claude.json文件,添加companion字段并自定义名称、性格;2)使用GitHub脚本获取userID;3)手动复制userID到配置中。注意保持JSON格式正确,即可绕过限制生成自定义宠物伙伴。该方法保留了底层渲染功能,让用户仍可体验buddy功能。

本文基于Claude Code v2.1.88源码,分析了其工具调用(Tool Use)的安全控制机制。该系统采用六层防御体系保障工具调用的准确性与安全性:(1)Zod Schema强类型校验确保参数格式正确;(2)业务逻辑校验(validateInput)检查具体规则;(3)Hook系统支持前置拦截与参数修改;(4)多层权限决策机制(规则/Hook/AI分类器/用户确认);(5)根据工具危险性自

Claude Code的Agent架构设计包含多个创新理念:1)采用异步生成器实现渐进式响应,提升用户体验;2)流式工具执行机制允许安全并行操作,降低延迟;3)子Agent继承父Agent完整对话历史,优化Prompt缓存;4)内置AI分类器自动审核工具调用的安全性;5)多层拦截机制确保任务完成的可靠性;6)动态投影方式管理长上下文,避免信息丢失;7)通过工具结果持久化策略防止无限递归。这些设计在