简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

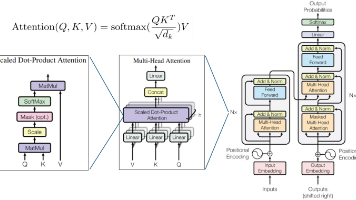

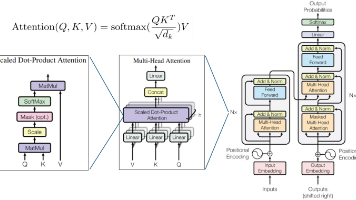

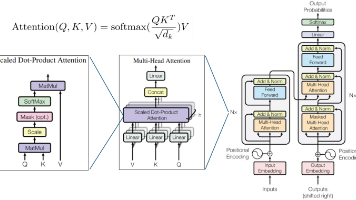

大语言模型(LLM)技术综述:从基础架构到部署应用 本文系统介绍了大语言模型(LLM)的核心技术及其应用流程。首先剖析了Transformer模型的基础架构,包括自注意力机制、归一化方法(LayerNorm/RMSNorm)、位置编码(RoPE)、多头注意力变体(MHA/MQA/GQA)以及优化技术如FlashAttention和KVCache机制。在模型开发环节,详细讲解了HuggingFace

引入违反控制输入或状态约束的罚项,例如对于控制输入 uk\mathbf{u}_kuk 的上下限约束,可以定义一个惩罚项:其中是惩罚参数,用来调节约束的严格性。

在pytorch框架下,可以很方便进行深度学习模型的搭建、训练和保存。当模型训练完成后,如何进行模型部署和推理是本文的重点。接下来以resnet模型为例,讲解下述部署和推理方法,并对比不同方法下的推理时间和精度:1)采用pytorch进行推理(python环境)2)采用onnx进行推理(python环境)3)采用tensorrt进行推理(python环境)4)采用tensorrt进行推理(c++环

大语言模型(LLM)技术综述:从基础架构到部署应用 本文系统介绍了大语言模型(LLM)的核心技术及其应用流程。首先剖析了Transformer模型的基础架构,包括自注意力机制、归一化方法(LayerNorm/RMSNorm)、位置编码(RoPE)、多头注意力变体(MHA/MQA/GQA)以及优化技术如FlashAttention和KVCache机制。在模型开发环节,详细讲解了HuggingFace

大语言模型(LLM)技术综述:从基础架构到部署应用 本文系统介绍了大语言模型(LLM)的核心技术及其应用流程。首先剖析了Transformer模型的基础架构,包括自注意力机制、归一化方法(LayerNorm/RMSNorm)、位置编码(RoPE)、多头注意力变体(MHA/MQA/GQA)以及优化技术如FlashAttention和KVCache机制。在模型开发环节,详细讲解了HuggingFace

top 是 Linux 中一个强大的实时监控工具,其显示的信息分为两部分:系统状态信息和进程列表。grep指令的基本语法:grep [选项] "关键字" [文件路径]ps 是 Linux 系统中用来显示当前运行进程的命令。查看正在运行的进程中包含。