简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

留个纪念,记录下解决问题的思路因为后来翻issue发现官方把问题都修复了(早知道我也去提了 :)有下列问题的,拉一下最新代码就行了吧,除了【未解决】的那个还卡着。在做:π0基于自己的数据集微调 Fine-Tuning Base Models on Your Own Data 的时候遇到各种报错,记录一下。

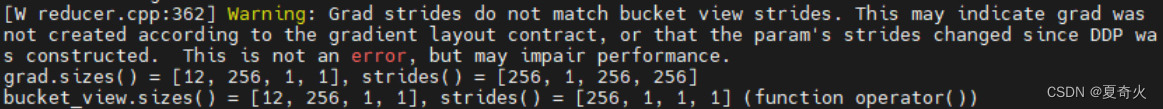

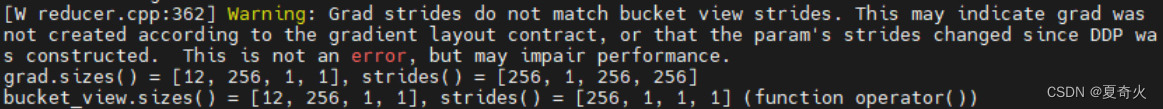

遇到报错: [W reducer.cpp:362] Warning: Grad strides do not match bucket view strides. This may indicate grad was not created according to the gradient layout contract, or that the param’s strides changed

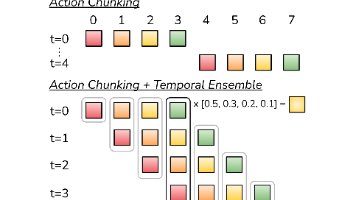

比较简单,算法题目里就写了:Action Chunking with Transformers,比较有特色的地方就是Action Chunking,核心就是不浪费之前做过的推理预测,统统拿过来加权一下,得到最终的答案。

留个纪念,记录下解决问题的思路因为后来翻issue发现官方把问题都修复了(早知道我也去提了 :)有下列问题的,拉一下最新代码就行了吧,除了【未解决】的那个还卡着。在做:π0基于自己的数据集微调 Fine-Tuning Base Models on Your Own Data 的时候遇到各种报错,记录一下。

遇到报错: [W reducer.cpp:362] Warning: Grad strides do not match bucket view strides. This may indicate grad was not created according to the gradient layout contract, or that the param’s strides changed

记录一下做作业的时候遇到的问题。coursera吴恩达机器学习网站ex1零零碎碎的笔记:nx1,或1xn的叫vector,向量,记作RnR^nRn,nxm的叫矩阵,记作 R n x mgradientDescent照公式写就可以了。delta = X'*(X*theta - y); %X'可以不加括号theta = theta - alpha/m*de...

记录一下做作业的时候遇到的问题。coursera吴恩达机器学习网站ex1零零碎碎的笔记:nx1,或1xn的叫vector,向量,记作RnR^nRn,nxm的叫矩阵,记作 R n x mgradientDescent照公式写就可以了。delta = X'*(X*theta - y); %X'可以不加括号theta = theta - alpha/m*de...