简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

从零开始,用 DeepSeek 最新 V4 模型驱动 Claude Code。约 10 分钟搞定。

从零开始,用 DeepSeek 最新 V4 模型驱动 Claude Code。约 10 分钟搞定。

《玩转AI图像编辑:在Bitahub云端部署Qwen-Image-Edit-2511全攻略》摘要: 本文详细介绍了如何在Bitahub平台部署阿里开源的Qwen-Image-Edit-2511图像编辑模型。该扩散模型支持语义级图像修改、老照片修复和画质增强三大功能。教程包含从HuggingFace获取模型组件(Diffusion主模型、CLIP文本编码器、VAE编码器)到Bitahub环境配置的全

该任务的目标是通过对模型的合理运用,精准提取语音特征并将语音转换为文本,进而提升在语音识别、语音内容分析、有声读物转文字等领域的工作效率和应用效果。通过模型提取语音特征并可视化,进而完成语音转文本任务,成功将语音转换为对应的文本内容。绘制模型分类结果的图像,横坐标为时间轴上的帧,纵坐标为类别,通过图像可以直观地观察模型对语音数据不同帧的分类情况。将模型输出转换为可读文本,取每一时间帧概率最高的标签

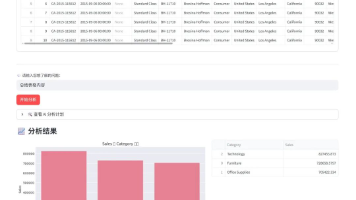

本文介绍了一种基于DeepSeekV3.2Speciale模型的AI数据分析代理系统,能够将自然语言问题转化为结构化分析流程。系统采用三层架构:规划代理生成JSON分析计划,Python工具执行计算和可视化,解释代理输出业务洞察。文章详细说明了环境配置、API获取、数据预处理、执行引擎实现等关键技术点,并展示了如何通过Streamlit构建交互界面。该系统实现了"模型思考-程序执行-人类

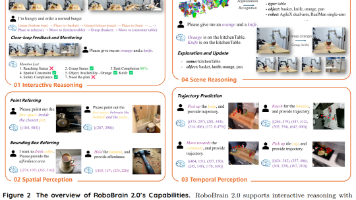

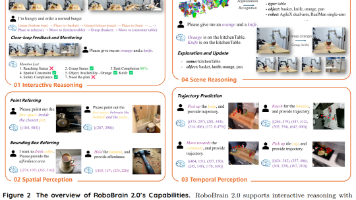

北京智源研究院团队推出RoboBrain2.0多模态大模型,致力于解决数字智能向物理智能转化的三大瓶颈:空间理解、时间建模和推理链条问题。该模型采用模块化架构,支持多模态输入,通过三阶段训练策略逐步提升具身能力。在空间推理和时间建模任务中表现优异,超越GPT-4o等主流模型。未来将重点发展视觉-语言-动作框架和机器人平台集成,推动具身AI生态建设。

北京智源研究院团队推出RoboBrain2.0多模态大模型,致力于解决数字智能向物理智能转化的三大瓶颈:空间理解、时间建模和推理链条问题。该模型采用模块化架构,支持多模态输入,通过三阶段训练策略逐步提升具身能力。在空间推理和时间建模任务中表现优异,超越GPT-4o等主流模型。未来将重点发展视觉-语言-动作框架和机器人平台集成,推动具身AI生态建设。

在 BitaHub 高性能算力的加持下,原本需要数小时手动处理的视频打码任务,现在只需几分钟即可自动化完成。在数字化生存的今天,无论是分享生活瞬间还是发布专业视频,隐私保护已成为不可忽视的环节。),模型便能够自动理解语义并精准定位对应区域,最终完成隐私区域的自动打码,实现真正的“文本驱动式”隐私保护。:代码自动检测 CUDA 环境,确保在 BitaHub 的 GPU 节点上运行,大幅提升视频帧的处

在本期教程中,我们系统走通了 LTX-2 模型的部署流程与 ComfyUI 自定义节点的安装配置,完整搭建了一套高效稳定的文生视频工作流。从基础扩散采样到二阶段高清增强,再到最终视频产出,每一个环节都进行了深入拆解,旨在帮助你全面理解并掌握 AI 视频生成的核心技术路径。同时也强烈推荐大家使用BitaHub 算力平台。在这里,你可以依托强大的算力资源,第一时间体验前沿视频生成模型,大幅缩短 AI

通过这段实战代码,我们不仅仅搭建了一个工具,更是实现了一次“设计工业化”的微型实验。Qwen-Image-2512 的本地部署不仅保障了数据隐私,更利用其强大的文字渲染优势,解决了 AI 绘画“不识字”的历史痛点。AI 的角色在这里发生了转变:它不再是取代设计师,而是将设计师从重复的排版、改字、对齐等繁琐劳动中解放出来,让设计回归到创意与策略本身。