简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

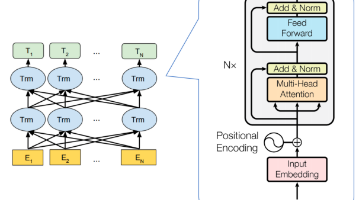

BERT基础模型架构的初识

本文系统介绍了BERT模型的核心架构与训练机制。模型由三部分组成:1)词嵌入模块(包含词向量、分段编码和位置编码);2)Transformer编码器(12层结构);3)预训练微调模块。重点阐述了BERT的两大预训练任务:Masked LM(随机遮蔽15%词汇进行双向预测)和NSP(判断句子连贯性)。文章分析了BERT的优势(强大的语义理解能力、任务适配性强)与局限(参数量大、收敛慢、中文处理不足等

到底了