简介

该用户还未填写简介

擅长的技术栈

未填写擅长的技术栈

可提供的服务

暂无可提供的服务

【Paddle】超越 attention:RWKV-7 架构的 Paddle 实现

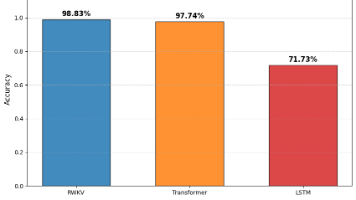

本项目基于PaddlePaddle实现了RWKV-7纯RNN大模型架构,并与Transformer和LSTM进行了对比实验。实验采用"倒背数字"任务,测试模型的长距离记忆能力。结果显示,RWKV-7和Transformer都能较好完成任务,其中RWKV-7在loss下降速度和准确率上表现更优。虽然当前实现因缺少CUDA优化而速度较慢,但验证了RWKV架构结合RNN和Transf

到底了