简介

该用户还未填写简介

擅长的技术栈

可提供的服务

暂无可提供的服务

《2025大模型AI系统化学习路线》摘要:本文系统规划了从入门到精通的大模型学习路径,包含数学基础(线性代数、微积分、概率统计)、编程语言(Python、TensorFlow/PyTorch)、深度学习基础(神经网络、CNN、RNN)、Transformer原理及变种模型(BERT、GPT)、预训练技术等核心内容。学习路线强调理论实践结合,提供分阶段学习目标和实战项目,并涵盖API开发、模型优化及

在2025年的今天,人工智能已不再是实验室里的“黑科技”,而是深刻重塑各行各业的核心驱动力。尤其在大模型(LLM)技术爆发式发展的背景下,企业对具备AI应用能力的工程师需求激增。而在这场技术浪潮中,一个被严重低估的群体——Java开发者,正迎来前所未有的转型黄金期。这不是空谈趋势,而是由真实数据和市场需求共同验证的结论。如果你是一名Java工程师,现在正是你转型为AI大模型应用工程师的最佳时机。

Meta公司发布了人工智能模型——Llama 3.1。那么Llama 3.1 405B的效果怎么样?我们来对比一张图,横向对比一下GPT-4。可以看出,Llama 3.1 405B在各类任务中的表现可以与GPT-4等顶级的模型相差无几。那么,我们怎样才能用到这款强大的Llama 3.1 405B模型呢?最直接的方式是通过Meta.ai平台,但目前这一途径仅对美丽国的用户开放。那有无适合平民用的大模

这里也给大家推荐一个非常全面的大模型项目,包含大模型相关技术原理以及实战经验(大模型工程化、大模型应用落地)。正如开源这个项目的作者所说,天下没有难学的大模型现在国内外还是比较缺乏全面成熟的大模型入门到精通教程,想比较于机器学习,深度学习等传统方向,入门大模型的难度还是比较大的。LLM的框架图如下,可以发现大模型现在也已经发展出挺多分支了,如果想要掌握所有的技术是需要一个比较系统的教程的,所以推荐

就在几年前,“通用人工智能”(Artificial General Inte11igence,AGI)似乎还是一个只存在于科幻小说中的概念,在现实中的实现方法仍在探索中。然而到了2022年,基于大语言模型的AIGC(AI Generated Content)领域的快速发展,使得通用人工智能不再那么遥不可及。研究人员发现,当参数量超过某个值时,基于大语言模型的AIGC系统就能够理解人类用自然语言发布

大模型是一种利用海量数据进行训练的深度神经网络模型,其特点是拥有庞大的参数规模和复杂的计算结构。通过在大规模数据集上进行训练,大模型能够学习到丰富的模式和特征,从而具备强大的泛化能力,可以对未知数据做出准确的预测。这些模型被设计用来解决各种复杂的任务,如自然语言处理、计算机视觉、语音识别和推荐系统等。大模型的出现使得机器具备了更接近人类的智能,能够更好地理解和处理现实世界的复杂情境。大模型在汽车行

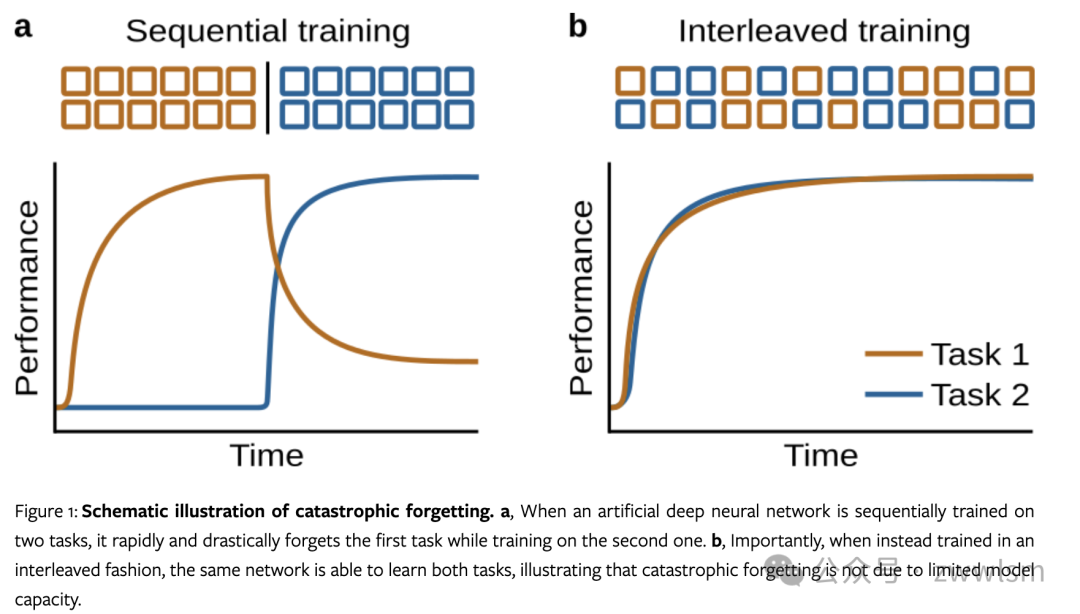

持续学习是智能的关键方面。它指的是从非平稳数据流中增量学习的能力,对于在非平稳世界中运作的自然或人工智能体来说是一项重要技能。人类是优秀的持续学习者,能够在不损害先前学习技能的情况下增量学习新技能,并能够将新信息与先前获得的知识整合和对比。然而,深度神经网络虽然在其他方面可以与人类智能相媲美,但几乎完全缺乏这种持续学习的能力。最引人注目的是,当这些网络被训练学习新事物时,它们倾向于"灾难性地"忘记

摘要 DeepSeek是一家专注于人工智能的创新型科技公司,成立于2023年7月。其发展历程包括发布多个开源大模型,如DeepSeek LLM、DeepSeek-Coder、DeepSeek-V2/V3等,涵盖语言、代码、数学、视觉等多领域任务。DeepSeek模型技术特点包括性能强劲、开源免费、训练成本低,并采用了多头潜注意力(MLA)、混合专家模型(MoE)优化、多令牌预测(MTP)等先进架构

根据脉脉《2023年人才报告》显示:人工智能成为2022最缺人行业,人工智能行业的人才紧缺指数(人才需求量/人才投递量)为0.83,也就是说这个领域人才缺口巨大且没那么卷

近期,机器学习和 AI 研究员、畅销书《Python 机器学习》作者 Sebastian Raschka 又写了一本新书 ——《Build a Large Language Model (From Scratch)》,旨在讲解从头开始构建大型语言模型的整个过程,包括如何创建、训练和调整大型语言模型。这本书的名字叫也就是。