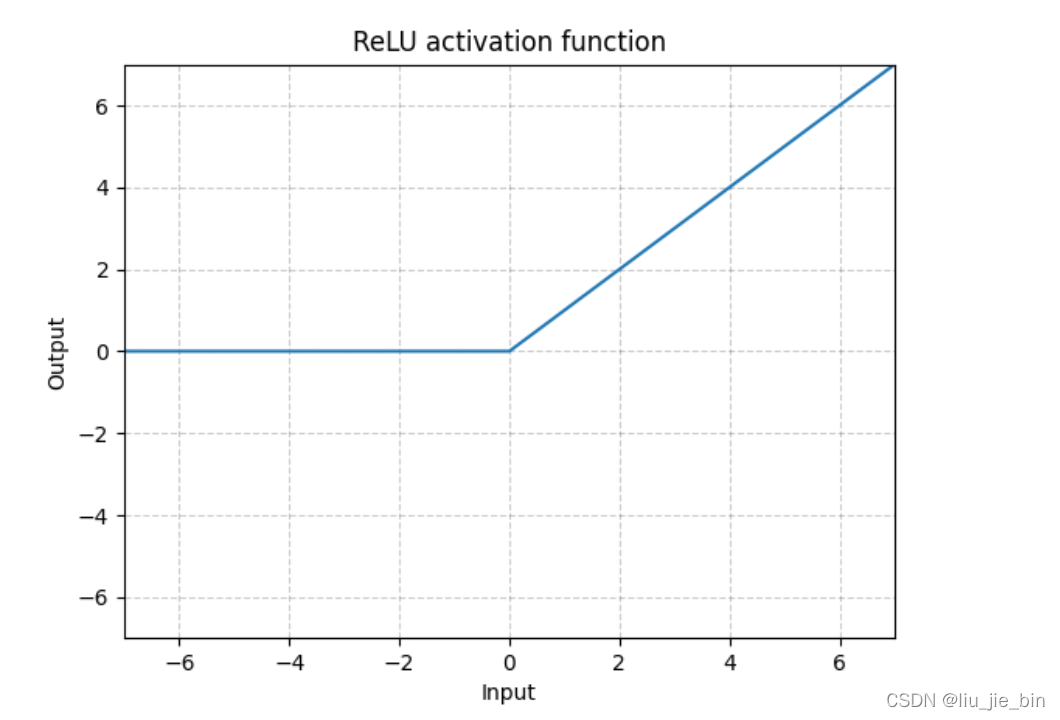

Pytorch学习(五)ReLu激活函数

文章目录概念函数原型参数说明代码示例概念PyTorch实现了常见的激活函数,ReLu为最常用激活函数,其原理就是将小于零的数值截至为0;其数学表达式为:函数原型torch.nn.ReLU(inplace=False)参数说明inplace参数如果设为True,它会把输出直接覆盖到输入中,这样可以节省内存/显存。代码示例input = torch.tensor([[-5,-3,4,5],[3,2,-

·

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)