美团LongCat-ZigZag:极速长文本AI推理新突破

**导语**:美团最新发布的LongCat-Flash-Thinking-ZigZag模型,通过创新的ZigZag稀疏注意力技术,在保持高性能的同时实现长文本处理速度的大幅提升,为AI在长上下文场景的应用开辟新路径。## 行业现状:长文本处理的效率瓶颈随着大语言模型(LLM)应用场景的不断扩展,长文本处理已成为企业级AI应用的核心需求。无论是法律文档分析、代码库理解还是多轮对话系统,都需要

美团LongCat-ZigZag:极速长文本AI推理新突破

导语:美团最新发布的LongCat-Flash-Thinking-ZigZag模型,通过创新的ZigZag稀疏注意力技术,在保持高性能的同时实现长文本处理速度的大幅提升,为AI在长上下文场景的应用开辟新路径。

行业现状:长文本处理的效率瓶颈

随着大语言模型(LLM)应用场景的不断扩展,长文本处理已成为企业级AI应用的核心需求。无论是法律文档分析、代码库理解还是多轮对话系统,都需要模型能够高效处理数万甚至数十万token的上下文。然而,传统全注意力机制的计算复杂度随文本长度呈平方增长,导致推理速度急剧下降,硬件成本居高不下。据行业调研,当上下文长度超过10万token时,现有模型的处理效率往往降低60%以上,严重制约了大模型在实际业务中的落地。

模型亮点:稀疏注意力技术实现效率跃升

LongCat-Flash-Thinking-ZigZag(简称ZigZag)作为美团LongCat系列的最新成员,核心突破在于引入了ZigZag Attention(LoZA)稀疏注意力机制。该技术通过以下创新实现效率与性能的平衡:

1. 有限计算开销的稀疏化方案

LoZA采用"彩票假说"启发的稀疏化策略,仅对模型中可稀疏化的层进行优化,在保持性能损失小于5%的前提下,实现50%的注意力计算量削减。通过在模型训练中期引入稀疏化校准,避免了从零开始训练的高昂成本,整体计算开销仅增加12%。

2. 长上下文场景的极致优化

在256K超长文本处理中,ZigZag实现了预填充速度提升50%、解码成本降低30% 的显著效果。其流式稀疏注意力内核在128K上下文时的解码成本仅为全注意力模型的10%,为实时长文本处理提供了可能。

3. 与主流模型的性能对齐

在数学推理(AIME-25)、工具使用(τ²-Retail)等关键基准测试中,ZigZag性能与全注意力模型LongCat-Flash-Thinking-2601基本持平,部分指标甚至超越DeepSeek-V3.2等竞品,证明了稀疏化方案的有效性。

性能验证:数据揭示效率革命

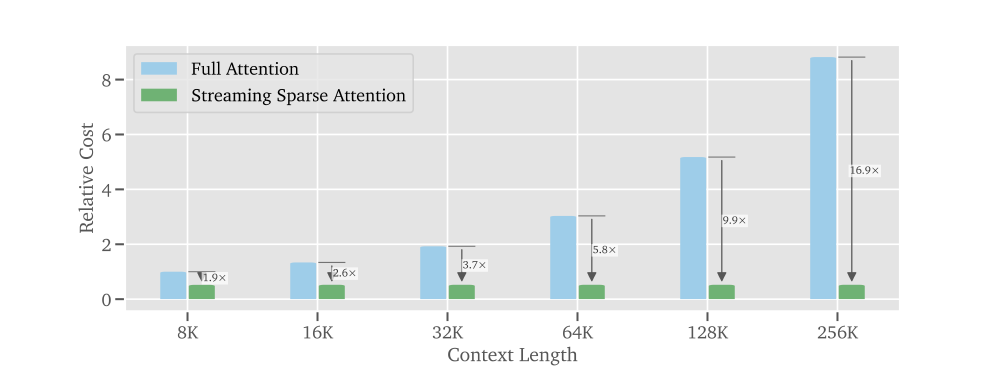

ZigZag的性能优势在多维度测试中得到验证。通过对比全注意力(FA)与流式稀疏注意力(SSA)在不同上下文长度下的表现:

这张柱状图清晰展示了随着上下文长度从8K增加到256K,流式稀疏注意力(SSA)相比全注意力(FA)的成本优势呈指数级扩大。在256K长度时,SSA的相对成本仅为FA的10%左右,直观体现了ZigZag在长文本处理中的效率优势。

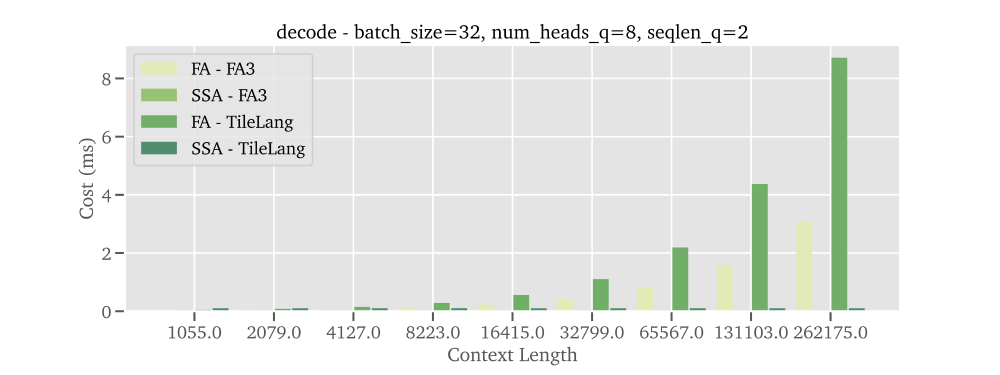

在解码性能方面,ZigZag同样表现出色:

该图显示在batch_size=32的条件下,随着上下文长度增加,采用SSA的ZigZag模型解码耗时增长幅度远低于FA模型。当上下文达到256K时,ZigZag的解码速度比全注意力模型快3倍以上,这对实时交互场景至关重要。

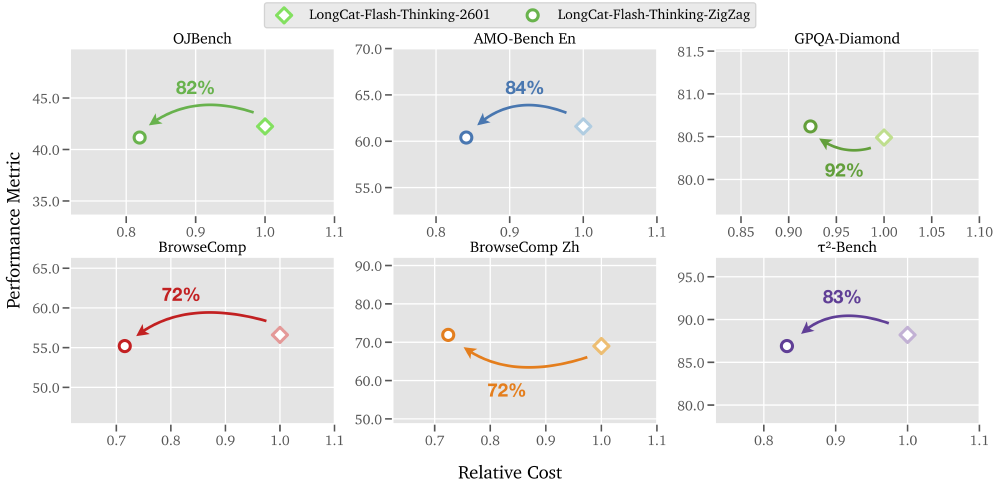

综合性能与成本来看,ZigZag在多个基准测试中展现出显著优势:

此图展示了ZigZag与2601模型在OJBench、AMO-Bench等任务中的表现,ZigZag在保持性能接近的同时,实现了30%-50%的成本节约,验证了其"提速不降质"的设计目标。

行业影响:开启长文本AI应用新纪元

ZigZag的推出将对AI行业产生多维度影响:

技术层面,稀疏注意力技术的成功应用为大模型效率优化提供了新范式,证明通过结构化稀疏化而非单纯增大模型规模,同样可以突破性能瓶颈。美团开源的TileLang内核和SGLang部署支持,将推动整个行业在长文本处理领域的技术进步。

商业层面,50%的速度提升和30%的成本节约,使原本因计算资源限制无法落地的长文本应用成为可能。金融文档分析、医疗记录处理、代码库理解等场景的处理成本将显著降低,加速AI在垂直行业的渗透。

用户体验层面,实时响应的长文本交互成为现实。例如,客服机器人可以瞬间处理完整的历史对话记录,提供更精准的回答;开发者工具能够实时分析百万行代码库,给出智能提示。

结论与前瞻

LongCat-Flash-Thinking-ZigZag通过创新的稀疏注意力技术,在长文本AI推理领域实现了"鱼与熊掌兼得"——既保持了顶尖性能,又大幅提升了处理效率。这一突破不仅体现了美团在大模型优化领域的技术实力,更为行业树立了效率与性能平衡的新标准。

随着模型上下文能力从256K向更高量级迈进,ZigZag的稀疏化策略将展现更大优势。未来,结合动态路由、混合专家(MoE)等技术,我们有理由相信长文本AI处理将进入"极速时代",为企业和用户带来更强大、更经济、更流畅的智能体验。

欢迎来到AMD开发者中国社区,我们致力于为全球开发者提供 ROCm、Ryzen AI Software 和 ZenDNN等全栈软硬件优化支持。携手中国开发者,链接全球开源生态,与你共建开放、协作的技术社区。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

项目地址: https://ai.gitcode.com/meituan-longcat/LongCat-Flash-Thinking-ZigZag

项目地址: https://ai.gitcode.com/meituan-longcat/LongCat-Flash-Thinking-ZigZag

所有评论(0)